306| 云巨头千亿豪赌AI,Nvidia护城河固若金汤?

306| 云巨头千亿豪赌AI,Nvidia护城河固若金汤?

数据存储前沿技术

发布于 2026-03-09 17:40:59

发布于 2026-03-09 17:40:59

全文概览

2026年伊始,科技巨头们便在资本市场投下了一枚重磅炸弹:Meta、微软、谷歌、亚马逊四家公司年度资本支出总额预计将飙升至惊人的6150亿美元,同比增长70%,其中大部分将涌入AI和云基础设施建设。

然而,市场对此的反应并非一片欢腾,反而是深深的忧虑——如此激进的投入,回报周期和确定性究竟在何方?一个令人困惑的现象是,这笔巨额资金的大部分(可能高达60%)最终都流向了Nvidia,但投资者似乎并未因此感到安心。这背后隐藏着怎样的矛盾?当云巨头们一边豪掷千金采购Nvidia GPU,一边又大力推进自家的AI芯片(如AWS Trainium、Google TPU)时,他们真正的战略意图是什么?这究竟是一场旨在摆脱“Nvidia税”的独立战争,还是在产能极度紧缺下的无奈之举?这场围绕算力的军备竞赛,将如何重塑云市场的竞争格局与未来AI技术的成本曲线?

阅读收获

- 洞悉云市场竞争格局的微妙变化:通过最新的ETR调查数据,理解为何GCP能在AI/ML领域实现对AWS的客户渗透率反超,以及Azure如何在增量收入上超越AWS,这些关键指标如何预示着未来市场份额的变动。

- 量化Nvidia的技术护城河:明确Nvidia的12个月创新周期与云厂商18-24个月的自研芯片周期之间的巨大差距,结合其超过20倍的体量优势,深入理解为何其在成本和性能上的领导地位难以被撼动。

- 把握AI服务的核心成本命脉:认识到AI查询带来的百倍成本增长,使得“每令牌成本”成为决定AI服务能否存活的关键。理解为何即使拥有自研芯片,获得Nvidia最新技术的配额仍是云巨头们保持竞争力的生命线。

👉 划线高亮 观点批注

突发分析 由 Dave Vellante[1] 撰写

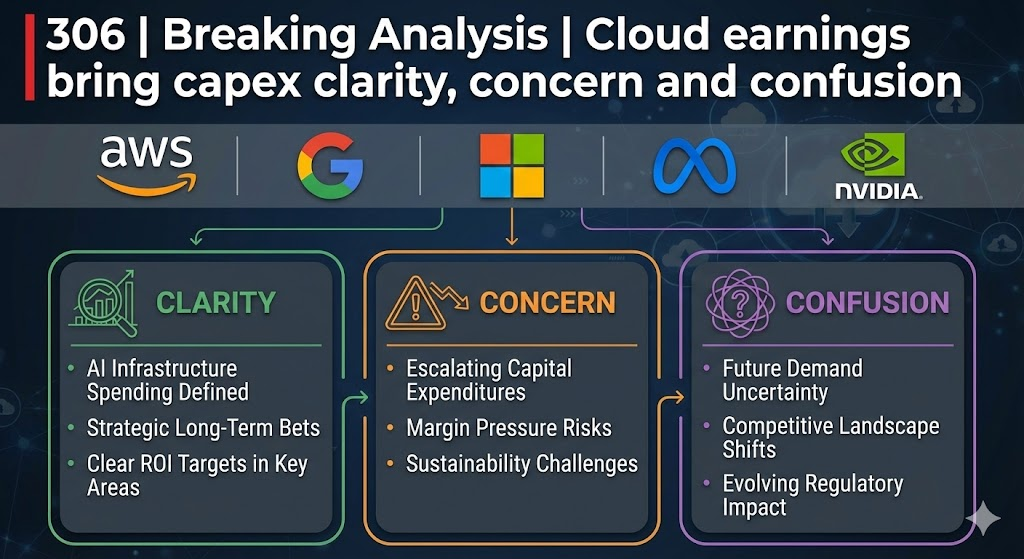

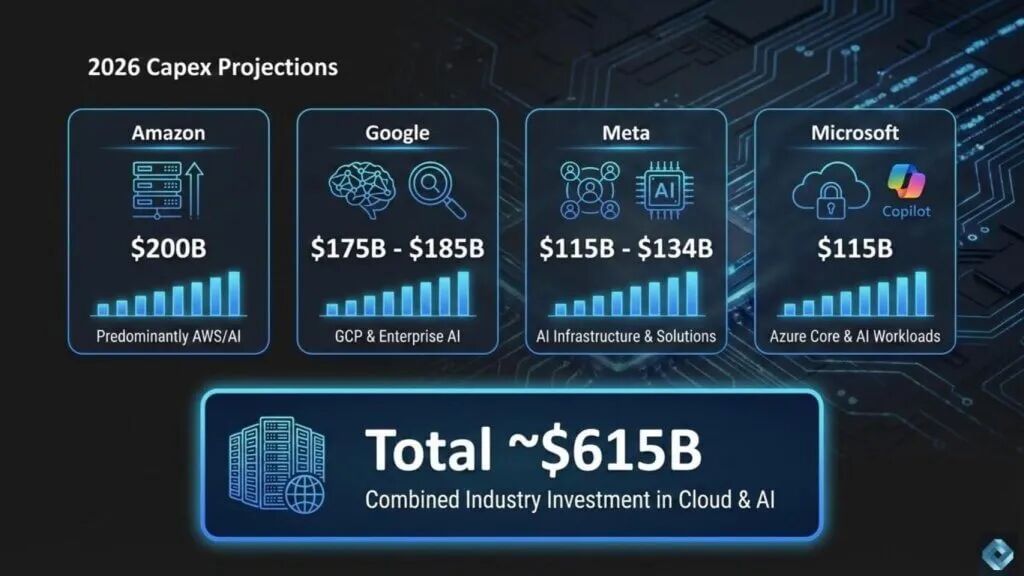

今冬2026年Meta Platforms Inc.、Microsoft Corp.、Alphabet Inc.和Amazon.com Inc.的超大规模财报显示,明确了资本支出正在加速。四家公司合计本年度资本支出将超过6150亿美元,比本已膨胀的2025年增长约70%。

尽管人工智能和通用计算需求强劲,但这一消息引发了市场观察者的重大担忧,因为激进支出带来的回报前景不明朗。加上Anthropic PBC注入的软件即服务攻势,投资者在本周大部分时间里抛售股票,包括Nvidia Corp.。

令人困惑的是,大部分资本支出流向Nvidia——AI部分资本支出的60%可能流向该公司——投资者似乎忽略了这一点。值得注意的是,本周早些时候的抛售后,市场在周五反弹。

在本期突发分析中,我们剖析了公司管理层在本周财报电话会议上的表态,包括我们认为与AI建设演进情景相冲突的一些假设。特别是,虽然运营商们理所当然地关注支付Nvidia的高毛利率,但我们认为观察者低估了Nvidia相对于图形处理单元替代品(包括Advanced Micro Devices Inc.、Intel Corp.和超大规模云厂商)的成本优势。

资本支出冲击与投资者的新心态

资本支出故事不容忽视。周四收盘后发布的亚马逊报告显示,本年度资本支出预测为2000亿美元,股价周五大幅下跌,加上保守的前景展望。谷歌也紧随其后,本年度超过1750亿美元。Meta早前已暗示类似的大手笔资本支出偏好。微软增加了资本支出,但Azure增长环比放缓1个百分点,低于买方预期。这引发了抛售,因为投资者看到了资本支出增长与Azure增长的背离[2],并立即质疑回报时机。

我们认为市场正在重新校准正在进行中的规模。数字惊人。当你将大玩家加总起来,我们谈论的是未来一年约6150亿美元的资本支出。大部分直接针对云和AI。在此基础上,加上去年超过3000亿美元的支出,增幅令观察者担忧。

但我们视之为由资本支出播种的建设周期。市场同时试图回答两个问题:1)基础设施搭建、利用、转化为收入并最终带来运营杠杆需要多长时间;2)近期上行空间有多少被供应、部署时间和将AI整合到产品及企业工作流中的实际工作所限制。

微软的例子突显了这一局面,正如我们上周讨论的。该公司支出增加,但Azure增长未加速。投资者期望两者同步,当未实现时,股价承压,叙事转为负面。我们认为同样的担忧现在正适用于亚马逊和谷歌。然而,Amazon Web Services和Google Cloud均加速了云增长。这表明举证责任已从“AI是未来”转向“让我看到钱”。

来看管理层评论。微软已在上周深入覆盖[3]。重点是亚马逊首席执行官Andy Jassy对AWS的表述,以及谷歌首席执行官Sundar Pichai对谷歌的解释,因为他们的解释将告诉我们这一资本支出激增是领先需求、响应需求,还是仅仅为了跟上赛跑。提示:我们强烈认为兼而有之,包括确保获得Nvidia最新最先进技术的配额。

净值是我们认为市场正进入AI交易的新阶段,资本支出规模不再孤立庆祝。投资者想要基础设施支出、增长和回报之间更紧密的联系。

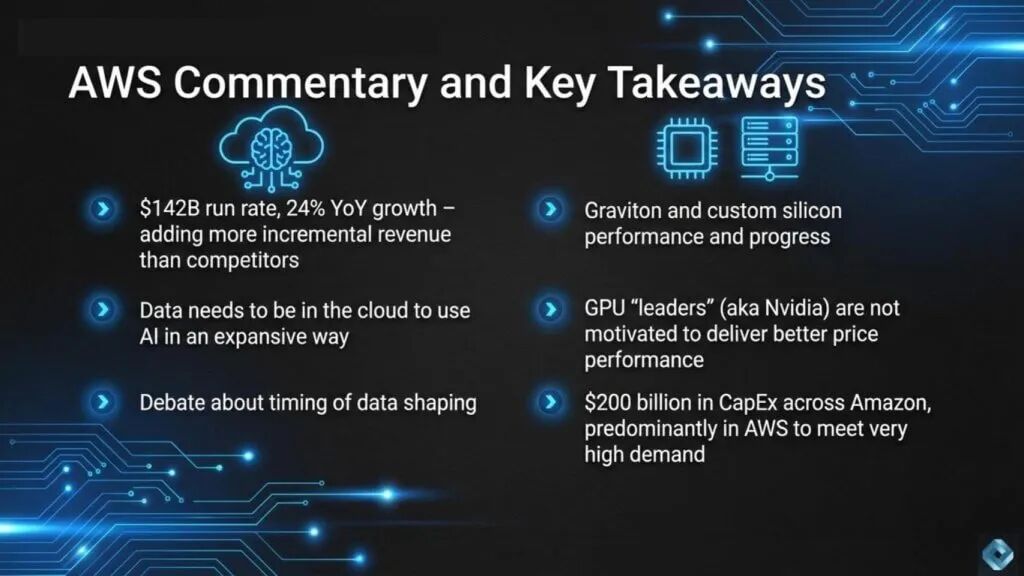

AWS评论:强劲增长、大胆声明与具有挑战性的芯片议程

AWS交出了超出预期的季度业绩[4]。以1420亿美元的年化收入,该业务同比增长24%。这强于我们模型中的21%至22%增长区间。该结果为投资者解读2000亿美元资本支出估计设定了基准。如果AWS在这个规模下仍以20%中段增长,甚至可能加速增长,则表明需求完好无损。辩论围绕回报归属和谁控制单位经济。

Andy Jassy强调了“大型基数效应”论点,他说 在1420亿美元年化收入基数上实现24%的增长,与在显著更小的基数上实现更高百分比增长是非常不同的。 他明确表示AWS的年同比增量收入超过竞争对手。这一论点适用于大多数竞争对手,但并非通用于所有。Microsoft Azure不再是小基数业务,Jassy关于增量收入美元的声明并不适用于Azure。具体而言,据我们估计,微软Azure在2025日历年新增的增量美元约比AWS多25亿美元。

数据作为关键

评论的其他两部分很重要,因为它们揭示了AWS希望AI故事如何被理解。

首先,Jassy强调广泛AI采用需要数据和应用置于云中。这是直接将AI周期与云迁移模式联系起来的尝试。潜在信息是AI不仅仅是另一项工作负载。它是数据重力和应用放置向云倾斜的强制函数。尽管云继续远超传统本地支出的增长,但客户持续报告对云成本的沮丧,所有我们接触的主要公司都在实验本地AI堆栈,以平衡成本、主权和信任。

其次,他强调了企业塑造模型方式的转变。主流模式是在生命周期后期通过微调和后训练应用企业数据。Jassy表示存在辩论,AWS认为企业将希望尽早在预训练阶段使用其数据训练模型。我们同意Jassy的观点,并在突发分析中讨论过。

我们接触的顶级领导者不会等待完美数据条件。反复出现的模式是AI帮助组织在杂乱数据中找到关键内容、清理所需部分以实现结果,并比“先整理数据屋子”的叙事更快行动。JPMorgan Chase & Co.、Walmart Inc.、Dell Technologies Inc.、IBM Corp.和AWS本身都是采用这一方法的组织示例。

电话会议真正有趣的地方在于芯片。

芯片机遇与挑战

Jassy描述了100亿美元年化收入的芯片业务,并提出两点关键。第一,AWS每天扩展核心计算容量,大部分新容量运行在Graviton上。他称Graviton的价格性能比领先x86处理器好达40%,并表示超过90%的AWS前1000客户使用它。我们已广泛撰文[5]讨论Graviton和Nitro。Graviton是在x86性能曲线趋平时对x86经济学的直接攻击。Annapurna Labs早有领先,AWS有效利用了这一窗口。

第二点是我们解读,AWS现在正将Graviton剧本应用于AI加速器。Jassy认为推理成本需要下降以实现AI的广泛使用,而AI芯片成本是重大障碍。他说客户想要更好的价格性能,而早期主导者并不急于提供,这就是为什么AWS构建了Trainium。他声称已部署超过140万颗Trainium2芯片,称其为有史以来最快ramp的发布,并表示Trainium2的价格性能比同类GPU好30%至40%。

我们接受部分叙事,拒绝部分。

Trainium受益于供需失衡。Nvidia无法满足所有需求,任何可行替代品都会吸收供应不足。这并不削弱AWS的芯片努力。但它解释了为什么ramp发生在买方容量受限的市场。

不支持的部分是暗示Nvidia未推动更好价格性能。Nvidia正以年度节奏推动性能、吞吐量和每令牌成本的激进改进。 创新和经济步伐是主导故事。市场快速移动,Nvidia移动得更快。尽管Jassy披露了100亿美元芯片年化业务,Nvidia的销量轻松是AWS的10倍。这就是为什么我们认为低成本曲线和供应曲线仍紧密绑定Nvidia路线图。AWS可捕获有意义份额,因为市场巨大且供应受限,但与x86竞争不同于与Nvidia竞争。

这将我们带回资本支出。AWS以迫使艰难选择的规模建设,芯片策略旨在控制单位经济并减少对单一供应商依赖。投资者真正询问的是资本支出多快转化为可持续货币化,以及自定义芯片策略是否随时间改善利润率。

我们想明确强调的另一关键点是,我们相信Nvidia将是低成本供应商,无法获得最新最先进Nvidia技术的运营商将落后。无论Trainium、张量处理单元、专用集成电路或其他替代品,在我们工作模型中,Nvidia将是最高效解决方案,缺乏其技术访问将阻碍竞争力。

底线

AWS交付了超出预期的强劲增长,Jassy利用电话会议将AI需求与云放置联系,推动模型塑造辩论提前到生命周期,并加倍押注自定义芯片作为单位经济杠杆。Graviton是已验证剧本。Trainium是将相同剧本应用于加速器的市场,该市场由Nvidia步伐定义,且供需失衡为替代品创造空间。但2000亿美元资本支出大部分将流向Nvidia(60%的服务器比例,假设Nvidia占比8成,折合有960亿的Nvidia份额),因为没有Nvidia技术访问,包括AWS在内的运营商将落后。这一切保持执行压力,但AWS信息是容量、芯片和云放置是决定AI基础设施周期胜者的旋钮。

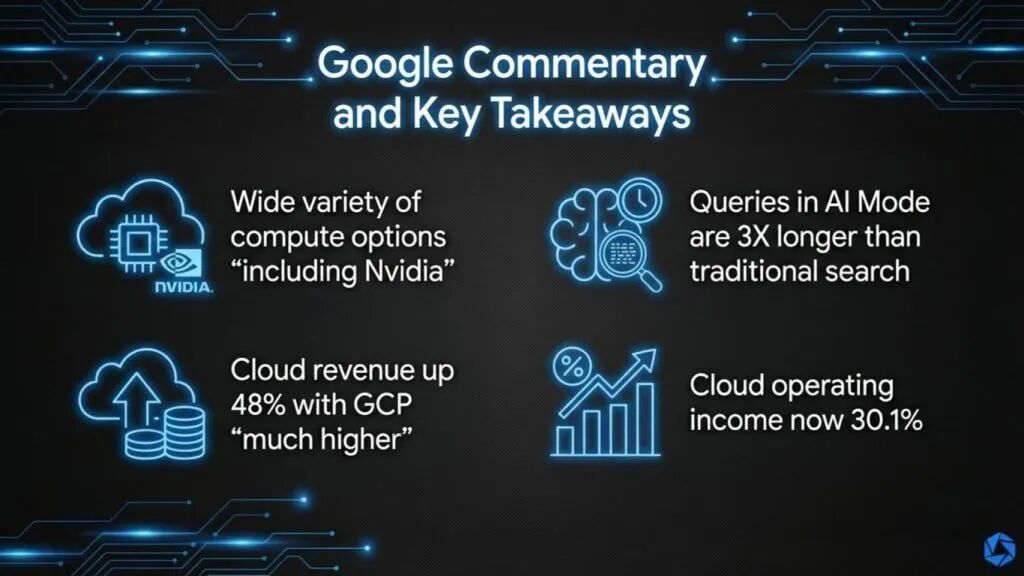

谷歌评论:Nvidia配额、爆炸性查询需求与找到运营杠杆的云业务

谷歌评论的语气不同于AWS。更关注需求行为及其对谷歌基础设施路线图的含义。Sundar Pichai针对2026年提出两点引人注目。首先,谷歌正扩展计算选择,包括自家TPU和Nvidia GPU——因为在我们看来,他绝对需要后者;Trainium的相同动态适用于TPU,尽管谷歌在加速器游戏中更资深。其次,AI驱动搜索体验的需求特征正改变使用模式,推动更高计算强度和单位成本。

Pichai现在多次提及Nvidia作为关键伙伴。这次,他说,“这包括我们伙伴Nvidia的GPU,他们在CES宣布我们将是首批提供最新Vera Rubin GPU平台的厂商,加上我们开发十年的自家TPU。” 要点是TPU重要,但超大规模云仍需要Nvidia最新平台的访问。重复,我们认为Nvidia仍是前沿低成本提供者,即使对推理而言,因为节奏和每令牌成本改进快于任何人能匹敌。内部人士明白,如果不在配额内,他们将落后。这就是Nvidia提及反复出现的原因。

谷歌的需求动态同样值得注意。Pichai表示,一旦人们开始使用新体验,使用量就会增加。“在美国,自推出以来,每用户每日AI查询翻倍,AI概述表现持续出色。” 他接着分享与成本结构相关的小道消息:“AI模式查询比传统搜索长3倍,” 会话 “更具对话性,” 且大量AI模式查询导致跟进。他还说 “近六分之一AI模式查询现在是非文本,使用语音或图像。”

他未讨论的是AI查询成本。我们认为这些指标描述了根本不同的工作负载特征。传统搜索优化至每查询几分之一美分[6]。AI模式贵数个数量级——可能100倍。更长提示、跟进和多模态输入推动更高会话推理成本。这就是为什么每令牌成本和每瓦特每美元令牌已成为行业核心指标。查询成本是大型服务商的生存基础,否则流量越大,亏损的就越多。

业务模式张力嵌入使用曲线。谷歌股价飙升,社交媒体撕裂六个月前Brad Gerstner等评论员的预测[7],指OpenAI将终结谷歌搜索业务。但在我们看来,这个故事未完,将在未来几年展开。

这一动态体现在竞争行为中。围绕广告和消费者定位的公开营销战正在浮现(如Anthropic超级碗广告[8] 攻击[9] OpenAI)背景是OpenAI准备启动在AI答复中启用广告策略。战略问题是AI广告如何做。Anthropic广告暗示OpenAI将给用户带来糟糕广告体验。但如果它真正重塑广告,不再是“蓝链接”,而是真正研究驱动体验呢?这需要与品牌和用户的新关系,谷歌必须匹配。不是谷歌无法匹配体验;它显然能。但正如Gerstner今天被批评的观点,在新时代难以看到谷歌利润率和主导地位如何保全。

Cite

电话财报会中,Google 高管 针对AI商业模式和广告投放答复分析师,Google 并不着急变现,而是在思考AI生态该如何构建。

提问分析师 (机构) | 核心问题 | 谷歌高管答复摘要 (主要回答者) | 关键洞察 / 言外之意 |

|---|---|---|---|

Justin Post (Bank of America) | 1. Gemini App的影响:是否观察到它蚕食了传统搜索的活动?2. 变现路径:Gemini App的商业化进展如何? | 1. (Pichai) 没有看到任何蚕食的证据。他认为Gemini App和AI化的搜索共同创造了一个**“扩张性时刻(expansionary moment)”,扩展了用户与谷歌互动的类型。2. (Schindler) 目前的重点是免费版和订阅服务**,增长势头良好。广告是未来可能的选项,但**“并不着急(not rushing anything)”**。 | 1. 做大蛋糕,而非切分蛋糕。谷歌认为AI应用会创造新的用户需求和场景,从而扩大整个信息服务市场的规模。2. 订阅优先,广告待时。Gemini App的商业化将优先通过增值订阅模式进行,保持优质的用户体验,广告变现则会非常谨慎。 |

OpenAI的关键问题是它能否在AI转变用户行为向更高成本互动时,迫使谷歌向新模式转型。如果谷歌被迫捍卫份额同时重塑搜索经济,将对利润率和再投资能力造成压力。挑战者的风险当然是焦点。在消费者、企业、芯片雄心和多分发渠道同时竞争是艰难执行问题。但在我们看来,OpenAI首席执行官Sam Altman在“代码红色”后对广告的翻转旨在减少谷歌按自身节奏应对转变的能力。

Google Cloud正高速运转

谷歌当前势头的最大具体证据在于云。谷歌报告[10]季度云收入增长48%,达177亿美元,云运营利润率升至30.1%,较去年17.5%大幅上升。管理层称该季度“出色”(我们完全同意),归因于企业AI产品强劲需求。他们还指出GCP非常强劲,GCP继续远超整体Google Cloud收入增长。谷歌不直接公布GCP收入,但含义是AI需求驱动基础设施需求并加速其云业务。而且,公司同时找到运营杠杆。

我们认为加速增长与改善盈利性的组合提升了其资助AI建设的能力。该建设仍依赖TPU和Nvidia GPU。TPU有助于改善经济并填补供应缺口。Nvidia提供前沿成本曲线和性能节奏。在我们看来,二者并非互斥,而是互补,在需求扩张快于供应的市场中。但明确地说,我们假设Nvidia将继续在性能和成本上拉开与TPU和ASIC群的差距。

底线

谷歌在云中展现强劲执行,并显示加速AI驱动需求迹象,但AI搜索经济正转向每用户会话更高计算强度。Pichai反复强调最早获得Nvidia Vera Rubin平台,这强化了我们的观点,即超大规模云仍迫切需要Nvidia配额以留在最低成本曲线上,即使推动内部芯片。云结果表明谷歌有势头和运营杠杆,下个问题是它多快能将上升AI使用转化为可持续货币化,同时管理核心搜索业务固有的更昂贵转变。

ETR云部门观点:Azure主导,GCP正在缩小账户渗透差距

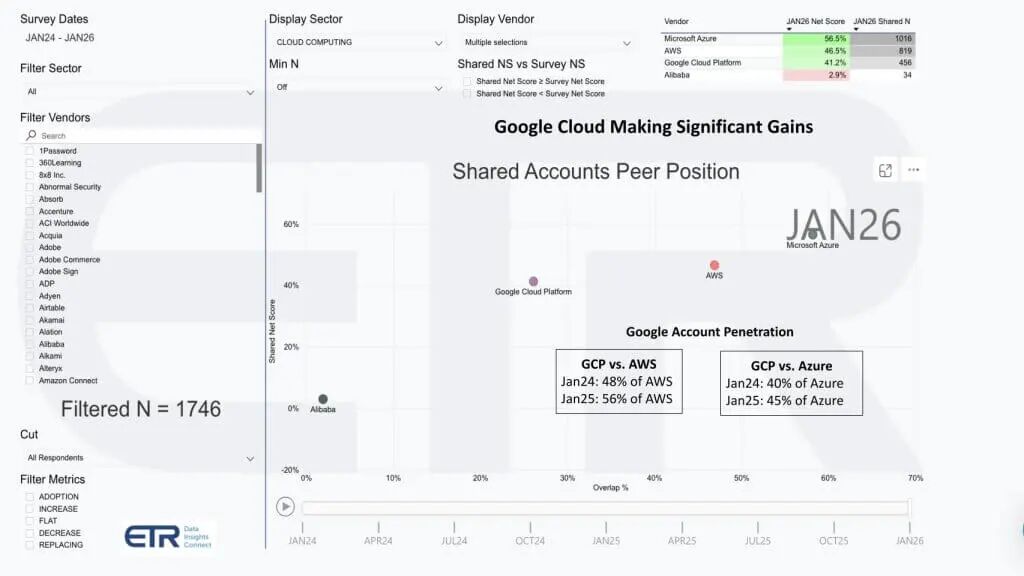

下图是穿透噪音的最清晰方式之一,因为它是基于账户的前瞻性。数据集来自1月调查,1746个账户。纵轴是Enterprise Technology Research的专有Net Score,支出势头的代理。横轴是重叠,反映账户内渗透。图显示Azure、AWS、Google Cloud Platform和Alibaba Cloud。Alibaba共享N仅34,因此不是故事主角。

数据要点:GCP缩小与AWS差距

首先注意的是三大巨头均高于40% Net Score阈值,我们视之为高度提升。Azure在上右,数字出色,约57% Net Score,共享N约1016。这就是“无处不在且仍加速”的样子。

AWS也高度提升,Net Score约46.5,共享N约819。有趣变动是谷歌。GCP Net Score约41.2,共享N约456,使其高于高度提升阈值,但账户渗透仍落后前二。要问的是渗透差距是否缩小。答案是是的。

简单方式是图形上添加的相对渗透数学。2024年1月,GCP重叠约AWS的48%。2025年1月,该比率升至约56%,使用当前共享N代理,456除以819。这是有意义进步。对Azure,比率也改善,但不如对AWS明显。GCP正向上游,但Azure足迹庞大并守住位置。

Note

值得一提的是,图中左下角有国内阿里云的标识,在全球头部企业中评估云渗透率,并不恰当。

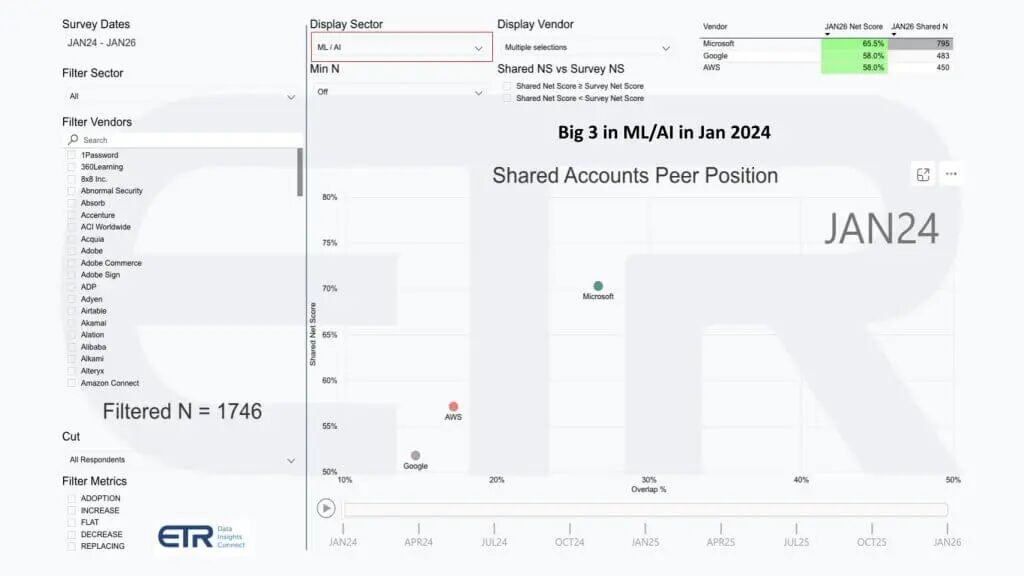

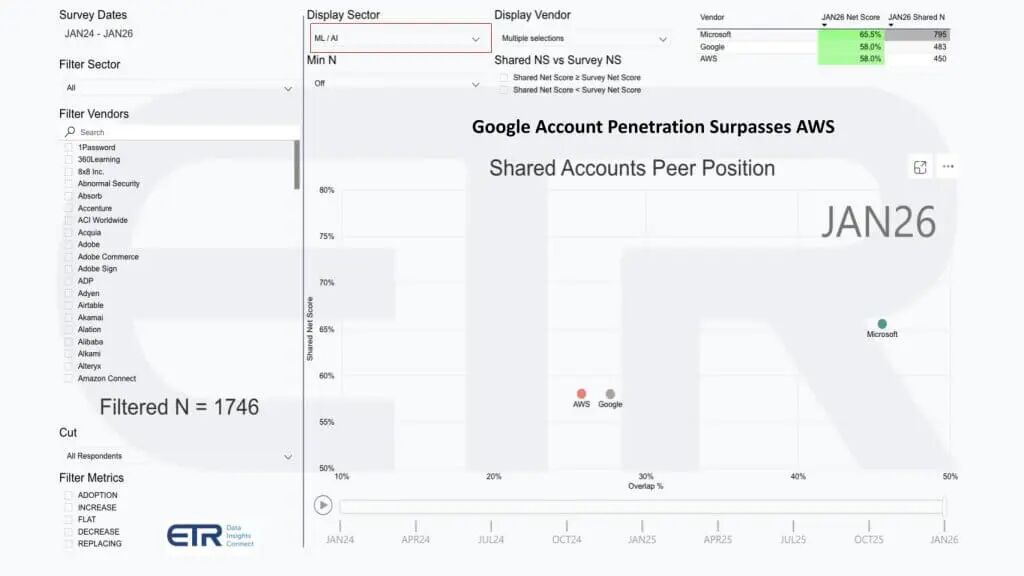

AI驱动GCP需求:谷歌在ML/AI部门超越AWS

我们认为驱动是AI和机器学习,下图强化了这一点。在ETR数据集中,对于机器学习和AI部门,谷歌从落后AWS重叠(下第一图 – 2024年1月)转向超越(第二图 – 2026年1月),支出势头相当在高50s,微软更高在中60s。

要点是谷歌在AI和机器学习的优势及其数据平台故事不仅仅在ML/AI部门创造势头。它们为整体云业务创造顺风,这个云部门观点显示顺风开始转化为更高企业渗透。

信息是Azure仍是ETR企业数据集中最主导云平台,AWS仍高度提升,GCP以现在账户级调查数据可见的速度获得渗透。谷歌在机器学习和AI的优势正拉动它前进,该AI主导势头作为更广泛云部门的显著顺风显现。

为什么谷歌在AI和机器学习领域,有更明显的领先态势?

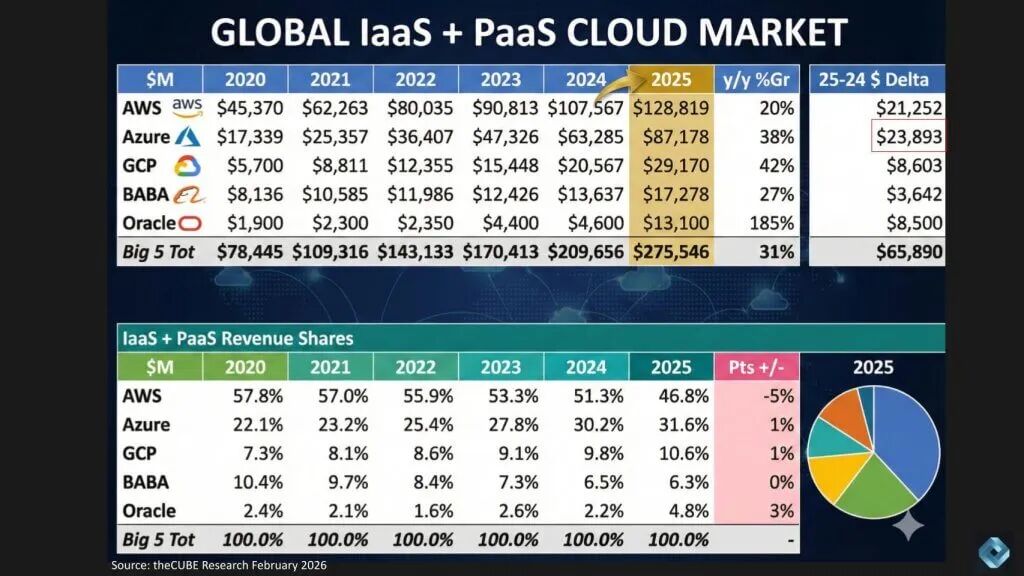

IaaS和PaaS市场份额:AWS庞大,Azure增长更快……挑战Jassy的增量收入数学

下图显示我们对全球基础设施即服务和平台即服务收入市场份额的更新观点。我们上周分享版本[11],并为2025全年再次更新。Alibaba和Oracle Corp.财报尚待,所以那些数字将在财报后刷新。Azure也是移动目标,因为微软按财年报告且不直接披露Azure收入,因此这些是基于我们三角测量的日历年估计。

市场规模仍惊人。AWS 2025年IaaS和PaaS收入为1290亿美元,季度增长率24%。这保持AWS以宽裕优势最大。

然而,关键是当你考察增量收入美元而非仅增长率时。Jassy在电话中说在1420亿美元年化基数上24%增长与小基数更高百分比增长不同,他进一步暗示AWS新增更多增量收入并扩展领导。那声明适用于许多竞争对手。Jassy声明对Azure不成立。

在上图日历年视图中,Azure年同比新增约239亿美元收入,而AWS新增约213亿美元。换言之,Azure新增的增量收入美元超过AWS,直接与Jassy声明冲突。 这相关,因为通过2024年,AWS可声称“增量美元”是其领先的重要指标。它不再能如此声称。

尽管如此,AWS仍是规模领导者。Azure正在夺取份额,且以非常大基数做到了。注意这些是theCUBE Research估计,因为微软不报告干净Azure收入。但我们的研究显示Azure取得重大进步,这质疑Jassy声明。

谷歌继续显示有意义进步,增长快于所有竞争对手。我们估计GCP Q4同比增长超过50%,显著快于整体Google Cloud。有趣历史趋势是GCP年收入约250亿美元。要回溯到2018和2021年,当时AWS和Azure分别相当大小。它们当时增长率高40s,而GCP据我们估计低50s。

这支持更广泛观点,即云市场结构强劲,仍以高率扩张。我们很快更新2026预测,但初步数据显示这些云玩家今年将向市场新增750亿至1000亿美元增量收入。而且,市场顶端的竞争故事正收紧,Azure对AWS的差距现在在增长和增量收入美元上均太大,无法在财报电话中回避或混淆。

底线是AWS仍是地球上最大IaaS和PaaS平台,但增量收入数学显示Azure不再是“显著更小基数”竞争者。据我们估计,Azure在2025年新增收入美元超过AWS,这是投资者在供应商声明过分依赖规模而不承认谁增长更快时需牢记的现实。

Cisco AI峰会:与Matt Garman对话突显AWS芯片挑战

我们想以几点观察结束。我们从上周Cisco AI峰会提取的一些片段开始。在与AWS首席执行官Matt Garman的面对面中,Cisco总裁兼首席产品官Jeetu Patel提出了一些精彩问题,他推动Matt Garman讨论半导体周期,如tape-out时间。

他没用“tape-out”一词,tape-out是从设计运送到TSM或其他代工厂的制造时间。

有两个连续片段,我们将在下方放置逐字转录。

第一个片段讨论做自家芯片的利润含义。第二个片段讨论半导体设计到tape-out的周期时间。我们认为两者都发人深省,并促使我们重新思考对GPU替代品的假设,即使对推理。我们对超大规模云跟上Nvidia的能力不再乐观。

Cite

Jeetu Patel: 你认为AWS的经济会改变吗?利润结构会更好吗?因为如果每个应用都有推理,你将构建推理能力堆栈,那会随时间改善你的利润吗? Matt Garman: 我不知道,这是好问题。那是银行家猜的。但我可以说它绝对比只用Nvidia GPU改善我们的利润。而且它们将始终是重要部分,但其中很大利润部分必然流向Jensen和团队。我们爱他们的产品,他们执行出色。但当你有70%、80%毛利率时,有人拿更少利润、提供更高性能部件并给客户选择的空间是有的。头部Tokens厂商的毛利率不低于80%

所以我们认为能为客户提供更好价格性能、选择,让他们从各种选项中挑选,并拥有独属于AWS的最丰富能力集,无法在别处获得。这就是为什么我们过去10多年投资芯片,它是我们交付的一部分,从芯片层到差异化性能,与伙伴一起提供人们可构建的丰富能力集。

我认为Trainium对我们是巨大部分,无论最终允许我们提高利润还是保持利润并降低客户价格。老实说,我可能押注后者,因为这就是数据中心运作方式。 Jeetu Patel: 它就是这样布线的,是的。 Matt Garman: 所以我的猜测可能是更多后者,我们试图更快增长,因为我们发现每次降低价格,通常传给客户,给客户更多预算构建新工作负载。对我们,这通常导致良好飞轮。 Jeetu Patel: 你继续确保构建芯片。现在你的平均芯片周期时间是多少?每18个月推出新版本芯片吗? Matt Garman: 18到24个月,视情况。 Jeetu Patel: 那在压缩。 Matt Garman: 有时压缩,一般,但叫它18到24个月之间。 Jeetu Patel: 对。 Matt Garman: 但有时,你也受工艺代限。

自定义芯片现实检验:周期时间、体量经济与Nvidia持续拉开差距之处

Cisco AI峰会的两个片段有用,因为它们为自定义芯片叙事提供了真实数字和时间框架。Jeetu Patel试图拉Matt Garman进入“周期在压缩”讨论。Garman没上钩。他坚持18到24个月,并添加工艺代约束仍限制速度的警告。

这设置了最重要比较:Nvidia节奏远超所有人。这不是说超大规模云不应设计自家芯片。然而,在我们看来,它突显了它们的市场机会是Nvidia因供应约束无法履行的。同时,我们警告Graviton对x86的剧本相对于Nvidia将难复制得多。

最后,我们相信基于这些原因及下方阐述,竞争者侵蚀Nvidia护城河的想法是胡说。

我们的看法

Nvidia以12个月周期运作。Vera Rubin定位为5倍性能改进、10倍吞吐量改进、先代成本的1/10。那是一年内阶跃函数。对18至24个月芯片周期,超大规模云路线图跟不上步伐。亚马逊Trainium、谷歌TPU、微软Maia和Cobalt可能是重要产品,但如果周期时间保持Garman位置,差距将扩大。

这也是为什么将Graviton剧本带到GPU是不同动物。Graviton在x86性能曲线趋平时与x86竞争,AWS通过系统设计和集成有真正杠杆。与Nvidia竞争不同。Nvidia未站桩。它以年度节奏激进推进成本曲线。这将“替代芯片”的经济从取代转为容量策略。

这引出第二点。主导领导者无动力改善价格性能的暗示站不住脚。客户确实想要更好价格性能。Nvidia在交付。Jevons悖论[12]动态将随着成本下降和新工作负载持续改善经济,推动15倍需求提升。讽刺的是,扩张市场的相同动态增加供应约束,供应约束是保持替代芯片可行性的因素。

我们未忽略供应讨论。在Garman片段中你能听到工艺代约束。代工厂系统紧张。Nvidia优先访问和规模效应,规模效应是一切。亚马逊描述约100亿美元年化芯片业务。Nvidia以约2250亿美元年化运作。那是20倍体量优势。结合更快节奏和更深生态杠杆,结果是成本结构和学习曲线优势向Nvidia复合。

对其他人的好消息是需求仍超供应。一切售罄。Trainium可卖。TPU可卖。Maia可卖。可识别合适工作负载,且因市场大且计算胃口增长,可持续很久。但竞争位置不变。如果Nvidia仍是主导体量供应商,它有最低成本曲线和持续降本最佳能力。

边缘用例呢?

这留下边缘。市场正确,推理和边缘工作负载改变拓扑。传统超大规模区域往往太远,我们预期“云let”和近端推理堆栈加速,靠近客户及其数据。有些假设Nvidia无法在那里竞争因为太贵。这一论点随着Nvidia与Groq伙伴关系大幅削弱。Groq专注推理和边缘部署,Nvidia锁定该关系战略重要。我们的建模显示Nvidia在边缘表现好,此交易填补感知组合缺口。

这不意味着超大规模云放弃芯片努力。他们可能不会。TPU可能最有腿,因为谷歌有长跑道、紧密集成和清晰内部需求。AWS足够广,可跨极宽用例放置芯片,Garman评论AWS很少退役EC2实例突显他们将保持运送多样性让客户选择。

战略风险不是超大规模云构建自定义芯片。风险是认为那些程序以有意义方式侵蚀Nvidia护城河。它们不会。护城河在我们看来由节奏和体量维持。如果超大规模云未内化这一现实,开始类似于IBM OS/2对Windows时刻,即技术可信替代因生态、执行节奏和分发输给主导平台。

关键要点

- Garman将自定义芯片周期时间锚定在18至24个月,并指出工艺代约束作为限制因素。

- Nvidia年度节奏和每令牌成本改进正扩大差距,而非缩小。

- 替代加速器主要因需求超供应获份额,而非在成本曲线上超越Nvidia。

- Nvidia体量优势复合学习、成本结构和生态杠杆。

- 边缘推理为新部署模型创造空间,但Nvidia的Groq关系加强其在那里的手牌。

底线

Nvidia是更快周期上的低成本提供者,使其成为全行业参考点。超大规模云芯片程序将出货并售出,因为市场供应受限需求爆炸,但它们未侵蚀Nvidia护城河。当周期时间保持18至24个月而Nvidia以12个月节奏和20倍体量前进时,差距将扩大。获得Nvidia配额的运营商将留在最低成本曲线上。未获得的将竞争力更弱,无论构建多少自定义芯片。

这是我们当前情景。你们许多人评论不同意我们的Nvidia展望。请继续分享原因,我们总是欣赏反馈和辩论。

延伸思考

这次分享的内容就到这里了,或许以下几个问题,能够启发你更多的思考,欢迎留言,说说你的想法~

- 面对Nvidia每年一代的技术迭代和巨大的体量优势,您认为云巨头们的自研芯片战略,长期来看是会成为真正的“Nvidia替代品”,还是最终沦为填补供应缺口、优化特定负载成本的“补充品”?在您的业务场景中,会如何评估和选择这两种计算平台?

- 文章提到AI查询的成本可能是传统搜索的100倍,这给依赖广告收入的商业模式带来巨大压力。您认为未来AI服务的商业模式将如何演进,才能平衡高昂的计算成本和用户体验?除了订阅和广告,还有哪些潜在的变现路径?

原文标题:Cloud earnings bring capex clarity, concern and confusion[13]

---【本文完】---

👇阅读原文,搜索🔍更多历史文章。

丰子恺-护生画集-幸福的?情 (字不识,请友告知)

- https://siliconangle.com/author/dvellante/ ↩

- https://thecuberesearch.com/304-breaking-analysis-microsoft-q2-26-investors-fret-as-capex-azure-growth-decouple/ ↩

- https://siliconangle.com/2026/02/01/microsoft-investors-fret-capital-spending-azure-growth-decouple/ ↩

- https://siliconangle.com/2026/02/05/amazons-stock-falls-upping-fiscal-2026-spending-forecast-200b/ ↩

- https://thecuberesearch.com/breaking-analysis-aws-secret-weapon-is-revolutionizing-computing/ ↩

- https://thecuberesearch.com/300-breaking-analysis-why-nvidia-maintains-its-moat-and-gemini-wont-kill-openai/ ↩

- https://x.com/Benioff/status/2020277273899991313?s=20 ↩

- https://www.youtube.com/watch?v=3BTzzlurgRk ↩

- https://siliconangle.com/2026/02/04/anthropics-hilarious-super-bowl-ad-jibe-chatgpts-ads-hits-nerve/ ↩

- https://siliconangle.com/2026/02/04/alphabet-jack-ai-spending-google-cloud-ad-business-revenues-shine/ ↩

- https://thecuberesearch.com/304-breaking-analysis-microsoft-q2-26-investors-fret-as-capex-azure-growth-decouple/ ↩

- https://en.wikipedia.org/wiki/Jevons_paradox ↩

- https://siliconangle.com/2026/02/08/cloud-earnings-bring-capex-clarity-concern-confusion/ ↩

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-09,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录