打破刻板印象:JAX 早已全面适配 NVIDIA GPU,轻松微调 Llama 3.1

打破刻板印象:JAX 早已全面适配 NVIDIA GPU,轻松微调 Llama 3.1

GPUS Lady

发布于 2026-05-08 12:36:38

发布于 2026-05-08 12:36:38

在大模型高速发展的当下,PyTorch、TensorFlow 是大众最熟悉的深度学习框架,但还有一款高性能科学计算与 AI 框架JAX,长期笼罩在一层认知迷雾里:绝大多数开发者都默认,JAX 是谷歌 TPU 专属框架,只能在 TPU 上运行。

先简单聊聊 JAX 的核心背景,就能明白它为什么备受顶尖 AI 团队青睐。JAX 由谷歌深度研发并开源,是一套结合自动微分、自动向量化、XLA 编译加速、高性能分布式运算的数值计算库,原生适配函数式编程风格。它最早为谷歌 TPU 集群生态而生,广泛用于谷歌 DeepMind、DeepMind 科研团队的前沿模型研发,像强化学习、大规模科学计算、超大模型训练等硬核场景,JAX 都有着极强的性能优势。

对比传统框架,JAX 拥有极致的运算效率、灵活的高阶微分能力、原生高性能分布式支持,非常适合大模型、复杂算法与大规模算力调度。也正因早期深度绑定谷歌 TPU 生态,久而久之,行业便形成了固化偏见:JAX = 只支持 TPU,和 NVIDIA GPU 无缘。

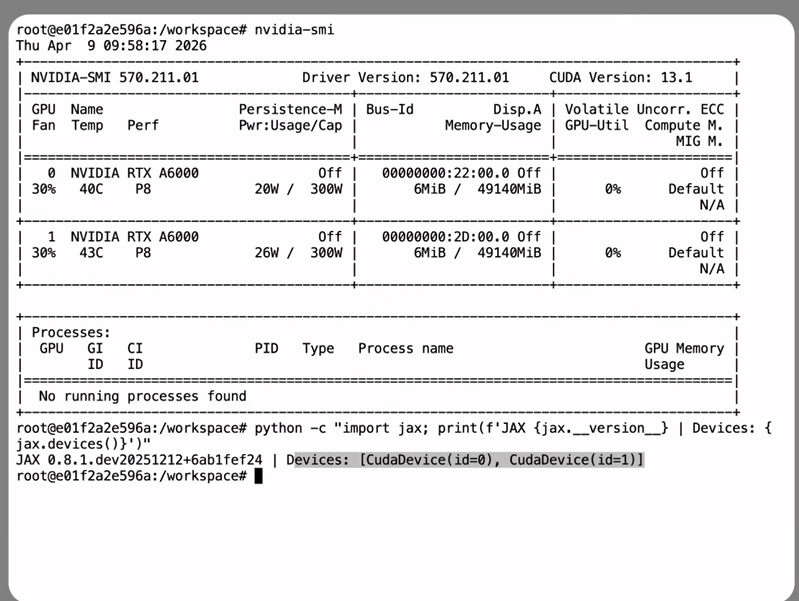

但事实早已彻底改写:JAX 早已完成对 NVIDIA GPU 的完整适配,彻底摆脱 TPU 绑定限制。

普通英伟达消费级显卡、RTX 系列、专业算力卡乃至 DGX 商用设备,都可以正常部署、运行 JAX 任务。依托 XLA 统一编译架构,JAX 可无缝调用 GPU 算力,自动识别硬件、调度显存与计算核心,让普通 GPU 用户也能用上 JAX 的高性能优势,高效完成 Llama 3.1 等主流大模型的微调工作。

当下借助JAX + NVIDIA GPU组合,依托 XLA 编译加速能力,模型训练、推理、微调全流程可以完整落地。简单来说,只要设备搭载 NVIDIA 显卡,JAX 就能自动识别硬件并调度算力,告别 TPU 绑定的限制,让 JAX 的技术优势向通用 GPU 生态全面开放。

基于这套组合方案,目前已经落地了两套成熟、可直接复用的 Llama 3.1 8B 模型微调方案,覆盖高性能全量微调与轻量化低显存微调两大场景,适配不同算力条件的开发需求。

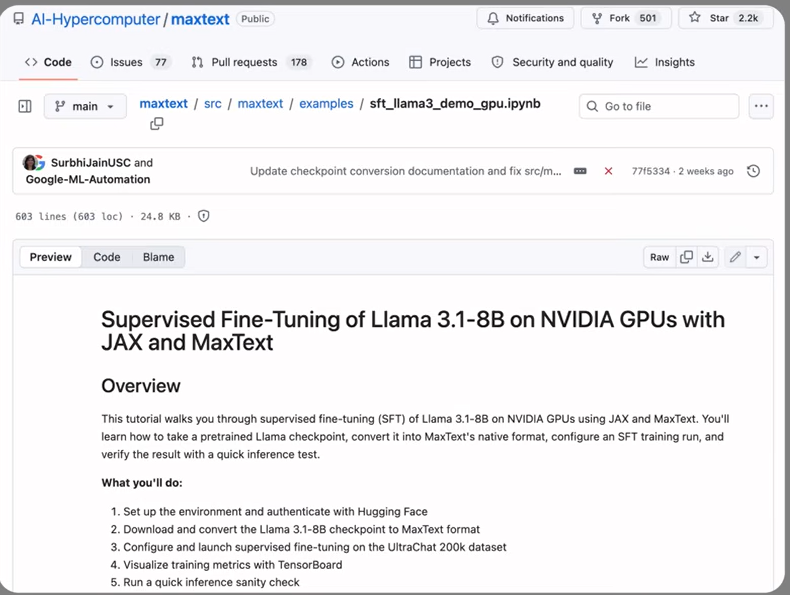

一、全量有监督微调:MaxText 高性能完整训练

第一种方案基于 MaxText 框架实现全量 SFT 有监督微调,属于高性能全域训练模式,适合算力充足的专业场景。

全量微调会更新模型全部权重参数,对硬件配置有一定要求,更适配多 GPU 集群环境,例如 8 卡 80GB 及以上大显存显卡集群。部署方式十分灵活:单机环境下,JAX 会自动扫描并识别本地所有 GPU,无需复杂配置;多机分布式训练场景,仅需填写协调器地址,即可快速完成分布式集群初始化,实现多机协同训练。

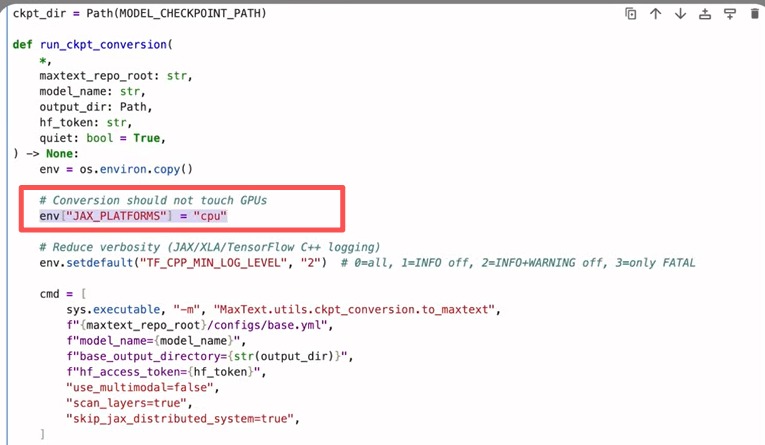

完整操作流程简洁清晰:完成 Hugging Face 权限认证,获取受限开源的模型权重文件,再将权重转换为 MaxText 适配格式。这里分享一个实用优化技巧:设置JAX_PLATFORMS=CPU运行格式转换任务,用 CPU 完成预处理,最大限度节省宝贵的 GPU 显存资源。

格式处理完成后,通过 YAML 配置文件即可一键启动训练。官方演示项目基于 UltraChat 数据集,以 1024 上下文长度、bfloat16 精度完成快速百轮训练,全程支持 TensorBoard 可视化,实时监控损失变化,方便开发者调试与效果观测。

资源:

https://github.com/AI-Hypercomputer/maxtext/blob/main/src/maxtext/examples/sft_llama3_demo_gpu.ipynb

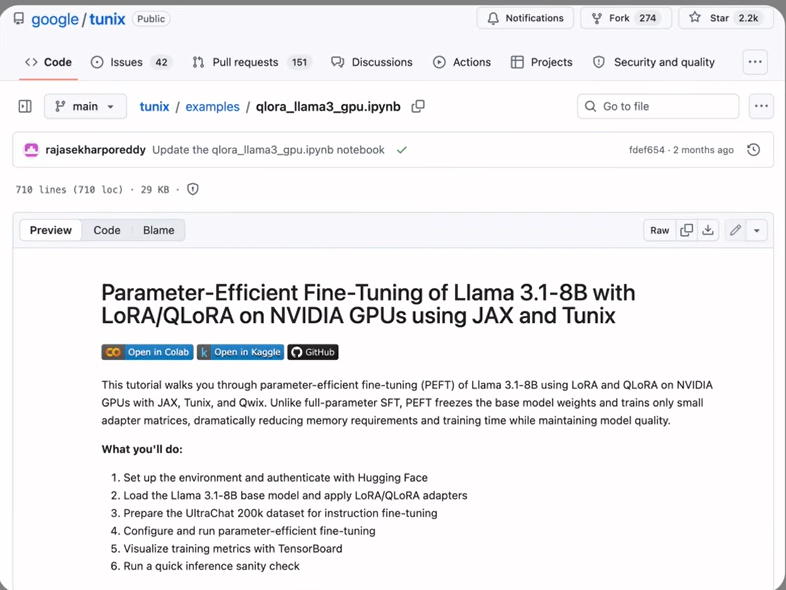

二、轻量化参数高效微调:Tunix 低资源快速迭代

对于个人开发者、小算力设备而言,全量微调门槛较高,因此第二套 Tunix 轻量化 PEFT 方案更加亲民,包含 LoRA、QLoRA 两种主流参数高效微调方式。

这套方案大幅降低了硬件门槛:QLoRA 仅需 16GB 及以上显存的单卡即可运行,常规 LoRA 微调推荐 24GB 显存起步,像 DGX Spark 这类商用边缘算力设备,是轻量化微调的绝佳选择。

Tunix 框架具备智能适配能力,会根据当前 GPU 数量自动构建分布式运算网格,自动下载预训练模型、一键转换为 JAX 格式,并合理完成多卡资源分配。其核心技术亮点在于轻量化训练逻辑:冻结模型基础主干权重,仅在注意力层、MLP 多层感知机层插入少量适配模组,用极低的参数量开销,实现模型能力定制。

其中 QLoRA 采用 NF4 4 比特量化、32 分块压缩策略,进一步压缩显存占用。训练采用小批量数据集,每 25 步自动执行一轮效果评估;在完成首次 JIT 即时编译后,训练速度会大幅提升,后续迭代效率拉满,非常适合快速实验、高频调参。

资源:

https://github.com/google/tunix/blob/main/examples/qlora_llama3_gpu.ipynb

三、两种微调方案怎么选?场景化选型指南

两套 JAX 微调方案各有侧重,可根据业务需求与硬件条件灵活选择:

LoRA / QLoRA 轻量化微调适合显存有限、追求快速迭代的场景,主要用于模型风格改写、输出格式统一、细分领域轻量化适配等轻度改造需求,成本低、上手快、落地灵活。

MaxText 全量 SFT 微调适合需要深度改造模型能力的场景,能够全方位优化模型逻辑、对话风格与知识输出能力。缺点是算力消耗更大,需要承担更高的训练与评估成本,企业级深度定制场景优先选择。

写在最后

JAX 绑定 TPU 的时代已经彻底过去。作为谷歌主导、科研领域公认的高性能计算框架,JAX 不再是 TPU 集群的专属工具,而是全面拥抱 NVIDIA GPU 生态。从 GPU 硬件自动识别,到双路线完整微调 Llama 3.1 大模型,无论是专业多卡集群的全量训练,还是个人单卡的轻量化定制,都能依托 JAX 高效的运算能力与简洁的开发体验完成落地。

无需固守 PyTorch 等传统框架,不妨亲自上手体验 JAX + NVIDIA GPU 的全新组合,解锁大模型微调的高效新方案,挖掘更多模型定制与二次开发的可能性。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-27,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录