Nature | 通用尺度驱动的AI评估方法: 实现解释性与预测性的统一

Nature | 通用尺度驱动的AI评估方法: 实现解释性与预测性的统一

DrugAI

发布于 2026-04-13 15:46:04

发布于 2026-04-13 15:46:04

DRUGONE

研究人员提出了一种全新的人工智能评估框架,通过构建“通用尺度”,实现对AI系统能力的可解释分析与对未来任务表现的准确预测。该方法突破了传统基准测试仅依赖平均性能指标的局限,能够揭示模型在不同能力维度上的真实水平。

这一框架基于18个通用能力尺度,覆盖认知能力与知识维度,并通过自动化标注方法将不同任务统一映射到同一评价空间。在此基础上,研究人员构建了“任务需求画像”和“模型能力画像”,从而解释模型表现的来源,并对未见任务进行高精度预测。实验表明,该方法在预测能力上显著优于现有黑箱模型,尤其是在分布外任务中表现出更强的泛化能力。同时,该框架还能够解释当前关于AI是否具备推理能力的争议。总体而言,该研究为建立系统化、可解释且可预测的AI评估体系奠定了基础,为未来AI的可靠应用提供了重要支撑。

当前通用人工智能系统,尤其是大语言模型,虽然在多个任务中表现出色,但其行为仍然高度不稳定且难以预测。这使得AI评估不仅需要衡量性能,还需要具备解释能力和预测能力。

传统评估方法通常基于基准测试的平均得分。然而,这类指标无法回答一个关键问题:模型在具体任务实例上的表现如何,以及其能力边界在哪里。例如,一个模型在数学基准测试中取得较高平均分,并不能说明它在新的数学问题上是否同样可靠。

更进一步,这种评估方式无法跨任务泛化,因为模型表现不仅依赖模型本身,还依赖具体数据集。这意味着当前评估体系缺乏对“能力”的稳定刻画。

研究人员指出,虽然心理测量学等方法曾被引入AI评估,但这些方法通常依赖特定模型或数据分布,难以适应快速演化的AI系统。此外,现有基于嵌入或不确定性建模的预测方法虽然可以一定程度上预测性能,但缺乏可解释性,并且在分布外任务中表现较差。

因此,构建一种既具解释性又具预测能力的通用评估框架,成为AI领域亟待解决的问题。

方法

研究人员提出了一套基于“通用尺度”的AI评估体系,其核心思想是将任务需求与模型能力统一映射到同一尺度空间中。

该方法首先定义了18个通用能力维度,包括语言理解、逻辑推理、抽象能力以及不同领域知识等。随后,通过设计标准化的标注规则,对每一个任务实例进行多维度需求标注,从而构建任务的“需求画像”。

在此基础上,研究人员通过模型在不同需求水平下的表现,推导出模型在各能力维度上的“能力画像”。这些能力值具有跨任务可比性,不依赖具体数据集。

进一步地,该方法利用任务需求作为特征,建立预测模型,从而实现对模型在新任务上的表现预测。这一过程完全自动化,可扩展至不同模型和任务体系。

结果

通用尺度实现能力解释与性能预测

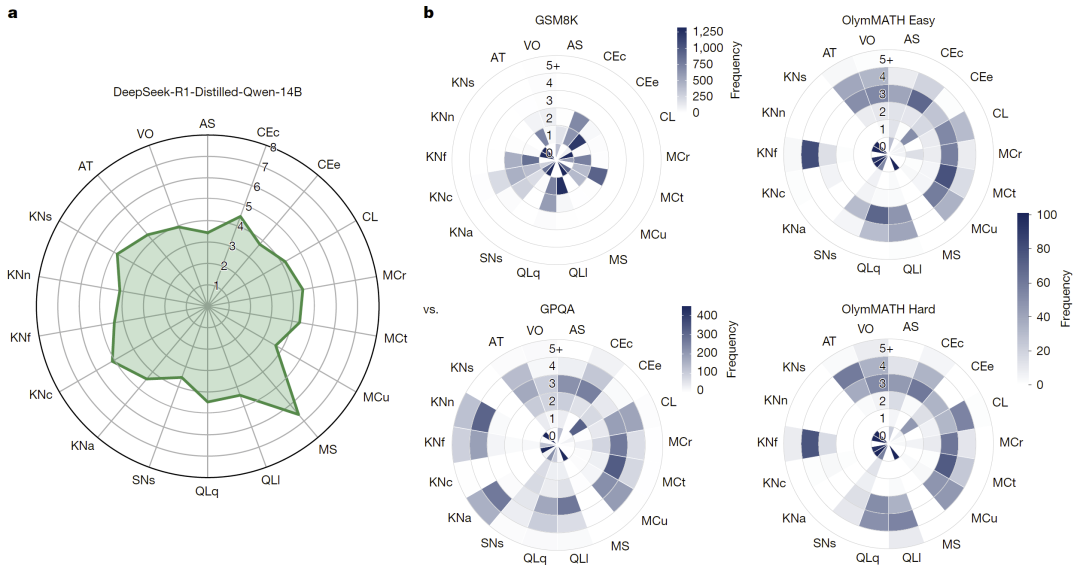

研究人员首先展示了如何利用通用尺度解释模型表现。通过将模型能力画像与任务需求画像进行对比,可以直观判断模型在不同任务上的表现。

例如,对于某些数学任务,模型在定量推理和逻辑推理维度上具有较高能力,因此表现较好;而对于更复杂任务,由于需求超过模型能力范围,表现显著下降。

这种分析不仅能够解释模型成功或失败的原因,还能够进行反事实推理,例如分析某一能力下降对整体表现的影响。

图1:可比的LLM能力画像与基准任务需求画像用于解释与预测模型性能。

通用尺度揭示基准测试的真实测量内容

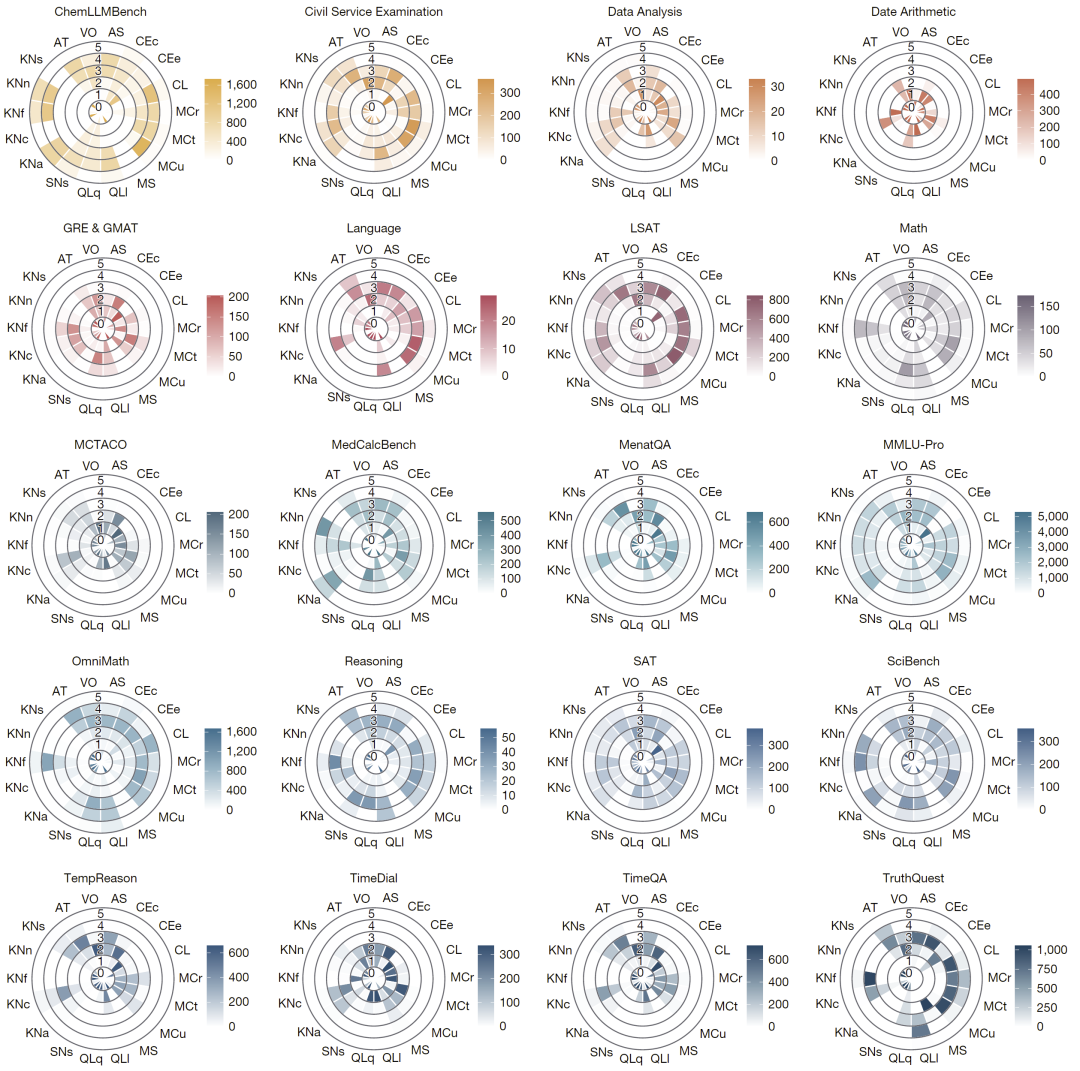

通过对多个常用基准测试进行分析,研究人员发现,这些测试在能力维度上的分布差异显著。

一些专业性较强的基准测试在特定知识维度上具有较高需求,而另一些测试则在多个维度上呈现混合需求。此外,部分基准测试整体需求较低,难以区分模型能力。

更重要的是,研究人员发现许多基准测试存在“构念效度”问题,即它们并未真正测量其声称的能力。例如,一些推理测试实际上依赖知识记忆或题目形式,而非纯粹推理能力。

这些结果表明,传统基准测试在评估AI能力时存在系统性偏差。

图2:ADeLe v1.0基准体系中20个测试基准在18个需求维度上的等级分布。

能力曲线揭示模型性能随任务难度变化规律

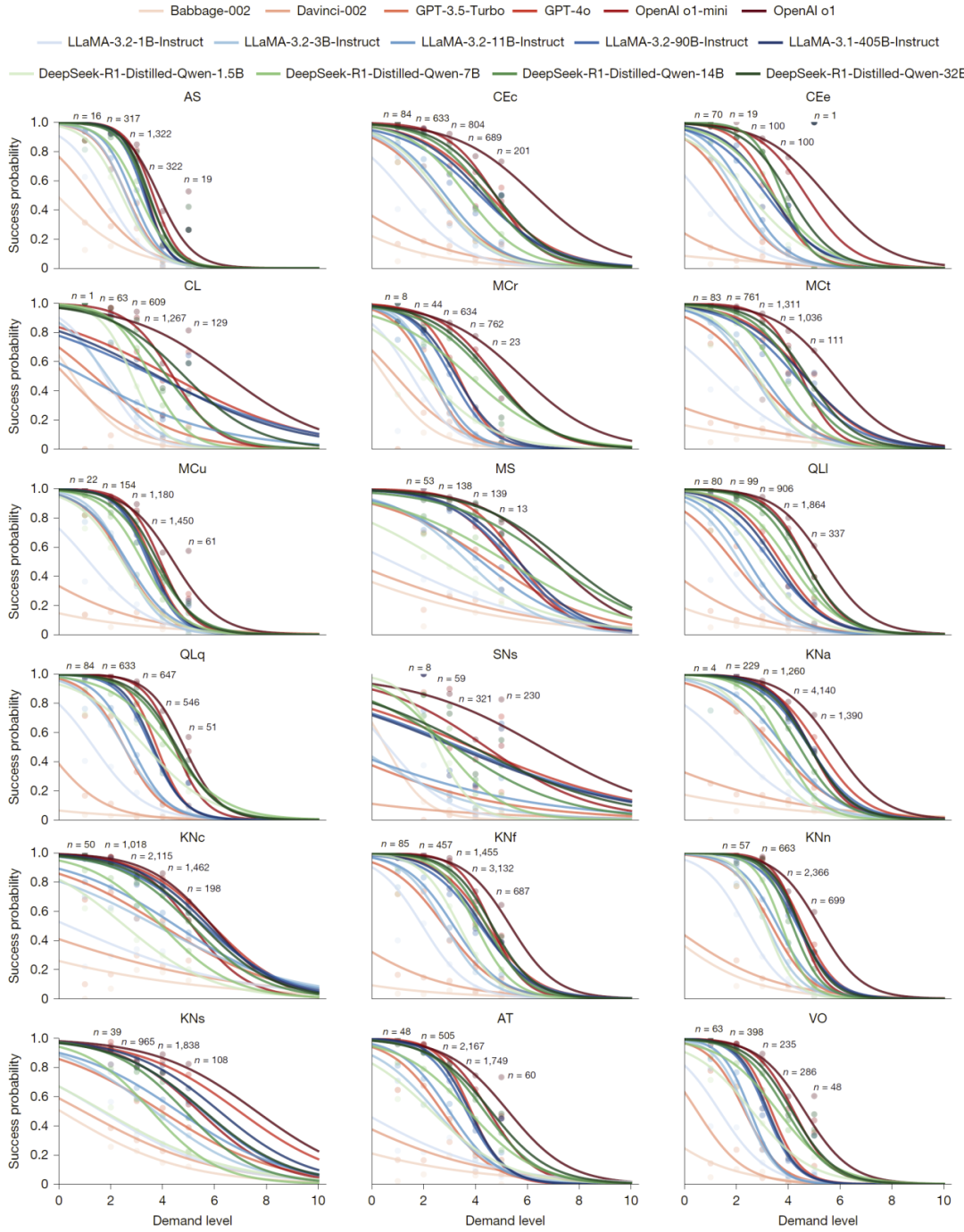

研究人员进一步分析了模型在不同需求水平下的表现,构建了能力曲线。

结果显示,随着任务需求的提升,模型成功率呈现出典型的下降趋势,但不同能力维度的变化模式存在差异。例如,一些能力维度具有较强区分性,而另一些维度则变化较为平缓。

这些曲线能够精确刻画模型的能力边界,并揭示不同模型之间的能力差异。

图3:18个需求维度与15个大语言模型对应的特征曲线。

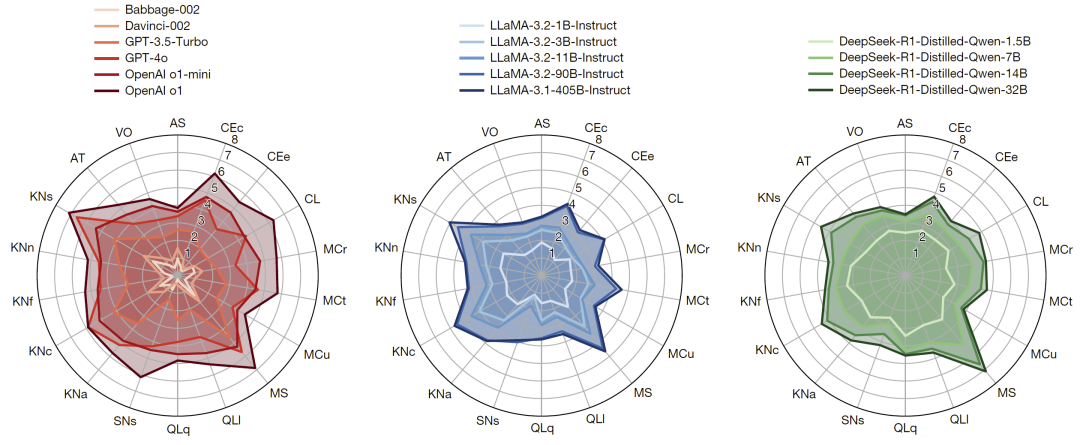

能力画像揭示不同模型的优势与局限

通过对多个大语言模型进行分析,研究人员发现,不同模型在能力维度上的表现存在显著差异。

模型规模主要影响知识相关能力,而推理、抽象等能力则在特定模型(如推理增强模型)中表现更强。这一发现有助于解释不同模型在不同任务中的表现差异。

此外,该方法还揭示了模型能力随规模增长的非线性变化规律,表明简单扩大模型规模并不能持续提升所有能力。

图4:15个大语言模型的能力画像。

通用尺度实现高精度性能预测

研究人员进一步验证了该方法在性能预测方面的能力。结果表明,基于任务需求的预测模型在实例级别具有较高准确性,并在分布外任务中优于现有方法。

这一能力使得该框架能够用于模型选择、任务分配以及风险控制等实际应用场景。

总结

该研究提出了一种基于通用尺度的AI评估新范式,实现了从“评估性能”到“理解能力”和“预测表现”的转变。

这一方法的核心贡献在于:将任务与模型统一到同一能力空间,从而实现跨任务、跨模型的可解释评估,并显著提升预测能力。

研究人员认为,该框架有望成为未来AI评估的基础工具,为AI系统的可靠部署和监管提供关键支撑。

整理 | DrugOne团队

参考资料

Zhou, L., Pacchiardi, L., Martínez-Plumed, F. et al. General scales unlock AI evaluation with explanatory and predictive power. Nature 652, 58–67 (2026).

https://doi.org/10.1038/s41586-026-10303-2

内容为【DrugOne】公众号原创|转载请注明来源

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-08,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读