差速移动机器人视觉闭环伺服技术方案

1. 项目概述与目标

本技术方案旨在为一台配备有结构光视觉相机的差速移动机器人,设计并实现一套完整的视觉闭环伺服算法。该算法的核心目标是使机器人能够自主识别环境中的设备,并精确移动到设备正前方0.5米的位置,最终调整姿态以正对设备的方向停稳。此功能是实现后续与设备相关作业的关键前提。

方案将详细阐述系统架构、工作流程、核心技术原理、算法实现步骤以及潜在的挑战,为项目的研发与实施提供全面的技术指导。

2. 系统架构与工作流程

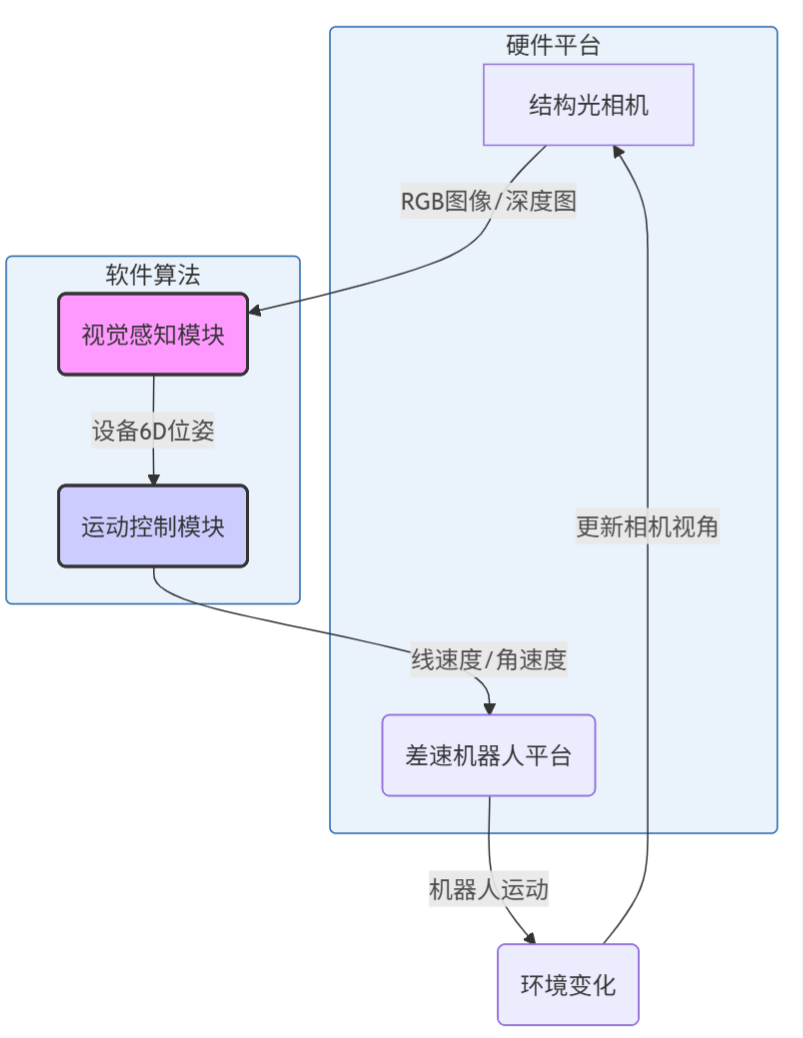

为了实现精确的视觉伺服功能,系统需要整合硬件平台与软件算法,形成一个感知、决策、控制的闭环。下图展示了系统的整体架构。

2.1. 系统硬件组成

硬件模块 | 功能描述 |

|---|---|

差速移动机器人 | 作为运动执行平台,具备两个独立驱动轮,可通过控制轮速差实现前进、后退及原地转向。 |

结构光视觉相机 | 核心传感器,通过投射特定光栅图案并捕捉其形变,可同时获取高分辨率的RGB彩色图像和高精度的深度图(点云)。 |

机器人控制器 | 底层硬件控制器,负责接收上层计算平台发送的运动指令(如轮速),并驱动电机精确执行。 |

计算平台 | 上位机(PC)或高性能嵌入式主板(如NVIDIA Jetson系列),负责运行所有核心算法。 |

2.2. 闭环伺服工作流程

机器人从启动到最终停在目标位置的整个过程是一个连续的闭环反馈控制流程,具体步骤如下:

- 环境感知:结构光相机实时采集环境的RGB图像和深度数据。

- 目标检测:视觉感知模块处理RGB图像,利用深度学习模型识别并定位出“设备”目标,输出其在图像中的2D边界框。

- 位姿估计:结合2D检测结果和深度数据(点云),精确计算出设备在相机坐标系下的三维位置和姿态(即6D Pose)。

- 坐标变换:通过预先标定的相机与机器人之间的相对位置关系(外参),将设备的位姿从相坐标系转换到机器人坐标系。

- 目标位姿定义:根据机器人坐标系下设备的位姿,计算出机器人需要到达的目标位姿(即设备正前方0.5米,且朝向设备)。

- 误差计算:比较机器人的当前位姿与目标位姿,计算出两者之间的位移误差和姿态误差。

- 运动指令生成:运动控制模块(如PID控制器)根据位姿误差,生成机器人需要执行的线速度(v)和角速度(ω)指令。

- 运动指令下发:将线速度和角速度指令通过机器人运动学逆解,转换为左右轮的具体转速,并发送给机器人控制器执行。

- 循环迭代:机器人移动后,其在环境中的位置发生改变,相机视角也随之更新。系统重复步骤1-8,持续不断地调整机器人的运动,直到位姿误差小于预设的阈值,机器人最终在目标位置停稳。

3. 核心技术原理与方案

3.1. 视觉感知模块

视觉感知是整个系统的“眼睛”,其准确性和鲁棒性直接决定了任务的成败。本方案推荐采用基于深度学习的方法,并充分利用结构光相机的多模态数据优势。

3.1.1. 目标检测

- 推荐模型:YOLO系列模型,如YOLOv8或YOLOv9。这类单阶段检测器在速度和精度之间取得了很好的平衡,非常适合需要实时响应的机器人应用。

- 数据增强:为了让模型能够应对不同环境(如光照变化、不同型号的设备、部分遮挡等),需要在训练数据集中进行充分的数据增强,包括随机亮度、对比度调整、旋转、缩放以及模拟遮挡等。

- 深度信息辅助:结构光相机提供的深度图可以作为额外的输入通道(形成RGB-D四通道输入),或用于在后处理阶段滤除明显不符合设备深度特征的误检结果,从而提高检测的准确率。

3.1.2. 6D位姿估计 (6D Pose Estimation)

在检测到设备后,精确估计其6D位姿是实现精准对准的关键。考虑到鲁棒性和实现难度,推荐以下两种方案:

方案A:基于已知3D模型的点云配准

原理:此方法需要预先获取设备的3D模型(例如CAD模型或通过3D扫描重建的点云模型)。算法流程是:首先从实时点云中分割出与2D检测框对应的设备点云簇,然后通过ICP (Iterative Closest Point,迭代最近点) 算法,将分割出的点云与预存的3D模型进行对齐,从而解算出精确的6D位姿。

- 优点:精度高,对纹理不敏感。

- 缺点:需要预先获取目标的3D模型,且对初始位姿估计有一定要求。

方案B:基于深度学习的端到端位姿估计

原理:训练一个专门的深度学习网络,如PVNet或GDR-Net,使其能够直接从RGB-D图像中回归出目标的6D位姿。这类方法通常通过预测像素级的关键点或表面向量来实现。

- 优点:无需显式3D模型,对遮挡和光照变化更鲁棒。

- 缺点:需要大量带有6D位姿标注的训练数据,数据采集和标注成本较高。

方案选择建议:在项目初期,建议采用方案A,因为其原理清晰,实现相对直接,先通过3D扫描创建一个标准设备的3D模型,待系统稳定运行后,再考虑投入资源研发方案B以提升鲁棒性。

3.2. 运动控制模块

运动控制模块是系统的“大脑”和“小脑”,负责将视觉感知到的目标信息转化为机器人具体的移动动作。

3.2.1. 坐标系定义与变换

为了清晰地描述位姿关系,我们定义以下坐标系:

- 世界坐标系 {W}:一个固定的全局参考系。

- 机器人坐标系 {R}:机器人中心,x轴指向机器人前方,y轴指向左侧。

- 相机坐标系 {C}:相机光学中心。

- 目标坐标系 {T}:设备上的某个特定点,例如其几何中心。

相机与机器人之间的变换关系 T_rc (从{C}到{R}) 是固定的,可以通过手眼标定提前获得。视觉模块计算出的是 T_ct (从{T}到{C}),通过矩阵乘法 T_rt = T_rc * T_ct 即可得到设备在机器人坐标系下的位姿。

3.2.2. 差速机器人运动学模型

差速机器人的运动由其线速度 v 和角速度 ω 完全决定,这两个量与左右轮的角速度 ω_L 和 ω_R 之间的关系如下(假设轮距为 L,车轮半径为 r):

- 正运动学:v = r * (ω_R + ω_L) / 2,ω = r * (ω_R - ω_L) / L

- 逆运动学:ω_L = (v - ω * L / 2) / r,ω_R = (v + ω * L / 2) / r

逆运动学模型用于将上层控制器计算出的 v 和 ω 转换为底层电机需要执行的轮速指令。

3.2.3. 视觉伺服控制律

视觉伺服的核心是设计一个控制律,将位姿误差转化为机器人的运动指令。

- 定义目标位姿:假设设备在机器人坐标系 {R} 下的位姿为

(x_t, y_t, θ_t)。我们的目标是让机器人移动到设备正前方0.5米处,即目标位姿P_target为(x_t - 0.5, y_t, θ_t)。注意,这是一个动态变化的目标点,因为它始终是相对于设备而言的。 - 计算位姿误差:机器人的当前位姿在 {R} 下始终是

(0, 0, 0)。因此,机器人相对于目标位姿的误差为:- 距离误差 (ρ):ρ = sqrt((x_t - 0.5)^2 + y_t^2)

- 角度误差 (α):机器人当前朝向与目标点的夹角,α = atan2(y_t, x_t - 0.5)

- 终点姿态误差 (β):机器人到达目标点后,其朝向与设备朝向的误差,β = θ_t - α

- PID控制:使用两个独立的PID控制器来分别控制线速度和角速度。

- 线速度控制器:输入为距离误差 ρ,当距离较远时,机器人可以较快行驶;当接近目标时,应减速以保证平稳停止。v = Kp_v * ρ(这是一个简化的比例控制,实际应用中可加入积分和微分项)。

- 角速度控制器:输入为角度误差 α,机器人需要不断调整方向来对准目标点。ω = Kp_ω * α。

- 控制逻辑切换:当机器人接近目标点(

ρ小于一个阈值)时,应将控制目标从“朝向目标点”切换为“对准最终姿态”。此时,角速度的控制输入应切换为终点姿态误差β,即ω = Kp_β * β,直到β也小于阈值,机器人完全对准后停止。

4. 实施步骤与规划

阶段 | 任务 | 关键产出 |

|---|---|---|

第一阶段 | 环境搭建与标定 | 机器人操作系统(ROS)环境配置结构光相机驱动安装与测试相机内参标定手眼标定,获得 T_rc 变换矩阵 |

第二阶段 | 视觉感知算法开发 | 设备图像数据集采集与标注YOLO目标检测模型训练与部署设备3D模型获取ICP位姿估计算法实现与测试 |

第三阶段 | 运动控制算法开发 | 差速机器人运动学模型代码实现PID视觉伺服控制器设计与编码控制逻辑切换策略实现 |

第四阶段 | 系统集成与测试 | 将感知与控制模块在ROS中集成PID参数整定完整流程的实地测试与性能评估编写最终的技术文档和用户手册 |

- 机器人操作系统(ROS)环境配置

- 结构光相机驱动安装与测试

- 相机内参标定

- 手眼标定,获得

T_rc变换矩阵

第二阶段视觉感知算法开发

- 设备图像数据集采集与标注

- YOLO目标检测模型训练与部署

- 设备3D模型获取

- ICP位姿估计算法实现与测试

第三阶段运动控制算法开发

- 差速机器人运动学模型代码实现

- PID视觉伺服控制器设计与编码

- 控制逻辑切换策略实现

第四阶段系统集成与测试

- 将感知与控制模块在ROS中集成

- PID参数整定

- 完整流程的实地测试与性能评估

- 编写最终的技术文档和用户手册

5. 挑战与应对策略

- 光照影响:结构光相机在强光或反光表面下性能会下降。对策:通过算法对点云进行滤波处理;在训练数据中加入不同光照条件的样本。

- 动态障碍物:机器人在移动过程中可能遇到人或其他障碍物。对策:集成额外的避障传感器(如激光雷达或超声波),或在视觉算法中加入动态障碍物检测功能,实现导航与避障的融合。

- 计算资源:实时运行深度学习模型和点云处理算法对计算平台要求较高。对策:选用NVIDIA Jetson等带有GPU的嵌入式平台;对模型进行量化或剪枝以加速推理。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录