还在用“网格”预测深度?浙大新方法让你直接“函数调用”,打破分辨率枷锁!

原创还在用“网格”预测深度?浙大新方法让你直接“函数调用”,打破分辨率枷锁!

原创

CoovallyAIHub

发布于 2026-01-20 10:30:19

发布于 2026-01-20 10:30:19

深度估计是计算机视觉的基石,广泛应用于自动驾驶、机器人、AR/VR等领域。传统深度估计方法一直受限于一个根本性约束:它们只能在预设的离散像素网格上输出深度。

这导致了两个核心问题:

- 分辨率僵化:训练时用的什么分辨率,输出基本就被锁定在什么分辨率,难以灵活适应不同需求。

- 细节丢失:为了预测整个网格,往往需要通过卷积上采样或线性投影,这些操作会平滑掉高频的几何细节,导致物体边缘模糊、精细结构丢失。

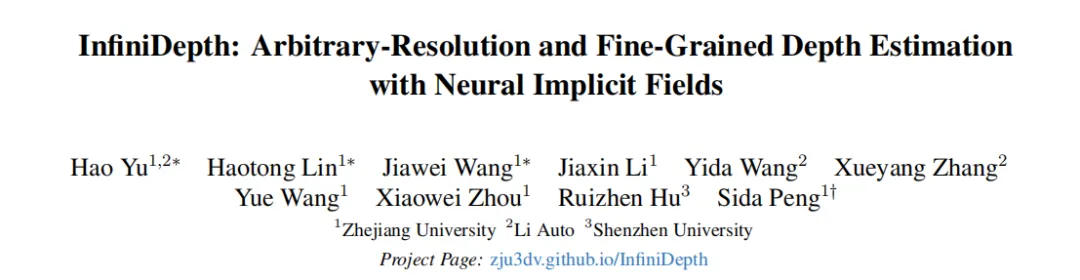

来自浙江大学、理想汽车和深圳大学的研究团队提出了InfiniDepth。它将深度建模为神经隐式场,实现了真正意义上的任意分辨率、细粒度深度估计。

图片1.png

项目主页:zju3dv.github.io/InfiniDepth 论文链接:https://arxiv.org/abs/2601.03252

核心思想:从离散网格到连续隐式场

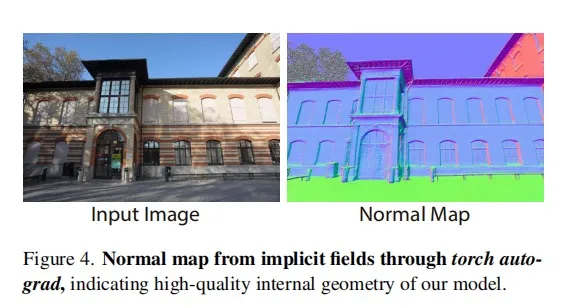

想象一下,传统的深度图像就像一张由固定格子组成的“点阵图”,你只能知道每个格子中心的深度。而InfiniDepth的理念,则是学习一个连续的数学函数。给定任意一个图像上的连续坐标(x,y),这个函数都能直接输出该点的深度值。

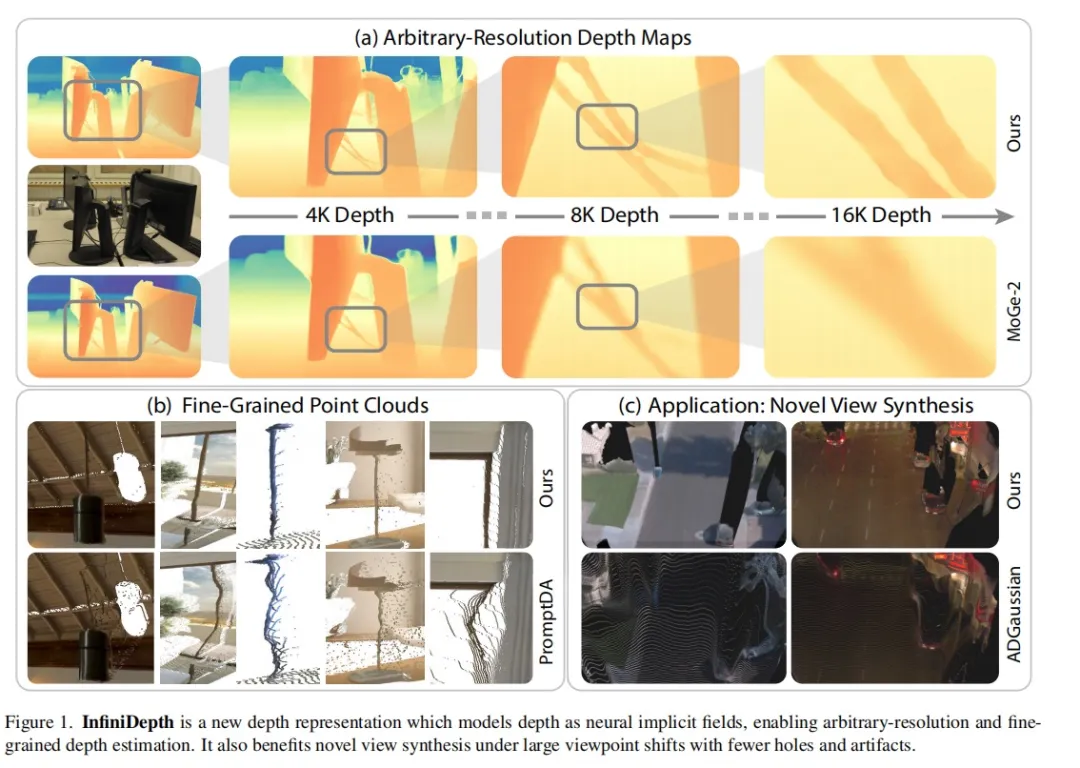

图片2.png

InfiniDepth的数学模型简洁而强大:

深度=F(图像,坐标)

这里,F是一个由神经网络参数化的隐式函数。这种表示方式带来了根本性优势:

- 分辨率自由:查询坐标是连续的,因此可以生成任意分辨率的深度图,从1K到16K甚至更高,无需重新训练模型。

- 细节友好:预测是局部和连续的,能更好地捕捉像素之间的细微几何变化,恢复边缘、纹理等高频信息。

方法详解:如何实现“无限深度”

InfiniDepth的架构主要包含两个创新部分:

- 多尺度局部隐式解码器

如何为图像上的任意点提取特征?

- 特征金字塔构建:使用Vision Transformer(ViT)编码图像,并从不同层提取特征,构建一个蕴含从细节到语义的多尺度特征金字塔。

- 局部特征查询:对于任意查询坐标(x,y),在特征金字塔的每一层,通过双线性插值,从其周围一个小邻域内提取对齐的局部特征。

- 分层融合与解码:将这些多尺度局部特征从细到粗进行融合,最后通过一个轻量级MLP解码出精确的深度值。这个过程专注于局部上下文,完美适配细节恢复。

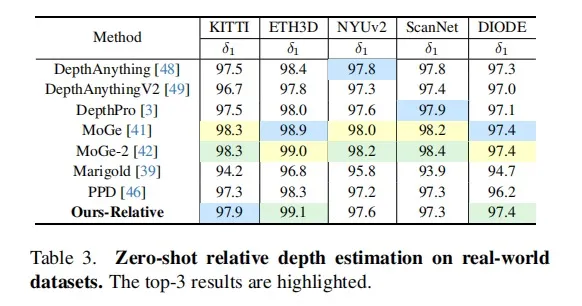

图片3.png

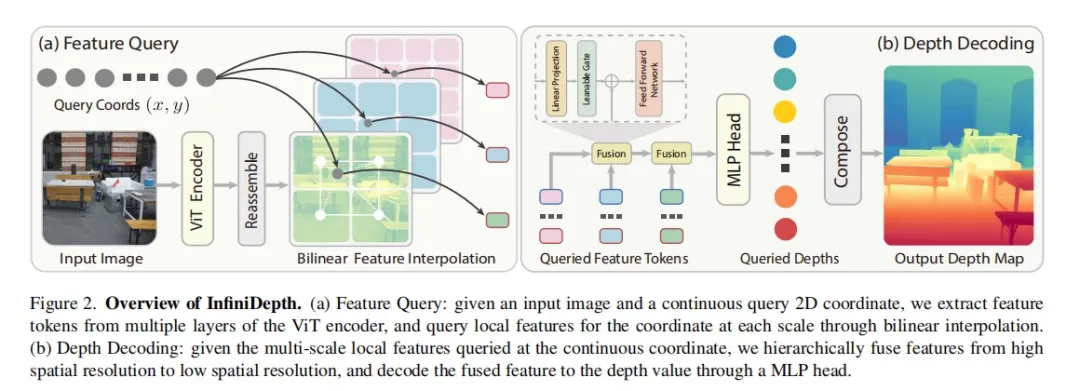

- 无限深度查询策略(创新应用点)

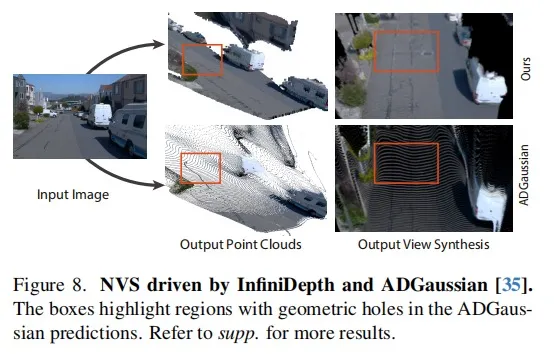

这项技术还解决了一个新视角合成(NVS)中的关键难题。传统方法将每个像素的深度反投影到3D时,由于透视投影(近大远小)和表面倾斜,会导致3D点云密度严重不均,从而在渲染新视角时产生空洞和伪影。

图片4.png

InfiniDepth的解决方案非常巧妙:

- 洞察:每个像素在3D空间中代表的实际表面积不同。它取决于深度(与距离平方成正比)和表面法线方向(越倾斜,投影面积越大)。

- 策略:利用隐式场可微分的特性,自动估算每个像素对应的3D微分面积,并以此作为权重,在像素内部自适应地分配更多亚像素查询点。

- 效果:反投影后得到的是在物体表面均匀分布的3D点云,从而为后续的新视角合成提供了高质量的几何基础,显著减少了空洞。

图片5.png

全新基准测试集:Synth4K

为了公正地评估高分辨率、细粒度深度估计的能力,作者从五款3A游戏中,精心采集并构建了一个高质量的4K RGB-D基准测试集——Synth4K。

图片6.png

Synth4K的特点:

- 分辨率高:提供3840×2160的真值深度图。

- 细节丰富:涵盖复杂室内外场景,包含大量精细几何结构。

- 评估精准:通过计算多尺度拉普拉斯能量,生成了“高频细节掩码”,可以专门评估模型在边缘、角落等难区的性能。

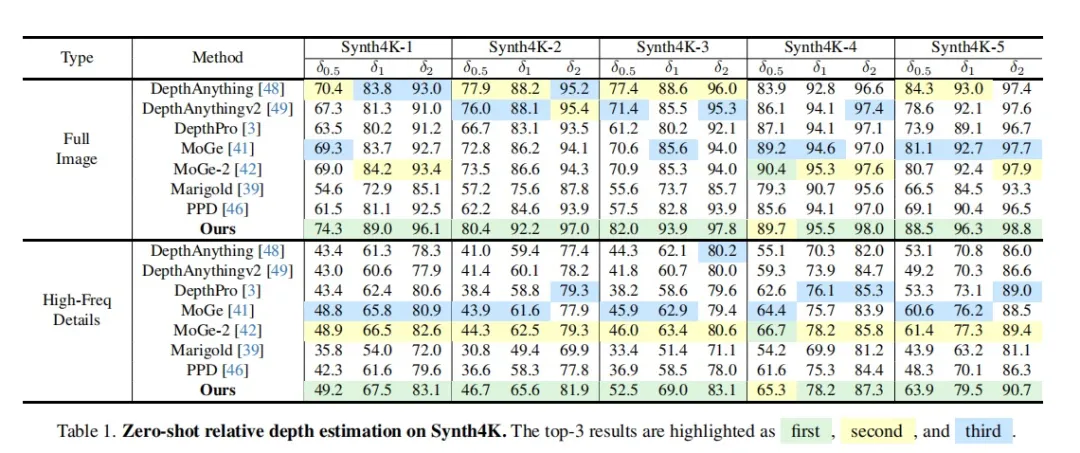

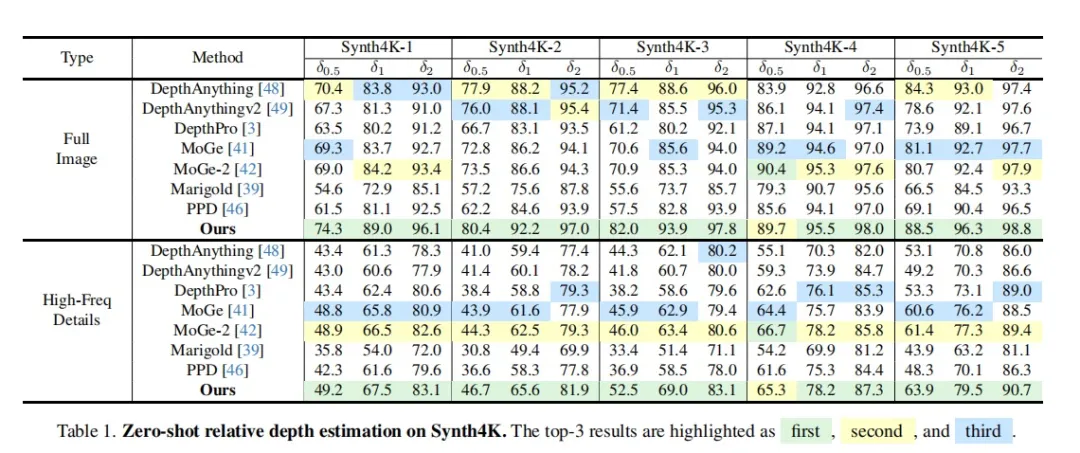

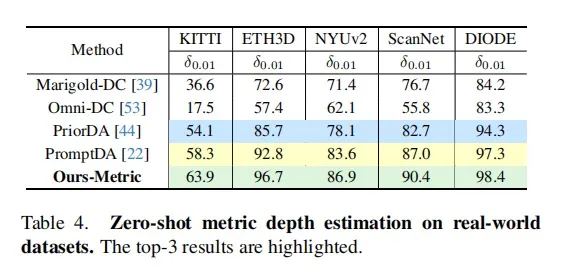

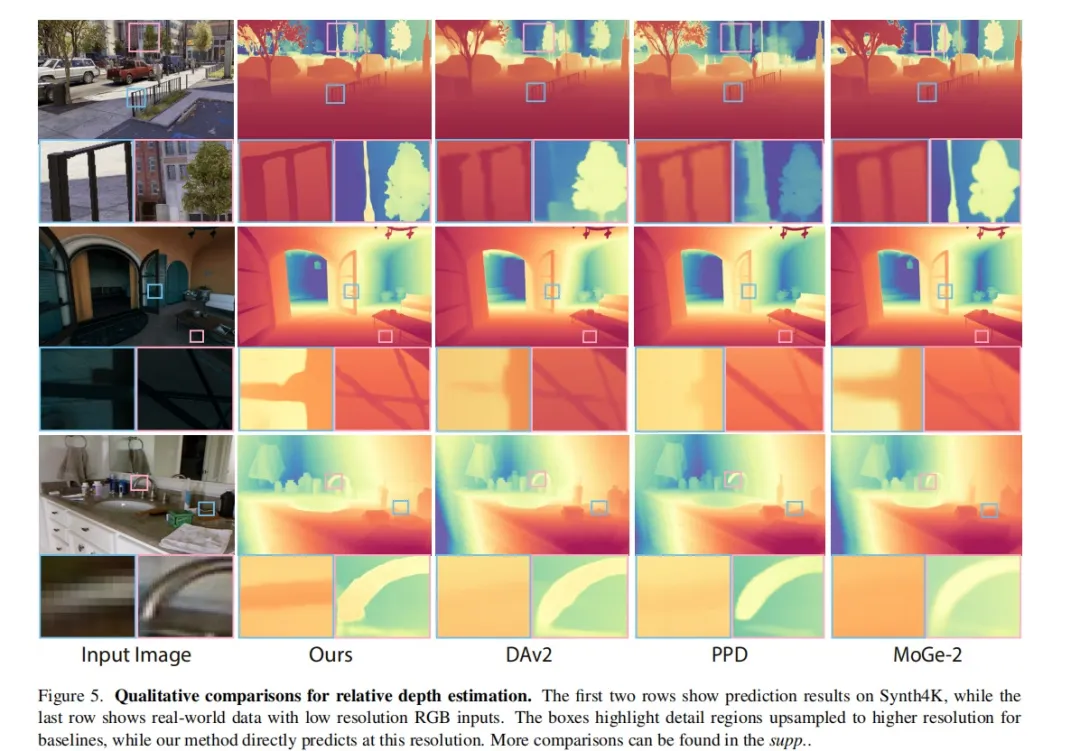

实验结果:全面领先

在Synth4K和KITTI、NYUv2等真实数据集上的大量实验表明,InfiniDepth在相对深度估计和稀疏深度引导的度量深度估计任务上,均达到了最先进的性能。

图片6.png

量化指标领先:在Synth4K上,无论是全图还是高频细节区域,InfiniDepth在δ0.5,δ1,δ2等严格指标上均大幅领先于DepthAnything、MoGe、Marigold等强劲基线。

图片7.png

图片8.png

视觉质量出众:生成的深度图边缘锐利、细节清晰,点云更加稠密和均匀。

应用效果显著:结合高斯泼溅渲染器,InfiniDepth为单张图像新视角合成带来了质的提升,即使在大视角变换下,也能生成完整、伪影少的视角。

图片9.png

图片10.png

总结与展望

InfiniDepth的核心贡献在于思维的转变——将深度从离散的网格表示,解放为连续的隐式场表示。这不仅在理论上更加优雅,更在实践中带来了分辨率自由和细节增强的双重突破。

未来方向:

- 视频深度估计:当前工作聚焦单帧,未来可扩展到视频,加入时间一致性约束。

- 多视图融合:与多视图几何结合,进一步提升三维重建的精度和鲁棒性。

- 成为基础模块:集成到更大的自动驾驶、机器人三维感知管道中。

InfiniDepth为高精度深度感知打开了新的大门,其“隐式场”的思想或许将启发更多视觉任务走向连续化、精细化的未来。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录