Nat. Commun. | 揭开神经网络势能模型的黑箱:多体相互作用的重要性究竟有多大?

Nat. Commun. | 揭开神经网络势能模型的黑箱:多体相互作用的重要性究竟有多大?

DrugAI

发布于 2026-01-06 13:52:48

发布于 2026-01-06 13:52:48

DRUGONE

基于神经网络的机器学习势能模型正逐渐成为建立复杂体系有效能量面的重要工具,既可在原子尺度融入电子结构效应,也可在粗粒度层面有效重整部分原子自由度。然而,相比于使用透明解析函数的传统势能模型,神经网络势能(NNP)的能量形式难以解释,长期被视为“黑箱”。研究人员在本研究中将可解释人工智能(Explainable AI,XAI)工具扩展至基于图神经网络(GNN)的粗粒度势能模型,并展示如何将神经网络势能分解为可理解的 n 体相互作用,使解释过程对人类可读,同时不损失预测精度。研究人员将该方法应用于三类体系:两种流体(甲烷和水)以及蛋白 NTL9。结果显示:经过充分训练的神经网络势能能够学习与物理基本原理一致的相互作用模式。

过去几十年,分子模拟已成为探索微观物理现象的重要手段。然而,精确的能量面来自求解多体的量子力学方程,通常过于昂贵。因此,研究人员在实践中通过近似方法构建有效势能,如经典力场,用参数化的键、角、二面角和非键项描述势能。

近年来,机器学习势能(尤其是 NNP)极大提升了此类模型的精度。GNN 等架构可灵活学习多体相互作用,使势能更加表达丰富。但同时也带来一个难题:NNP 的能量由网络隐式学习得出,通常无法像传统力场那样分解并解释贡献来源,引发“黑箱”争议。

在许多场景中,这样的不可解释性令人担忧。例如:

- 如何确认模型学习的是正确的物理规律,而不是训练数据中的偶然偏差?

- 如何信任模型在新体系中的外推能力?

- 如何判断哪类相互作用(2-body、3-body 甚至更高阶)对能量贡献最重要?

XAI 的兴起为此提供了新机会。然而,现有方法多应用于图像或化学性质预测,鲜有面向分子模拟中势能解释的设计。

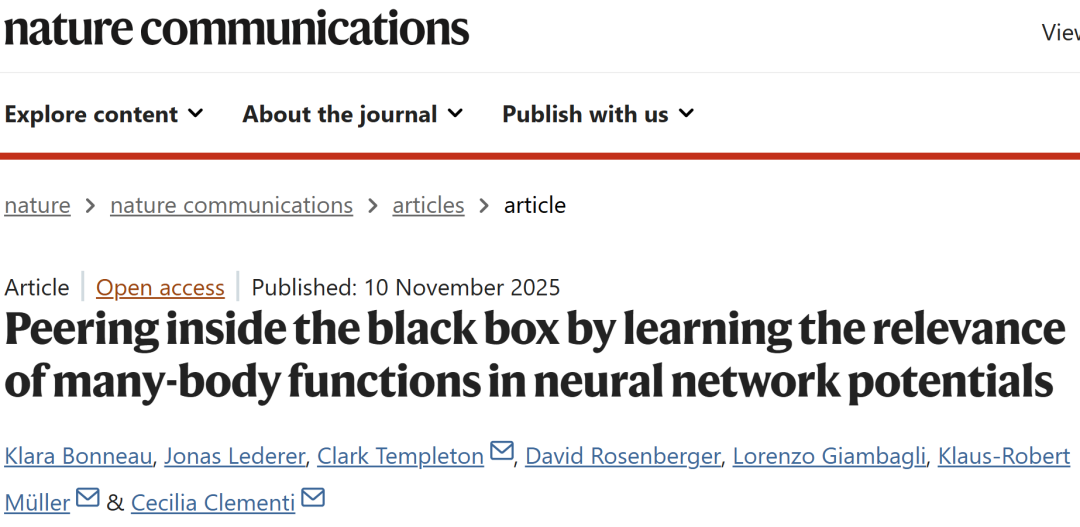

本研究旨在将 XAI 的“逐层相关性传播”(Layer-wise Relevance Propagation,LRP)扩展至 GNN 势能,使研究人员能够理解 NN 势能实际学习了哪些多体贡献、其物理意义如何,以及不同模型是否学习到相同物理规律。

方法

研究人员使用 GNN-LRP —— 将 LRP 方法扩展至图神经网络的解释框架。该方法可将 NN 的输出能量反向分解为一系列“walks”(在图上的步行序列),每个 walk 对应一组原子(或粗粒度 beads)的组合。通过对所有 walk 按照涉及的节点数量(2 个、3 个、4 个…)分组,可得到不同 n-体相互作用对模型能量贡献的分解。

研究人员在三种体系上进行了验证:

- 甲烷(弱相互作用、近似 LJ 流体)

- 水(具有强三体氢键网络)

- 蛋白 NTL9(复杂折叠、多稳态体系)

所有模型均采用粗粒度表示,以原子级模拟作为训练数据,并进行力匹配训练。随后利用 GNN-LRP 解释每种模型所学习的 n-体贡献。

结果

在甲烷与水体系上验证 GNN-LRP:学习到的多体贡献与物理一致

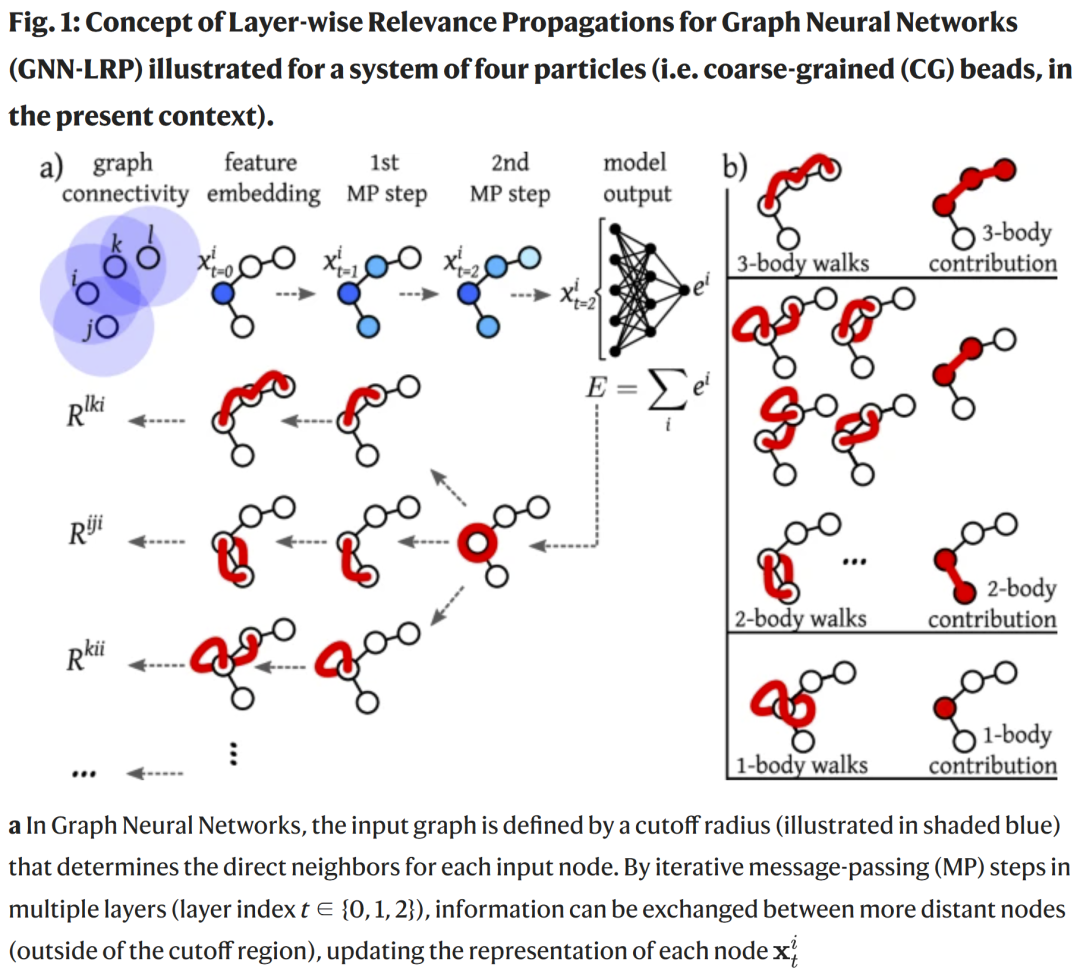

研究人员对甲烷与水进行了粗粒度建模,并用两类 GNN(PaiNN 与 SO3Net)分别训练势能模型。

(1) 结构性质再现结果良好

- 两种架构都可重现甲烷和水的径向分布函数(RDF)。

- 水的 RDF 第一个峰尖锐,对模型表达能力要求更高;SO3Net 在更低 cutoff 下也能准确捕捉。

(2) 二体贡献与 RDF 具有反相关关系

GNN-LRP 的结果显示:

- 二体项在短程表现为强排斥,符合排除体积效应。

- 在 RDF 峰附近具有稳定化贡献(负相关性)。

- 随距离接近 cutoff,贡献趋近于零,符合物理预期。

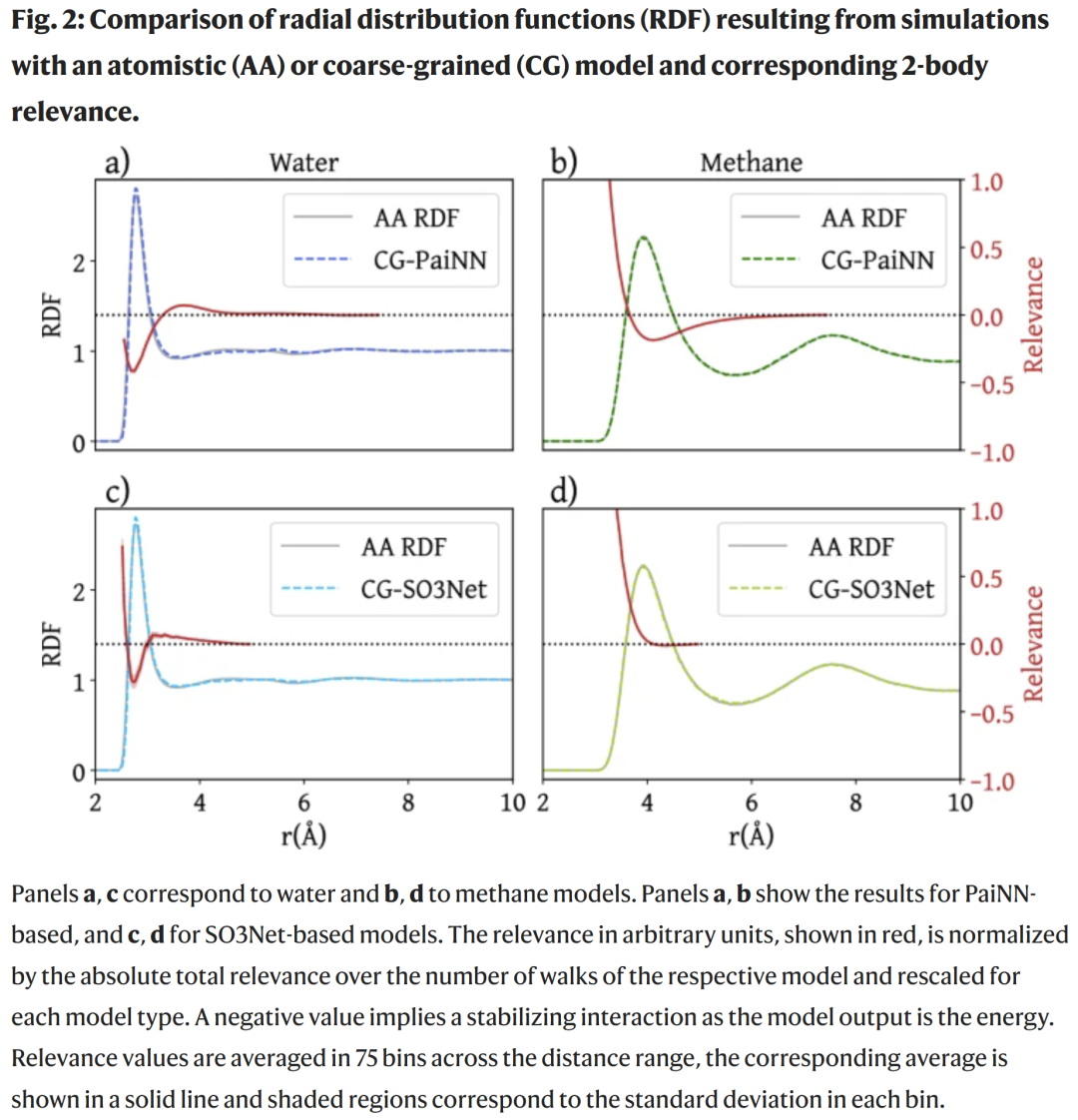

(3) 三体贡献揭示甲烷与水的根本差异

- 甲烷三体贡献接近零 → 体系几乎完全由二体项描述。

- 水的三体贡献强烈且呈现典型角度依赖 → 代表氢键网络结构。

- 两类架构(PaiNN、SO3Net)学习到的三体贡献模式高度一致,说明模型捕获了相同的有效潜在能量面。

此外,三体项不仅用于补偿二体误差,还反映了真实的氢键三体结构,这与水的物理本质一致。

NTL9 蛋白体系:GNN-LRP 揭示蛋白折叠的关键相互作用

研究人员对 NTL9 的 Cα 粗粒度模型进行训练与解释。NTL9 具有已知的折叠/解折叠两态与复杂折叠路径。

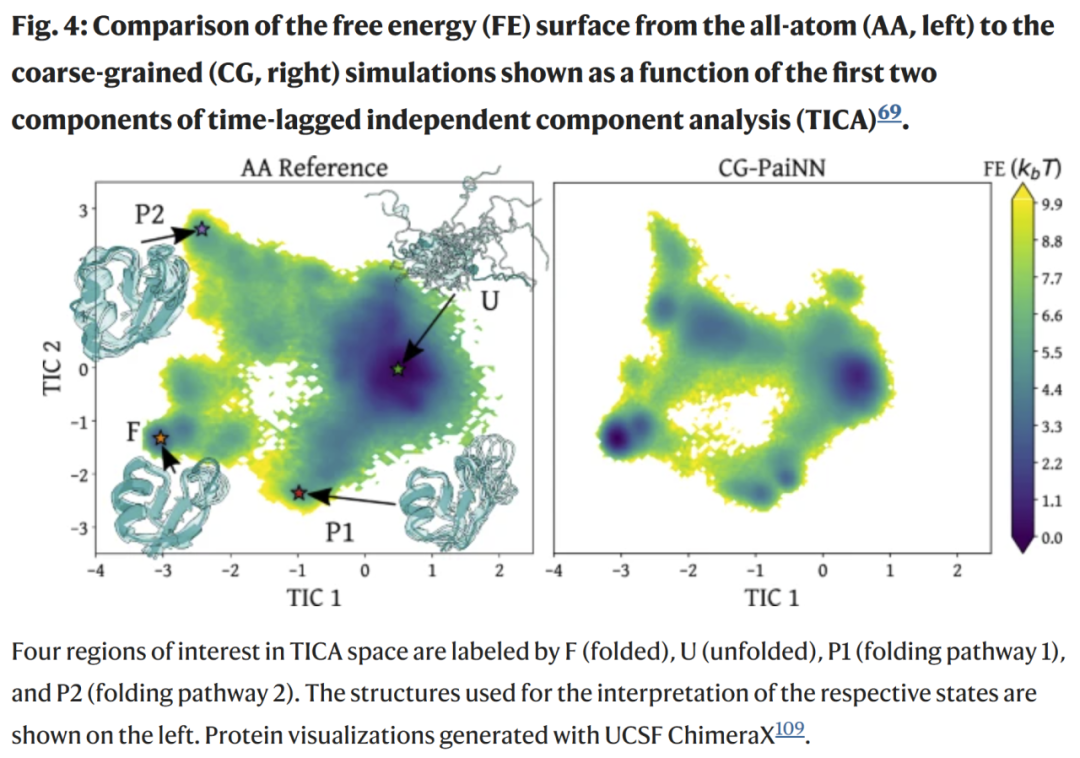

(1) GNN-CG 模型能重现折叠自由能面

- 在 TICA 空间上,CG 模型和原子模型表现一致

- 包括折叠态、解折叠态与两条折叠路径 P1、P2

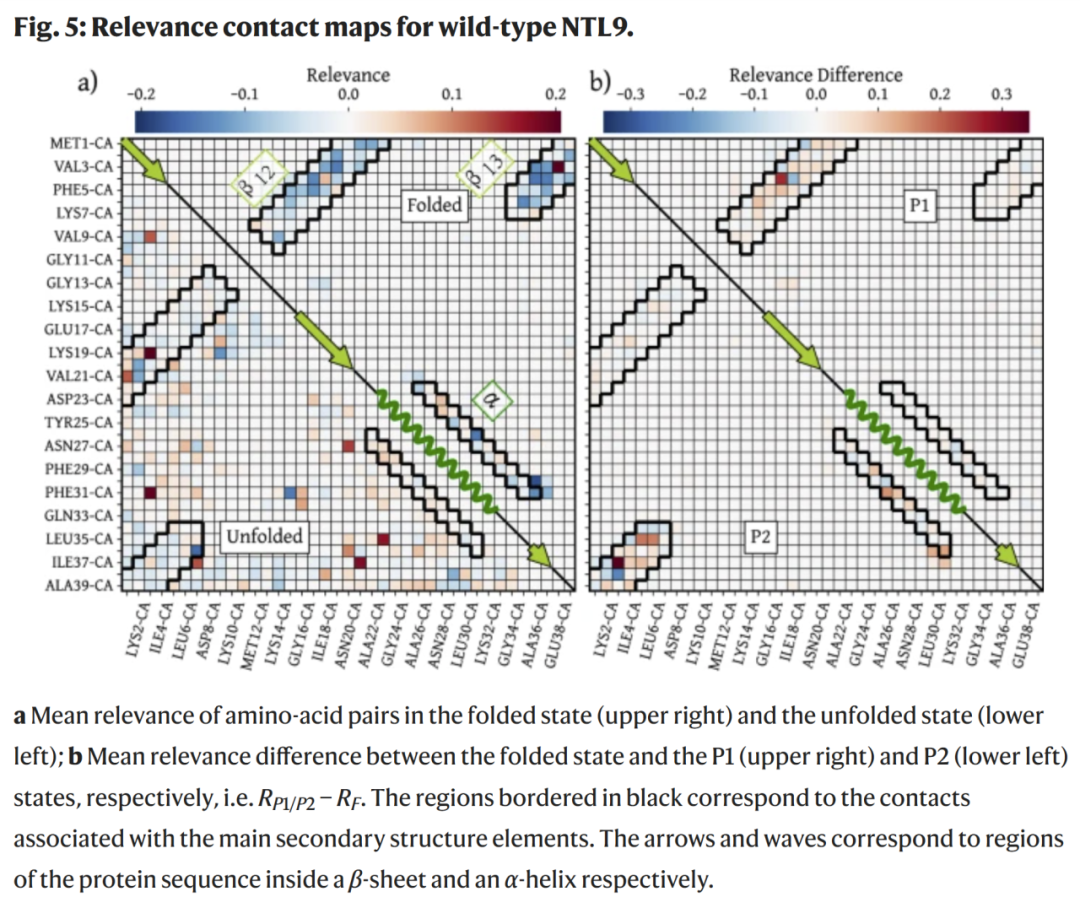

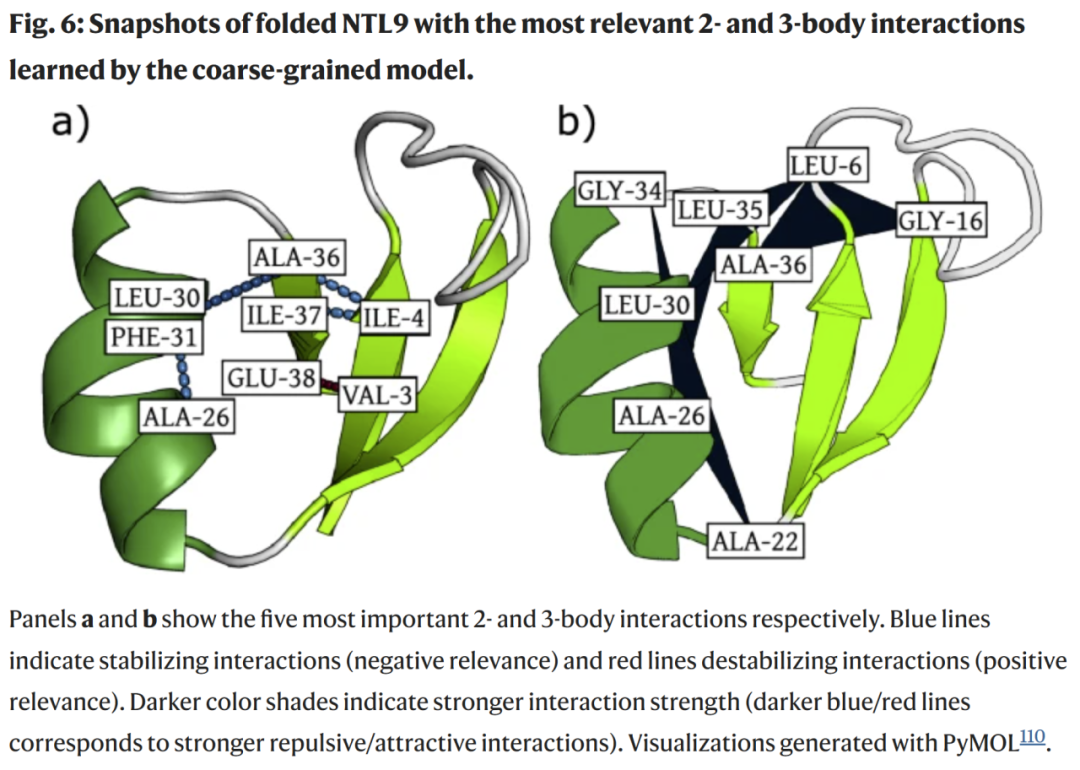

(2) 二体与三体贡献揭示折叠态的主要稳定化相互作用

GNN-LRP 显示:

- 折叠态中的二体稳定化项主要集中在 β-折叠片和 α-螺旋之间的疏水核心

- 三体项稳定化 α-螺旋与整体三级结构

- 某些残基对(例如 VAL3–GLU38)表现出去稳定化贡献,反映了 CG 模型捕获的侧链化学特异性,与已知力场一致

(3) GNN-LRP 能区分两条折叠路径的关键特征

- P1 路径中 β12 片不稳定

- P2 路径中 β13 片与 α-螺旋不稳定

- 与过去的计算研究结果一致

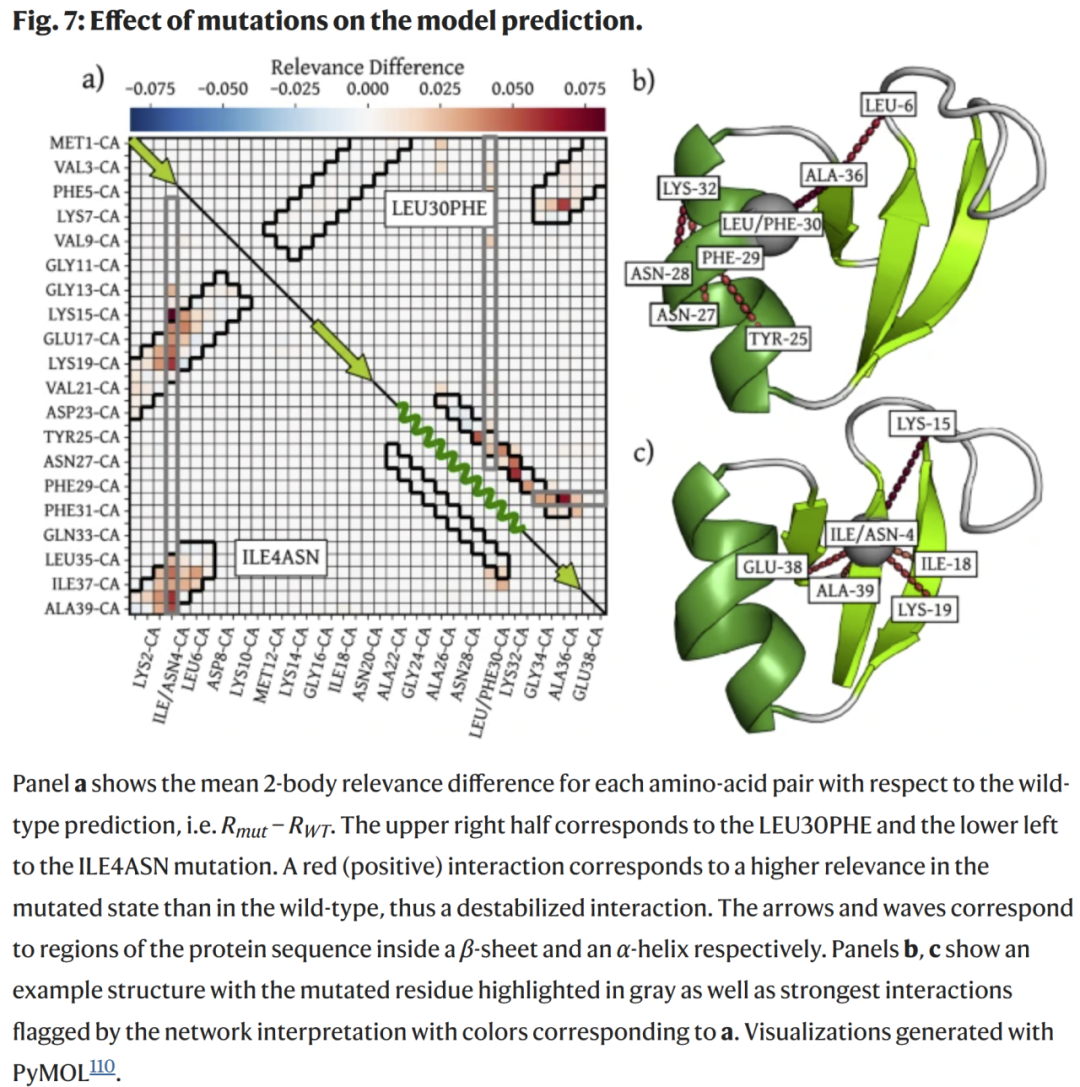

(4) GNN-LRP 能解释突变效应

研究人员模拟了两个突变:

- ILE4→ASN 破坏疏水核心

- LEU30→PHE 破坏 α-螺旋与 β 片的紧密堆叠

GNN-LRP 成功显示出:

- 这些突变导致局部与远端相互作用的去稳定化

- 模型确实学习到“氨基酸特异性”的象征性相互作用,即使在 Cα 粒度下

与传统多体分解方法的对比

传统的多体能量分解方式:

- 需要构造孤立的 n-mer

- 忽略环境

- 噪声大、难以解释

相比之下:

- GNN-LRP 在完整环境中解释 n 体贡献

- 更稳定、可解释性强

- 可揭示模型中的潜在缺陷(如训练数据分布不足导致的伪稳定化三体项)

讨论

研究人员提出的 GNN-LRP 框架为解释神经网络势能提供了以下突破:

揭示 NNP 所学习的多体物理规律

- 水体系中学习到的三体氢键模式

- 甲烷体系几乎完全由二体项支配

- 蛋白中学习到疏水核心与侧链化学特异性

不同模型架构学习到相同的物理解释

- PaiNN 与 SO3Net 的解释结果高度一致

- 说明模型学习到了潜在真实的能量面,而非简单记忆数据

揭示模型可能的问题

- LRP 可检测训练数据稀缺导致的异常三体贡献

- 超出普通 MD 性能评估所得

为粗粒度建模与 NNP 外推能力提供物理基础

- 使 NNP 从“黑箱”变为“可解释”模型

- 促进研究人员信任其预测与外推能力

研究人员认为,此方法可推广到更多体系和更多类型的机器学习势能模型,有助于未来在未知体系中通过解释推动新的物理发现。

整理 | DrugOne团队

参考资料

Bonneau, K., Lederer, J., Templeton, C. et al. Peering inside the black box by learning the relevance of many-body functions in neural network potentials. Nat Commun 16, 9898 (2025).

https://doi.org/10.1038/s41467-025-65863-0

内容为【DrugOne】公众号原创|转载请注明来源

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-11-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读