从 Vibe 到 Harness:如何为企业团队选择 AI Coding 范式

从 Vibe 到 Harness:如何为企业团队选择 AI Coding 范式

用户5602664

发布于 2026-03-31 16:53:14

发布于 2026-03-31 16:53:14

最近AI Coding在企业技术团队及个人开发者中风靡一时,不过很多团队都遇到同一个问题:AI 让编码变快了,为什么交付并没有同步变稳?

原因通常不在工具,而在范式。AI 时代的软件研发,关注点已经从“写得快”转向“交付稳、可追溯、可规模化”。

现在新范式层出不穷,名字越来越多,但很多企业技术团队并没有真正“用起来”:

要么停在概念层,要么局部试点后无法规模化,结果是效率、质量、协作、合规等问题仍然反复出现。

这篇文章希望做三件事:

第一,带你快速看见更多范式,而不只盯着 4 个热门词;

第二,帮你理清它们之间的关系与分层;

第三,给出可落地的评估与判断框架,帮助团队选到当下真正合适的范式组合。

适合阅读人群:技术负责人、架构师、平台工程团队、正在推进 AI Coding 规模化落地的研发管理者。

阅读方式建议:先看“全景对比表”建立全局视角,再结合“场景化选型”和“默认组合路线”做决策。

先看入口:4 个高频范式在解决什么问题

在进入全景图之前,先抓住最常见的四个入口。

它们几乎覆盖了企业团队最常遇到的四类痛点:探索慢、对齐难、集成难、回归不稳。

1) Vibe Coding:解决探索效率

- 适合:需求模糊、方向不确定、需要快速试错。

- 价值:启动快、反馈快、创意密度高。

- 边界:可追溯性弱,长期容易积累技术债。

2) Spec Coding(SDD):解决交付一致性

- 适合:需求相对稳定、跨团队协作、需要验收签字。

- 价值:规格即契约,返工少,审计与复盘成本低。

- 边界:前期投入高,变更治理要求更严格。

3) Glue Coding(Integration/Orchestration):解决系统打通

- 适合:异构系统多、已有能力多、需要快速形成业务闭环。

- 价值:连接快、复用高、落地周期短。

- 边界:若缺乏契约和测试门禁,集成耦合风险高。

4) Harness Engineering(AI Harness):解决联调与回归稳定性

- 适合:依赖复杂、环境不一致、回归频繁的项目。

- 价值:可重复验证、定位更快、回归更稳。

- 边界:初期建设成本高,需要持续维护。

这 4 个范式解释了企业 AI Coding 的核心矛盾:探索速度、交付质量、系统连接、验证稳定性 很难靠单一方法同时满足。

如果把视角停在这 4 个范式,结论仍然不完整。因为真实项目往往跨越多个阶段:从探索到收敛,再到稳定交付和复杂治理,每个阶段需要的“方法组合”并不相同。

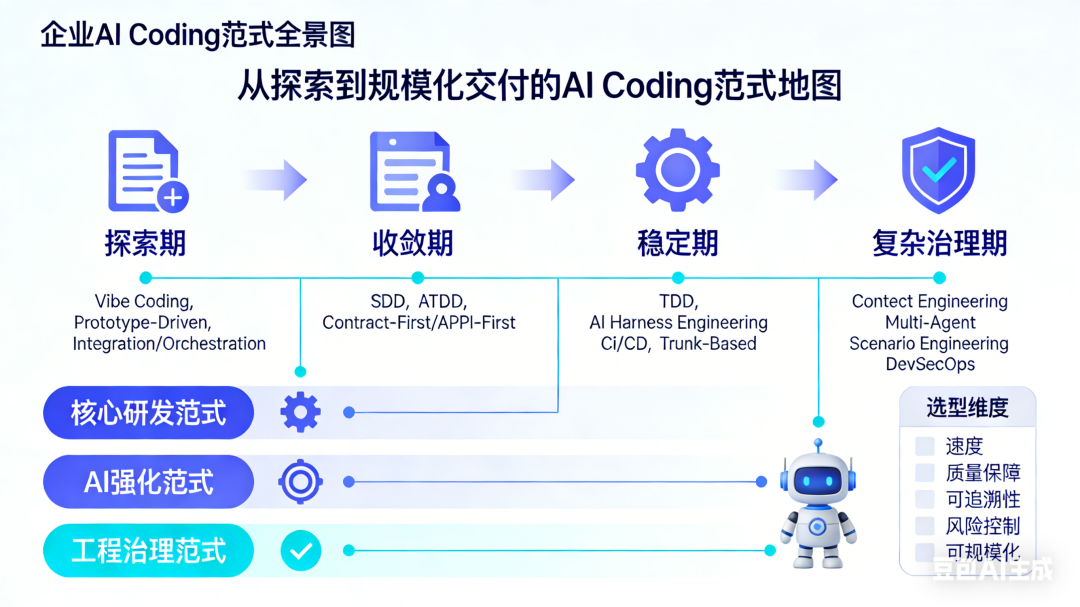

从入口到体系:完整范式族怎么分层看

问题来了:为什么很多团队“知道很多方法”,却依然很难落地?

常见原因是没有先分层,导致把不同职责的方法放在同一维度比较,最后越选越乱。

当项目进入团队化与规模化后,仅靠 4 个范式不够,需要引入更多方法形成“主范式 + 补偿范式”。

核心研发范式(直接驱动需求到功能交付)

- 这类范式直接作用在“需求分析、设计实现、验收交付”主链路上,决定功能产出方式与迭代节奏。

- 你可以把它理解为“主发动机”:它定义了团队平时如何写、如何验、如何迭代。

- Vibe Coding

- Prototype-Driven

- Integration/Orchestration

- SDD(规格驱动)

- ATDD

- BDD

- TDD

- DDD

AI 强化范式(提升 AI 协作稳定性与可控性)

- Context Engineering

- Multi-Agent Programming

- Scenario Engineering

工程治理范式(保障长期交付与组织可复制)

- AI Harness Engineering

- Contract-First / API-First

- Trunk-Based Development

- CI/CD-Driven Development

- DevSecOps

- Refactoring-Driven Development

这一分层的价值是:避免把“研发范式”和“治理范式”混在一起比较,导致选型失真。

有了分层之后,下一步不是“站队”,而是看执行差异。同样叫“方法”,不同范式在落地时的主驱动步骤完全不同,这决定了它们的协作成本、质量下限和交付节奏。

主方法横向对比:不只看理念,也看步骤

方法论讨论最容易停在口号层。

真正决定落地成败的,往往是步骤是否清晰、团队是否能重复执行。

方法 | 核心亮点 | 关键差异 | 优势 | 5 步操作法 |

|---|---|---|---|---|

Vibe Coding | 体验先行,快速感知价值 | 弱化前置约束 | 原型速度快 | 定义体验假设 -> 快速原型 -> 用户反馈 -> 固化有效模式 -> 切换规范化 |

SDD(规格驱动) | 规格即契约 | 强调可追溯与验收闭环 | 返工少,一致性高 | 定义规格与验收条目 -> 评审签字 -> 任务分解 -> 按规格实现 -> 按条目验收 |

TDD | Red-Green-Refactor 强约束 | 粒度偏技术实现 | 设计与质量同步提升 | 写失败测试 -> 最小实现通过 -> 重构 -> 回归 -> 扩展边界测试 |

BDD | 业务语言驱动协作 | 更强调业务可读性 | 降低业务-研发语义偏差 | Given/When/Then 场景 -> 评审 -> 绑定自动化 -> 实现 -> 验收 |

ATDD | 验收标准前置 | 聚焦可执行验收案例 | 交付导向明确 | 制定验收测试 -> 产品/测试共评 -> 开发实现 -> 自动验收 -> 发布前回归 |

Multi-Agent | 并行专家推理与评审 | 覆盖面比单代理更完整 | 复杂任务更稳健 | 定义角色职责 -> 并行产出 -> 统一评审标准 -> 冲突仲裁 -> 汇总复盘 |

Context Engineering | 上下文资产化管理 | 强调体系化维护 | 提升 AI 输出稳定性 | 建上下文仓 -> 约束格式化 -> 分层注入 -> 结果回写 -> 漂移监控修正 |

Scenario Engineering | 场景变量驱动验证 | 强调环境与角色变化 | 异常/边界覆盖更好 | 场景建模 -> 关键/异常路径设计 -> 风险排序 -> 演练验证 -> 反哺需求测试 |

AI Harness Engineering | 先搭支架再提速 | 偏系统级验证环境 | 联调与回归效率高 | 定义支架目标 -> 构建 mock/stub/fixture -> 接入 CI -> 建基线用例 -> 持续稳定性监控 |

Integration/Orchestration | 快速连接能力形成闭环 | 更偏拼装与编排 | 上线快、复用高 | 能力盘点 -> 连接层设计 -> 协议/数据转换 -> 端到端联调 -> 健壮性加固 |

如果上面的表回答的是“怎么做”,那么下面这张全景图回答的是“在什么阶段用、风险在哪里、边界在哪里”。

这也是管理层和架构负责人最常用的一张选型底图。

完整横向对比全景图(核心表)

接下来这张表,重点不是“谁最好”,而是“什么阶段该用什么、代价是什么、风险在哪里”。

分组 | 范式 | 主要解决问题 | 速度 | 质量保障 | 可追溯性 | 典型风险 | 推荐阶段 |

|---|---|---|---|---|---|---|---|

核心研发 | Vibe Coding | 快速探索方向与交互体验 | 高 | 低 | 低 | 需求漂移、技术债积累 | 探索期 |

核心研发 | Prototype-Driven | 低成本验证方案可行性 | 高 | 低 | 低 | 原型难平滑产品化 | 探索期 |

核心研发 | Integration/Orchestration | 连接异构能力形成业务闭环 | 高 | 中 | 中 | 集成耦合、边界脆弱 | 探索/收敛 |

核心研发 | SDD(规格驱动) | 统一需求、实现、验收口径 | 中 | 高 | 高 | 规格滞后真实需求 | 收敛/交付 |

核心研发 | ATDD | 验收标准前置并可执行 | 中 | 高 | 高 | 验收标准定义不全 | 收敛/交付 |

核心研发 | BDD | 业务语义与研发语义对齐 | 中 | 中高 | 中高 | 语义与实现脱节 | 收敛 |

核心研发 | TDD | 缺陷前移与代码设计质量 | 中 | 高 | 中 | 只测实现细节忽略验收 | 收敛/稳定 |

核心研发 | DDD | 复杂业务建模与边界治理 | 中 | 中高 | 高 | 建模复杂度过高 | 收敛/稳定 |

AI 强化 | Context Engineering | 提升 AI 输出稳定性与一致性 | 中 | 中高 | 中高 | 上下文漂移、知识过期 | 全阶段 |

AI 强化 | Multi-Agent Programming | 并行专家协作提升复杂任务覆盖 | 中 | 高 | 中高 | 角色冲突、仲裁缺失 | 收敛/复杂治理 |

AI 强化 | Scenario Engineering | 覆盖边界与异常场景 | 中 | 高 | 中高 | 场景建模不全导致漏测 | 收敛/高风险 |

工程治理 | AI Harness Engineering | 构建可重复联调与回归环境 | 中 | 高 | 中高 | 支架与真实环境偏差 | 稳定/规模化 |

工程治理 | Contract-First / API-First | 接口契约先行降低联调冲突 | 中 | 高 | 高 | 契约变更治理失控 | 收敛/交付 |

工程治理 | Trunk-Based Development | 降低分支分叉与合并风险 | 中高 | 中 | 中 | 主干门禁不足 | 稳定/规模化 |

工程治理 | CI/CD-Driven Development | 自动化门禁与持续交付 | 中高 | 高 | 中高 | 流水线形同虚设 | 稳定/规模化 |

工程治理 | DevSecOps | 安全与合规左移 | 中 | 高 | 高 | 安全策略与研发脱节 | 全阶段(高风险优先) |

工程治理 | Refactoring-Driven | 持续降低技术债与复杂度 | 中 | 中高 | 中 | 重构无验收导致回归 | 稳定/演进 |

对全景表的简要解读

- 这不是“谁更先进”的排名,而是“谁在什么阶段更有效”的分工图。

- 探索范式(Vibe/Prototype)用于验证价值,不应直接贯穿交付全周期。

- 交付范式(SDD/ATDD/Contract)用于锁定一致性与验收口径。

- 稳定范式(TDD/Harness/CI-CD)用于锁定质量下限与回归效率。

- 高风险场景必须叠加 Scenario 与 DevSecOps,单靠编码范式不够。

在企业实践中,可以把这张表当作“范式地图”来用:

先根据阶段和风险确定主范式,再用补偿范式填补短板,而不是一次性同时引入多套方法。

但在企业里,选型还有一个常被忽略的维度:资源投入结构。

很多团队不是方法选错,而是投入结构失衡,比如前期几乎不投 Spec 和测试,后期再用大量人力补救。

过程资产投入全景矩阵(精简版)

如果全景图解决的是“选谁”,投入矩阵解决的是“怎么投”。

它直接对应企业落地时最现实的问题:预算、人力、流程注意力应该放在哪。

口径:H=高投入,M=中投入,L=低投入。

目的:回答“同样做 AI Coding,不同范式到底把资源投在哪里”。

方法 | 上下文 | Rules | MCP | Prompt | Spec | 测试 | Harness | 场景资产 | 可观测与CI/CD | 可追溯性 |

|---|---|---|---|---|---|---|---|---|---|---|

Vibe Coding | M | L | M | H | L | L | L | M | L | 低 |

Integration/Orchestration | M | M | H | M | M | M | M | M | M | 中 |

SDD | M | H | M | M | H | H | M | M | M | 高 |

ATDD | M | M | M | M | H | H | M | H | M | 高 |

TDD | M | M | M | M | L | H | M | M | M | 中 |

Context Engineering | H | H | H | H | M | M | M | M | M | 中高 |

Multi-Agent | H | H | H | H | M | H | M | H | M | 中高 |

Scenario Engineering | H | M | M | M | M | H | M | H | M | 中高 |

AI Harness Engineering | M | M | H | L | L | H | H | M | H | 中高 |

DevSecOps | M | H | H | L | M | H | M | M | H | 高 |

过程资产矩阵怎么用

- 先选主范式,再看“投入短板”补偿,而不是一次堆满所有方法。

- 项目从探索转交付时,Spec 与 测试 的投入必须从 L/M 提升到 M/H。

- AI 深度开发场景,优先把 上下文 + Rules + MCP 提升到 H,再追求生成速度。

有了全景图和投入矩阵之后,选型就可以回到业务语境:

你当前处在什么场景,目标是“快验证”还是“稳交付”,风险是“协作偏差”还是“联调失控”。

场景化选型:不同场景该选哪个范式、怎么组合

当团队把方法放回业务场景,选型就会变简单。

关键不是追求“最先进”,而是用最合适的组合解决当前最关键的交付问题。

场景 | 首选范式 | 推荐组合 |

|---|---|---|

需求模糊、试错窗口短 | Vibe Coding | Vibe + Prototype + Integration |

需求稳定、需验收签字 | SDD | SDD + ATDD + Contract-First |

核心规则复杂、质量优先 | TDD | TDD + AI Harness + CI/CD |

多系统依赖、联调成本高 | AI Harness Engineering | Harness + Integration + Contract-First |

AI 深度参与、结果需稳定 | Context Engineering | Context + Multi-Agent + Scenario |

金融/医疗/政企等高风险 | SDD + DevSecOps | SDD + ATDD + Scenario + Harness + CI/CD |

决策一页纸

为了便于跨团队共识和管理层沟通,可以直接使用下面这张一页纸版本。

项目类型 | 主方法(必须) | 配套方法(建议) | 选择原则 |

|---|---|---|---|

创新探索 / Demo / PoC | Vibe 或 Prototype | Integration + 轻量测试 | 先验证价值,再补治理 |

企业交付 / 外包交付 / 需验收签字 | SDD 或 ATDD | Contract-First + CI/CD | 先定义契约,再实现 |

核心规则复杂(计费/风控/结算) | TDD | ATDD + AI Harness | 缺陷前移,回归可重复 |

多系统联动(中台、外部 API、多环境) | AI Harness Engineering | Contract-First + Integration | 先稳联调,再扩功能 |

AI 深度参与开发 | Context Engineering | Multi-Agent + Scenario | 上下文与规则先行 |

高合规高风险(金融/医疗/政企) | SDD + DevSecOps | ATDD + Scenario + CI/CD | 合规与可审计优先 |

再往前走一步,最实用的不是“记住所有方法”,而是采用一条默认组合路线,在不同阶段按门槛切换。

默认组合路线(可直接落地)

如果你希望快速开始,而不是从零设计流程,可以先采用这条默认路线,后续再按项目特征微调。

- 探索期(0-1):Vibe + Prototype + Integration

目标是快速验证价值与可行性,尽快形成可演示闭环;治理从轻,但要提前设定“何时切换到规范化”的门槛。

- 收敛期(1-N):SDD + Contract-First + ATDD

目标是统一需求、接口和验收口径,控制返工;把“说清楚”变成“可执行、可验收”的交付标准。

- 稳定期(N->):TDD + AI Harness + CI/CD + Trunk-Based

目标是把质量门禁前移并固化为日常机制,降低回归与发布风险,建立稳定的交付节奏。

- 复杂治理期:Context + Multi-Agent + Scenario + DevSecOps

面向高复杂度或高风险场景,通过上下文治理、角色化协作、场景覆盖和安全左移,构建可审计的治理闭环。

核心原则只有一句话:单方法解决局部问题,组合范式解决交付问题。

在团队中落地:建议的 2 周试点清单

如果你准备在团队内部验证本文方法,建议用一个中等复杂度需求做 2 周试点:

- 1. 选择 1 个业务场景,明确当前阶段(探索/收敛/稳定/复杂治理)。

- 2. 按本文全景表选 1 个主范式 + 1-2 个补偿范式。

- 3. 设定基线指标:交付周期、返工率、缺陷率、验收一次通过率。

- 4. 每周做一次偏差复盘:是否范式与阶段不匹配、投入权重是否失衡。

- 5. 结束后输出团队标准:保留有效组合,剔除无效流程。

结语:从方法之争到组合落地

本文先从 4 个范式切入,再扩展到完整范式族,并给出全景横向对比表、投入矩阵与场景选型建议。

后续会继续做两件事:

- 1. 持续增加更多范式的对比与评估;

- 2. 分范式拆解“如何开发新项目”的可执行步骤与模板。

如果你正在推进企业级 AI Coding,建议从“小范围试点 + 指标化复盘”开始,而不是一次性推动全组织改造。

先证明组合有效,再做规模化推广,通常是风险更低、成功率更高的路径。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-30,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录