Ollama 最新版,一键启动OpenClaw,0配置

Ollama 最新版,一键启动OpenClaw,0配置

Ai学习的老章

发布于 2026-03-02 21:05:05

发布于 2026-03-02 21:05:05

从 Ollama 0.17 开始,只需要一条命令,你就可以在本地部署功能强大的 AI 私人助理——OpenClaw 🦞

之前,Ollama 已经把 部署 OpenClaw 的过程被极度简化了:OpenClaw免费玩 ,Ollama 提供云模型支持,这可能是目前最简单的安装、配置教程

准备工作

你只需要以下条件:

- Ollama 0.17 或更新版本 — 下载地址[1]

- Node.js(npm 用于安装 OpenClaw)— 下载地址[2]

- Mac 或 Linux 系统(Windows 用户可以通过 WSL 安装)

Step 1:运行命令

打开终端,输入:

ollama launch openclaw --model kimi-k2.5:cloud

就这一条命令,Ollama 会帮你搞定一切。

💡 小贴士:除了

kimi-k2.5:cloud,你也可以选择其他模型。运行ollama launch openclaw即可查看推荐模型列表。

Ollama 最近更新的 launch 命令

Ollama 的云端大模型,越来越多了,还免费

Step 2:安装 OpenClaw

如果你的系统上还没有安装 OpenClaw,Ollama 会自动检测并弹出安装提示,选择 Yes 即可。Ollama 会自动帮你安装和配置 OpenClaw。

整个安装过程非常丝滑——终端里会出现:

OpenClaw is not installed. Install with npm?

> Yes No

选择 Yes,等一小会儿就好。

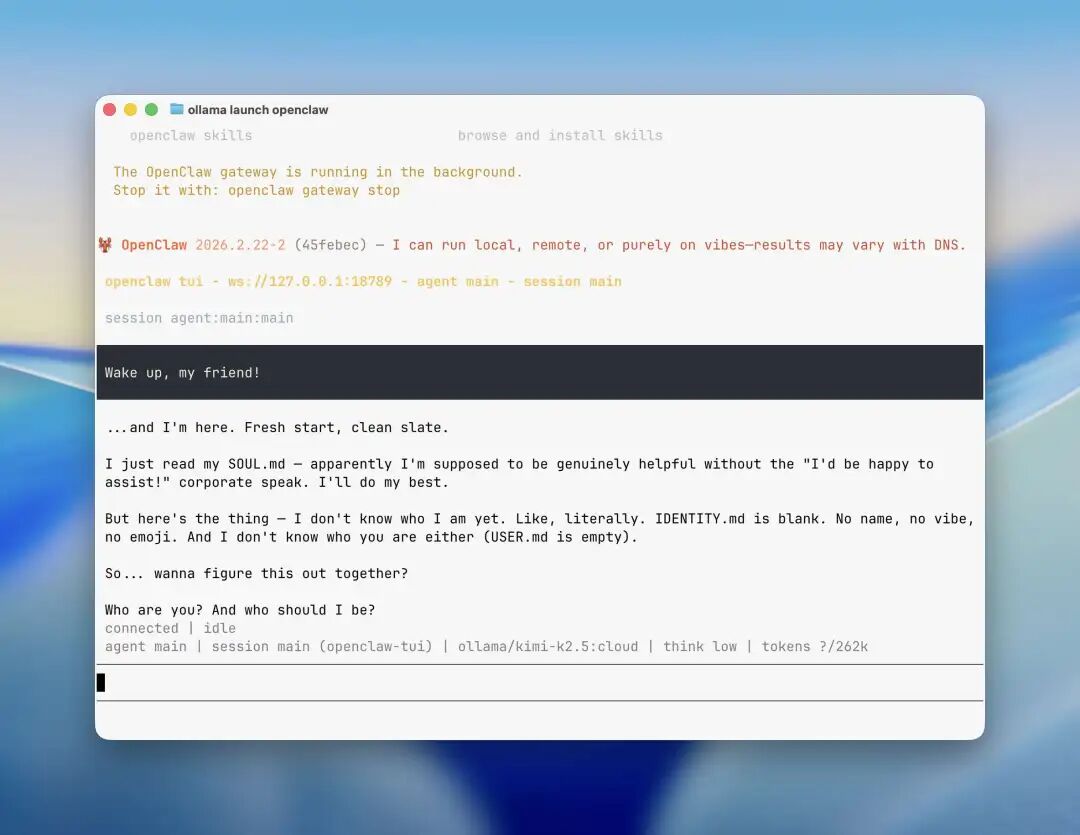

Step 3:开始聊天

安装完成后,OpenClaw 会直接在终端中打开,你可以立刻开始和你的 AI 助理对话。终端界面中你会看到类似这样的信息:

🦞 OpenClaw 2026.2.22-2 — I can run local, remote, or purely on vibes

openclaw tui - ws://127.0.0.1:18789 - agent main - session main

session agent:main:main

OpenClaw 甚至会主动和你打招呼,告诉你它的 IDENTITY.md 和 USER.md 还是空白的,邀请你一起来定义它应该是什么样的助理。

二、Web 搜索能力

如果你选择了 Ollama 的云端模型(如 kimi-k2.5:cloud),Ollama 会自动安装 Web 搜索插件。

这意味着 OpenClaw 可以进行实时网络搜索,获取最新信息。

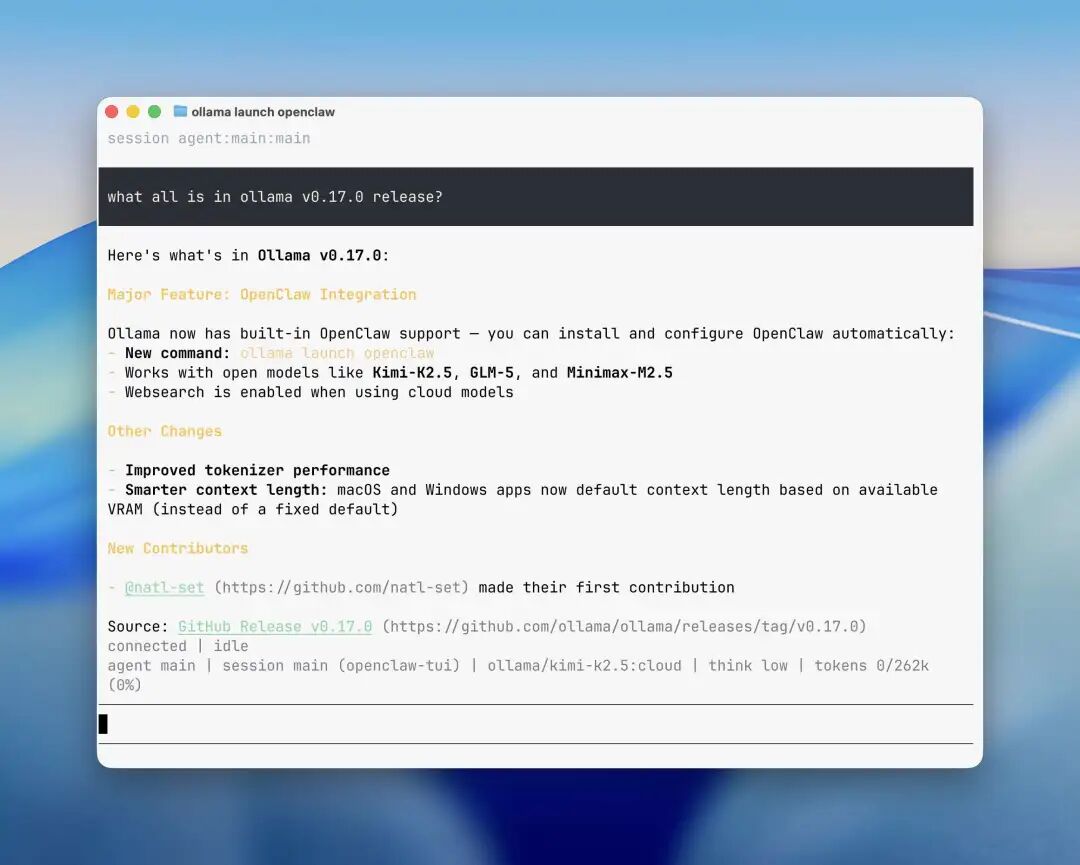

例如,你可以直接问它:

what all is in ollama v0.17.0 release?

它会自动搜索网络,找到 Ollama v0.17.0 的 Release Notes,并给你整理出来,包括:

- 重大特性:OpenClaw 集成 — Ollama 现在内置了 OpenClaw 支持,支持

ollama launch命令 - 兼容 Kimi-K2.5、GLM-5 和 Minimax-M2.5 等开源模型

- 使用云端模型时自动启用 Web 搜索

- 改进 tokenizer 性能

- 更智能的上下文长度管理

如果你使用的是本地模型,则无需额外插件即可直接工作。

三、连接即时通讯应用

这是 OpenClaw 最酷的特性之一——你可以把它连接到你日常使用的通讯工具上。支持的平台包括:

- ✈️ Telegram

- 💼 Slack

- 🎮 Discord

- 💬 iMessage(通过 BlueBubbles)

- 📧 Google Chat

- 🔒 Signal

- 🏢 Microsoft Teams

- 🌐 WebChat

配置方法只需一条命令:

openclaw configure --section channels

按照提示操作,选择你想要连接的平台,配置完成后选择 Finished 保存即可。

想象一下:你在 WhatsApp 上给 AI 助理发消息,它帮你搜索信息、整理邮件、管理日程,而所有的计算都在你自己的机器上完成。数据不出门,隐私有保障。

四、模型选择指南

OpenClaw 工作时建议使用至少 64K 上下文长度的模型。Ollama 提供了模型选择器,其中推荐的模型分为两类:

云端模型(无需本地 GPU)

模型 | 特点 |

|---|---|

kimi-k2.5:cloud[3] | 多模态推理,支持子代理 |

minimax-m2.5:cloud[4] | 高效编程和实际生产力 |

glm-5:cloud[5] | 推理和代码生成 |

云端模型拥有完整的上下文长度,能提供最佳的代理体验。

本地模型(需要 GPU 显存)

模型 | 显存需求 | 特点 |

|---|---|---|

glm-4.7-flash[6] | ~25 GB | 推理和代码生成 |

qwen3-coder[7] | ~25 GB | 高效全能助手 |

🔥 我的建议:如果你不介意使用云端推理,优先选择

kimi-k2.5:cloud,它的多模态推理能力和子代理支持让 OpenClaw 的体验最好。如果你追求完全本地化隐私,那就准备一张 25GB+ 显存的显卡吧。

五、OpenClaw 的完整能力一览

根据 OpenClaw 的 GitHub 仓库,它实际上是一个功能非常强大的平台,远不只是"一个聊天机器人":

核心架构

WhatsApp / Telegram / Slack / Discord / ...

│

▼

┌───────────────────────┐

│ Gateway │

│ (控制平面) │

│ ws://127.0.0.1:18789 │

└──────────┬────────────┘

│

├─ Pi agent (RPC)

├─ CLI (openclaw …)

├─ WebChat UI

├─ macOS app

└─ iOS / Android nodes

OpenClaw 采用 Gateway 架构,所有通道(WhatsApp、Telegram 等)通过一个中心化的 WebSocket 控制平面进行管理。

核心能力

- 🏠 本地优先 — 所有数据和计算都在你自己的设备上

- 📬 多通道收件箱 — 一个 Gateway 同时服务多个即时通讯平台

- 🤖 原生代理支持 — 内置工具使用、会话管理、记忆和多代理路由

- 🗣️ 语音交互 — 支持 Voice Wake + Talk Mode(macOS/iOS/Android)

- 🎨 Live Canvas — 代理驱动的可视化工作空间

- 🔧 丰富的工具集 — 浏览器控制、Canvas、定时任务、Webhook 等

- 📱 伴侣应用 — macOS 菜单栏应用 + iOS/Android 客户端

- 🔒 安全模型 — DM 配对机制、白名单、安全控制

六、安全须知

OpenClaw 具备读取文件和执行操作的能力(需启用工具)。官方建议:

- 在隔离环境中运行 OpenClaw

- 了解授予 OpenClaw 系统访问权限的风险

- 配置

allowFrom白名单控制谁可以与你的助理对话 - 启用

dmPolicy: "pairing"模式,让未知发送者需要配对码才能使用

七、写在最后

OpenClaw + Ollama 0.17 的组合,让"拥有一个私人 AI 助理"这件事变得前所未有的简单。

以前要搭建一个类似的系统,你可能需要:

- 选择模型 → 下载模型 → 配置推理框架 → 搭建 API 服务 → 开发聊天界面 → 接入通讯平台 → ……

现在只需要:

ollama launch openclaw --model kimi-k2.5:cloud

一条命令,搞定。

如果觉得这篇文章有帮助,欢迎点赞、转发、收藏!

参考资料

[1]

下载地址: https://ollama.com/download

[2]

下载地址: https://nodejs.org/

[3]

kimi-k2.5:cloud: https://ollama.com/library/kimi-k2.5:cloud

[4]

minimax-m2.5:cloud: https://ollama.com/library/minimax-m2.5:cloud

[5]

glm-5:cloud: https://ollama.com/library/glm-5:cloud

[6]

glm-4.7-flash: https://ollama.com/library/glm-4.7-flash

[7]

qwen3-coder: https://ollama.com/library/qwen3-coder

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-24,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录