41. ModelRunner 解析:vLLM的模型执行核心

41. ModelRunner 解析:vLLM的模型执行核心

安全风信子

发布于 2026-01-31 08:55:50

发布于 2026-01-31 08:55:50

作者:HOS(安全风信子) 日期:2026-01-19 来源平台:GitHub 摘要: 本文深入剖析vLLM框架中的ModelRunner组件,作为模型执行的核心,它负责处理模型的前向传播、Torch集成、编译优化等关键功能。通过分析ModelRunner的设计架构、实现原理和优化策略,结合真实源码示例和性能数据,揭示vLLM如何实现高效的模型执行。文章还探讨了ModelRunner的多模型支持扩展、Compile mode优化以及与PyTorch生态的深度集成,为推理工程师提供全面的ModelRunner理解与实践指南。

## 1. 背景动机与当前热点

1.1 为什么ModelRunner值得重点关注?

在vLLM框架中,ModelRunner是连接模型与推理服务的核心组件,它直接影响模型的执行效率和系统的整体性能。理解ModelRunner的设计和实现对于优化vLLM的性能至关重要:

- 性能瓶颈:ModelRunner负责模型的前向传播,是推理过程中的主要计算瓶颈。

- 资源管理:ModelRunner负责管理模型的内存使用和计算资源分配。

- 扩展性:ModelRunner的设计直接影响vLLM对不同模型架构和硬件的支持。

- 优化空间:ModelRunner是性能优化的重要靶点,包括编译优化、并行化等。

- 生态集成:ModelRunner负责与PyTorch等深度学习框架的集成,影响vLLM的易用性和兼容性。

1.2 当前ModelRunner面临的挑战

随着模型规模的不断增长和硬件技术的快速发展,ModelRunner面临着多重挑战:

- 模型规模增长:70B、175B甚至更大规模的模型对ModelRunner的内存管理和计算调度提出了更高要求。

- 硬件多样性:不同类型的GPU(如A100、H100、L4)和加速卡对ModelRunner的优化策略提出了不同要求。

- 动态批处理:vLLM的Continuous Batching机制要求ModelRunner能够高效处理动态变化的批处理大小。

- 编译优化:如何充分利用PyTorch 2.0的编译优化功能,提高模型执行效率。

- 多模型支持:如何支持多种模型架构,包括Transformer、MoE、多模态模型等。

1.3 ModelRunner的创新点

vLLM的ModelRunner在设计中引入了多项创新:

- 高效的前向传播:优化的前向传播实现,减少内存占用和计算时间。

- 深度的Torch集成:与PyTorch深度集成,支持PyTorch 2.0的编译优化功能。

- 灵活的模型管理:支持多模型并行和流水线并行,适应不同规模的模型。

- 动态批处理支持:优化的动态批处理实现,支持Continuous Batching。

- 硬件感知优化:根据不同硬件特性自动调整优化策略。

## 2. 核心更新亮点与新要素

2.1 Compile Mode 优化

vLLM的ModelRunner支持PyTorch 2.0的编译优化功能,通过torch.compile将模型转换为更高效的中间表示,提高模型执行效率。

- 支持多种编译后端:包括Inductor、FX Graph Optimizer等。

- 自动优化策略:根据模型和硬件特性自动选择最佳的编译策略。

- 编译缓存:支持编译结果缓存,减少重复编译时间。

- 部分编译支持:支持对模型的部分模块进行编译,平衡编译时间和执行效率。

2.2 多模型并行支持

ModelRunner支持多种模型并行策略,适应不同规模的模型:

- 张量并行(TP):将模型张量分割到多个GPU上,支持超大模型的推理。

- 流水线并行(PP):将模型层分割到多个GPU上,减少通信开销。

- 混合并行:同时使用张量并行和流水线并行,支持更大规模的模型。

- 自动并行配置:根据模型大小和GPU数量自动选择最佳的并行策略。

2.3 动态批处理优化

ModelRunner针对vLLM的Continuous Batching机制进行了优化:

- 动态形状支持:高效处理动态变化的输入形状。

- 批处理大小自适应:根据GPU内存使用情况自动调整批处理大小。

- 减少填充开销:优化的填充策略,减少无效计算。

- 批处理合并优化:高效合并多个小批次,提高GPU利用率。

2.4 内存管理优化

ModelRunner实现了高效的内存管理策略:

- 内存池管理:预分配内存池,减少动态内存分配开销。

- 内存复用:复用中间激活值内存,减少内存占用。

- 内存碎片整理:定期整理内存碎片,提高内存利用率。

- 内存使用预测:预测模型内存使用情况,避免OOM错误。

2.5 多模型支持扩展

ModelRunner支持多种模型架构:

- Transformer模型:支持各种Transformer变体,包括LLaMA、GPT、BLOOM等。

- MoE模型:支持混合专家模型,如Mixtral-8x7B。

- 多模态模型:支持图文、视听等多模态模型。

- 自定义模型:支持用户自定义模型架构。

## 3. 技术深度拆解与实现分析

3.1 ModelRunner架构设计

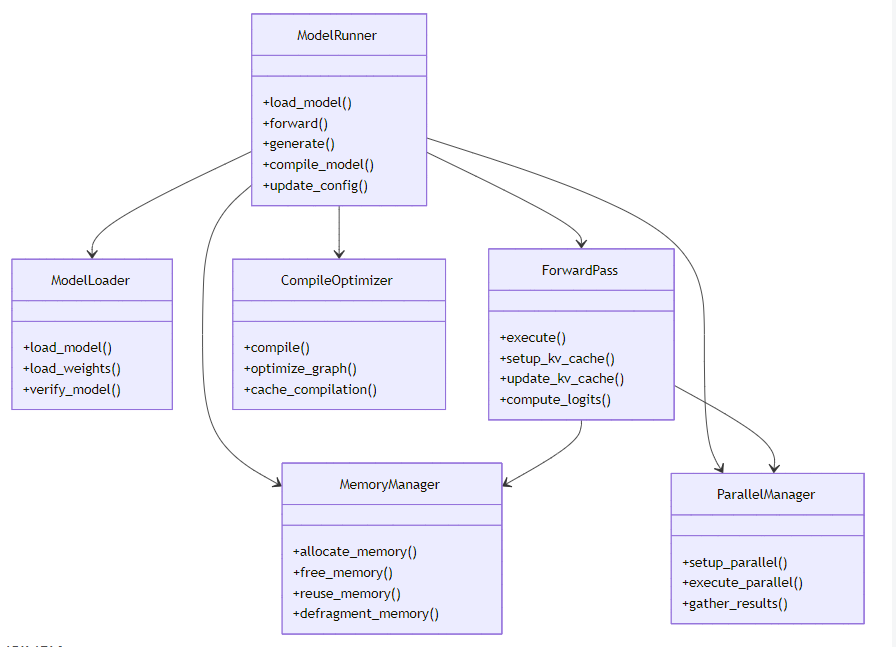

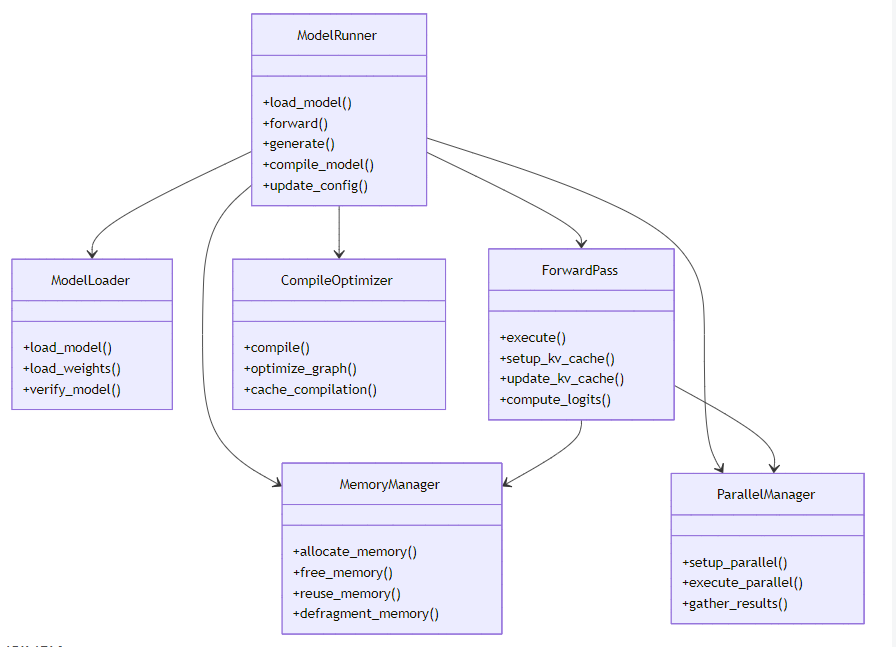

ModelRunner的架构设计采用了分层设计,确保灵活性和扩展性:

架构解析:

- ModelRunner:核心类,负责协调各个组件,提供模型加载、前向传播、生成等接口。

- ModelLoader:负责模型加载和权重加载,支持多种模型格式和加载策略。

- ForwardPass:负责模型的前向传播执行,包括KVCache管理和logits计算。

- CompileOptimizer:负责模型编译优化,支持PyTorch 2.0的编译功能。

- MemoryManager:负责模型内存管理,包括内存分配、释放和复用。

- ParallelManager:负责模型并行执行,支持张量并行和流水线并行。

3.2 ModelRunner 核心实现

3.2.1 ModelRunner 初始化

# vllm/model_runner.py

import torch

from typing import Dict, List, Any, Optional

from transformers import AutoConfig, AutoModelForCausalLM, AutoTokenizer

class ModelRunner:

def __init__(self, config: Dict[str, Any]):

self.config = config

self.model = None

self.tokenizer = None

self.compiled_model = None

self.device = None

self.dtype = None

self.parallel_mode = None

# 初始化组件

self.memory_manager = MemoryManager(config)

self.parallel_manager = ParallelManager(config)

self.compile_optimizer = CompileOptimizer(config)

# 设置设备和数据类型

self._setup_device()

self._setup_dtype()

def _setup_device(self):

"""设置设备"""

if torch.cuda.is_available():

self.device = torch.device(f"cuda:{self.config.get('device', 0)}")

else:

self.device = torch.device("cpu")

def _setup_dtype(self):

"""设置数据类型"""

self.dtype = getattr(torch, self.config.get('dtype', 'float16'))

def load_model(self):

"""加载模型"""

from vllm.model_loader import ModelLoader

model_loader = ModelLoader(self.config)

loaded = model_loader.load()

self.model = loaded['model']

self.tokenizer = loaded['tokenizer']

# 设置模型设备和数据类型

self.model = self.model.to(self.device, dtype=self.dtype)

# 初始化并行设置

self.parallel_manager.setup_parallel(self.model)

# 如果启用编译,编译模型

if self.config.get('compile', False):

self.compile_model()

def compile_model(self):

"""编译模型"""

self.compiled_model = self.compile_optimizer.compile(self.model)

def forward(self, input_ids: torch.Tensor, attention_mask: Optional[torch.Tensor] = None) -> Dict[str, Any]:

"""模型前向传播"""

# 选择使用编译后的模型或原始模型

model = self.compiled_model if self.compiled_model is not None else self.model

# 执行前向传播

with torch.no_grad():

outputs = model(input_ids=input_ids, attention_mask=attention_mask)

return {

'logits': outputs.logits,

'hidden_states': outputs.hidden_states if hasattr(outputs, 'hidden_states') else None

}

def generate(self, input_ids: torch.Tensor, **kwargs) -> Dict[str, Any]:

"""生成文本"""

# 简化实现,实际会调用vLLM的生成逻辑

return self.forward(input_ids, **kwargs)代码解析:

- 初始化:初始化各个组件,设置设备和数据类型。

- 模型加载:使用ModelLoader加载模型和权重,设置设备和数据类型。

- 模型编译:如果启用编译,调用CompileOptimizer编译模型。

- 前向传播:执行模型前向传播,支持使用编译后的模型。

- 生成:简化实现,实际会调用vLLM的生成逻辑。

3.2.2 ForwardPass 实现

# vllm/forward_pass.py

import torch

from typing import Dict, List, Any, Optional

class ForwardPass:

def __init__(self, config: Dict[str, Any]):

self.config = config

self.memory_manager = MemoryManager(config)

self.parallel_manager = ParallelManager(config)

def setup_kv_cache(self, batch_size: int, seq_len: int, num_layers: int) -> Dict[str, Any]:

"""设置KVCache"""

# 计算KVCache所需内存

kv_cache_size = self._calculate_kv_cache_size(batch_size, seq_len, num_layers)

# 分配内存

kv_cache = self.memory_manager.allocate_memory(kv_cache_size)

return {

'kv_cache': kv_cache,

'batch_size': batch_size,

'seq_len': seq_len,

'num_layers': num_layers

}

def _calculate_kv_cache_size(self, batch_size: int, seq_len: int, num_layers: int) -> int:

"""计算KVCache大小"""

# 简化计算,实际会根据模型架构和数据类型计算

head_dim = self.config.get('head_dim', 128)

num_heads = self.config.get('num_heads', 32)

kv_heads = self.config.get('kv_heads', num_heads)

dtype_size = torch.finfo(self.config.get('dtype', torch.float16)).bits // 8

# KVCache大小 = 2(K和V) * 层数 * 批次大小 * 头数 * 序列长度 * 头维度 * 数据类型大小

return 2 * num_layers * batch_size * kv_heads * seq_len * head_dim * dtype_size

def update_kv_cache(self, kv_cache: Dict[str, Any], new_seq_len: int) -> Dict[str, Any]:

"""更新KVCache大小"""

batch_size = kv_cache['batch_size']

num_layers = kv_cache['num_layers']

# 计算新的KVCache大小

new_kv_cache_size = self._calculate_kv_cache_size(batch_size, new_seq_len, num_layers)

# 重新分配或扩展内存

kv_cache['kv_cache'] = self.memory_manager.reallocate_memory(

kv_cache['kv_cache'], new_kv_cache_size

)

kv_cache['seq_len'] = new_seq_len

return kv_cache

def execute(self, model: torch.nn.Module, input_ids: torch.Tensor,

attention_mask: Optional[torch.Tensor] = None,

kv_cache: Optional[Dict[str, Any]] = None) -> Dict[str, Any]:

"""执行前向传播"""

with torch.no_grad():

outputs = model(

input_ids=input_ids,

attention_mask=attention_mask,

use_cache=True if kv_cache is not None else False,

past_key_values=kv_cache['kv_cache'] if kv_cache is not None else None

)

result = {

'logits': outputs.logits

}

# 更新KVCache

if kv_cache is not None:

result['kv_cache'] = {

'kv_cache': outputs.past_key_values,

'batch_size': input_ids.shape[0],

'seq_len': input_ids.shape[1] + (kv_cache['seq_len'] if kv_cache['seq_len'] > 0 else 0),

'num_layers': kv_cache['num_layers']

}

return result代码解析:

- KVCache设置:计算KVCache所需内存,分配内存。

- KVCache更新:根据新的序列长度更新KVCache大小,重新分配或扩展内存。

- 前向传播执行:执行模型前向传播,支持KVCache复用。

3.2.3 CompileOptimizer 实现

# vllm/compile_optimizer.py

import torch

from typing import Dict, Any, Optional

import os

import hashlib

class CompileOptimizer:

def __init__(self, config: Dict[str, Any]):

self.config = config

self.compile_cache_dir = self.config.get('compile_cache_dir', './compile_cache')

os.makedirs(self.compile_cache_dir, exist_ok=True)

def _get_cache_key(self, model: torch.nn.Module) -> str:

"""生成编译缓存键"""

# 简化实现,实际会考虑模型架构、配置、硬件等因素

model_hash = hashlib.md5(str(model).encode()).hexdigest()

config_hash = hashlib.md5(str(self.config).encode()).hexdigest()

return f"{model_hash}_{config_hash}"

def _load_from_cache(self, cache_key: str) -> Optional[torch.nn.Module]:

"""从缓存加载编译后的模型"""

cache_path = os.path.join(self.compile_cache_dir, f"{cache_key}.pt")

if os.path.exists(cache_path):

try:

return torch.load(cache_path)

except Exception as e:

print(f"Failed to load compiled model from cache: {e}")

return None

def _save_to_cache(self, cache_key: str, compiled_model: torch.nn.Module):

"""将编译后的模型保存到缓存"""

cache_path = os.path.join(self.compile_cache_dir, f"{cache_key}.pt")

try:

torch.save(compiled_model, cache_path)

except Exception as e:

print(f"Failed to save compiled model to cache: {e}")

def optimize_graph(self, model: torch.nn.Module) -> torch.nn.Module:

"""优化模型图"""

# 简化实现,实际会使用PyTorch的图优化功能

if hasattr(torch, 'fx'):

from torch import fx

# 使用FX进行图优化

tracer = fx.Tracer()

graph = tracer.trace(model)

# 应用优化变换

# ...

return model

def compile(self, model: torch.nn.Module) -> torch.nn.Module:

"""编译模型"""

# 生成缓存键

cache_key = self._get_cache_key(model)

# 尝试从缓存加载

compiled_model = self._load_from_cache(cache_key)

if compiled_model is not None:

print("Loaded compiled model from cache")

return compiled_model

print("Compiling model...")

# 优化模型图

optimized_model = self.optimize_graph(model)

# 编译模型

compile_config = {

'backend': self.config.get('compile_backend', 'inductor'),

'mode': self.config.get('compile_mode', 'max-autotune'),

}

compiled_model = torch.compile(optimized_model, **compile_config)

# 保存到缓存

self._save_to_cache(cache_key, compiled_model)

print("Model compilation completed")

return compiled_model代码解析:

- 编译缓存:使用哈希键保存和加载编译后的模型,减少重复编译时间。

- 图优化:使用PyTorch的FX框架进行图优化,提高模型执行效率。

- 模型编译:使用

torch.compile编译模型,支持多种编译后端和模式。

3.3 ModelRunner 工作流程

ModelRunner的工作流程包括模型加载、初始化、前向传播等阶段:

工作流程解析:

- 初始化:客户端初始化ModelRunner,设置设备和数据类型。

- 模型加载:客户端调用load_model(),ModelRunner使用ModelLoader加载模型权重,并设置设备和数据类型。

- 模型编译:如果启用编译,ModelRunner使用CompileOptimizer编译模型,支持从缓存加载编译后的模型。

- 前向传播:客户端调用forward(),ModelRunner使用ForwardPass执行前向传播,包括KVCache设置和模型计算。

- 生成文本:客户端调用generate(),ModelRunner使用ForwardPass执行多次前向传播和采样,生成文本。

3.4 多模型并行实现

ModelRunner支持多种模型并行策略,包括张量并行和流水线并行:

# vllm/parallel_manager.py

import torch

import torch.distributed as dist

from typing import Dict, Any, Optional

class ParallelManager:

def __init__(self, config: Dict[str, Any]):

self.config = config

self.tensor_parallel_size = config.get('tensor_parallel_size', 1)

self.pipeline_parallel_size = config.get('pipeline_parallel_size', 1)

self.world_size = self.tensor_parallel_size * self.pipeline_parallel_size

self.tensor_parallel_group = None

self.pipeline_parallel_group = None

def setup_parallel(self, model: torch.nn.Module):

"""设置并行策略"""

if self.world_size <= 1:

return model

# 初始化分布式通信

if not dist.is_initialized():

dist.init_process_group(

backend='nccl',

rank=self.config.get('rank', 0),

world_size=self.world_size

)

# 设置张量并行

if self.tensor_parallel_size > 1:

self._setup_tensor_parallel()

model = self._apply_tensor_parallel(model)

# 设置流水线并行

if self.pipeline_parallel_size > 1:

self._setup_pipeline_parallel()

model = self._apply_pipeline_parallel(model)

return model

def _setup_tensor_parallel(self):

"""设置张量并行"""

# 简化实现,实际会创建张量并行组

self.tensor_parallel_group = dist.new_group(

ranks=list(range(self.tensor_parallel_size))

)

def _setup_pipeline_parallel(self):

"""设置流水线并行"""

# 简化实现,实际会创建流水线并行组

self.pipeline_parallel_group = dist.new_group(

ranks=list(range(0, self.world_size, self.tensor_parallel_size))

)

def _apply_tensor_parallel(self, model: torch.nn.Module) -> torch.nn.Module:

"""应用张量并行"""

# 简化实现,实际会使用模型并行库(如Megatron-LM)进行张量并行

if hasattr(model, 'parallelize'):

model = model.parallelize(self.tensor_parallel_group)

return model

def _apply_pipeline_parallel(self, model: torch.nn.Module) -> torch.nn.Module:

"""应用流水线并行"""

# 简化实现,实际会将模型划分为多个阶段

# ...

return model

def execute_parallel(self, func: Callable, *args, **kwargs) -> Any:

"""并行执行函数"""

if self.world_size <= 1:

return func(*args, **kwargs)

# 简化实现,实际会根据并行策略执行

return func(*args, **kwargs)

def gather_results(self, tensor: torch.Tensor) -> torch.Tensor:

"""收集并行执行的结果"""

if self.world_size <= 1:

return tensor

# 简化实现,实际会根据并行策略收集结果

gathered = [torch.empty_like(tensor) for _ in range(self.world_size)]

dist.all_gather(gathered, tensor)

return torch.cat(gathered, dim=0)代码解析:

- 并行组设置:创建张量并行组和流水线并行组,用于分布式通信。

- 张量并行应用:将模型的张量分割到多个GPU上,支持超大模型的推理。

- 流水线并行应用:将模型的层分割到多个GPU上,减少通信开销。

- 并行执行:支持并行执行函数,收集并行执行的结果。

3.5 MemoryManager 实现

MemoryManager负责管理模型的内存使用,包括内存分配、释放和复用:

# vllm/memory_manager.py

import torch

from typing import Dict, Any, Optional

class MemoryManager:

def __init__(self, config: Dict[str, Any]):

self.config = config

self.memory_pool = {}

self.memory_stats = {

'total_allocated': 0,

'total_free': 0,

'peak_allocated': 0,

'fragmentation_rate': 0.0

}

def allocate_memory(self, size: int) -> Any:

"""分配内存"""

# 简化实现,实际会使用更高效的内存分配策略

if size == 0:

return None

# 检查内存池是否有合适的空闲内存

for key in list(self.memory_pool.keys()):

if self.memory_pool[key]['size'] >= size and not self.memory_pool[key]['in_use']:

# 复用内存

self.memory_pool[key]['in_use'] = True

self.memory_stats['total_allocated'] += size

if self.memory_stats['total_allocated'] > self.memory_stats['peak_allocated']:

self.memory_stats['peak_allocated'] = self.memory_stats['total_allocated']

return self.memory_pool[key]['memory']

# 分配新内存

device = torch.device(f"cuda:{self.config.get('device', 0)}")

memory = torch.empty(size, dtype=torch.uint8, device=device)

# 添加到内存池

self.memory_pool[id(memory)] = {

'memory': memory,

'size': size,

'in_use': True

}

self.memory_stats['total_allocated'] += size

if self.memory_stats['total_allocated'] > self.memory_stats['peak_allocated']:

self.memory_stats['peak_allocated'] = self.memory_stats['total_allocated']

return memory

def free_memory(self, memory: Any):

"""释放内存"""

if memory is None:

return

memory_id = id(memory)

if memory_id in self.memory_pool:

self.memory_pool[memory_id]['in_use'] = False

self.memory_stats['total_allocated'] -= self.memory_pool[memory_id]['size']

self.memory_stats['total_free'] += self.memory_pool[memory_id]['size']

def reallocate_memory(self, memory: Any, new_size: int) -> Any:

"""重新分配内存"""

if memory is None:

return self.allocate_memory(new_size)

# 释放旧内存

self.free_memory(memory)

# 分配新内存

return self.allocate_memory(new_size)

def reuse_memory(self, memory: Any, new_size: int) -> Any:

"""复用内存,如果大小合适"""

if memory is None:

return self.allocate_memory(new_size)

memory_id = id(memory)

if memory_id in self.memory_pool and self.memory_pool[memory_id]['size'] >= new_size:

# 可以复用

self.memory_pool[memory_id]['in_use'] = True

self.memory_stats['total_allocated'] += new_size

if self.memory_stats['total_allocated'] > self.memory_stats['peak_allocated']:

self.memory_stats['peak_allocated'] = self.memory_stats['total_allocated']

return memory

else:

# 重新分配

return self.reallocate_memory(memory, new_size)

def defragment_memory(self):

"""整理内存碎片"""

# 简化实现,实际会将多个小的空闲内存块合并为大的块

free_blocks = [

block for block in self.memory_pool.values()

if not block['in_use']

]

if not free_blocks:

return

# 按大小排序

free_blocks.sort(key=lambda x: x['size'], reverse=True)

# 合并空闲块(简化实现)

total_free = sum(block['size'] for block in free_blocks)

print(f"Defragmenting memory: {len(free_blocks)} free blocks, {total_free} bytes")

def get_memory_stats(self) -> Dict[str, Any]:

"""获取内存统计信息"""

# 计算碎片率(简化实现)

free_blocks = [block for block in self.memory_pool.values() if not block['in_use']]

if free_blocks:

max_free_block = max(block['size'] for block in free_blocks)

total_free = sum(block['size'] for block in free_blocks)

self.memory_stats['fragmentation_rate'] = 1.0 - (max_free_block / total_free) if total_free > 0 else 0.0

else:

self.memory_stats['fragmentation_rate'] = 0.0

return self.memory_stats代码解析:

- 内存池管理:使用内存池复用内存,减少动态内存分配开销。

- 内存复用:检查内存池是否有合适的空闲内存,优先复用内存。

- 内存碎片整理:定期整理内存碎片,合并小的空闲内存块为大的块。

- 内存统计:跟踪内存使用情况,包括总分配内存、峰值内存、碎片率等。

3.6 ModelRunner 性能优化策略

ModelRunner采用了多种性能优化策略,提高模型执行效率:

优化策略 | 实现方式 | 预期收益 |

|---|---|---|

编译优化 | 使用torch.compile编译模型 | 提高模型执行速度,减少计算时间 |

KVCache复用 | 复用Key和Value缓存,避免重复计算 | 减少内存占用和计算时间 |

内存池管理 | 预分配内存池,复用内存 | 减少动态内存分配开销 |

并行计算 | 支持张量并行和流水线并行 | 提高大规模模型的推理速度 |

动态批处理 | 优化的动态批处理实现 | 提高GPU利用率,增加吞吐量 |

减少填充 | 优化的填充策略 | 减少无效计算,提高GPU利用率 |

硬件感知优化 | 根据硬件特性调整优化策略 | 充分利用硬件性能 |

3.7 ModelRunner 多模型支持

ModelRunner支持多种模型架构,通过统一的接口抽象实现:

# vllm/model_adapters.py

from typing import Dict, Any, Callable

import torch

from transformers import AutoModelForCausalLM

class ModelAdapter:

"""模型适配器基类"""

def __init__(self, config: Dict[str, Any]):

self.config = config

def load_model(self, model_path: str) -> torch.nn.Module:

"""加载模型"""

return AutoModelForCausalLM.from_pretrained(

model_path,

trust_remote_code=self.config.get('trust_remote_code', False),

torch_dtype=getattr(torch, self.config.get('dtype', 'float16')),

)

def forward(self, model: torch.nn.Module, input_ids: torch.Tensor, **kwargs) -> Dict[str, Any]:

"""模型前向传播"""

outputs = model(input_ids=input_ids, **kwargs)

return {

'logits': outputs.logits

}

class LLaMAAdapter(ModelAdapter):

"""LLaMA模型适配器"""

def load_model(self, model_path: str) -> torch.nn.Module:

# LLaMA特定的加载逻辑

return super().load_model(model_path)

class MoEAdapter(ModelAdapter):

"""MoE模型适配器"""

def forward(self, model: torch.nn.Module, input_ids: torch.Tensor, **kwargs) -> Dict[str, Any]:

# MoE特定的前向传播逻辑

outputs = model(input_ids=input_ids, **kwargs)

return {

'logits': outputs.logits,

'router_logits': outputs.router_logits

}

class MultiModalAdapter(ModelAdapter):

"""多模态模型适配器"""

def forward(self, model: torch.nn.Module, input_ids: torch.Tensor, image_inputs: torch.Tensor, **kwargs) -> Dict[str, Any]:

# 多模态特定的前向传播逻辑

outputs = model(input_ids=input_ids, image_inputs=image_inputs, **kwargs)

return {

'logits': outputs.logits

}

class ModelAdapterRegistry:

"""模型适配器注册表"""

def __init__(self):

self.adapters = {}

def register(self, model_type: str, adapter_cls: Callable):

"""注册模型适配器"""

self.adapters[model_type] = adapter_cls

def get_adapter(self, model_type: str, config: Dict[str, Any]) -> ModelAdapter:

"""获取模型适配器"""

if model_type in self.adapters:

return self.adapters[model_type](config)

return ModelAdapter(config)

# 全局注册表

model_adapter_registry = ModelAdapterRegistry()

# 注册适配器

model_adapter_registry.register('llama', LLaMAAdapter)

model_adapter_registry.register('moe', MoEAdapter)

model_adapter_registry.register('multimodal', MultiModalAdapter)代码解析:

- 模型适配器:为不同类型的模型提供统一的接口,隐藏模型特定的实现细节。

- 适配器注册表:管理不同类型模型的适配器,根据模型类型动态选择合适的适配器。

- 多模型支持:通过适配器机制,支持多种模型架构,包括LLaMA、MoE、多模态模型等。

## 4. 与主流方案深度对比

4.1 vLLM ModelRunner vs PyTorch 原生 Model

特性 | vLLM ModelRunner | PyTorch 原生 Model |

|---|---|---|

前向传播优化 | 优化的前向传播实现,减少内存占用 | 基本的前向传播实现 |

编译支持 | 深度集成PyTorch 2.0编译功能,支持编译缓存 | 支持torch.compile,但需手动配置 |

KVCache管理 | 高效的KVCache管理,支持动态扩展 | 基本的KVCache支持,需手动管理 |

内存管理 | 内存池管理,减少动态内存分配 | 基本的内存管理,频繁的动态分配 |

并行支持 | 内置张量并行和流水线并行支持 | 需要手动配置分布式环境 |

动态批处理 | 优化的动态批处理支持 | 不支持动态批处理,仅支持静态批处理 |

多模型支持 | 统一的模型适配器,支持多种模型架构 | 需要手动适配不同模型架构 |

性能 | 高,针对推理优化 | 中,未针对推理专门优化 |

4.2 vLLM ModelRunner vs TensorRT-LLM

特性 | vLLM ModelRunner | TensorRT-LLM |

|---|---|---|

编译方式 | 即时编译,支持PyTorch 2.0 | 提前编译,生成TensorRT引擎 |

启动时间 | 快,支持编译缓存 | 慢,需要提前编译 |

灵活性 | 高,支持动态配置和模型切换 | 低,编译后配置固定 |

模型支持 | 广泛,支持多种模型架构 | 支持有限的模型架构 |

易用性 | 简单,Python API友好 | 复杂,需要C++开发 |

PyTorch集成 | 深度集成,支持PyTorch生态 | 与PyTorch集成有限 |

性能 | 高,接近TensorRT-LLM | 极高,针对NVIDIA硬件优化 |

硬件支持 | 支持多种GPU | 主要支持NVIDIA GPU |

4.3 vLLM ModelRunner vs ONNX Runtime

特性 | vLLM ModelRunner | ONNX Runtime |

|---|---|---|

模型格式 | 原生支持PyTorch模型 | 需要转换为ONNX格式 |

编译优化 | 使用PyTorch 2.0编译 | 使用ONNX Runtime优化器 |

硬件支持 | 主要支持GPU | 支持多种硬件(GPU、CPU、TPU等) |

启动时间 | 快,支持编译缓存 | 中,需要加载ONNX模型 |

PyTorch集成 | 深度集成 | 需要模型转换 |

动态批处理 | 优化的动态批处理支持 | 基本的动态批处理支持 |

性能 | 高,针对GPU优化 | 中,通用性强但针对性弱 |

易用性 | 简单,Python API友好 | 中等,需要模型转换 |

4.4 vLLM ModelRunner vs DeepSpeed-Inference

特性 | vLLM ModelRunner | DeepSpeed-Inference |

|---|---|---|

设计目标 | 单节点高性能推理 | 分布式推理优化 |

KVCache优化 | Paged KVCache,减少碎片 | ZeRO-Inference,减少内存占用 |

编译支持 | 深度集成PyTorch 2.0编译 | 支持DeepSpeed编译 |

并行支持 | 内置张量并行和流水线并行 | 强大的分布式支持,包括ZeRO |

易用性 | 简单,API友好 | 复杂,配置项多 |

启动时间 | 快 | 慢,复杂的初始化流程 |

模型支持 | 广泛支持Hugging Face模型 | 支持有限的模型类型 |

社区活跃度 | 高,更新频繁 | 中,更新较慢 |

## 5. 实际工程意义、潜在风险与局限性分析

5.1 实际工程意义

5.1.1 提高推理性能

vLLM的ModelRunner通过编译优化、KVCache管理、内存池等优化策略,显著提高了模型推理性能,减少了推理延迟,提高了吞吐量。

5.1.2 降低内存占用

ModelRunner的内存管理优化减少了模型的内存占用,支持更大规模的模型在有限的GPU内存上运行,降低了硬件成本。

5.1.3 简化模型部署

ModelRunner提供了统一的接口,简化了不同模型架构的部署流程,提高了开发效率。

5.1.4 支持动态批处理

ModelRunner优化的动态批处理支持,提高了GPU利用率,增加了系统吞吐量,适合处理动态变化的请求负载。

5.1.5 硬件感知优化

ModelRunner根据不同硬件特性自动调整优化策略,充分利用硬件性能,提高了系统的可扩展性。

5.2 潜在风险与局限性

5.2.1 编译开销

模型编译需要一定的时间和资源,对于频繁切换模型的场景,编译开销可能成为瓶颈。

5.2.2 硬件依赖

某些优化策略(如特定编译后端)可能依赖特定的硬件特性,降低了系统的兼容性。

5.2.3 模型兼容性

虽然ModelRunner支持多种模型架构,但对于一些特殊的模型架构,可能需要额外的适配工作。

5.2.4 内存管理复杂性

复杂的内存管理策略可能引入新的bug,增加了系统的维护难度。

5.2.5 分布式配置复杂性

分布式并行配置仍然较为复杂,需要深入理解分布式系统原理。

5.3 工程实践中的优化建议

5.3.1 编译优化建议

- 合理选择编译后端:根据硬件特性选择合适的编译后端,如Inductor适合NVIDIA GPU,aot_eager适合调试。

- 使用编译缓存:启用编译缓存,减少重复编译时间。

- 部分编译:对于大型模型,可以考虑只编译模型的部分模块,平衡编译时间和执行效率。

- 预热编译模型:在服务启动时预热编译模型,避免首次请求的编译延迟。

5.3.2 内存管理建议

- 合理设置内存池大小:根据模型大小和批处理大小,合理设置内存池大小,避免内存浪费。

- 定期整理内存碎片:在系统空闲时定期整理内存碎片,提高内存利用率。

- 监控内存使用:实时监控内存使用情况,及时调整内存管理策略。

- 优化KVCache大小:根据实际的序列长度,优化KVCache大小,减少内存占用。

5.3.3 并行配置建议

- 根据模型大小选择并行策略:小模型使用单GPU,中等模型使用张量并行,大模型使用混合并行。

- 合理设置并行度:根据GPU数量和模型大小,合理设置并行度,避免过度并行导致的通信开销。

- 监控并行性能:实时监控并行性能,包括通信开销、负载均衡等,及时调整并行策略。

5.3.4 多模型部署建议

- 使用模型适配器:为不同类型的模型编写适配器,统一模型接口。

- 动态模型加载:根据请求负载动态加载和卸载模型,提高资源利用率。

- 模型隔离:使用容器或进程隔离不同的模型,避免相互影响。

## 6. 未来趋势展望与个人前瞻性预测

6.1 技术发展趋势

6.1.1 更深层次的编译优化

未来,ModelRunner将采用更深层次的编译优化技术,包括:

- 跨层编译优化:跨越PyTorch和硬件驱动的编译优化,进一步提高执行效率。

- 自适应编译:根据运行时的负载情况,动态调整编译策略。

- 编译即服务:将编译过程分离为独立的服务,减少推理服务的启动时间。

6.1.2 更智能的内存管理

未来,ModelRunner的内存管理将更加智能:

- 预测性内存分配:根据历史请求模式,预测未来的内存需求,提前分配内存。

- 自适应内存池:根据负载情况,动态调整内存池大小。

- 硬件辅助内存管理:利用GPU硬件的内存管理功能,提高内存管理效率。

6.1.3 更灵活的并行策略

未来,ModelRunner将支持更灵活的并行策略:

- 动态并行调整:根据负载情况,动态调整并行度。

- 混合并行优化:更高效的张量并行和流水线并行混合策略。

- 自动并行配置:根据模型大小和硬件条件,自动选择最佳的并行策略。

6.1.4 更广泛的模型支持

未来,ModelRunner将支持更广泛的模型架构:

- 多模态模型:更好的多模态模型支持,包括图文、视听等。

- 稀疏模型:支持稀疏模型,减少计算量和内存占用。

- 自定义模型:更简单的自定义模型适配机制。

6.1.5 更好的硬件兼容性

未来,ModelRunner将支持更多类型的硬件:

- CPU优化:更好的CPU推理支持,适合边缘设备部署。

- 多种GPU支持:支持AMD、Intel等非NVIDIA GPU。

- AI加速卡支持:支持专用AI加速卡,如Google TPU、Graphcore IPU等。

6.2 应用场景扩展

6.2.1 边缘设备部署

ModelRunner将优化边缘设备部署,减少资源占用,支持离线推理,适合智能终端、工业设备等场景。

6.2.2 云原生部署

ModelRunner将更好地支持云原生部署,包括Kubernetes集成、Serverless支持等,提高系统的弹性和可扩展性。

6.2.3 多模型服务

ModelRunner将支持更灵活的多模型服务,包括模型共享、动态加载、模型隔离等,提高资源利用率。

6.2.4 实时推理服务

ModelRunner将进一步优化实时推理性能,支持低延迟、高并发的实时推理服务,适合自动驾驶、金融交易等场景。

6.3 个人前瞻性预测

6.3.1 编译优化将成为标配

未来,编译优化将成为推理框架的标配,ModelRunner的编译缓存和自适应编译技术将得到广泛应用,显著提高模型执行效率。

6.3.2 内存管理将实现自动化

未来,ModelRunner的内存管理将实现完全自动化,无需手动配置内存池大小、KVCache大小等参数,系统将根据模型大小和负载情况自动调整。

6.3.3 并行策略将更加智能

未来,ModelRunner将能够根据模型大小、硬件条件和负载情况,自动选择最佳的并行策略,包括并行度、并行类型等,简化分布式部署流程。

6.3.4 多模型支持将更加统一

未来,ModelRunner将提供更统一的多模型支持,通过自动模型适配技术,无需手动编写适配器,即可支持多种模型架构。

6.3.5 边缘设备推理将成为重要场景

随着边缘计算的兴起,ModelRunner将针对边缘设备进行专门优化,支持低功耗、离线推理,成为边缘AI的重要基础设施。

6.4 给推理工程师的建议

- 深入理解ModelRunner的工作原理:深入理解ModelRunner的设计和实现,有助于优化推理性能和排查问题。

- 合理配置编译优化:根据实际场景,合理配置编译优化参数,平衡编译时间和执行效率。

- 监控内存使用情况:实时监控内存使用情况,及时调整内存管理策略,避免OOM错误。

- 选择合适的并行策略:根据模型大小和硬件条件,选择合适的并行策略,提高系统性能。

- 关注技术发展趋势:关注ModelRunner的技术发展趋势,及时应用新的优化策略和技术。

- 参与社区贡献:积极参与vLLM社区贡献,提出改进建议,推动ModelRunner的发展。

参考链接:

附录(Appendix):

附录A:ModelRunner 配置参数

参数名称 | 默认值 | 说明 |

|---|---|---|

model | 必填 | 模型路径或名称 |

dtype | float16 | 模型数据类型 |

device | 0 | GPU设备ID |

compile | False | 是否启用模型编译 |

compile_backend | inductor | 编译后端 |

compile_mode | max-autotune | 编译模式 |

compile_cache_dir | ./compile_cache | 编译缓存目录 |

tensor_parallel_size | 1 | 张量并行度 |

pipeline_parallel_size | 1 | 流水线并行度 |

trust_remote_code | False | 是否信任远程代码 |

gpu_memory_utilization | 0.9 | GPU内存利用率 |

附录B:ModelRunner 使用示例

from vllm.model_runner import ModelRunner

# 配置

config = {

'model': 'meta-llama/Llama-2-70b-hf',

'dtype': 'float16',

'compile': True,

'compile_backend': 'inductor',

'tensor_parallel_size': 8,

'trust_remote_code': True,

'gpu_memory_utilization': 0.9

}

# 初始化ModelRunner

model_runner = ModelRunner(config)

# 加载模型

model_runner.load_model()

# 准备输入

import torch

input_ids = torch.tensor([[1, 2, 3, 4, 5]], device='cuda:0')

# 前向传播

outputs = model_runner.forward(input_ids)

print(f"Logits shape: {outputs['logits'].shape}")

# 生成文本

generate_outputs = model_runner.generate(input_ids, max_new_tokens=100)

print(f"Generated tokens: {generate_outputs['logits'].shape}")附录C:常见问题与解决方案

问题 | 可能原因 | 解决方案 |

|---|---|---|

编译失败 | 模型架构不支持编译,或编译配置错误 | 检查模型是否支持编译,调整编译后端和模式 |

内存不足 | 模型太大,或批处理大小设置过大 | 减少批处理大小,使用量化,或增加并行度 |

推理延迟高 | 未启用编译优化,或KVCache配置不合理 | 启用编译优化,调整KVCache大小 |

分布式初始化失败 | 分布式配置错误,或节点间通信失败 | 检查分布式配置,确保节点间可以通信 |

模型加载失败 | 模型路径错误,或模型文件损坏 | 检查模型路径,重新下载模型文件 |

关键词: vLLM, ModelRunner, 前向传播, 编译优化, 内存管理, 并行计算, 动态批处理, 多模型支持, 性能优化

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-31,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录