AI系统故障诊断:模型崩溃、算力瓶颈与数据漂移的识别与解决策略

AI系统故障诊断:模型崩溃、算力瓶颈与数据漂移的识别与解决策略

果粒蹬

发布于 2026-01-23 19:45:52

发布于 2026-01-23 19:45:52

AI系统故障诊断:模型崩溃、算力瓶颈与数据漂移的识别与解决策略

在这里插入图片描述

一、引言

在AI系统规模化落地生产环境的过程中,稳定性是决定其商业价值的核心指标之一。相较于实验室场景的可控性,生产环境中的复杂数据分布、波动的计算负载及动态业务需求,易引发各类故障,其中模型崩溃、算力瓶颈与数据漂移是三类高频且影响深远的问题。模型崩溃可能导致推理结果失真、训练任务中断,如神经网络训练过程中梯度爆炸引发的发散的,或推理时输出异常值;算力瓶颈会造成推理延迟激增、吞吐量下降,极端情况下出现GPU内存溢出(OOM),直接阻断服务响应;数据漂移则因真实场景数据分布偏离训练数据,导致模型性能持续衰减,却难以通过常规监控快速定位。这类故障不仅会影响业务流程的连续性,还可能引发决策失误、用户体验恶化等连锁反应,因此建立科学的故障识别、诊断与解决体系,对保障AI系统稳定运行至关重要。

二、问题诊断方法

针对模型崩溃、算力瓶颈与数据漂移三类故障,需建立量化检测指标与实时监控机制,实现故障的精准识别与早期预警。

2.1 模型崩溃的诊断指标与方法

模型崩溃主要分为训练阶段崩溃与推理阶段异常,核心诊断指标围绕模型参数更新、损失变化及输出合理性展开:

- 训练阶段:损失函数值突变(如骤升、骤降至趋于恒定)、梯度范数异常(过大或过小)、参数更新幅度异常(如参数值超出合理范围);

- 推理阶段:输出结果分布异常(如分类任务中某一类别占比骤升至100%)、推理耗时突变、输出空值或极值。

可通过实时监控损失曲线、梯度范数及输出统计特征,快速定位模型崩溃问题。

2.2 算力瓶颈的诊断指标与方法

算力瓶颈集中体现为计算资源供给不足与资源利用率失衡,核心检测指标包括:

- 硬件资源指标:GPU利用率(持续低于30%可能存在资源浪费,持续高于95%易引发瓶颈)、GPU显存占用率(接近100%时易触发OOM)、CPU利用率及内存占用;

- 服务性能指标:推理延迟(P95/P99延迟激增是瓶颈核心信号)、吞吐量(单位时间内处理请求数下降)、请求排队长度(持续增长说明处理能力不足)。

2.3 数据漂移的诊断指标与方法

数据漂移分为特征漂移(输入特征分布偏移)与标签漂移(输出标签分布偏移),常用量化指标包括:

- Population Stability Index(PSI):衡量特征分布的稳定性,PSI<0.1表示无显著漂移,0.1≤PSI<0.25表示轻微漂移,PSI≥0.25表示严重漂移;

- Kullback-Leibler(KL)散度:量化两个分布的差异程度,值越大说明漂移越明显;

- Jensen-Shannon(JS)散度:KL散度的对称形式,取值范围[0,1],更适合跨分布对比。

代码示例:基于PSI的特征漂移实时检测

以下代码使用scikit-learn实现PSI计算,可嵌入生产环境监控流程,实时检测特征分布偏移。

import numpy as np

from sklearn.preprocessing import KBinsDiscretizer

def calculate_psi(expected: np.ndarray, actual: np.ndarray, bins: int = 10) -> float:

"""

计算Population Stability Index(PSI)

参数:

expected: 训练集特征分布(基准分布)

actual: 生产环境实时特征分布(待检测分布)

bins: 离散化分箱数,默认10

返回:

psi: PSI值

"""

# 移除缺失值

expected = expected[~np.isnan(expected)]

actual = actual[~np.isnan(actual)]

# 离散化处理(避免因连续值导致分布对比失真)

discretizer = KBinsDiscretizer(n_bins=bins, encode='ordinal', strategy='quantile')

discretizer.fit(expected.reshape(-1, 1))

# 计算两个分布在各分箱中的占比

exp_counts = np.bincount(discretizer.transform(expected.reshape(-1, 1)).flatten())

act_counts = np.bincount(discretizer.transform(actual.reshape(-1, 1)).flatten())

# 归一化为概率,避免零值导致计算错误

exp_prob = exp_counts / exp_counts.sum() + 1e-10 # 加平滑项

act_prob = act_counts / act_counts.sum() + 1e-10

# 计算PSI

psi = np.sum((exp_prob - act_prob) * np.log(exp_prob / act_prob))

return psi

# 示例:模拟训练集与生产环境特征分布

np.random.seed(42)

train_feature = np.random.normal(loc=0, scale=1, size=10000) # 基准分布(正态分布)

prod_feature = np.random.normal(loc=0.5, scale=1.2, size=5000) # 存在轻微漂移的分布

psi_value = calculate_psi(train_feature, prod_feature)

print(f"特征PSI值:{psi_value:.4f}")

if psi_value < 0.1:

print("无显著特征漂移")

elif 0.1 <= psi_value < 0.25:

print("存在轻微特征漂移,建议持续监控")

else:

print("存在严重特征漂移,需立即处理")上述代码通过分箱离散化处理连续特征,避免了因单值频率过低导致的分布对比误差,同时加入平滑项防止对数计算中出现无穷大。实际应用中可将其封装为监控组件,对核心特征定时计算PSI,触发阈值告警。

三、解决策略

3.1 模型崩溃的缓解措施与实现

针对模型崩溃的不同场景,需从参数约束、训练策略及推理防护三个维度制定措施:

- 梯度裁剪抑制梯度爆炸:训练深层神经网络时,通过对梯度范数设置阈值,避免梯度累积导致参数更新幅度过大。代码示例(PyTorch): `import torch import torch.nn as nn import torch.optim as optim

定义简单模型

model = nn.Sequential(nn.Linear(100, 200), nn.ReLU(), nn.Linear(200, 10)) criterion = nn.CrossEntropyLoss() optimizer = optim.Adam(model.parameters(), lr=1e-3)

训练过程中加入梯度裁剪

for epoch in range(10): for batch_x, batch_y in dataloader: optimizer.zero_grad() output = model(batch_x) loss = criterion(output, batch_y) loss.backward()

# 梯度裁剪,范数阈值设为1.0

torch.nn.utils.clip_grad_norm_(model.parameters(), max_norm=1.0)

optimizer.step()`- 加入正则化防止过拟合与训练发散:通过L2正则化约束参数规模,或Dropout随机失活神经元,提升模型泛化能力,减少训练崩溃风险。在PyTorch中可通过在优化器中设置weight_decay实现L2正则化。

- 推理阶段异常检测与降级:在推理服务中加入输出校验逻辑,当检测到异常输出(如极值、概率分布异常)时,自动切换至备用模型或返回默认结果,避免影响业务。

3.2 算力瓶颈的缓解措施与实现

算力瓶颈的解决需兼顾资源利用率优化与模型轻量化,核心措施如下:

- 模型量化减少显存占用与计算量:将模型参数从FP32(单精度)量化为FP16(半精度)或INT8(整型),可显著降低显存占用,提升推理速度。代码示例(PyTorch FP16量化): `import torch

模型与数据移至GPU

device = torch.device(“cuda” if torch.cuda.is_available() else “cpu”) model = model.to(device)

启用FP16混合精度训练/推理

scaler = torch.cuda.amp.GradScaler()

推理过程

with torch.cuda.amp.autocast(): for batch_x in inference_dataloader: batch_x = batch_x.to(device) output = model(batch_x) # 后续处理逻辑`量化后可减少约50%显存占用,推理速度提升30%-50%,适合对精度要求不极致的业务场景。

- checkpoint机制节省显存:针对深层模型,通过梯度检查点(Gradient Checkpointing)策略,在训练时仅保存部分中间激活值,通过反向传播时重新计算其余激活值,换取显存占用降低。代码示例(PyTorch): `import torch from torch.utils.checkpoint import checkpoint

class DeepModel(nn.Module): def init(self): super().init() self.layer1 = nn.Linear(100, 1024) self.layer2 = nn.Linear(1024, 2048) self.layer3 = nn.Linear(2048, 10)

def forward(self, x):

# 对计算密集层启用checkpoint

x = checkpoint(self.layer1, x)

x = torch.relu(x)

x = checkpoint(self.layer2, x)

x = torch.relu(x)

x = self.layer3(x)

return xmodel = DeepModel().to(device)

训练逻辑与常规模型一致`

该方法会增加少量计算开销(约10%-20%),但可将显存占用降低40%-60%。- 资源调度优化:通过动态批处理(根据显存剩余量调整batch size)、请求队列限流、GPU集群负载均衡等工程手段,提升资源利用率。例如使用Kubernetes调度GPU资源,避免单卡过载。

3.3 数据漂移的缓解措施与实现

应对数据漂移需建立“检测-适应-更新”的闭环机制,核心措施如下:

- 在线增量重训练:当检测到轻微漂移时,使用生产环境新数据增量更新模型,避免全量重训练的高成本。代码示例(基于Evidently AI检测漂移+增量训练): `import pandas as pd from evidently.report import Report from evidently.metrics import DataDriftMetric import torch from torch.utils.data import DataLoader, TensorDataset

1. 漂移检测(使用Evidently AI)

准备基准数据(训练集)与实时数据(生产数据)

reference_data = pd.read_csv(“train_data.csv”) current_data = pd.read_csv(“prod_data.csv”)

定义漂移检测报告

drift_report = Report(metrics=[DataDriftMetric(column_name=“core_feature”)]) drift_report.run(reference_data=reference_data, current_data=current_data) drift_result = drift_report.as_dict()

2. 若检测到漂移,执行增量训练

if drift_result[“metrics”][0][“result”][“drift_detected”]: # 提取新数据并预处理 X_new = torch.tensor(current_data[[“core_feature”]].values, dtype=torch.float32) y_new = torch.tensor(current_data[“label”].values, dtype=torch.long) new_dataset = TensorDataset(X_new, y_new) new_dataloader = DataLoader(new_dataset, batch_size=32)

# 增量训练(冻结部分层,仅更新顶层)

for param in model.parameters():

param.requires_grad = False

model.fc = nn.Linear(model.fc.in_features, 10) # 替换顶层分类器

model.fc.requires_grad = True

optimizer = optim.Adam(model.fc.parameters(), lr=5e-4)

criterion = nn.CrossEntropyLoss()

for epoch in range(3): # 少量epoch增量更新

for batch_x, batch_y in new_dataloader:

optimizer.zero_grad()

output = model(batch_x)

loss = criterion(output, batch_y)

loss.backward()

optimizer.step()

print("增量训练完成,模型已适配新数据分布")`- 特征工程自适应调整:针对特征漂移,通过在线特征标准化、归一化(使用生产数据重新计算均值/方差),或动态筛选稳定特征,减少漂移对模型的影响。

- 模型融合与降级策略:训练多个适应不同数据分布的模型,当检测到漂移时,自动切换至对当前分布适应性更强的模型;若漂移严重,暂时降级为规则引擎,确保业务连续性。

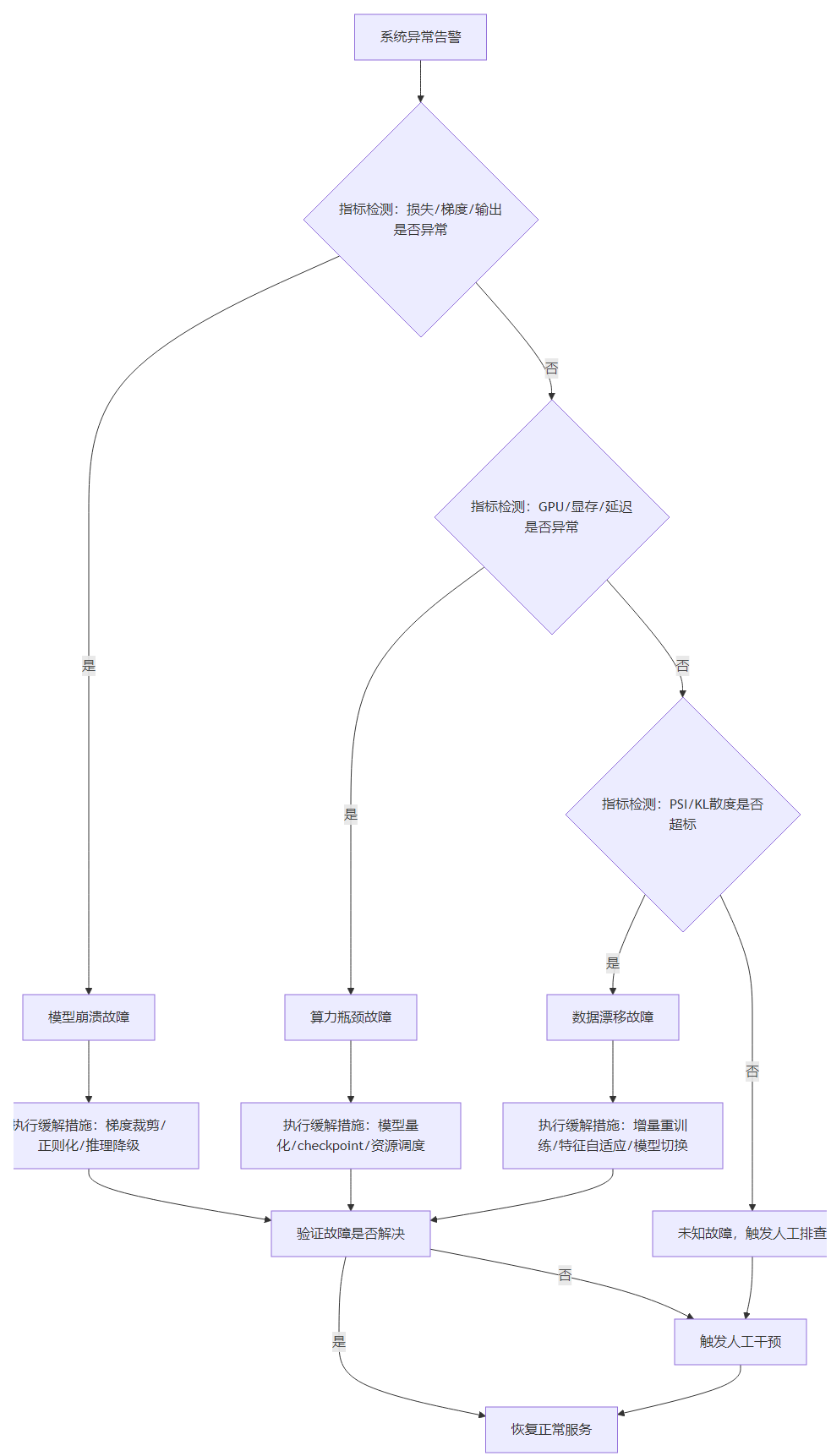

四、系统化故障处理流程图

以下为基于Mermaid语法的AI系统故障处理流程图,从异常告警出发,通过分层判断定位故障类型,并执行对应处理策略,形成闭环管理。

五、结语

AI系统的稳定性保障并非单一故障点的修复,而是构建“可观测-可诊断-可自愈”的全链路体系。模型崩溃、算力瓶颈与数据漂移的频发,本质上反映了AI系统与生产环境的动态不匹配问题。对此,首先需建立完善的可观测性体系,通过实时监控核心指标(损失、梯度、资源利用率、分布差异度等),实现故障的早期预警与精准定位;其次,需将缓解策略工程化、自动化,减少人工干预成本,例如通过脚本封装增量训练、模型量化等逻辑,接入调度系统实现故障自动恢复;最后,需持续迭代优化故障处理机制,结合业务场景调整指标阈值与处理策略,提升系统对复杂环境的适配能力。

对于AI工程师与MLOps从业者而言,需兼顾模型性能与工程稳定性,将故障诊断与解决融入模型开发、部署、运维的全生命周期。唯有如此,才能让AI系统在复杂的生产环境中持续发挥价值,真正实现从技术落地到商业赋能的闭环。

我的博客即将同步至腾讯云开发者社区,邀请大家一同入驻:https://cloud.tencent.com/developer/support-plan?invite_code=4008oyeogrn

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录