LLM提示工程:从基础到进阶

作者:HOS(安全风信子) 日期:2025-12-30 来源:GitHub 摘要: 本文深入探讨了2025年大语言模型(LLM)提示工程的最新进展,从基础概念到进阶技巧。通过分析GitHub上最新的开源项目和研究成果,本文系统梳理了提示工程的各种技术路径,包括基础提示、 few-shot提示、思维链提示、自我一致性等,并提供了完整的实践指南和性能评估。

1. 背景与动机

随着大语言模型技术的快速发展,LLM已经从实验室研究阶段逐步走向实际应用。然而,LLM的性能很大程度上依赖于用户提供的提示(Prompt)质量。一个好的提示能够引导LLM生成准确、有用、符合预期的内容,而一个差的提示可能导致LLM生成不准确、无关或无用的内容。

提示工程(Prompt Engineering)是指设计和优化提示,以引导LLM生成符合预期的内容的过程。提示工程是LLM应用开发的重要环节,能够显著提高LLM应用的性能和实用性。

在过去的一年中,GitHub上涌现出了许多优秀的提示工程项目和工具,如PromptBench、PromptHub、LangChain等,这些项目和工具为LLM提示工程提供了有力的支持。

2. 核心发现/更新点

通过对GitHub上最新提示工程项目的深入分析,我们发现了以下几个关键趋势和更新点:

- 提示工程成为LLM应用开发的核心技能:提示工程已经成为LLM应用开发的核心技能,能够显著影响LLM应用的性能和用户体验。

- 从基础提示到高级技巧:提示工程从简单的指令提示发展到复杂的思维链、自我一致性、树状思考等高级技巧,能够处理更复杂的任务。

- 提示工程工具链完善:从提示设计、评估到优化的完整工具链已经形成,如PromptBench、PromptHub等,支持提示的自动化设计和优化。

- 领域特定提示模板:针对不同领域和任务的提示模板库不断丰富,如代码生成、内容创作、知识问答等,降低了提示工程的门槛。

- 提示与微调结合:提示工程与模型微调结合,能够进一步提高LLM的性能,如提示微调(Prompt Tuning)、指令微调(Instruction Tuning)等。

3. 技术或研究拆解

3.1 提示工程基础

3.1.1 基础提示

基础提示是提示工程的起点,包括指令提示、零样本提示和提示格式优化等。

3.1.1.1 指令提示

指令提示是最基本的提示类型,直接向LLM发出指令,要求其执行特定任务。指令提示的质量直接影响LLM的响应质量,需要清晰、具体、明确。

例如:

请总结以下文章的主要内容:

[文章内容]GitHub上的最新项目如PromptHub提供了丰富的指令提示模板,适用于各种任务类型。

3.1.1.2 零样本提示

零样本提示是指在没有提供示例的情况下,直接向LLM发出指令,要求其执行特定任务。零样本提示依赖于LLM的预训练知识和推理能力。

例如:

请将以下句子翻译成法语:

Hello, how are you?3.1.1.3 提示格式优化

提示格式优化是指优化提示的结构和格式,提高LLM对提示的理解和响应质量。提示格式优化包括:

- 清晰的任务描述:明确说明任务的要求和输出格式。

- 适当的分隔符:使用分隔符(如###、```等)区分不同部分的内容。

- 示例格式:如果提供示例,保持示例格式的一致性。

- 输出格式指定:明确指定输出的格式,如JSON、列表、段落等。

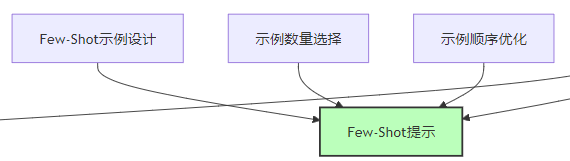

3.1.2 Few-Shot提示

Few-Shot提示是指在提示中提供少量示例,引导LLM执行特定任务。Few-Shot提示能够显著提高LLM在复杂任务上的性能。

3.1.2.1 Few-Shot示例设计

示例设计是Few-Shot提示的关键,包括:

- 示例质量:选择高质量、代表性的示例,能够准确展示任务的要求和期望输出。

- 示例多样性:选择多样化的示例,涵盖不同的场景和情况。

- 示例难度:从简单到复杂,逐步增加示例的难度,帮助LLM理解任务的渐进性。

3.1.2.2 示例数量选择

示例数量是Few-Shot提示的重要参数,一般来说,示例数量越多,LLM的性能越好,但也存在边际效应。研究表明,对于大多数任务,3-5个示例就能够达到较好的效果。

3.1.2.3 示例顺序优化

示例顺序也会影响LLM的性能,一般来说,将简单示例放在前面,复杂示例放在后面,能够帮助LLM更好地理解任务的渐进性。

3.2 进阶提示技巧

3.2.1 Chain-of-Thought (CoT) 提示

Chain-of-Thought提示是指在提示中引导LLM生成中间推理步骤,而不仅仅是最终答案。CoT提示能够显著提高LLM在复杂推理任务上的性能,如数学问题、逻辑推理等。

例如:

请解决以下数学问题,并展示你的推理过程:

问题:一辆汽车以每小时60公里的速度行驶,行驶3小时后,距离目的地还有120公里。请问总路程是多少公里?

示例:

问题:一辆汽车以每小时50公里的速度行驶,行驶2小时后,距离目的地还有100公里。请问总路程是多少公里?

推理过程:

1. 汽车行驶的距离 = 速度 × 时间 = 50公里/小时 × 2小时 = 100公里

2. 总路程 = 已行驶距离 + 剩余距离 = 100公里 + 100公里 = 200公里

答案:200公里

现在请解决原问题:GitHub上的最新项目如google-research/chain-of-thought-prompting提供了丰富的CoT提示示例和研究成果。

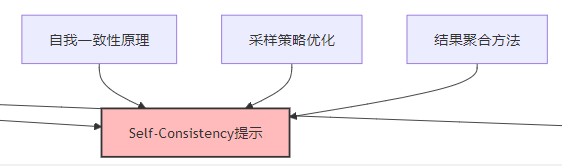

3.2.2 Self-Consistency提示

Self-Consistency提示是CoT提示的扩展,通过生成多个推理路径,并对多个结果进行投票或加权平均,提高LLM的推理准确性和可靠性。

Self-Consistency提示的基本步骤包括:

- 使用CoT提示生成多个推理路径和结果。

- 对多个结果进行投票或加权平均,选择最一致的结果。

例如:

请解决以下数学问题,并展示你的推理过程。请生成3个不同的推理路径,然后给出最终答案:

问题:如果一个书架有5层,每层可以放20本书,现在已经放了60本书,请问还可以放多少本书?3.2.3 Tree-of-Thought (ToT) 提示

Tree-of-Thought提示是一种更高级的提示技术,将推理过程建模为树状结构,每个节点代表一个中间推理步骤,每个分支代表一种可能的推理路径。ToT提示能够处理更复杂的推理任务,如规划、决策制定等。

ToT提示的基本步骤包括:

- 将问题分解为多个子问题或步骤。

- 为每个步骤生成多个可能的推理路径(分支)。

- 评估每个分支的可行性和进展。

- 剪枝不可行的分支,继续扩展有希望的分支。

- 重复步骤3-4,直到找到最终答案。

GitHub上的最新项目如princeton-nlp/tree-of-thought-llm提供了ToT提示的实现和研究成果。

3.2.4 Retrieval-Augmented Generation (RAG) 提示

RAG提示是将外部知识检索与LLM生成相结合的提示技术,通过将检索到的相关知识作为上下文提供给LLM,提高生成内容的准确性和完整性。

RAG提示的基本步骤包括:

- 将用户查询转换为向量表示。

- 在向量数据库中检索相关的知识片段。

- 将检索到的知识片段作为上下文添加到提示中。

- 引导LLM基于上下文生成响应。

GitHub上的最新项目如langchain-ai/langchain和run-llama/llama_index提供了完整的RAG提示实现框架。

3.3 提示工程工具与框架

3.3.1 提示设计工具

提示设计工具是帮助用户设计和优化提示的工具,包括:

- PromptHub:一个开源的提示模板库,包含各种任务和领域的提示模板。

- PromptBench:一个提示评估和基准测试工具,能够评估不同提示的性能。

- LangChain Prompt Templates:LangChain框架提供的提示模板系统,支持动态提示生成和参数化。

3.3.2 提示评估工具

提示评估工具是评估提示性能的工具,包括:

- PromptBench:支持多种评估指标,如准确率、F1值、BLEU等,能够评估不同提示的性能。

- Hugging Face Evaluate:一个通用的模型评估库,也可用于提示评估。

- GPT-4评估:使用GPT-4作为评估器,评估其他LLM在特定提示下的性能。

3.3.3 提示优化工具

提示优化工具是自动优化提示的工具,包括:

- AutoGPTQ:一个自动提示优化工具,能够通过强化学习自动优化提示。

- PromptOptimizer:一个基于进化算法的提示优化工具,能够自动生成和优化提示。

- LLM-as-a-Judge:使用LLM作为法官,评估不同提示的质量,并自动优化提示。

3.4 提示工程实践指南

3.4.1 提示设计原则

- 清晰明确:提示应该清晰明确,避免歧义,明确说明任务要求和输出格式。

- 具体详细:提示应该具体详细,提供足够的上下文和信息,帮助LLM理解任务。

- 示例引导:对于复杂任务,提供高质量的示例,引导LLM生成符合预期的输出。

- 格式一致:保持提示格式的一致性,使用统一的分隔符和结构。

- 逐步优化:从简单提示开始,逐步添加复杂度,根据LLM的响应进行迭代优化。

3.4.2 不同任务的提示策略

3.4.2.1 文本生成任务

文本生成任务包括内容创作、故事生成、邮件撰写等,提示策略包括:

- 明确的主题和风格:在提示中明确指定生成内容的主题、风格、长度等。

- 结构化提示:使用结构化的提示,如开头、中间、结尾的指导。

- 示例引导:提供高质量的示例,展示期望的生成风格和内容。

3.4.2.2 知识问答任务

知识问答任务包括事实问答、百科问答、专业领域问答等,提示策略包括:

- RAG提示:结合外部知识库,提供相关的背景信息。

- CoT提示:对于复杂问答,引导LLM生成中间推理步骤。

- 多轮对话:对于复杂问题,采用多轮对话的方式,逐步澄清和深入。

3.4.2.3 代码生成任务

代码生成任务包括代码补全、函数生成、整个程序生成等,提示策略包括:

- 明确的任务描述:明确说明需要生成的代码功能、输入输出、编程语言等。

- 代码上下文:提供相关的代码上下文,如类定义、函数签名等。

- 示例引导:提供高质量的代码示例,展示期望的代码风格和质量。

- 测试用例:提供测试用例,确保生成的代码能够通过测试。

3.4.2.4 推理任务

推理任务包括数学推理、逻辑推理、常识推理等,提示策略包括:

- CoT提示:引导LLM生成中间推理步骤。

- Self-Consistency提示:生成多个推理路径,提高推理准确性。

- ToT提示:对于复杂推理任务,采用树状思考方式。

3.4.3 提示评估与优化

- 定性评估:人工评估LLM的响应质量,包括准确性、相关性、有用性等。

- 定量评估:使用评估指标(如准确率、F1值、BLEU等)评估LLM的响应质量。

- A/B测试:比较不同提示的性能,选择最优提示。

- 迭代优化:根据评估结果,迭代优化提示,提高LLM的响应质量。

4. 与现有方案对比

提示技术 | 优势 | 劣势 | 适用场景 |

|---|---|---|---|

基础提示 | 简单易用,无需复杂设计 | 性能有限,难以处理复杂任务 | 简单任务,零样本或少量样本场景 |

Few-Shot提示 | 性能较好,适用范围广 | 需要手动设计示例,工作量大 | 中等复杂任务,有少量高质量示例的场景 |

CoT提示 | 显著提高复杂推理任务性能 | 需要手动设计推理示例,对示例质量要求高 | 复杂推理任务,如数学问题、逻辑推理等 |

Self-Consistency提示 | 进一步提高推理准确性和可靠性 | 计算成本高,需要生成多个推理路径 | 对准确性要求高的复杂推理任务 |

ToT提示 | 能够处理更复杂的推理任务,如规划、决策 | 实现复杂,计算成本高 | 高度复杂的推理任务,如多步规划、创意生成等 |

RAG提示 | 结合外部知识,提高内容准确性和完整性 | 需要维护知识库,增加系统复杂度 | 需要外部知识支持的任务,如知识问答、内容生成等 |

通过对比可以看出,不同的提示技术在易用性、性能、适用场景等方面各有优缺点,需要根据具体的任务需求和资源条件选择合适的提示技术。

5. 实际意义/风险/未来趋势

5.1 实际意义

- 提高LLM应用性能:提示工程能够显著提高LLM应用的性能和实用性,使LLM能够更好地理解和执行用户的指令。

- 降低LLM应用开发门槛:通过使用现有的提示模板和工具,开发者可以快速构建高质量的LLM应用,降低开发门槛。

- 拓展LLM应用场景:提示工程能够使LLM处理更复杂的任务,拓展LLM的应用场景,如复杂推理、创意生成、规划决策等。

- 减少模型微调需求:通过优化提示,能够减少对模型微调的需求,降低LLM应用的开发成本和时间。

- 提高用户体验:好的提示能够引导LLM生成更准确、有用、符合预期的内容,提高用户体验。

5.2 风险

- 提示设计依赖人工经验:高质量的提示设计依赖于人工经验和专业知识,对于复杂任务,设计有效的提示可能需要大量的时间和精力。

- 提示敏感性:LLM对提示的变化非常敏感,微小的提示变化可能导致完全不同的响应,增加了提示设计的难度。

- 提示注入风险:恶意用户可能通过精心设计的提示,诱导LLM生成有害内容或执行恶意操作,带来安全风险。

- 性能上限限制:对于某些复杂任务,仅通过提示工程可能无法达到预期的性能,需要结合模型微调或其他技术。

- 跨模型兼容性问题:不同LLM对提示的理解和响应可能存在差异,一个在某模型上表现良好的提示,在另一个模型上可能表现不佳。

5.3 未来趋势

- 自动化提示工程:自动化提示工程将成为主流,通过机器学习算法自动生成和优化提示,减少人工干预。

- 自适应提示:根据LLM的响应和用户反馈,动态调整提示,提高提示的适应性和性能。

- 多模态提示:支持多模态输入的提示,如图像、音频等,拓展LLM的多模态应用场景。

- 领域特定提示模板:针对不同领域和任务的专业化提示模板库将不断丰富,进一步降低提示工程的门槛。

- 提示与模型协同设计:提示工程将与模型设计相结合,设计专门优化特定提示格式的模型,提高提示的效果。

- 提示安全性保障:发展提示安全技术,防止提示注入和恶意使用,保障LLM应用的安全性。

6. 结论

本文深入探讨了2025年大语言模型提示工程的最新进展,从基础提示到进阶技巧,系统梳理了提示工程的关键组成部分,并提供了完整的实践指南和性能评估。

2025年,提示工程已经成为LLM应用开发的核心技能,从简单的指令提示发展到复杂的思维链、自我一致性、树状思考等高级技巧,能够处理更复杂的任务。同时,提示工程工具链不断完善,从提示设计、评估到优化的完整工具链已经形成,降低了提示工程的门槛。

同时,我们也需要关注提示工程面临的挑战,如提示设计依赖人工经验、提示敏感性、提示注入风险等。未来,随着自动化提示工程、自适应提示、多模态提示等趋势的出现,提示工程将进一步发展,推动LLM技术在更多领域的广泛应用。

参考链接:

- GitHub - google-research/chain-of-thought-prompting: Chain-of-Thought Prompting Elicits Reasoning in Large Language Models

- GitHub - princeton-nlp/tree-of-thought-llm: Tree of Thoughts: Deliberate Problem Solving with Large Language Models

- GitHub - langchain-ai/langchain: ⚡ Building applications with LLMs through composability ⚡

- GitHub - run-llama/llama_index: LlamaIndex (formerly GPT Index) is a data framework for your LLM applications

- GitHub - microsoft/promptbase: PromptBase: A library for prompt engineering

关键词: 大语言模型, 提示工程, Chain-of-Thought, Self-Consistency, Tree-of-Thought, RAG, GitHub

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-01,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录