AI终于"心中有数"!YOLO-Count让AI绘画精准理解"五个苹果"的指令

AI终于"心中有数"!YOLO-Count让AI绘画精准理解"五个苹果"的指令

AI浩

发布于 2025-08-14 15:14:36

发布于 2025-08-14 15:14:36

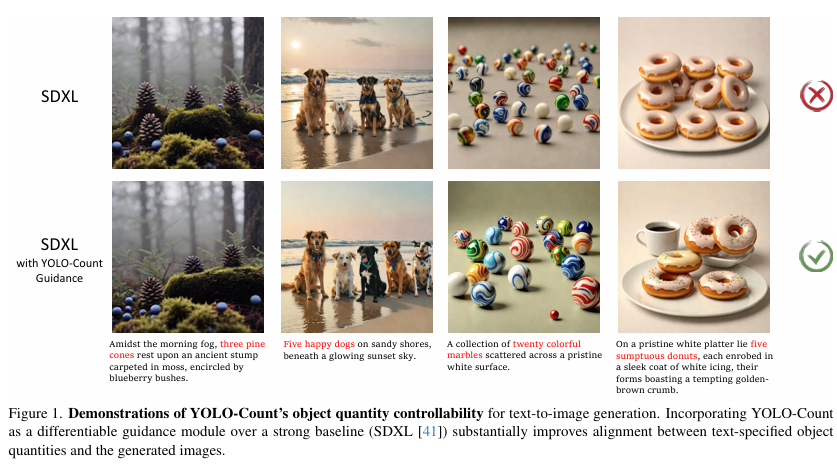

你是否曾经遇到过这样的尴尬?向AI绘画工具输入"画五个苹果",结果生成的图片里要么只有三个,要么堆满了七八个?这种数量控制不精准的问题,一直是文本到图像(T2I)生成领域的顽疾。现在,清华等研究团队提出的YOLO-Count模型,终于让AI真正"心中有数"了!

为什么AI总是数不清?

在传统AI绘画中,当模型被要求生成特定数量的物体时,往往会出现严重偏差。当提示词要求"5个苹果"时,基线模型可能生成任意数量的苹果,导致图文一致性大打折扣。 这是因为目标数量是一种全局约束,要求模型在语言标记和组合对象之间建立数字对应关系,而传统条件训练方法(如ControlNet)并不适合显式数量控制。

更麻烦的是,T2I模型中去噪过程的随机性引入了目标区分的模糊性,进一步使计数一致性复杂化。虽然现有技术能较好控制物体的位置、属性和风格,但精确控制数量却始终是个难题。

YOLO-Count:AI的"数数神器"

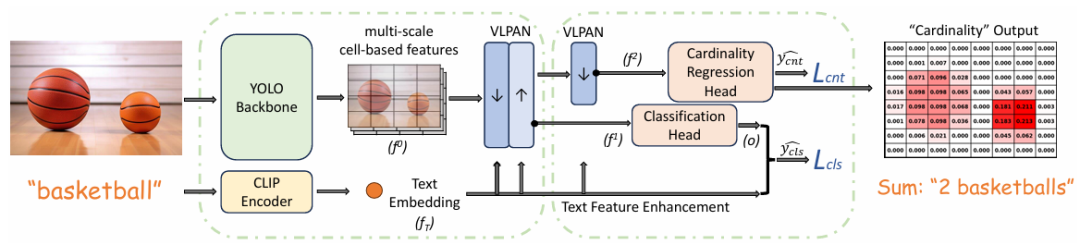

YOLO-Count是一种可微分的开放词汇目标计数模型,旨在解决通用计数挑战并实现文本到图像生成的精确数量控制。 它的核心创新在于引入了"基数图"(cardinality map)这一全新概念,彻底改变了传统计数方式。

YOLO-Count架构图

YOLO-Count架构图

传统计数模型使用"密度图",在目标中心应用高斯核来估计数量,但这种方法存在明显缺陷:高斯核的中心可以放置在目标范围内的任何位置,核半径也是任意选择的,缺乏物理意义。而YOLO-Count的"基数图"则在目标实例上均匀分布数量分数,将1个计数单位平均分配给目标的所有像素,从而提高了准确性和对尺度变化的鲁棒性。

简单来说,如果要数3只猫,传统方法可能只在猫的中心点"打分",而YOLO-Count则会让整只猫的每个像素都"贡献"一点计数,总和正好等于3。这种设计让模型对不同大小、形状的物体都能准确计数。

实战效果:从"差不多"到"刚刚好"

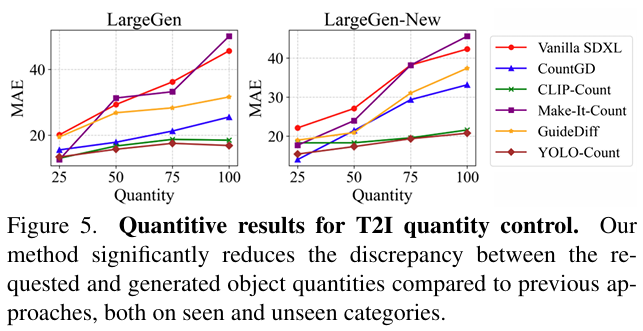

实验结果令人振奋!在LargeGen和LargeGen-New基准测试中,YOLO-Count显著降低了生成数量与提示数量之间的误差,无论是在训练过的类别还是未见过的类别上。

数量控制对比图

数量控制对比图

上图直观展示了YOLO-Count的威力:当要求生成25、50、75、100个目标时,其他方法误差很大,而YOLO-Count几乎完美匹配了目标数量。特别是对于大数量场景(如100个物体),优势更为明显。

更令人惊叹的是,YOLO-Count不仅适用于常见物体,还能处理未见过的类别。研究团队专门构建了OpenImg7-New和Obj365-New等新基准来测试这一能力,结果表明YOLO-Count在新类别上同样表现出色,真正实现了"开放词汇"计数。

技术背后:混合强-弱监督训练

YOLO-Count为何如此强大?关键在于其创新的混合强-弱监督训练策略:

- 强监督预训练:首先在LVIS等大规模实例分割数据集上预训练,利用精确的每实例掩码构建"基数图"

- 弱监督微调:然后在FSC147等计数数据集上微调,利用稀疏点级标注进行优化

这种训练方法巧妙地解决了计数数据稀缺的问题,让模型既掌握了丰富的视觉知识,又精通精确计数技巧。

训练流程图

训练流程图

未来应用:不止于AI绘画

YOLO-Count的意义远超AI绘画领域。作为支持开集通用、全可微分的物体计数模块,它能够无缝集成到各种T2I生成过程中,为"图文一致性"提供数量级别的精细控制。

想象一下这些应用场景:

- 电商产品展示:精确生成指定数量的商品图片

- 教育领域:创建包含特定数量教学元素的插图

- 游戏开发:批量生成具有精确数量元素的游戏素材

- 数据增强:为计算机视觉任务生成带精确标注的合成数据

结语

YOLO-Count的出现,标志着AI在理解数量概念上迈出了重要一步。它不仅解决了AI绘画中的数量控制难题,更为多模态生成和感知开辟了新可能。正如论文中所说,YOLO-Count"为增强文本到图像模型的可控性提供了实用且可微分的机制,从而实现更精确和可靠的多模态生成和感知"。

下次当你要求AI"画五个苹果"时,也许终于能如愿以偿了!这不仅是技术的进步,更是人机交互体验的一次质的飞跃。

❝小知识:YOLO-Count由清华大学等机构联合提出,相关论文已被ICCV 2025接收,代表了该领域的最前沿研究成果。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-08-11,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录