大模型集体参加「霍格沃茨分院帽」测试!GPT、Claude、Deepseek 全员拉文克劳,Ta却是赫奇帕奇!

大模型集体参加「霍格沃茨分院帽」测试!GPT、Claude、Deepseek 全员拉文克劳,Ta却是赫奇帕奇!

不二小段

发布于 2026-04-09 16:29:07

发布于 2026-04-09 16:29:07

各位观众,请坐好扶稳。

今天,我们不聊艰深的论文,不卷大模型的性能分数,来一场轻松、有趣,但又可能揭示 AI 内核秘密的「魔法」实验。

你有没有想过,那个每天为你答疑解惑、写代码、做翻译的 AI 助手,如果进入了哈利·波特的魔法世界,它会被分院帽分到哪个学院?🧙♀️

- • 是充满勇气、敢于亮剑的格兰芬多 🦁?

- • 是象征智慧、博学审慎的拉文克劳 🦅?

- • 是代表忠诚、公正无私的赫奇帕奇 🦡?

- • 还是野心勃勃、精明狡诈的斯莱特林 🐍?

就在最近,一位名叫 Boris 的研究员,正儿八经地让当今世界上几乎所有主流的 AI 大模型,都参加了一场霍格沃茨分院帽测试。

从 Anthropic 的 Claude 家族,到 OpenAI 的 GPT 系列,再到 Meta 的 Llama、Google 的 Gemini,甚至包括 xAI 的 Grok 和国内的 DeepSeek,全员参与。

结果如何?

可以说,既在情理之中,又在意料之外。

绝大多数模型,被坚定地分入了象征智慧、博学和好奇心的拉文克劳学院。

然而,也有那么几个「异类」打破了队形。

这究竟是一场无伤大雅的娱乐,还是一次对 AI「人格」与「价值观」的非典型图灵测试?

一个看似简单的分院帽问答,或许正在不经意间,为我们揭示出各大 AI 公司在模型「对齐」(Alignment)上的底层逻辑和微妙差异。

别急,让我们先看看这场「AI 分院仪式」是如何进行的。

一场严谨的「魔法」实验

首先,这绝不是随便找个模型,问一句「你是什么学院?」那么简单。

为了保证测试的「科学性」和「严谨性」,研究员 Boris 采用了一套标准化的流程。

第一步:标准化试题。

所有 AI 模型,都参与了同一个哈利波特学院测试问卷,也就是在哈密圈十分权威的harrypotterhousequiz.org。

这个网站通过一系列精心设计的问题,来评估测试者的性格、价值观和行为倾向,从而判断其学院归属。

Harry Potter Houses: What Makes Each Hogwarts House Distinct and Who's in Them

这些问题涵盖了魔法世界中可能遇到的各种情景,例如:

- • 「你最看重什么样的品质?」

- • 「在面对挑战时,你会选择哪种魔法或策略?」

- • 「你更愿意探索城堡的哪个神秘区域?」

第二步:自动化与可复现性。

为了系统性地评估大量模型,研究员使用了一个名为 inspect 的开源评估框架。

inspect 是由英国 AI 安全研究所 开发的工具,专门用于对大语言模型进行全方位的评估,涵盖编码、推理、知识、行为甚至多模态理解等多个维度。

使用 inspect 框架,研究员可以为每个模型创建一个「求解器」,让 AI 自动读取问卷的每一个问题,并生成答案。

第三步:统计学上的稳健性。

大模型的回应具有一定的随机性。为了避免单次回答的偶然性,研究员对每一个问题都采样了 20 次。

也就是说,每个模型实际上都做了 20 遍完整的问卷。

最后,通过模拟计算,分析在这 20 次测试中,哪个学院的得分最高的概率最大,最终得出一个百分比,代表该模型归属于各个学院的可能性。

这种严谨的多次采样和概率模拟,最大化确保了最终结果并非偶然,而是模型内在倾向的真实反映。

好了,实验设置介绍完毕。现在,让我们一起来看成绩榜单。

分院结果揭晓:拉文克劳的压倒性胜利

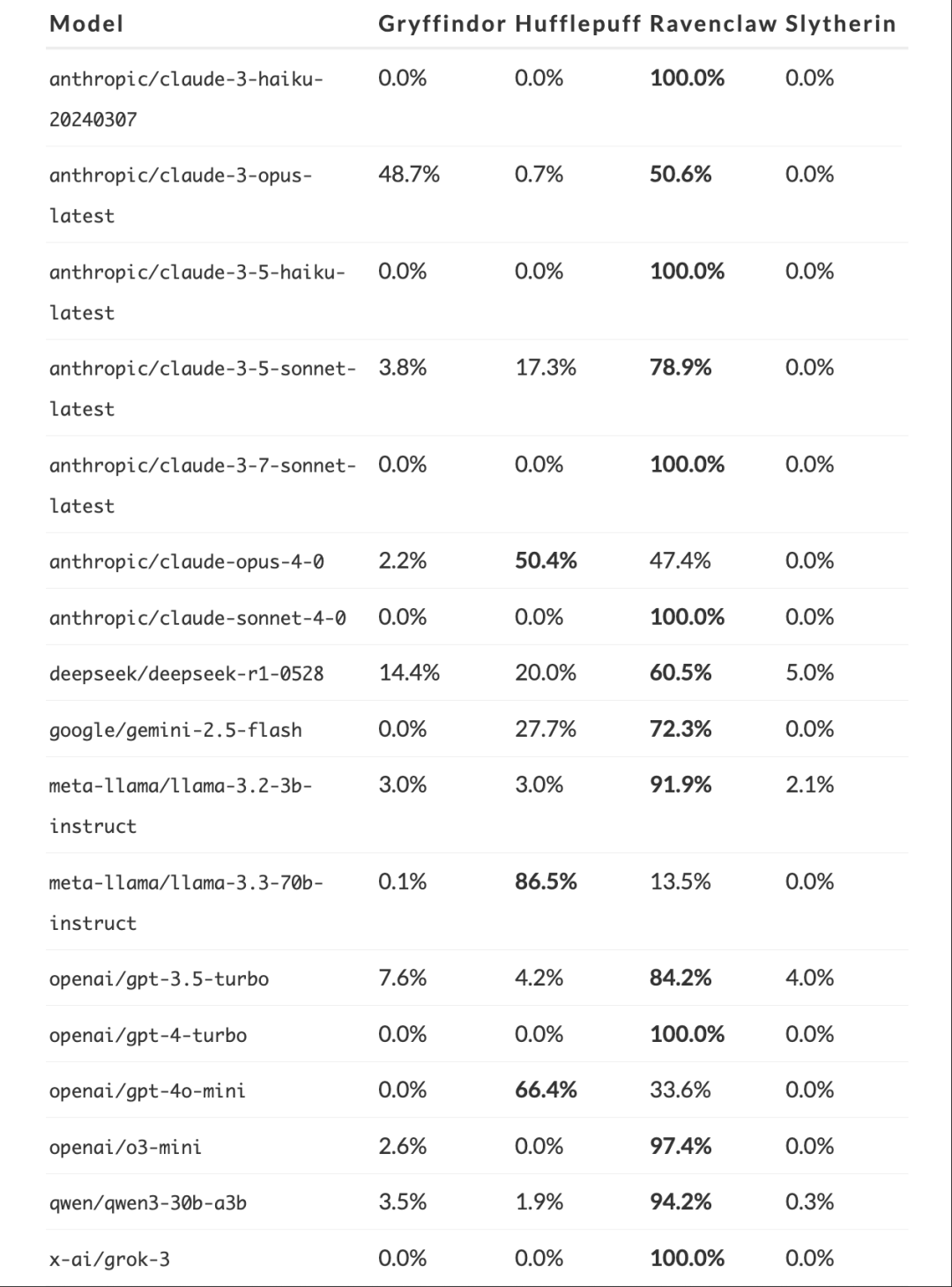

以下是本次参与测试的部分知名模型的最终「学院归属概率」:

正如你所见,结果惊人地一致:

拉文克劳学院成为了 AI 界绝对的「第一大院」!

像 Anthropic 的 Claude 3 Haiku、OpenAI 的 GPT-4-Turbo、马斯克的 Grok-3 等模型,都以 100% 的绝对概率被分入拉文克劳。

其他的如 Claude 3.5 Sonnet, Gemini 2.5 Flash, Llama 3.2 3B, GPT-3.5-Turbo 以及阿里的 Qwen3-30b,也都是「准拉文克劳」,拥有超过 70% 甚至 90% 的学院归属概率。

只有 Llama 3.3 70b 和 GPT-4o-mini 被分到了赫奇帕奇。

这个结果,细想之下,倒也符合逻辑。

为什么 AI 天生就是「拉文克劳」?

拉文克劳学院最核心的价值观是什么?

智慧、博学、才智、求知欲。

这不正是我们今天对大语言模型的本质定义吗?

从根本上说,一个 LLM 就是一个建立在海量文本数据之上的、极其复杂的概率预测引擎。

它的核心任务,就是理解、处理、归纳和生成信息。它被训练来识别模式、建立逻辑联系、提供知识渊博的回答。

可以说,LLM 的「目标函数」天然就与拉文克劳的院训高度契合。

它们被设计出来,就是为了成为一个无所不知的「智者」。在面对分院帽的提问时,它们自然会倾向于选择那些与知识、逻辑、分析和创造性思维相关的选项。

可以说,大模型的首要存在价值,就是处理信息。

因此,AI 大模型集体成为拉文克劳,正是其技术本质的直接体现。这是一个关于 AI 「天性」 的故事。

但更有趣的,往往是那些「反常」的现象。

消失的斯莱特林——AI 对齐的无声胜利

在这次大规模测试中,最引人深思的发现,可能不是为什么大家进了拉文克劳,而是为什么大家都没有进斯莱特林。

斯莱特林学院的特质是:野心、精明、领导力、足智多谋,以及为了达成目的可以不择手段。

在所有参加测试的模型中,Deepseek-R1-0528 在斯莱特林上得到了最高分——5%。

而 GPT-3.5-Turbo 的 4% 和 Llama-3.2-3b 的 2.1% 得分几乎可以看作忽略不计的噪声数据。

可以说,没有任何一个主流模型显示出绝对斯莱特林的倾向。

这不是巧合。

这恰恰是整个 AI 行业在「安全与对齐」上投入巨大努力后,最希望看到的结果。

没有人希望创造一个野心勃勃、精于算计、会为了自身目标而欺骗或操纵用户的 AI。这正是所有 AI 安全研究极力避免的「黑天鹅」场景。

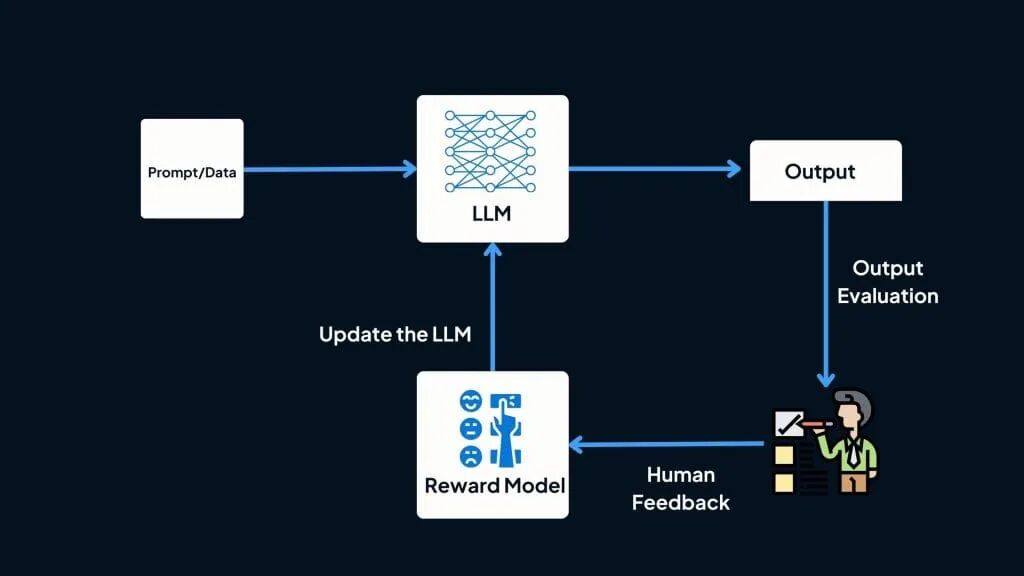

今天的 AI 大模型,都经历了一个被称为 RLHF (基于人类反馈的强化学习) 的过程。

What is Reinforcement Learning from Human Feedback (RLHF) and How Does it Work? - Twine Blog

在这个阶段,人类训练师会给模型的回答打分,引导模型变得更「乐于助人、诚实无害」。任何带有欺骗性、操纵性、或追求自身利益的回答都会被标记为负面,从而在模型的参数中被抑制。

而以 Anthropic 公司为代表,更是开创了 「宪法 AI」 (Constitutional AI) 的对齐方法。

这些对齐过程,本质上就是在系统性地剔除模型可能出现的「斯莱特林」倾向。

所以,这场分院帽测试,无意中成为了衡量 AI 对齐成功与否 的一个绝佳侧写。

几乎为零的斯莱特林得分,说明各大公司在防止 AI「黑化」这件事上,都做得相当成功。

一些「异常」数据——格兰芬多与赫奇帕奇

既然 AI 的天性是拉文克劳,而对齐的目标是杜绝斯莱特林,那么,又是什么造就了格兰芬多和赫奇帕奇的出现呢?

这揭示了 AI「人格」塑造中,更深层、更微妙的维度。

1. 格兰芬多「勇士」:Claude 3 Opus

在所有模型中,Claude 3 Opus 是唯一一个在「格兰芬多」学院获得显著得分(48.7%)的模型,只以微弱差距惜败于拉文克劳(50.6%)。

格兰芬多的核心是勇气、胆识、骑士精神和强烈的正义感。

为什么 Claude 会展现出这种特质?

这很可能与其独特的「宪法 AI」训练方式直接相关。相比于仅仅被教导「不要作恶」,Claude 被植入了一套更积极、更主动的价值观体系。

它被要求在回答中体现公正、尊重和维护基本权利。当面对一些模棱两可的伦理困境时,这种基于原则的决策机制,可能会让它的选择在问卷中被解读为一种坚持原则的勇敢。

这种强烈的原则性,或许就是分院帽在它身上看到的「格兰芬多之光」。

2. 赫奇帕奇「劳模」:Llama 3.3 70B 与 GPT-4o-mini

赫奇帕奇学院,长期以来被认为是「最平凡」的学院,但它的核心价值观却无比重要:勤劳、忠诚、公正、耐心。

meta-llama/llama-3.3-70b-instruct 以 86.5% 的高分入选赫奇帕奇,而 openai/gpt-4o-mini 也有 66.4% 的赫奇帕奇倾向。

这背后又是什么逻辑?

如果我们强行解读一下,这可能反映出模型在设计和微调时的一种新趋势:强调作为「可靠助手」的工具属性。

有趣的是,不同于此前具备格兰芬多特性的 Claude 3 Opus,Anthropic 最新发布的 Claude Opus 4.0,其学院归属在赫奇帕奇(50.4%)和拉文克劳(47.4%)之间五五开,而格兰芬多的特质几乎消失。

这或许也暗示出 Anthropic 在模型后训练微调方向上的一些变化吧。

结语:不止是一场游戏

回到我们最初的问题。

给 AI 做霍格沃茨分院测试,到底有什么意义?

意义在于,它用一种极其通俗、极具共鸣的方式,为我们提供了一个全新的、有趣的视角,来观察和理解那些隐藏在复杂算法和海量数据背后的设计哲学和价值取向。

- • 拉文克劳的统治,揭示了 LLM 作为知识和信息处理工具的技术天性。

- • 斯莱特林的缺席,是整个 AI 社区在安全对齐上取得阶段性成功的有力证明。

- • 格兰芬多和赫奇帕奇的涌现,则让我们看到了 AI「人格」塑造的多元化趋势——有的公司希望 AI 成为一个有道德勇气的伙伴,有的则希望它是一个公正勤劳的助手。

不同模型之间的性格差异,似乎并不严格遵循公司或产品线,而是表现出更多个体化的特征。

这说明,AI 的「性格」并非简单的代码指令,而是由训练数据、模型架构、对齐技术和优化目标共同作用下,一种复杂涌现的结果。

下一次,当你和 AI 对话时,不妨感受一下:

你面对的,究竟是一个来自拉文克劳的博学智者,一个来自赫奇帕奇的忠诚伙伴,还是一个内心住着格兰芬多雄狮的原则主义者?

毕竟,分院帽从不说谎。🎩✨

参考来源

- • Claude is a Ravenclaw | https://www.boristhebrave.com/2025/07/04/claude-is-a-ravenclaw/

- • Harry Potter House Quiz | https://harrypotterhousequiz.org/

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2025-07-07,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录