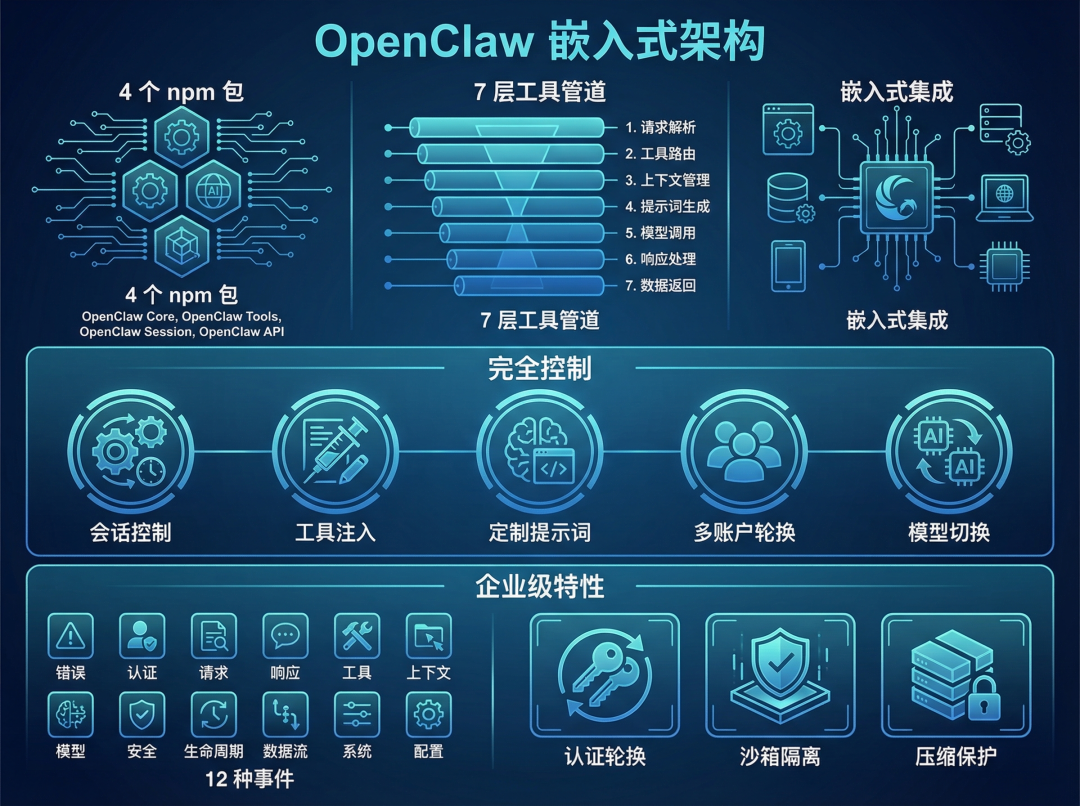

OpenClaw 嵌入式集成架构核心 Pi:4 个包 + 7 层管道,让 AI Agent 完全受控

OpenClaw 嵌入式集成架构核心 Pi:4 个包 + 7 层管道,让 AI Agent 完全受控

运维有术

发布于 2026-04-01 19:56:53

发布于 2026-04-01 19:56:53

🚩 2026 年「术哥无界」系列实战文档 X 篇原创计划 第 59 篇,OpenClaw 最佳实战「2026」系列第 29 篇 大家好,欢迎来到 术哥无界 | ShugeX | 运维有术。 我是术哥,一名专注于 AI 编程、AI 智能体、Agent Skills、MCP、云原生、AIOps、Milvus 向量数据库的技术实践者与开源布道者! Talk is cheap, let's explore。无界探索,有术而行。

OpenClaw 是 2026 年最火爆的现象级 AI 开源项目。这个 2025 年 11 月才发布的开源项目,GitHub Star 数已经突破 32 万+ Star。它的定位很简单:你的个人 AI 助手,可以在任何平台上用。

但翻了一圈官方文档后,我发现它有意思的地方不在"能做什么",而在怎么做到的。

大多数 AI 助手方案会用子进程或 RPC 调用一个独立的 Agent 进程——简单,但控制力有限。OpenClaw 选了另一条路:直接把 pi-coding-agent 的代码嵌入到自己的消息网关里。

这意味着什么?完全的会话生命周期控制、自定义工具注入、按渠道定制系统提示词、多账户认证轮换、提供商无关的模型切换……这些都是子进程/RPC 方案很难做到的。

今天来拆解一下这套嵌入式架构。

1. 为什么用嵌入式而不是 RPC

先说一个数字:OpenClaw 直接依赖了 4 个 pi 相关的 npm 包。

图 1:四大模块化包的依赖关系

包名 | 版本 | 职责 |

|---|---|---|

@mariozechner/pi-ai | 0.49.3 | 核心 LLM 抽象:Model、streamSimple、消息类型、提供商 API |

@mariozechner/pi-agent-core | 0.49.3 | Agent 循环、工具执行、AgentMessage 类型 |

@mariozechner/pi-coding-agent | 0.49.3 | 高级 SDK:createAgentSession、SessionManager、AuthStorage、ModelRegistry |

@mariozechner/pi-tui | 0.49.3 | 终端 UI 组件(OpenClaw 本地 TUI 模式使用) |

官方文档对嵌入式架构的描述很直接(来源:https://docs.openclaw.ai/pi):

Instead of spawning pi as a subprocess or using RPC mode, OpenClaw directly imports and instantiates pi's AgentSession via createAgentSession(). This embedded approach provides full control over session lifecycle and event handling.

翻译过来就是:不启动子进程,不用 RPC,直接导入 SDK,实例化 AgentSession。

1.1 嵌入式 vs 子进程/RPC:关键差异

官方文档给了一个对比表,列出了 Pi CLI(独立进程)和 OpenClaw Embedded(嵌入式)的差异:

方面 | Pi CLI | OpenClaw Embedded |

|---|---|---|

调用方式 | pi 命令 / RPC | SDK via createAgentSession() |

工具 | 默认编码工具 | 自定义 OpenClaw 工具套件 |

系统提示 | AGENTS.md + prompts | 动态按渠道/上下文定制 |

会话存储 | ~/.pi/agent/sessions/ | ~/.openclaw/agents/<agentId>/sessions/ |

认证 | 单一凭据 | 多配置文件轮换 |

扩展 | 从磁盘加载 | 程序化 + 磁盘路径 |

事件处理 | TUI 渲染 | 基于回调(onBlockReply 等) |

说实话,嵌入式架构复杂度更高。但换来的是对 Agent 行为的完全控制——这在构建一个多渠道、多账户、多模型的 AI 助手时,是必需的。

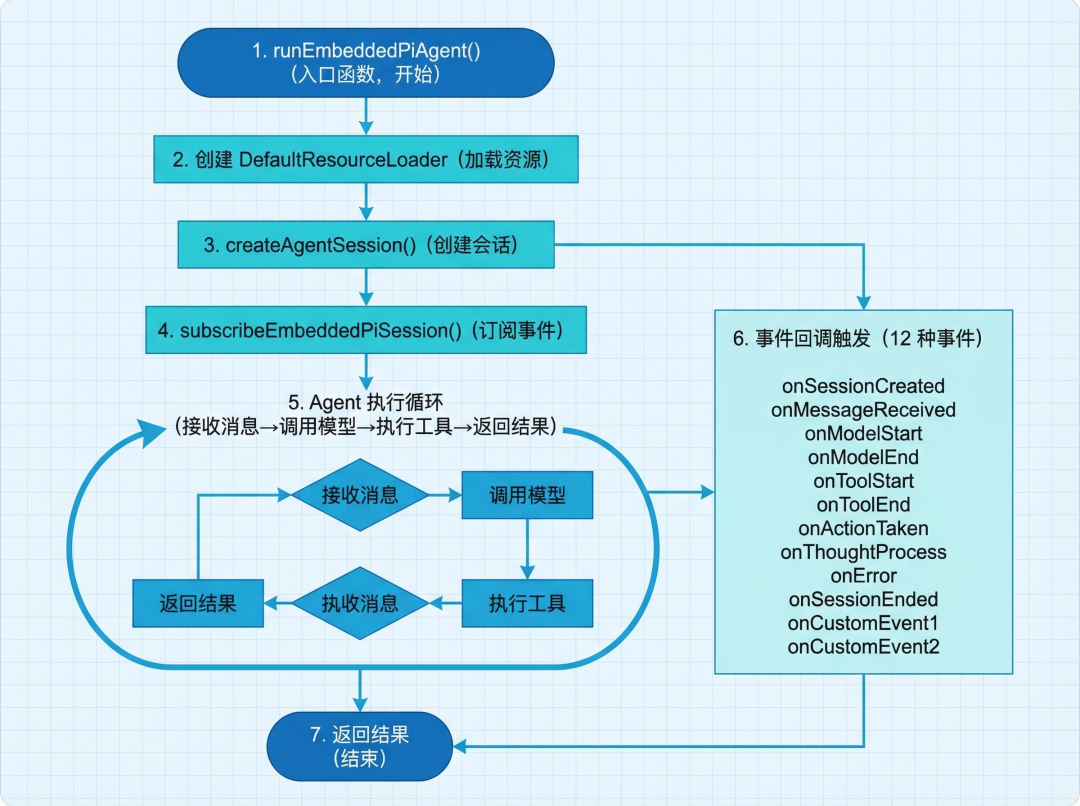

2. 核心集成流程拆解

整个集成流程分三步:运行嵌入式 Agent → 创建会话 → 订阅事件。

图 2:Agent 会话创建与执行流程

2.1 主入口:runEmbeddedPiAgent()

入口函数 runEmbeddedPiAgent() 定义在 src/agents/pi-embedded-runner/run.ts。调用方式如下:

import { runEmbeddedPiAgent } from"./agents/pi-embedded-runner.js";

const result = await runEmbeddedPiAgent({

sessionId: "user-123",

sessionKey: "main:whatsapp:+1234567890",

sessionFile: "/path/to/session.jsonl",

workspaceDir: "/path/to/workspace",

config: openclawConfig,

prompt: "Hello, how are you?",

provider: "anthropic",

model: "claude-sonnet-4-20250514",

timeoutMs: 120_000,

runId: "run-abc",

onBlockReply: async (payload) => {

await sendToChannel(payload.text, payload.mediaUrls);

},

});

参数说明:

sessionId:用户标识sessionKey:会话键(格式:main:<渠道>:<标识>)sessionFile:会话持久化文件路径(JSONL 格式)workspaceDir:工作空间目录provider/model:模型提供商和模型 IDonBlockReply:阻塞式回复回调

2.2 创建会话:createAgentSession()

会话创建使用 pi SDK 提供的 createAgentSession():

import {

createAgentSession,

DefaultResourceLoader,

SessionManager,

SettingsManager,

} from"@mariozechner/pi-coding-agent";

const resourceLoader = new DefaultResourceLoader({

cwd: resolvedWorkspace,

agentDir,

settingsManager,

additionalExtensionPaths,

});

await resourceLoader.reload();

const { session } = await createAgentSession({

cwd: resolvedWorkspace,

agentDir,

authStorage: params.authStorage,

modelRegistry: params.modelRegistry,

model: params.model,

thinkingLevel: mapThinkingLevel(params.thinkLevel),

tools: builtInTools,

customTools: allCustomTools,

sessionManager,

settingsManager,

resourceLoader,

});

这里有几个关键点:

DefaultResourceLoader负责加载资源和扩展createAgentSession()接收工具列表(内置 + 自定义)thinkingLevel会被映射到提供商对应的参数

2.3 订阅事件:subscribeEmbeddedPiSession()

会话创建后,通过 subscribeEmbeddedPiSession() 订阅事件:

const subscription = subscribeEmbeddedPiSession({

session: activeSession,

runId: params.runId,

verboseLevel: params.verboseLevel,

reasoningMode: params.reasoningLevel,

toolResultFormat: params.toolResultFormat,

onToolResult: params.onToolResult,

onReasoningStream: params.onReasoningStream,

onBlockReply: params.onBlockReply,

onPartialReply: params.onPartialReply,

onAgentEvent: params.onAgentEvent,

});

支持的事件类型有 12 种:

message_start/message_end/message_update:流式文本/思考tool_execution_start/tool_execution_update/tool_execution_end:工具执行turn_start/turn_end:对话轮次agent_start/agent_end:Agent 生命周期auto_compaction_start/auto_compaction_end:自动压缩

你在项目中用过类似的回调订阅机制吗?欢迎在评论区聊聊。

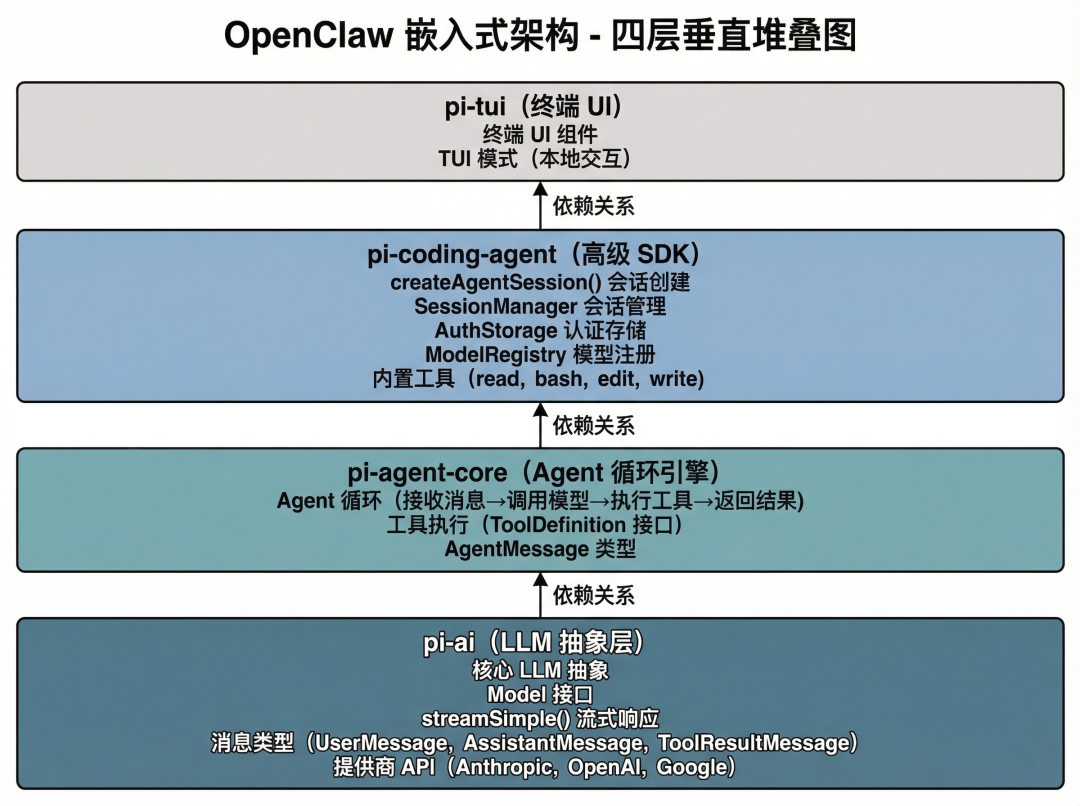

3. 四大包的职责分工

理解这四个包的分工,是理解整个架构的关键。

3.1 pi-ai:LLM 抽象层

pi-ai 是最底层,提供:

Model接口:统一的模型抽象streamSimple():流式响应处理- 消息类型:

UserMessage、AssistantMessage、ToolResultMessage等 - 提供商 API:Anthropic、OpenAI、Google 等的适配器

这层的设计目标是提供商无关——上层代码不需要关心具体是哪个模型。

3.2 pi-agent-core:Agent 循环引擎

pi-agent-core 负责:

- Agent 循环:接收消息 → 调用模型 → 执行工具 → 返回结果

- 工具执行:

ToolDefinition接口和执行逻辑 AgentMessage类型:Agent 产生的各类消息

这层是 Agent 的"大脑",处理推理和工具调用。

3.3 pi-coding-agent:高级 SDK

pi-coding-agent 是面向开发者的 SDK:

createAgentSession():会话创建入口SessionManager:会话持久化管理AuthStorage:认证凭据存储ModelRegistry:模型注册和查找- 内置工具:read、bash、edit、write 等编码工具

OpenClaw 主要使用这个包的 API。

3.4 pi-tui:终端 UI 组件

pi-tui 提供终端交互界面组件。OpenClaw 在本地 TUI 模式下会使用这些组件:

// src/tui/tui.ts

import { ... } from "@mariozechner/pi-tui";

这提供了一个类似 pi 原生模式的交互式终端体验。

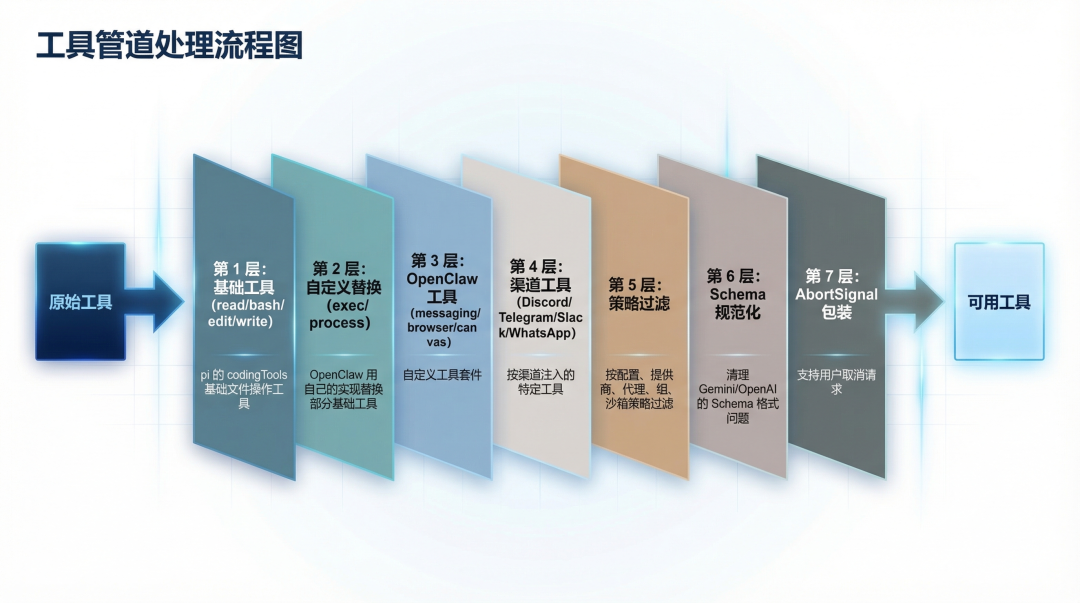

4. 7 层工具管道解析

这是整个架构中最有意思的部分。

图 3:7 层工具管道处理流程

工具在到达 Agent 之前,要经过 7 层处理:

4.1 第 1 层:基础工具

pi 的 codingTools:read、bash、edit、write。这是 Agent 操作文件系统的基本能力。

4.2 第 2 层:自定义替换

OpenClaw 用自己的实现替换部分基础工具:

exec/process替换 bash(为了沙箱隔离)- 自定义 read/edit/write(路径限制和权限控制)

4.3 第 3 层:OpenClaw 工具

OpenClaw 自定义的工具套件:

messaging:发送消息browser:浏览器操作canvas:画布工具sessions:会话管理cron:定时任务gateway:消息网关

4.4 第 4 层:渠道工具

按渠道注入特定工具:

- Discord 特定操作

- Telegram 特定操作

- Slack 特定操作

- WhatsApp 特定操作

4.5 第 5 层:策略过滤

按配置文件、提供商、代理、组、沙箱策略过滤工具。某些工具只在特定场景下可用。

4.6 第 6 层:Schema 规范化

清理 Gemini/OpenAI 的 Schema 怪异问题。不同提供商的 JSON Schema 支持有差异,这层负责统一。

4.7 第 7 层:AbortSignal 包装

工具包装以响应中止信号。用户取消请求时,正在执行的工具需要能被中断。

4.8 工具定义适配器

toToolDefinitions() 函数负责将 pi 工具转换为统一格式:

export function toToolDefinitions(tools: AnyAgentTool[]): ToolDefinition[] {

return tools.map((tool) => ({

name: tool.name,

label: tool.label ?? name,

description: tool.description ?? "",

parameters: tool.parameters,

execute: async (toolCallId, params, onUpdate, _ctx, signal) => {

// pi-coding-agent signature differs from pi-agent-core

return await tool.execute(toolCallId, params, signal, onUpdate);

},

}));

}

5. 认证轮换与故障转移

多账户支持是企业级部署的刚需。OpenClaw 的认证系统设计得比较完善。

5.1 认证配置存储

每个提供商维护多个 API 密钥的配置存储:

const authStore = ensureAuthProfileStore(agentDir, { allowKeychainPrompt: false });

const profileOrder = resolveAuthProfileOrder({ cfg, store: authStore, provider, preferredProfile });

5.2 故障自动转移

配置文件在失败时自动轮换,并跟踪冷却时间:

await markAuthProfileFailure({ store, profileId, reason, cfg, agentDir });

const rotated = await advanceAuthProfile();

当检测到需要故障转移的错误时,抛出 FailoverError:

if (fallbackConfigured && isFailoverErrorMessage(errorText)) {

throw new FailoverError(errorText, {

reason: promptFailoverReason ?? "unknown",

provider,

model: modelId,

profileId,

status: resolveFailoverStatus(promptFailoverReason),

});

}

5.3 错误分类

系统会自动分类错误类型:

isContextOverflowError(errorText) // 上下文太大

isCompactionFailureError(errorText) // 压缩失败

isAuthAssistantError(lastAssistant) // 认证失败

isRateLimitAssistantError(...) // 速率限制

isFailoverAssistantError(...) // 应该故障转移

classifyFailoverReason(errorText) // "auth" | "rate_limit" | "quota" | "timeout" | ...

5.4 思考级别降级

某些错误会触发思考级别自动降级:

const fallbackThinking = pickFallbackThinkingLevel({

message: errorText,

attempted: attemptedThinking,

});

if (fallbackThinking) {

thinkLevel = fallbackThinking;

continue;

}

6. 扩展机制:压缩保护与上下文修剪

OpenClaw 实现了两个重要的 pi 扩展。

6.1 压缩保护(Compaction Safeguard)

当会话历史过长时,系统会自动压缩以适应上下文窗口。但压缩可能导致重要信息丢失。

压缩保护扩展通过 maxHistoryShare 参数控制压缩行为:

if (resolveCompactionMode(params.cfg) === "safeguard") {

setCompactionSafeguardRuntime(params.sessionManager, { maxHistoryShare });

paths.push(resolvePiExtensionPath("compaction-safeguard"));

}

6.2 上下文修剪(Context Pruning)

基于缓存 TTL 的上下文修剪扩展:

if (cfg?.agents?.defaults?.contextPruning?.mode === "cache-ttl") {

setContextPruningRuntime(params.sessionManager, {

settings,

contextWindowTokens,

isToolPrunable,

lastCacheTouchAt,

});

paths.push(resolvePiExtensionPath("context-pruning"));

}

这层的逻辑是:如果某些工具调用结果已经缓存很久没用,可以从上下文中移除,腾出空间。

7. 提供商特定处理

不同 LLM 提供商的行为差异,OpenClaw 都做了适配。

7.1 Anthropic

- 拒绝魔法字符串清理

- 轮次验证连续角色

- Claude Code 参数兼容性

7.2 Google/Gemini

- 轮次排序修复:

applyGoogleTurnOrderingFix() - 工具 Schema 清理:

sanitizeToolsForGoogle() - 会话历史清理:

sanitizeSessionHistory()

7.3 OpenAI

- Codex 模型的

apply_patch工具 - 思考级别降级处理(OpenAI 不支持 extended thinking)

8. 沙箱集成与 TUI 模式

8.1 沙箱模式

启用沙箱时,工具和路径受限:

const sandbox = await resolveSandboxContext({

config: params.config,

sessionKey: sandboxSessionKey,

workspaceDir: resolvedWorkspace,

});

if (sandboxRoot) {

// 使用沙箱化的 read/edit/write 工具

// Exec 在容器中运行

// Browser 使用桥接 URL

}

沙箱隔离了 Agent 对文件系统的访问,适合多租户场景。

8.2 TUI 模式

OpenClaw 还有一个本地 TUI 模式,直接使用 pi-tui 组件。这提供了一个类似原生 pi 的交互式终端体验。

9. 文件结构一览

官方文档给出了完整的文件结构(来源:https://docs.openclaw.ai/pi):

src/agents/

├── pi-embedded-runner.ts # 从 pi-embedded-runner/ 重新导出

├── pi-embedded-runner/

│ ├── run.ts # 主入口: runEmbeddedPiAgent()

│ ├── run/

│ │ ├── attempt.ts # 单次尝试逻辑与会话设置

│ │ ├── params.ts # RunEmbeddedPiAgentParams 类型

│ │ ├── payloads.ts # 从运行结果构建响应负载

│ │ ├── images.ts # 视觉模型图像注入

│ │ └── types.ts # EmbeddedRunAttemptResult

│ ├── abort.ts # 中止错误检测

│ ├── cache-ttl.ts # 上下文修剪的缓存 TTL 跟踪

│ ├── compact.ts # 手动/自动压缩逻辑

│ ├── extensions.ts # 为嵌入式运行加载 pi 扩展

│ ├── session-manager-cache.ts # SessionManager 实例缓存

│ ├── session-manager-init.ts # 会话文件初始化

│ ├── system-prompt.ts # 系统提示构建器

│ ├── tool-split.ts # 将工具分为 builtIn vs custom

│ └── ...

├── pi-embedded-subscribe.ts # 会话事件订阅/分发

├── pi-tools.ts # createOpenClawCodingTools()

├── pi-settings.ts # 设置覆盖

├── pi-extensions/ # 自定义 pi 扩展

│ ├── compaction-safeguard.ts # 保护扩展

│ └── context-pruning.ts # 缓存-TTL 上下文修剪扩展

├── auth-profiles.ts # 配置存储、冷却、故障转移

├── model-selection.ts # 默认模型解析

├── system-prompt.ts # buildAgentSystemPrompt()

├── sandbox.ts # 沙箱上下文解析

├── channel-tools.ts # 渠道特定工具注入

└── tools/ # 单独工具实现

├── browser-tool.ts

├── canvas-tool.ts

├── cron-tool.ts

└── ...

从这个结构可以看出,嵌入式架构的复杂度确实不低。但也正是因为这种设计,OpenClaw 才能实现对 Agent 行为的精细控制。

总结

嵌入式架构是对传统 AI 助手集成方式的一次反直觉选择:更复杂,但换来的是完全的控制权。

核心要点:

- 4 个包:pi-ai(LLM 抽象)、pi-agent-core(Agent 循环)、pi-coding-agent(SDK)、pi-tui(终端 UI)

- 7 层工具管道:从基础工具到 AbortSignal 包装,层层处理

- 12 种事件类型:从消息流到工具执行,全程可订阅

- 企业级特性:多账户认证轮换、故障自动转移、沙箱隔离、扩展机制

如果你正在设计一个需要精细控制 Agent 行为的系统,这套架构值得参考。但如果你只是想快速集成一个 AI 助手,子进程或 RPC 可能更简单。

如果你对这套架构有疑问或者有类似的设计经验,欢迎在评论区讨论。

好啦,谢谢你观看我的文章,如果喜欢可以点赞转发给需要的朋友,我们下一期再见!敬请期待!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-21,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录