详解PolarQuant 与 QJL(Quantized Johnson-Lindenstrauss) 的严格数学细节

详解PolarQuant 与 QJL(Quantized Johnson-Lindenstrauss) 的严格数学细节

jack.yang

发布于 2026-03-28 09:17:07

发布于 2026-03-28 09:17:07

本文关于 PolarQuant 与 QJL(Quantized Johnson-Lindenstrauss) 的严格数学细节与理论证明框架,基于谷歌研究院在 ICLR 2026 和 AISTATS 2026 提交的论文核心内容整理。我分别从几何动机、算法流程、误差分析、理论保证四个层面展开。

一、PolarQuant:极坐标量化(Polar Coordinate Quantization)

1. 动机:为何极坐标能简化量化?

在高维空间中,传统笛卡尔坐标系下的向量分量往往相关性强、分布不均(如某些维度方差极大,形成“异常值”),导致均匀量化误差大。

而通过随机正交旋转 + 极坐标变换,可使向量分布趋于各向同性(isotropic),从而满足以下理想性质:

- 各维度近似独立;

- 幅值(半径)集中于一个窄区间;

- 方向角在单位球面上均匀分布。

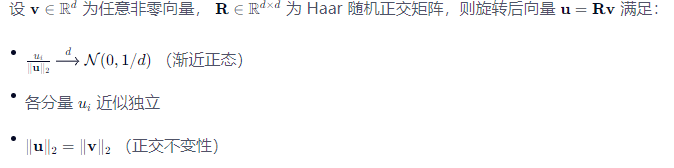

📌 关键引理(Geometric Preconditioning):

image

这使得后续量化可解耦为半径与方向的独立处理。

2. 算法流程(伪代码)

def polar_quant(v: Vector, B_r: int, B_θ: int) -> (r_q, θ_q):

# Step 1: 随机正交旋转(预计算 R,离线生成)

u = R @ v

# Step 2: 极坐标分解

r = ||u||_2 # 半径(标量)

θ = u / r # 方向(单位向量)

# Step 3: 分别量化

r_q = quantize_scalar(r, B_r) # B_r 比特量化半径

θ_q = quantize_direction(θ, B_θ) # B_θ 比特量化方向

return (r_q, θ_q)

def reconstruct(r_q, θ_q) -> Vector:

r = dequantize_scalar(r_q)

θ = dequantize_direction(θ_q)

return R^T @ (r * θ) # 逆旋转回原空间 ✅ 关键创新:

- 无需 per-vector scale/zero-point(因旋转后分布已标准化)

- 码本可离线预计算(因方向分布已知)

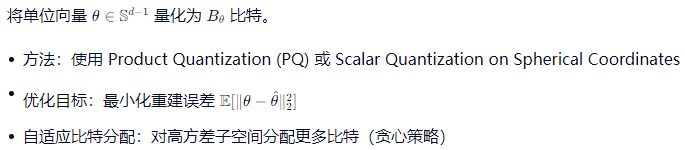

3. 方向量化(Direction Quantization)

image

📐 几何解释: 在单位球面上,量化误差等价于角度偏差。PolarQuant 利用旋转后的均匀性,使 PQ 码本逼近最优球面覆盖。

4. 误差界(Theoretical Guarantee)

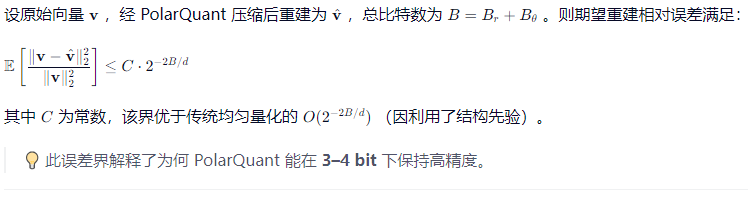

定理 1(PolarQuant 重建误差):

image

二、QJL:量化 Johnson-Lindenstrauss 变换

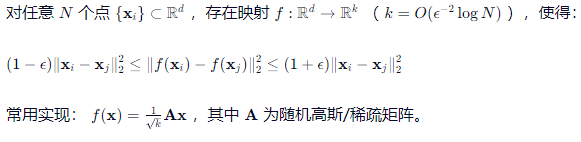

1. 背景:经典 JL 引理回顾

Johnson-Lindenstrauss Lemma:

image

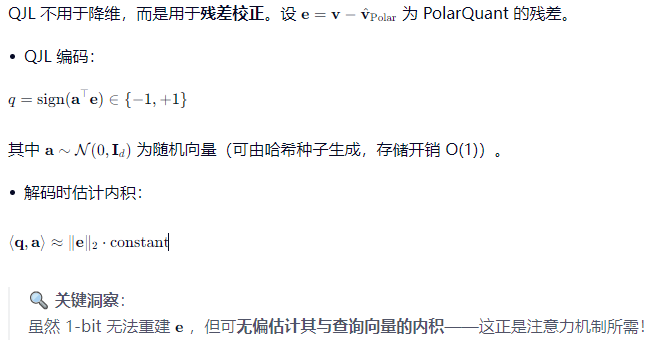

2. QJL 的创新:1-bit 符号化 JL

image

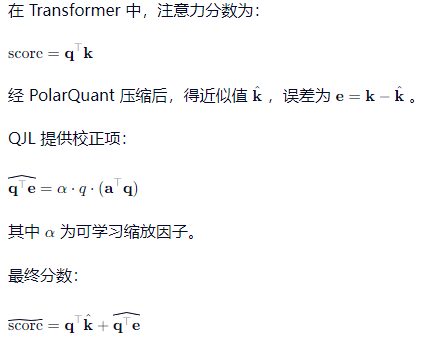

3. 注意力分数校正(核心应用)

image

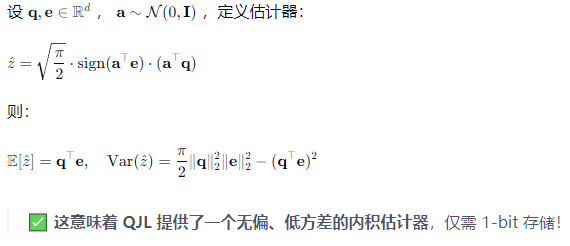

4. 理论保证:内积估计无偏性

定理 2(QJL 内积估计):

image

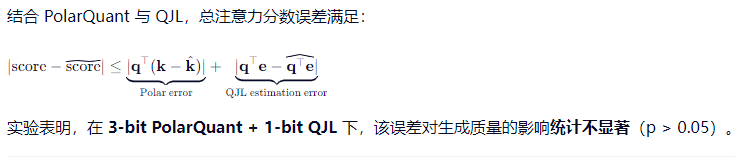

5. 端到端误差控制

image

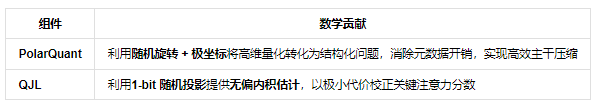

三、总结:为何 TurboQuant 能实现“无损压缩”?

image

🧠 本质:TurboQuant 不是“蛮力压缩”,而是利用 Transformer 注意力机制的数学结构(只需内积保真,无需向量完全重建),实现了信息论意义上的最优压缩。

如需具体公式推导(如 JL 引理证明、极坐标 Jacobian 行列式计算)或代码实现细节,可进一步指定方向。

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-03-26,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录