给OpenClaw装上“外挂大脑”MemMachine后,记性翻倍,Token砍半

给OpenClaw装上“外挂大脑”MemMachine后,记性翻倍,Token砍半

Henry Zhang

发布于 2026-03-06 10:51:46

发布于 2026-03-06 10:51:46

题图摄于旧金山国际机场

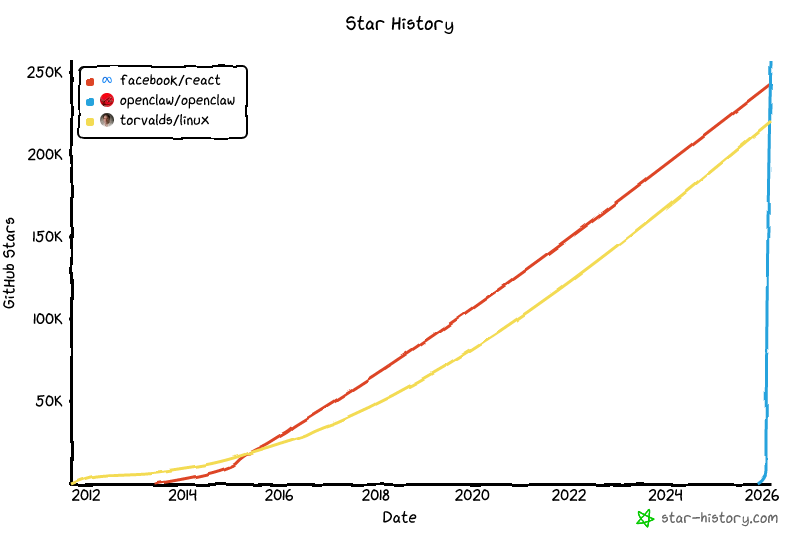

作为一名长期关注 AI 领域的从业者,我有幸见证了 OpenClaw 的崛起。该项目由 Peter Steinberger 从个人项目起步,短短数月内在 GitHub 上获得超过 20 多万颗星,其增长速度惊人,一举超越具有多年积累的 React 与 Linux 内核,成为开源史上星标数量最高的项目(可以近似理解成最多人喜爱)。

Star History Chart

图片来源:https://www.star-history.com/blog/openclaw-surpasses-react-most-starred-software

OpenClaw 的核心创新在于其交互层设计,实现了对 WhatsApp、Telegram、飞书等主流 IM 工具的无缝接入,为用户提供了极高的使用自由度。同时,skills 技能生态百花齐放,只有想不到,没有做不到的。

然而,从技术成熟度来看,该项目仍面临一些挑战,包括:

- 安全架构的完善:由于早期权限控制饱受争议,团队自 2026 年起推行了多项限制破坏性的变更,旨在从底层收紧默认权限,这一过程尚在迭代中。

- 认知能力的瓶颈:若以“个人助理”为标准衡量,其当前的理解与记忆能力仍是体验的天花板,难以胜任复杂的多轮任务。

本期主要探讨 OpenClaw 在记忆方面的困境和应对。

我们以问题《热辣滚烫》和《哥斯拉大战金刚2》哪部先上映?为例说明一下。

此问题看似简单,对 AI 却是不小的挑战:答案无法从单一文档获取,系统需要在海量记忆里检索两个独立证据,再通过推理将它们关联起来。这对任何记忆架构都是严苛的考验。

OpenClaw 面对这类问题,回答准确率并不理想。直到我引入了 MemMachine 作为 OpenClaw 的开源“外挂大脑”,情况大大改观。

装上 MemMachine 后,OpenClaw 仿佛拥有了过目不忘的能力,多跳推理问题的回答质量显著提升。更惊喜的是,Token 消耗大幅下降,省下的预算足够我每天多喝一杯咖啡。

今天我们拆解一下,MemMachine 究竟是如何让 OpenClaw “记性好且花钱少”的。

OpenClaw的记忆原理

OpenClaw 的记忆方案有多原始?简单说就是:用 Markdown 文件记流水账,再用 SQLite 当搜索引擎。结果就像在大脑里贴满了便利贴,乱成一团,找东西全看命。

这也是为什么圈里人管使用 OpenClaw 叫“养虾”,你得一点一点喂它信息,帮它把散落的知识点串起来,它才能慢慢变“聪明”。

但这种方式有个致命副作用,也是众多虾友吐槽之处:Token 烧得飞快。因为它会把所有聊天记录一股脑塞进上下文,里面全是“今天吃了没”这类废话,真正的关键信息反而被淹没了,专业术语叫做上下文腐烂(context rot)。典型的“花钱买罪受”。

直到我遇到了 MemMachine。

如果把 OpenClaw 比作一个智商爆表但记不住事的学霸,那 MemMachine 就是帮他整理笔记的记忆大师:让这个学霸终于能把自己学过的知识真正用起来,还顺便省下了一大笔咖啡钱。

MemMachine 到底有多能打?

选用测试数据集:2WikiMultiHopQA —— AI 记忆界的“铁人三项”,专门考验模型会不会“绕弯子”思考。

什么是绕弯子问题?前面提到的问题就是:《热辣滚烫》和《哥斯拉大战金刚2》哪部先上映?

正常人思路:先查两部电影的上映日期,然后再比较时间先后给出答案。两步推理,简单清晰。

但对 OpenClaw 来说,这简直是噩梦 —— 它只能走一步看一步。找到电影的上映时间后,就忘了下一步要干嘛,直接卡死在原地。

换上 MemMachine 之后:

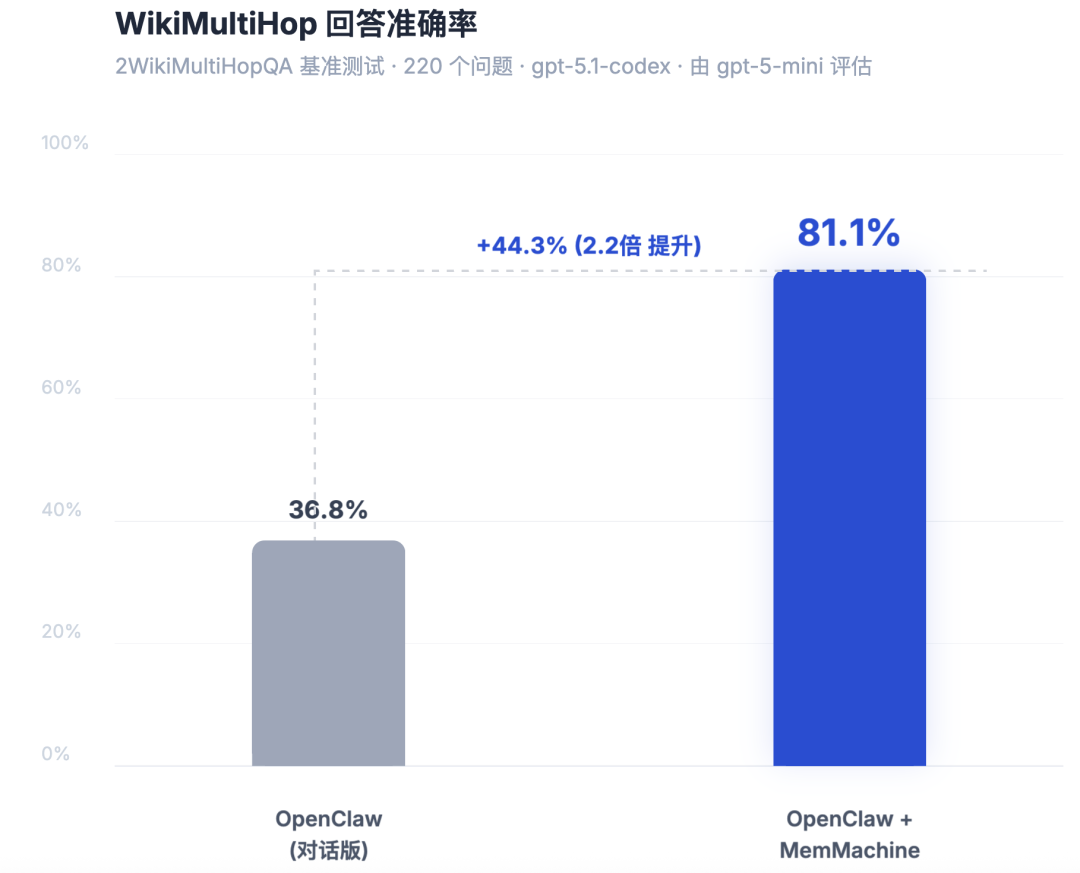

- 准确率直接飙到2.2倍

- Token消耗反而省下59%

换句话说:脑子更灵光了,还更省钱。这哪是升级,简直是“换脑手术”。

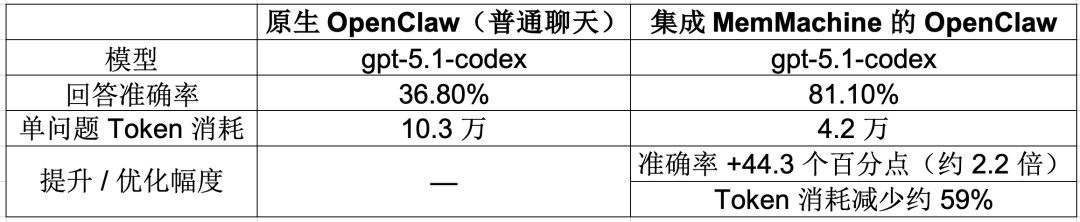

通过两组对照的测试:相同的模型(gpt-5.1-codex)、相同的100个多跳问题,所有答案都由 gpt-5-mini 模型给出,唯一的差别是是否采用了 MemMachine 。

先上核心数据表格,一看就懂:

2WikiMultiHopQA测试对比

准确率对比

Token消耗对比

这组数据,说实话颠覆了我的认知。

为什么? 因为在 AI 领域,“更准”和“更省”从来是一对矛盾体:

- 想准确?就得加载更多上下文,Token狂飙,成本失控

- 想省钱?就得精简上下文,关键信息丢失,准确率跳水

但 MemMachine 硬是打破了这道魔咒 —— 准确率从不及格的 36.8% 飙升到81.1% 的优等生,Token 反而砍掉近六成。对大流量用户来说,这意味着真金白银的节省。

数据背后透露了什么?

OpenClaw 的正确率是 36.8%,说明它大部分时候是在“瞎猜”——依赖LLM 自身的训练知识硬答,根本没检索到你真正喂给它的记忆。

而 81.1% 证明,MemMachine 真正让 LLM “吃对了粮”:它不再是凭空想象,而是按图索骥,从你的记忆库里找到正确答案,再发挥推理能力。这才是“大模型+外挂大脑”该有的样子。

MemMachine的“外挂大脑”,到底是什么原理?

为什么 MemMachine 能这么强?核心秘密藏在两个关键词里:“双层记忆架构”和“钩子集成”。

通俗点说,就是给 OpenClaw 同时配了一本日记本和一套百科全书,而且不用它刻意“回忆”,系统自动就能调出最相关的记忆。

双层记忆架构——从“便利贴”到“人脑”

这是 MemMachine 的“灵魂”,也是它区别于其他记忆插件的根本。它模仿人类大脑的两种记忆模式,分工明确、协同工作:

第一层:情境记忆(Episodic Memory)

这是 OpenClaw 的“日记本”。

专门记录“什么时候、发生了什么事”,捕捉对话的时间流和叙事逻辑。

举个例子:

上周三你在群里吐槽:“直播间买的风衣,洗一次就缩水了”

上周五又发消息:“找客服理论半天,终于同意退货退款”

情境记忆会把这两件事按时间顺序串起来,连成一条完整的“踩坑→维权→成功”的故事线。它保留了对话的温度和脉络,让 OpenClaw 明白“来龙去脉”。

第二层:语义记忆(Semantic Memory)

这是 OpenClaw 的“百科全书”。

如果说情境记忆是“日记本”,语义记忆就是“知识库”,只提炼长期有用的核心事实,过滤掉日常废话。

就像学生听课,你不会记住老师的每句话,只会记下“地球绕太阳转”、“1+1=2” 这些核心知识点。OpenClaw 缺的就是这种提炼能力,所有对话囫囵吞枣地存下来,找的时候像大海捞针。

MemMachine 通过“筛选-巩固”机制,模拟人脑海马体的工作原理,即情境记忆“记录过程”,语义记忆“提炼核心”,两者结合,使 OpenClaw 终于既有温度,又有精度。不像以前,要么全是废话啥也记不住,要么只剩干巴巴的关键词丢了上下文。

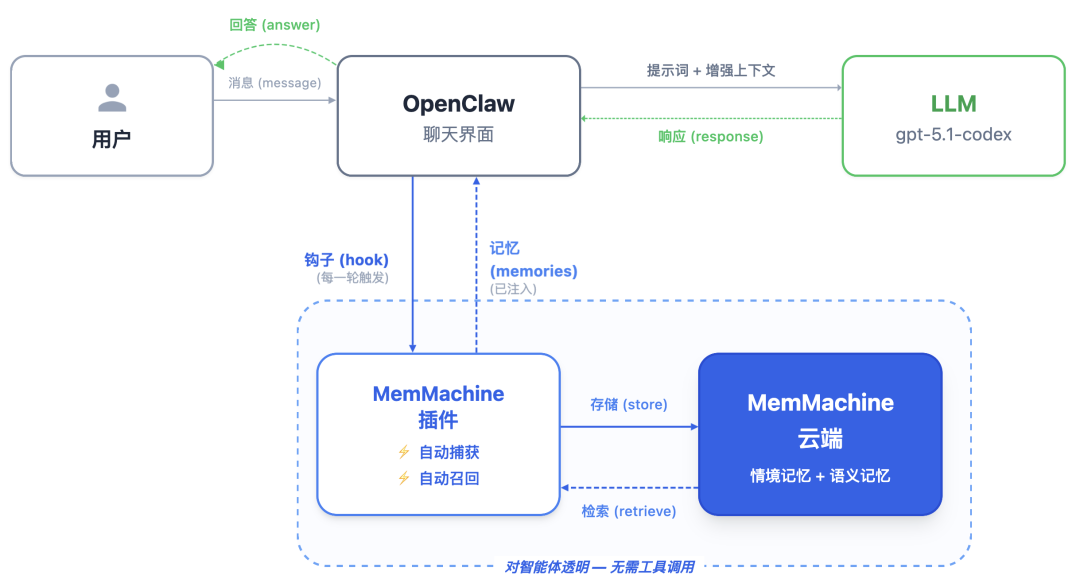

钩子集成,让OpenClaw“自动回忆”

有了双层记忆架构,还得解决一个关键问题:OpenClaw 怎么知道什么时候该调用哪段记忆?总不能让用户手动触发吧。

MemMachine 的答案是:钩子集成(Hook)。

与其他很多软件相似,OpenClaw 具有“钩子”(Hook)的扩展机制,技术的语言来说类似于“中断处理”,可在 OpenClaw 处理消息的关键路径上“埋点”。MemMachine 借此实现非侵入式的功能增强,不改一行 OpenClaw 的源码,却能彻底改变它的记忆能力。

MemMachine的插件架构及透明嵌入OpenClaw的方式

在 MemMachine 的加持下,OpenClaw 终于摆脱了“金鱼记忆”的宿命:

- 不用反复提醒:你说过的事,它真的记住了

- 不用手动喂料:相关记忆,它自己会翻出来

- 不用刻意引导:多跳推理,它默默完成了

这种体验,才是个人助理该有的样子——像真人一样,记得住过往,接得上话茬,不用你操心“他忘了没”。

如果说以前的 OpenClaw 像个聪明但健忘的学霸,聊天时总得你帮他翻笔记;那装上 MemMachine 之后,他终于进化成了那个懂你、记你、不用你操心的老朋友。

为什么MemMachine更聪明,反而更省Token?

这大概是 MemMachine 最反直觉的地方:检索更准了,记忆更全了,Token却大降59%。

核心秘密:从“全量加载”到“精准投喂”

OpenClaw 的记忆方案,像极了“把整个仓库搬进会议室”:

这就是所谓 噪音问题—— OpenClaw 的上下文里,90%都是无关的聊天记录、过期的废话和重复的日常。模型要处理大量无效内容,才能捞出那10%的关键信息。Token都烧在“翻找”上了,而不是“思考”上。

MemMachine 的解法很简单:只搬你需要的那个文件夹。

通过双层记忆架构,它能在你提问的瞬间,精准召回最相关的记忆片段——只有这些片段会被注入上下文。那些无关的噪音,直接剔除,连进会议室的机会都没有。

技术术语叫“信噪比提升”:信号(关键信息)不变或更多,噪音(无关内容)大幅减少。模型不用再“大海捞针”,而是直接“对针下药”,Token 消耗自然断崖式下跌。

聪明,还省钱——这才是最“反常识”的惊喜。

给OpenClaw装上Mem Machine“外挂大脑”

我最欣赏 MemMachine 的一点就是易用性:不用复杂的配置,不用懂代码,普通人三分钟就能安装完成,甚至比你安装一个微信插件还简单。步骤如下:

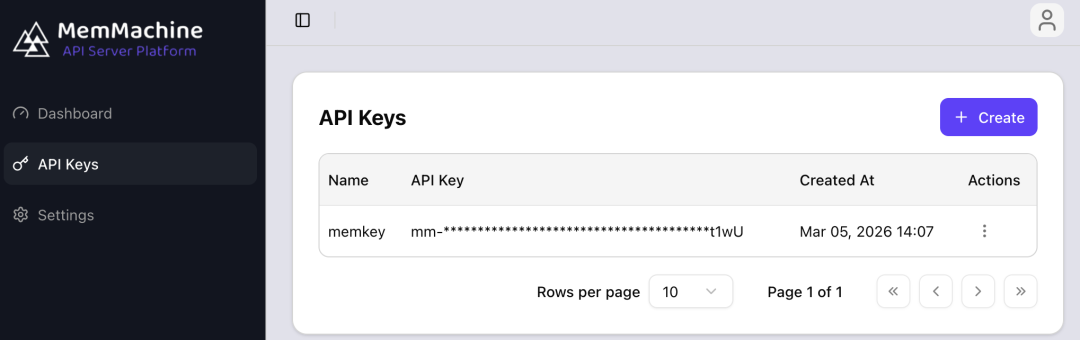

第一步:获取MemMachine的API Key

- 访问官网:https://console.memmachine.ai

- 注册一个账号,支持邮箱、Google 账号、GitHub 账号登录,推荐用 GitHub 或者 Google 账号,一键登录,更方便;

- 登录后,进入控制台,找到 API Key 选项,点击 “Create”,然后复制这个Key(一定要保存好,系统只显示一次,后续配置会用到,不要泄露给别人)。

第二步:安装MemMachine插件

- 打开命令行窗口(Windows 系统用 cmd 或 PowerShell,Mac/Linux 系统用 Terminal);

- 输入一行安装命令:openclaw plugins install @memmachine/openclaw-memmachine

- 等待1-2分钟,插件就安装完成了。

第三步:配置插件(填入API Key,开启自动记忆功能)

- 安装完成后,在终端输入命令: openclaw plugins configure @memmachine/openclaw-memmachine

- 终端会提示“请输入 MemMachine API Key ”,粘贴你第一步得到的API Key,按下回车;

- 重启 OpenClaw。

第四步:正常使用,享受“过目不忘”的体验

配置完成后,你不需要做任何额外操作,就像往常一样和 OpenClaw 聊天、发指令即可。MemMachine 会在后台自动工作:

- 自动捕获:你和 OpenClaw 的所有对话,都会被实时摄入 MemMachine,自动分类到情境记忆和语义记忆中;

- 自动召回:你每次问 OpenClaw 问题,MemMachine 都会自动检索相关记忆,注入上下文,让 OpenClaw 精准回答。

结语:OpenClaw的终极进化,从“有记忆”到“会记忆”

越用 OpenClaw 越感慨:它的崛起让普通人也能轻松部署个人 AI 助手,但记忆短板让它始终停留在响应式脚本,成不了真正的数字伴侣。

MemMachine 正好补齐了这个短板:没改核心模型,没改使用习惯,只是给它装了个“更聪明的大脑”,从“有记忆”进化到“会记忆”。既能记住日常偏好,又能处理多跳问题;既能提升准确率,又能节省 Token 成本——更强、更省、更易用。

AI 进化从来不是“一步登天”,而是像 MemMachine 这样,精准解决核心痛点:在正确的时间,拿到正确的记忆。这正是AI走向“通用智能”的关键一步。

如果你也被 OpenClaw 的记忆力困扰,想让 AI 更懂你、更省钱和“过目不忘”,不妨试试 MemMachine 。三分钟安装,终身受益。

最后,社区互动方法:去 GitHub(https://github.com/MemMachine)点个星,可加入他们的 Discord 社区,和其他 OpenClaw 玩家一起交流。相信不久的将来,OpenClaw 会成为我们不可或缺的数字伴侣。

安装使用遇到问题,欢迎评论区留言。关注“亨利笔记”,后续更多 OpenClaw 技巧和AI智能体前沿玩法!

参考文献:

MemMachine开源地址:

https://github.com/MemMachine/MemMachine/

官方博客:

https://memmachine.ai/blog/2026/02/how-memmachine-transforms-openclaws-memory-on-wikimultihop/

https://memmachine.ai/blog/2026/02/hipposync-switch-models.-share-context.-build-together./

欢迎关注 亨利笔记, 👍 点赞 | ⭐ 收藏 | ↗️ 转发。

近期文章:

不仅仅是裁员!当劳动力不再稀缺,AI将如何终结我们的传统经济模式?

现象级开源AI智能体:OpenClaw(Clawdbot)五层架构深度解析

本公众号聚焦人工智能,云原生和区块链等技术原理,请立即关注亨利笔记 ( henglibiji ),以免错过更新。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-05,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录