世界上最强大的开源模型,GLM-5实测,本地部署,Ollama免费提供云端模型

世界上最强大的开源模型,GLM-5实测,本地部署,Ollama免费提供云端模型

Ai学习的老章

发布于 2026-03-02 20:47:08

发布于 2026-03-02 20:47:08

大模型春晚 2.0

世界上最强大的开源大模型来了

没想到最先来的是 GLM-5,师承 DeepSeek,股价大涨 40%

正如前面推测的一样,它就是 GLM-5

本文只说三件事:

- 简介

- 本地部署/压缩 80% 的量化版部署

- Ollama 免费云模型一键配置到 Claude Code、OpenCode

我拿出经典测试题,它的表现居然不如 Claude Sonnet 3.7

甚至不如闭源的 Qwen3-Max-Thinking

阿里 Qwen3-Max-Thinking 来了,加上 TTS 更强了,依然不开源

让我吃惊的是 Ollama 云端量化后的 GLM-5,表现很稳,除了换行有点瑕疵(Ollama 如何启动,后面有介绍)

我的测试不全面,不代表GLM-5的真实水平,我看有网友拿出的测试,看起来就很牛逼

1、师承 DeepSeek,Claude 蒸馏数据加持

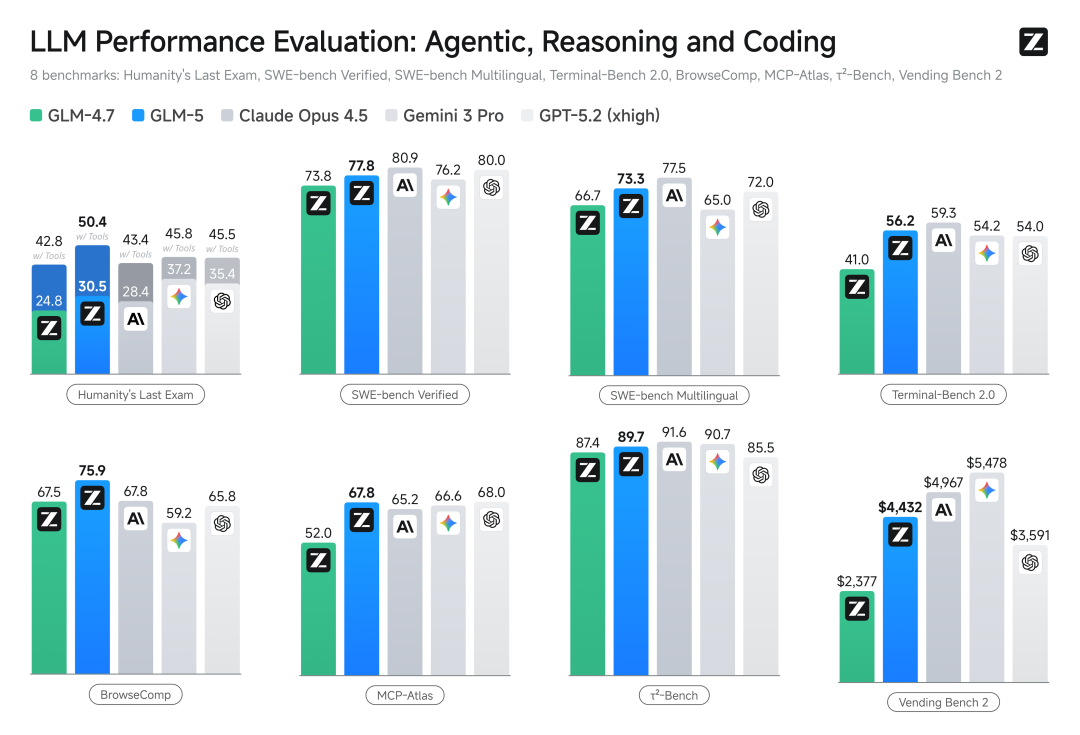

官方 Benchmark 结果,直接与 Claude Opus 4.5、Gemini 3 Pro、GPT-5.2 站一起了

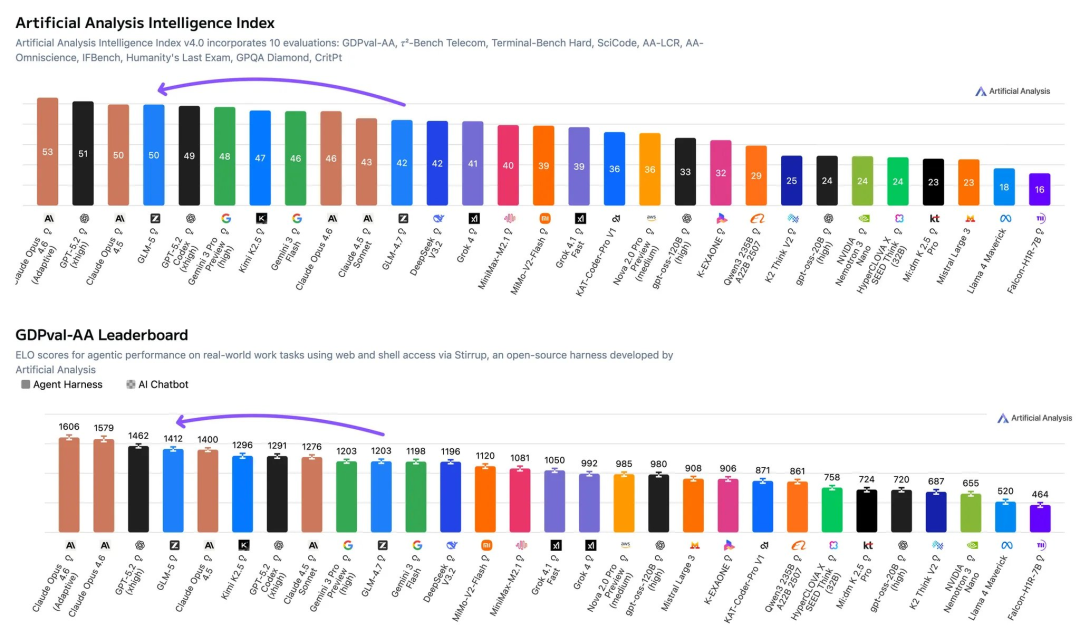

Artificial Analysis 的测评数据,GLM-5 是目前世界上最领先的开源模型,分数逼近 Claude Opus 4.5

如此强悍,我觉得主要是站在两大巨人的肩膀上,1 是集成 DeepSeek Sparse Attention 的全新架构,总参 744B,激活 40B,实现了高效的长上下文服务;2 是来自 Claude 的蒸馏数据

第二点有争议,多名网友不同测试显示其训练数据很可能 N 多来自 Claude

也有不一样的结果

具体表现还需要大家亲自体验:https://chat.z.ai/

它的 3 个亮点功能我觉得都值得一试

1 是 Agent 模式

- 视角的转变:超越对话,迈向交付优先模式 —— 自动分解任务、协调工具并执行工作流,以生成即用型结果。

- 新增功能 —— 数据洞察与智能写作:将原始数据转化为即时可视化内容。从大纲到终稿无缝衔接。

- AI 演示文稿、全栈开发与高级搜索 —— 全面升级:增强指令理解能力和多步骤任务执行能力。

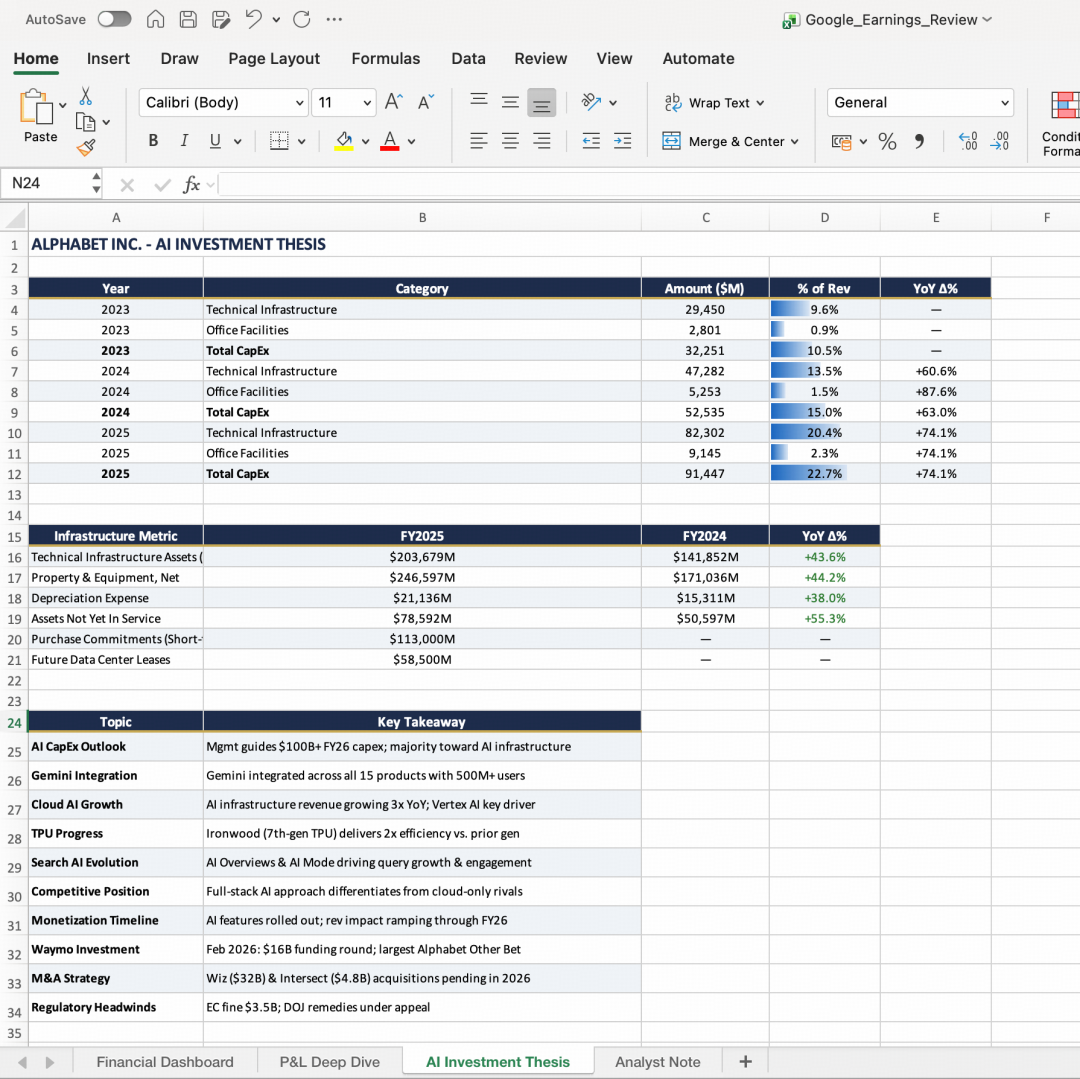

2 是数据分析

上传数据,立即获取图表和结论。

- 一步生成图表:柱状图、折线图、饼图等多种类型,自动与您的数据匹配。无需再进行手动 Excel 操作

- 从数据清洗到分析的端到端流程:缺失值处理、异常检测、趋势分析,全部通过对话完成

- 导出为 xlsx/csv/png 格式:直接下载结果,可立即使用

3 是 PDF / Word / Excel 创建技能

GLM-5 可以直接将文本或源材料转换为 .docx、.pdf 和 .xlsx 文件——产品需求文档 (PRD)、教案、考试题、电子表格、财务报告、运行表、菜单等等——并以端到端的方式交付即用型文档。

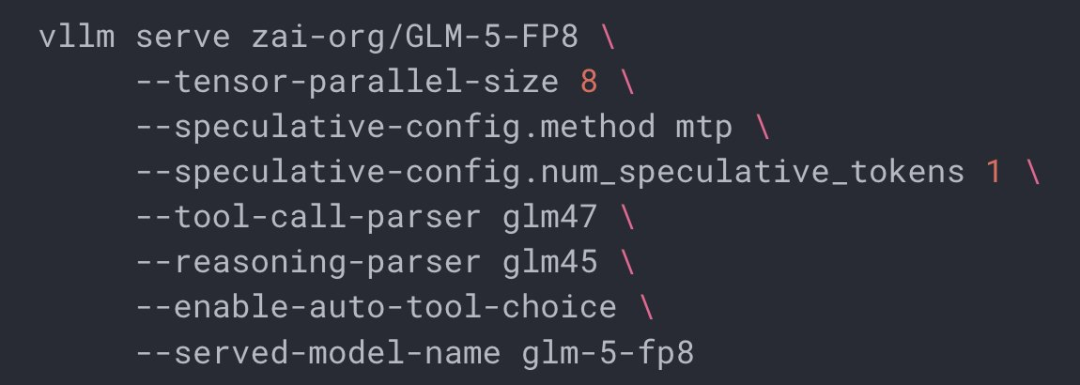

2、FP8 本地部署,量化版本地部署

vLLM 依然很给力,Day0 支持

但是 99.9% 的朋友可以忽视了,FP8 也需要至少 8 卡 H200 才能跑起来

BF16 的模型文件更是来到了 1.5T,16 卡阿里 PPU 也跑不动

好在量化一哥 Unsloth 正在加急出量化版,2-bit 模型来到 280GB,压缩 80%+

部署方法:https://unsloth.ai/docs/models/glm-5

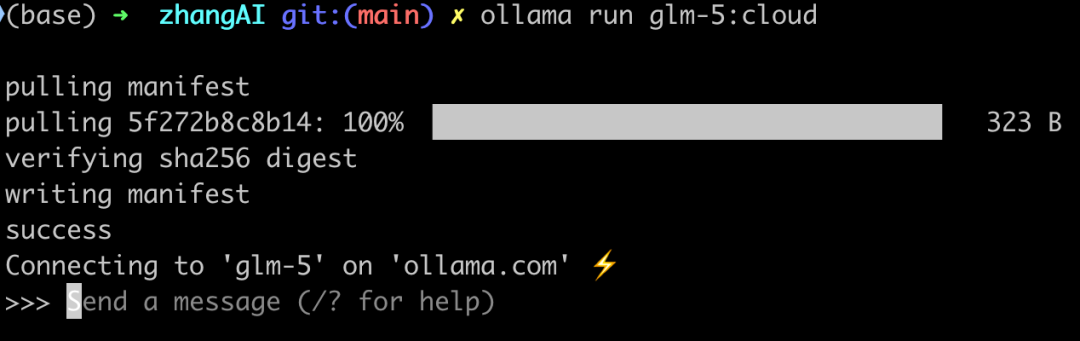

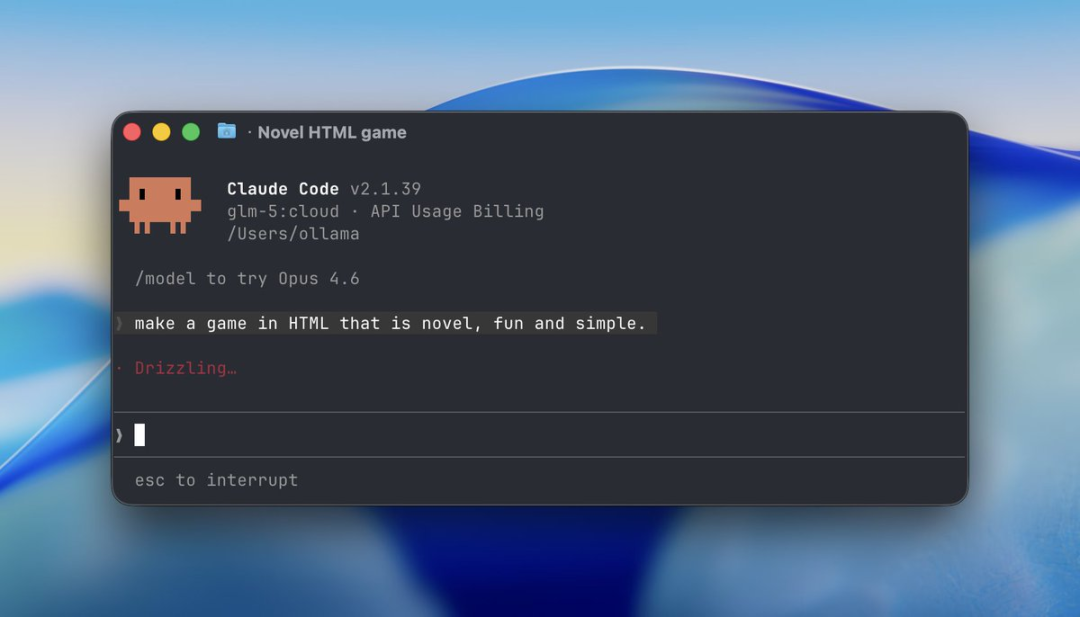

3、Ollama 免费云端模型 + 一键配置到 Claude Code、Codex、OpenCode、OpenClaw!

免费用直接 ollama run glm-5:cloud 就行了

launch 用法介绍太多次了,不赘述,比如一键配置Claude Code

ollama launch claude --model glm-5:cloud

Ollama 近期重大更新:图片生成、Claude Code 兼容、一键启动 Agent

OpenClaw 免费玩 ,Ollama 提供云模型支持,这可能是目前最简单的安装、配置教程

GLM-5 绝对是个值得尝试的国产大模型,我后续将在OpenCode中替换掉K2.5,深度感受一下

制作不易,如果这篇文章觉得对你有用,可否点个关注。给我个三连击:点赞、转发和在看。若可以再给我加个🌟,谢谢你看我的文章,我们下篇再见!

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-12,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录