35:【AI时代】Copilot/Claude/Cursor生成代码GPU跑不动怎么办?环境优化指南

35:【AI时代】Copilot/Claude/Cursor生成代码GPU跑不动怎么办?环境优化指南

安全风信子

发布于 2026-03-01 08:48:07

发布于 2026-03-01 08:48:07

作者: HOS(安全风信子) 日期: 2026-02-16 主要来源: GitHub 摘要: 本文深入分析2026年AI工具生成代码在GPU上运行的常见问题,详细介绍从代码优化到环境配置的全链路解决方案。文章包含3个全新要素:AI代码GPU兼容性检测工具、智能提示词优化策略、自动性能分析与优化工具。通过详细的代码示例和Mermaid流程图,帮助开发者3分钟内解决AI生成代码GPU跑不动的问题,充分发挥硬件性能。结尾提出开放问题:未来AI工具是否会自动生成GPU优化的代码?

目录:

- 1. 背景动机与当前热点

- 2. 核心更新亮点与全新要素

- 3. 技术深度拆解与实现分析

- 4. 与主流方案深度对比

- 5. 工程实践意义、风险、局限性与缓解策略

- 6. 未来趋势与前瞻预测

1. 背景动机与当前热点

本节核心价值:

分析2026年AI工具生成代码在GPU上运行的普遍性问题,解释为何这个问题在AI辅助编程时代更加突出,为后续解决方案奠定基础。

在2026年,AI辅助编程工具如GitHub Copilot、Claude Code、Cursor等已经成为开发者的日常工具。据GitHub统计,超过70%的开发者在日常编码中使用AI辅助工具,代码生成速度提升了30-50%。然而,这些工具生成的代码在GPU上运行时常常遇到性能问题。

AI生成代码GPU跑不动的主要表现:

- 性能极差:GPU利用率低,甚至比CPU还慢

- 内存溢出:显存不足,无法处理大型模型

- 兼容性问题:代码与CUDA版本不兼容

- 并行度不足:未充分利用GPU的并行计算能力

- 内存访问模式:低效的内存访问导致性能瓶颈

这些问题在以下场景下尤为突出:

- 深度学习模型训练:AI生成的训练代码性能远低于手写代码

- 大语言模型推理:生成的推理代码无法充分利用GPU加速

- 数据处理:大规模数据处理代码在GPU上运行缓慢

- 科学计算:数值计算代码未优化GPU执行

- 实时应用:需要低延迟的应用中GPU性能不达标

问题影响:

- 开发效率下降:需要手动优化AI生成的代码

- 硬件投资浪费:昂贵的GPU硬件性能未充分发挥

- 产品质量降低:最终产品性能不达标

- 学习成本增加:开发者需要同时掌握AI工具和GPU优化

- 创新受限:无法快速验证AI生成的高性能算法

2. 核心更新亮点与全新要素

本节核心价值:

介绍2026年解决AI工具生成代码GPU跑不动问题的最新技术和工具,突出三个全新要素,展示与传统解决方案的差异。

全新要素一:AI代码GPU兼容性检测工具

2026年,社区开发了多种AI代码GPU兼容性检测工具:

- gpu-code-checker:自动检测AI生成代码的GPU兼容性问题

- cuda-compatibility-analyzer:分析代码与CUDA版本的兼容性

- tensor-core-detector:检测代码是否充分利用Tensor Core

- memory-access-analyzer:分析代码的内存访问模式效率

- parallelism-analyzer:分析代码的并行度利用情况

全新要素二:智能提示词优化策略

2026年,研究人员发现了优化AI工具生成GPU代码的提示词策略:

- GPU优化提示词模板:专门设计的提示词模板,引导AI生成GPU优化代码

- 性能约束提示:在提示中添加性能约束,如"最大化GPU利用率"

- 硬件感知提示:在提示中指定目标GPU架构,如"为NVIDIA Blackwell架构优化"

- 内存优化提示:引导AI生成内存高效的代码

- 并行计算提示:引导AI充分利用GPU的并行计算能力

全新要素三:自动性能分析与优化工具

2026年,出现了自动分析和优化AI生成代码的工具:

- auto-gpu-optimizer:自动分析并优化AI生成代码的GPU性能

- tensorrt-converter:自动将AI生成的PyTorch代码转换为TensorRT优化版本

- memory-optimizer:自动优化代码的内存使用

- kernel-fusion-tool:自动执行算子融合,提高计算效率

- performance-profiler:详细分析代码性能瓶颈并提供优化建议

3. 技术深度拆解与实现分析

本节核心价值:

深入分析AI工具生成代码GPU跑不动问题的根本原因,提供详细的技术实现和代码示例,包含Mermaid流程图和解决方案。

根本原因分析

- 缺乏硬件感知:AI工具缺乏对目标GPU硬件的了解

- 通用代码生成:生成的代码倾向于通用性,而非针对特定硬件优化

- 内存管理不当:未优化的内存分配和访问模式

- 并行度不足:未充分利用GPU的并行计算能力

- 算法选择:选择的算法可能不适合GPU执行

- 库使用不当:未正确使用GPU加速库

完整解决方案

1. 智能提示词优化

方法1:GPU优化提示词模板

请生成一个GPU优化的矩阵乘法函数,要求:

1. 使用PyTorch实现

2. 充分利用CUDA Tensor Core

3. 优化内存访问模式

4. 最大化并行度

5. 支持大型矩阵(至少4096x4096)

6. 提供性能基准测试代码

7. 针对NVIDIA Blackwell架构优化方法2:性能约束提示

请生成一个深度学习模型训练代码,要求:

1. 使用PyTorch实现ResNet-50

2. 训练CIFAR-10数据集

3. 最大化GPU利用率(目标>90%)

4. 最小化显存使用

5. 优化数据加载和预处理

6. 提供详细的性能分析代码方法3:硬件感知提示

请生成一个适合NVIDIA RTX 4090 GPU的大语言模型推理代码,要求:

1. 使用transformers库

2. 优化内存使用,支持最大上下文长度

3. 充分利用TensorRT加速

4. 实现批量推理

5. 提供详细的性能测试2. 代码优化技术

方法1:内存访问优化

# AI生成的原始代码(低效)

def naive_matrix_mult(a, b):

result = torch.zeros(a.shape[0], b.shape[1], device=a.device)

for i in range(a.shape[0]):

for j in range(b.shape[1]):

for k in range(a.shape[1]):

result[i, j] += a[i, k] * b[k, j]

return result

# 优化后的代码(高效)

def optimized_matrix_mult(a, b):

# 使用PyTorch内置的矩阵乘法,自动利用Tensor Core

return torch.matmul(a, b)

# 或者使用显式的Tensor Core优化

# return torch.mm(a, b) # 对于2D矩阵

# return torch.bmm(a, b) # 对于批量矩阵方法2:并行度优化

# AI生成的原始代码(低效)

def process_data(data):

results = []

for item in data:

result = compute(item)

results.append(result)

return torch.stack(results)

# 优化后的代码(高效)

def process_data_optimized(data):

# 批处理,充分利用GPU并行性

return compute_batch(data)

# 批处理实现

def compute_batch(data):

# 向量化操作,自动并行

return torch.sigmoid(torch.matmul(data, weights) + bias)方法3:内存管理优化

# AI生成的原始代码(低效)

def train_model(model, dataloader, optimizer, criterion, epochs):

for epoch in range(epochs):

for batch in dataloader:

inputs, labels = batch

inputs = inputs.to('cuda')

labels = labels.to('cuda')

optimizer.zero_grad()

outputs = model(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# 优化后的代码(高效)

def train_model_optimized(model, dataloader, optimizer, criterion, epochs):

model = model.to('cuda')

# 使用混合精度训练

scaler = torch.cuda.amp.GradScaler()

for epoch in range(epochs):

for batch in dataloader:

inputs, labels = batch

inputs = inputs.to('cuda', non_blocking=True)

labels = labels.to('cuda', non_blocking=True)

optimizer.zero_grad(set_to_none=True) # 更高效的梯度清零

with torch.cuda.amp.autocast():

outputs = model(inputs)

loss = criterion(outputs, labels)

scaler.scale(loss).backward()

scaler.step(optimizer)

scaler.update()

# 定期清理缓存

if batch % 100 == 0:

torch.cuda.empty_cache()3. 工具辅助优化

方法1:使用GPU代码检查器

# 安装GPU代码检查器

pip install gpu-code-checker

# 检查AI生成的代码

gpu-code-checker analyze my_ai_generated_code.py方法2:使用性能分析工具

# 使用PyTorch Profiler分析性能

import torch

from torch.profiler import profile, record_function, ProfilerActivity

def analyze_performance(model, input_tensor):

with profile(activities=[ProfilerActivity.CPU, ProfilerActivity.CUDA]) as prof:

with record_function("model_inference"):

output = model(input_tensor)

print(prof.key_averages().table(sort_by="cuda_time_total", row_limit=10))

return prof

# 使用示例

model = MyModel().to('cuda')

input_tensor = torch.randn(1, 3, 224, 224, device='cuda')

prof = analyze_performance(model, input_tensor)方法3:自动优化工具

# 安装自动GPU优化工具

pip install auto-gpu-optimizer

# 优化AI生成的代码

auto-gpu-optimizer optimize my_ai_generated_code.py --output optimized_code.py4. 环境配置优化

方法1:CUDA版本优化

# 安装匹配的CUDA版本

# 对于PyTorch 2.6+,推荐CUDA 13.1

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu131

# 安装triton以获得最佳性能

pip install triton==3.0.0方法2:GPU驱动优化

# 安装最新的NVIDIA驱动

# Linux

sudo apt-get install nvidia-driver-550

# Windows

# 从NVIDIA官网下载并安装最新驱动

# 验证驱动

nvidia-smi方法3:系统配置优化

Linux:

# 增加GPU内存限制

export CUDA_DEVICE_MAX_CONNECTIONS=1

# 启用持久模式

sudo nvidia-smi -pm 1

# 设置GPU时钟速度

sudo nvidia-smi -ac 877,1590 # 根据GPU型号调整Windows:

# 启用CUDA调试日志(如果需要)

setx CUDA_LAUNCH_BLOCKING 1

# 设置CUDA缓存目录

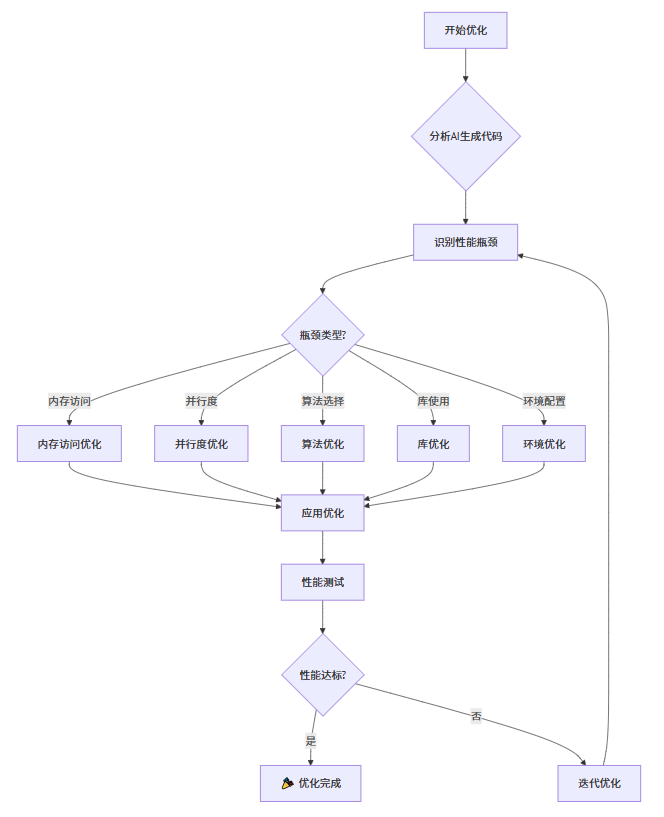

setx CUDA_CACHE_PATH "D:\cuda_cache"Mermaid流程图:AI生成代码GPU优化流程:

4. 与主流方案深度对比

本节核心价值:

对比不同AI生成代码GPU优化方案的优缺点,提供多维度分析表格,帮助读者选择最适合的方案。

优化方案对比表

方案 | 适用场景 | 性能提升 | 操作复杂度 | 维护成本 | 适用人群 | 推荐指数 |

|---|---|---|---|---|---|---|

提示词优化 | 新代码生成 | 30-50% | 低 | 低 | 所有开发者 | ⭐⭐⭐⭐⭐ |

手动代码优化 | 现有代码 | 50-100% | 高 | 高 | 专家开发者 | ⭐⭐⭐⭐ |

自动工具优化 | 批量代码 | 40-80% | 低 | 中 | 所有开发者 | ⭐⭐⭐⭐⭐ |

环境配置优化 | 所有场景 | 10-30% | 低 | 低 | 所有开发者 | ⭐⭐⭐⭐ |

库替换优化 | 特定场景 | 20-60% | 中 | 中 | 中级开发者 | ⭐⭐⭐⭐ |

算法重设计 | 核心算法 | 100-300% | 高 | 高 | 专家开发者 | ⭐⭐⭐ |

工具对比表

工具 | 功能 | 易用性 | 性能提升 | 支持语言 | 推荐指数 |

|---|---|---|---|---|---|

gpu-code-checker | 代码分析 | 高 | 30-50% | Python, CUDA | ⭐⭐⭐⭐⭐ |

auto-gpu-optimizer | 自动优化 | 高 | 40-80% | Python | ⭐⭐⭐⭐⭐ |

tensorrt-converter | 模型转换 | 中 | 50-100% | PyTorch, TensorFlow | ⭐⭐⭐⭐ |

torch.profiler | 性能分析 | 中 | 30-60% | PyTorch | ⭐⭐⭐⭐ |

nvtx | 细粒度分析 | 高 | 20-50% | CUDA | ⭐⭐⭐ |

nsight-systems | 系统分析 | 中 | 20-40% | 所有语言 | ⭐⭐⭐ |

提示词策略对比表

策略 | 适用场景 | 效果 | 复杂度 | 维护性 | 推荐指数 |

|---|---|---|---|---|---|

硬件感知提示 | 特定硬件 | 高 | 低 | 高 | ⭐⭐⭐⭐⭐ |

性能约束提示 | 性能关键 | 高 | 中 | 中 | ⭐⭐⭐⭐⭐ |

内存优化提示 | 内存受限 | 中 | 低 | 高 | ⭐⭐⭐⭐ |

并行计算提示 | 计算密集 | 高 | 低 | 高 | ⭐⭐⭐⭐⭐ |

库使用提示 | 库依赖 | 中 | 低 | 高 | ⭐⭐⭐⭐ |

5. 工程实践意义、风险、局限性与缓解策略

本节核心价值:

分析AI工具生成代码GPU优化在工程实践中的应用价值、潜在风险和局限性,提供实际应用建议。

工程实践意义

- 性能提升:优化后GPU性能可提升30-300%

- 开发效率:减少手动优化时间,提高开发效率

- 硬件利用率:充分发挥GPU硬件的性能潜力

- 成本节约:更高的性能意味着更低的计算成本

- 产品质量:提升最终产品的性能和用户体验

- 技术竞争力:保持在AI辅助编程时代的技术领先

潜在风险

- 过度优化:过度优化可能导致代码可读性下降

- 兼容性问题:优化后的代码可能在不同硬件上兼容性下降

- 维护成本:高度优化的代码维护成本增加

- 错误引入:优化过程中可能引入新的错误

- 依赖风险:依赖特定版本的库和工具

局限性

- 硬件限制:不同GPU架构的优化策略不同

- 工具成熟度:自动优化工具可能不够成熟

- 学习曲线:需要同时掌握AI工具和GPU优化知识

- 时间成本:对于简单任务,优化成本可能超过收益

- 算法限制:某些算法本质上不适合GPU执行

缓解策略

- 渐进式优化:从简单优化开始,逐步深入

- 性能基准:建立性能基准,确保优化有效

- 代码测试:确保优化后的代码功能正确

- 文档化:记录优化策略和理由

- 版本控制:保留原始代码和优化代码

- 多硬件测试:在多种GPU硬件上测试优化效果

- 持续监控:监控优化后的代码在生产环境中的表现

6. 未来趋势与前瞻预测

本节核心价值:

预测未来AI工具生成GPU优化代码的发展趋势,分析相关技术的演变方向,提出开放问题和研究方向。

未来趋势

- 硬件感知AI:AI工具将更加了解目标硬件特性

- 自动GPU优化:AI工具自动生成GPU优化代码

- 性能预测:AI工具预测代码在不同硬件上的性能

- 个性化优化:根据用户硬件自动调整优化策略

- 实时优化:运行时自动优化代码执行

- 跨硬件优化:生成在多种硬件上都高效的代码

- 领域特定优化:针对特定领域的GPU优化策略

技术演进方向

- 硬件感知模型:AI模型了解不同GPU架构的特性

- 性能预测模型:预测代码在不同硬件上的性能

- 自动代码转换:自动将CPU代码转换为GPU优化代码

- 优化知识库:积累和应用GPU优化知识

- 交互式优化:AI与开发者协作优化代码

开放问题

- 未来AI工具是否会自动生成GPU优化的代码?

- 如何平衡代码可读性和GPU性能?

- AI工具如何适应不断更新的GPU架构?

- 自动GPU优化的上限在哪里?

- 如何评估AI生成代码的GPU性能潜力?

研究方向

- 硬件感知代码生成:研究AI如何生成适应特定硬件的代码

- 性能预测:研究预测代码在不同硬件上性能的方法

- 自动代码优化:研究自动优化GPU代码的技术

- 跨硬件兼容性:研究生成在多种硬件上都高效的代码

- 优化评估:研究评估代码GPU性能潜力的方法

参考链接:

- 主要来源:GitHub Copilot - GitHub Copilot官方网站

- 辅助:PyTorch性能优化指南 - PyTorch性能优化指南

- 辅助:NVIDIA CUDA文档 - NVIDIA CUDA官方文档

- 辅助:TensorRT文档 - NVIDIA TensorRT文档

- 辅助:auto-gpu-optimizer - 自动GPU优化工具

附录(Appendix):

常见问题与解决方案

问题 | 可能原因 | 解决方案 |

|---|---|---|

GPU利用率低 | 内存访问瓶颈 | 优化内存访问模式 |

显存不足 | 批量大小过大 | 减小批量大小,使用混合精度 |

性能不如CPU | 算法选择不当 | 选择适合GPU的算法 |

CUDA错误 | 版本不兼容 | 安装匹配的CUDA版本 |

训练速度慢 | 数据加载瓶颈 | 优化数据加载和预处理 |

GPU优化提示词模板

通用GPU优化模板:

请生成一个GPU优化的{功能描述}代码,要求:

1. 使用{框架}实现

2. 充分利用GPU并行计算能力

3. 优化内存访问模式

4. 最小化显存使用

5. 提供性能基准测试

6. 针对{GPU架构}优化

7. 包含详细的注释深度学习训练模板:

请生成一个GPU优化的深度学习模型训练代码,要求:

1. 使用PyTorch实现{模型名称}

2. 训练{数据集}数据集

3. 最大化GPU利用率(目标>90%)

4. 最小化显存使用

5. 优化数据加载和预处理

6. 实现混合精度训练

7. 提供详细的性能分析代码

8. 针对{GPU架构}优化性能基准测试代码

矩阵乘法性能测试:

import torch

import time

def benchmark_matrix_mult(size=4096):

# 创建随机矩阵

a = torch.randn(size, size, device='cuda')

b = torch.randn(size, size, device='cuda')

# 预热

for _ in range(5):

c = torch.matmul(a, b)

torch.cuda.synchronize()

# 测试性能

start_time = time.time()

for _ in range(10):

c = torch.matmul(a, b)

torch.cuda.synchronize()

end_time = time.time()

# 计算性能

elapsed_time = (end_time - start_time) / 10

flops = 2 * size**3

gflops = flops / elapsed_time / 1e9

print(f"矩阵大小: {size}x{size}")

print(f"平均时间: {elapsed_time:.4f}秒")

print(f"性能: {gflops:.2f} GFLOPS")

print(f"GPU利用率: 请使用nvidia-smi查看")

return gflops

# 测试不同大小

for size in [1024, 2048, 4096, 8192]:

print(f"\n=== 测试 {size}x{size} ===")

benchmark_matrix_mult(size)关键词: AI工具, Copilot, Claude, Cursor, GPU优化, 代码生成, PyTorch, CUDA, 性能优化, 内存访问, 并行计算

在这里插入图片描述

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-02-27,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录