深度解析OpenClaw自主智能体的核心技术

原创深度解析OpenClaw自主智能体的核心技术

原创

走向未来

发布于 2026-02-03 15:16:06

发布于 2026-02-03 15:16:06

深度 | 下一场AI革命:当大模型有了“手脚”,智能体如何重塑世界?

导读:如果不只是陪你聊天,而是帮你订票、写代码、甚至打游戏通关,AI会变成什么样?从“对话者”到“行动者”,大模型驱动的智能体(AI Agents)正在开启通往自主智能的大门。本文将带你深入拆解智能体的认知架构、进化路径与未来挑战。

人工智能的发展史,本质上是一部不断逼近“自主性(Autonomy)”的历史。

过去两年,我们惊叹于 ChatGPT 的博学;而未来,我们将依赖于 AI Agent(智能体)的行动力。

当大语言模型(LLM)不仅拥有了“大脑”,还通过工具获得了“手脚”,通过记忆拥有了“经验”,一场从“计算”到“认知”,再到“自主行动”的范式转移正在发生。

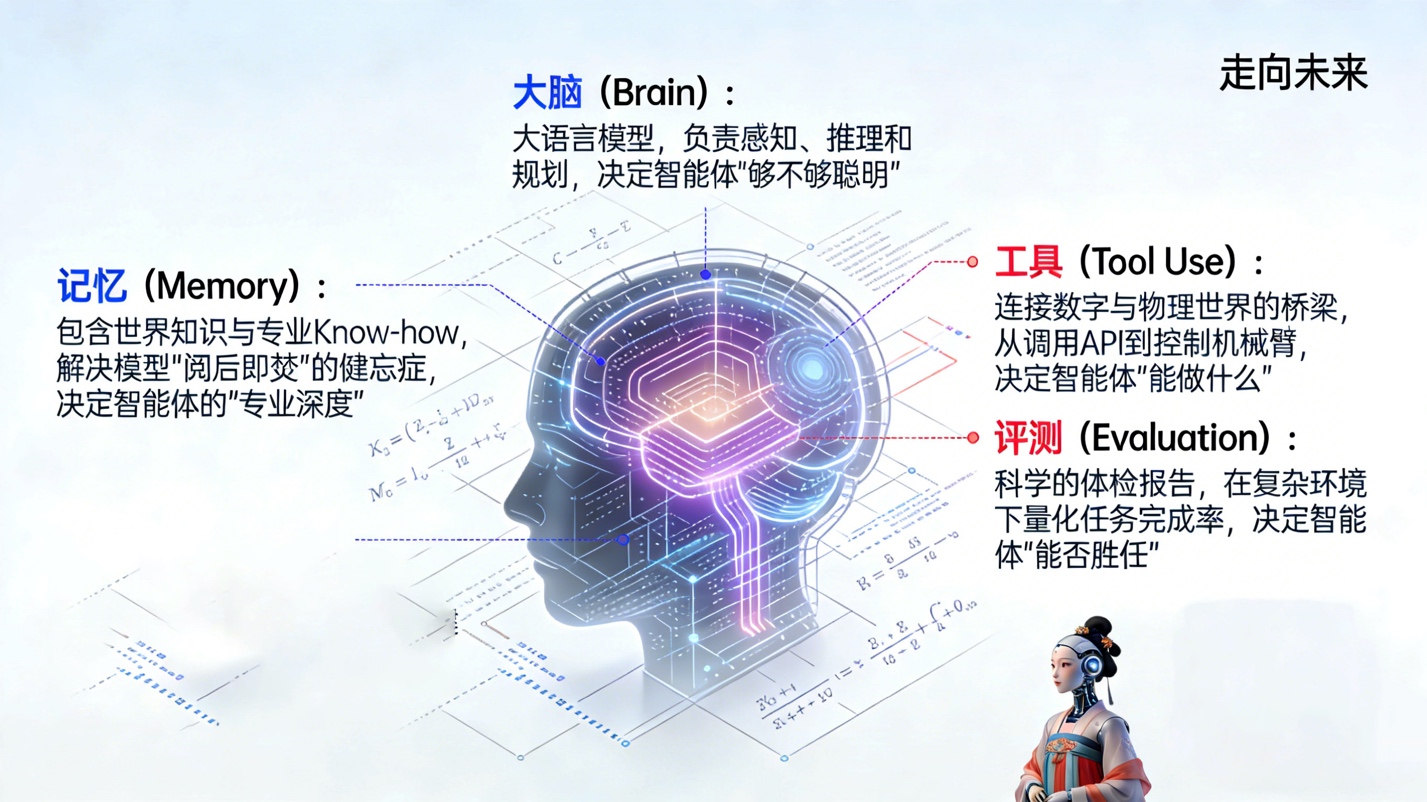

01. 认知觉醒:智能体的“四位一体”架构

如果把传统的软件比作听命行事的“工具”,那么基于大模型的智能体更像是一个正在成长的“数字人类”。本报告深入剖析了现代智能体架构的四大支柱,它们共同构成了一个完整的生命闭环:

- 🧠 大脑(Brain): 也就是大语言模型。它负责感知、推理和规划,决定了智能体“够不够聪明”。

- 📚 记忆(Memory): 包含世界知识与专业 Know-how。它解决了模型“阅后即焚”的健忘症,决定了智能体的“专业深度”。

- 🛠️ 工具(Tool Use): 连接数字与物理世界的桥梁。从调用 API 到控制机械臂,决定了智能体“能做什么”。

- 📊 评测(Evaluation): 科学的体检报告。在复杂环境下量化任务完成率,决定了智能体“能否胜任”。

1.jpg

02. 拒绝“直觉”依赖:像人类一样思考

大模型本质上是一个概率预测器,依靠“直觉”(System 1)行事。要处理复杂任务,智能体必须进化出“深思熟虑”(System 2)的能力。

1. 思维的进化:从链到树

我们解决难题时,习惯分步骤思考。思维链(CoT) 正是让 AI 学会了“打草稿”,将黑盒逻辑转化为线性的推理流。

但这还不够。面对死胡同怎么办?思维树(ToT) 允许智能体像人类一样进行多路径探索:分解问题、生成多个想法、自我评估,甚至在发现错误时回溯(Backtracking),在无数种可能性中寻找最优解。

2. ReAct:知行合一的闭环

单纯的思考容易空想(幻觉),单纯的行动容易盲目。ReAct (Reason + Act) 框架提出了“推理-行动”的交响曲:

Thought: 用户在上海,问天气。

Action: 调用天气 API 查询上海。

Observation: 返回 25℃。

Thought: 结合数据,回答用户。

这种闭环机制,让智能体不再是“书呆子”,而是能根据环境反馈实时修正策略的“实干家”。

3. Reflexion:失败是成功之母

人类之所以聪明,是因为能从错误中学习。Reflexion 机制赋予了智能体“反思”的能力。当任务失败,它不会死机,而是生成一段“自我检讨”,存入记忆。下一次遇到类似情况,它会调取这段教训,避免重蹈覆辙。

03. 记忆与知识:构建“领域专家”

为什么通用的 GPT 无法直接替代资深律师或金融分析师?因为它缺乏垂直领域的深度记忆。

RAG(检索增强生成) 是目前的最佳实践。它就像给考试的大模型发了一本“开卷书”。当遇到专业问题,先去向量数据库(Vector DB)里翻书,找到答案再回答。

但这还不够。微软的 GraphRAG 引入了知识图谱,让智能体不仅能检索“点”的信息,还能理解“线”的关系(如供应链上下游的法律风险)。

💡 行业启示录:

- 金融领域:FinGPT 利用数据飞轮,结合情感分析与数值推理,甚至能模拟“多智能体辩论会”,让风控与激进策略博弈,从而做出更优投资决策。

- 法律领域:Harvey AI 采用“隐私优先”架构,将 AI 嵌入合同审查工作流,不再是简单的问答,而是变成了一丝不苟的法律助理。

04. 手握工具:从数字世界走向物理荒原

智能体与聊天机器人最大的区别,在于“执行力”。

在数字世界,代码解释器(Code Interpreter) 是通用的万能胶。它让 AI 写 Python 代码来处理 Excel、剪辑视频、分析数据。

而在游戏与物理世界,具身智能(Embodied AI) 正在上演进化的奇迹。

还记得 Minecraft 里的 Voyager 吗?它是一个没有预设目标的终身学习者。

- 它会自己给自己布置作业(“我需要把石镐”);

- 它会把学会的动作写成代码存入“技能库”;

- 下一次,它直接调用技能库,就像《黑客帝国》里瞬间学会开直升机一样。

Voyager 证明了:智能体可以通过代码积累程序性知识,实现自我进化。

![Image: Voyager在Minecraft中探索的示意图]

05. 现实的骨感:评测与挑战

尽管 Demo 很酷,但我们要清醒地看到,智能体距离大规模商用还有“最后一公里”。

GAIA 和 SWE-bench 等硬核评测揭示了残酷的真相:

- 处理真实复杂的 GitHub 代码库时,顶尖模型的解决率也仅在 40%-50% 徘徊。

- 在简单的问答中表现完美,但在长程任务中,一步错,步步错(级联错误)。

三大拦路虎:

- 可靠性鸿沟:95% 的准确率在企业级应用中往往意味着不可用。一次“幻觉”导致的错误交易,后果可能是灾难性的。

- 成本与延迟:为了“深思熟虑”,智能体需要反复调用大模型,Token 成本和等待时间成倍增加。

- 安全风险:当 AI 有了行动力,提示注入攻击(Prompt Injection)可能诱导它执行恶意操作。我们需要构建“AI 宪法”和“数字良心”系统。

结语:迈向 AGI 的必经之路

智能体不是一个简单的技术热点,它是通往通用人工智能(AGI)的最具潜力的路径。

未来的智能体,将不再是单一的工具,而是拥有自主进化能力的物种;它们将组成群体智能网络,像人类社会一样分工协作;它们将建立世界模型,在内心模拟未来。

从“工具”到“伙伴”,从“执行”到“自主”。我们正站在计算历史上最激动人心的十字路口。

参考资料:本文基于《迈向自主智能:基于大语言模型的智能体技术架构、应用范式与评测体系深度研究报告》整理撰写。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录