为什么ChatGPT这么强?—— 一文读懂ChatGPT原理!

免责声明

笔者工作和学历均与AI无关,对NLP的理解比较有限,因此无法保证本文中所有内容都是正确的。笔者非常欢迎大家能够指出文中的错误。

此外,文中配图均来自网络,版权归原作者所有,如果不希望自己的图被使用的话可联系删除。

前言

最近一周多的时间,只要不是生活在火星,技术爱好者一定都被OpenAPI的ChatGPT给刷屏了。ChatGPT与过往公开提供服务的对话机器人相比,性能有了明显的增强。它可以相对可靠的提供一些日常对话、知识获取的功能,也可以它根据人类提供的需求帮忙写文档、写代码,甚至可以修改文本中的各类错误或者代码中的Bug。

我相信很多非AI圈的同学肯定会有一种“为什么AI突然变得这么强?“的感受。这篇文章的目的也是为了回答这个问题。在开始之前,我觉得有必要先表达一个我自己的观点:NLP技术发生跨越式发展的标志并不是ChatGPT本身,而应该是2017年-2020年间相继被提出的Transformer[1]和GPT系列[2][6]。

ChatGPT是Transformer和GPT等相关技术发展的集大成者。总体来说,ChatGPT的性能卓越的主要原因可以被概括为三点:

- 使用的机器学习模型表达能力强。

- 训练所使用的数据量巨大。

- 训练方法的先进性。

我们接写下来将会针对这三点进行一一探讨。

机器学习模型

在步入正题之前,我们可以先大致理一下NLP发展的历史。

基于文法的模型

这个阶段,大家处理自然语言的主要思路就是利用语言学家智慧尝试总结出一套自然语言文法,并编写出基于规则的处理算法进行自然语言处理。这个方法是不是乍听起来还行?其实我们熟悉的编译器也是通过这种方法将高级语言编译成机器语言的。可惜的是,自然语言是极其复杂的,基本上不太可能编写出一个完备的语法来处理所有的情况,所以这套方法一般只能处理自然语言一个子集,距离通用的自然语言处理还是差很远。

基于统计的模型

在这个阶段,大家开始尝试通过对大量已存在的自然语言文本(我们称之为语料库)进行统计,来试图得到一个基于统计的语言模型。比如通过统计,肯定可以确定“吃”后面接“饭”的概率肯定高于接其他词如“牛”的概率,即P(饭|吃)>P(牛|吃)。

虽然这个阶段有很多模型被使用,但是本质上,都是对语料库中的语料进行统计,并得出一个概率模型。一般来说,用途不同,概率模型就不同。不过,为了行文方便,我们接下来统一以最常见语言模型为例,即建模“一个上下文后面接某一个词的概率“。刚才说的一个词后面接另一个词的概率其实就是一元语言模型。

模型的表达能力

在这里,我们很适合插播一下模型表达能力这个概念。

模型表达能力简单来说就是模型建模数据的能力,比如上文中的一元语言模型就无法建模“牛吃草”和“我吃饭”的区别,因为它建模的本质统计一个词后面跟另一个词的概率,在计算是选“草”还是选“饭”的时候,是根据“吃”这个词来的,而“牛”和“我”这个上下文对于一元语言模型已经丢失。你用再多的数据让一元语言模型学习,它也学不到这个牛跟草的关系。

模型参数数量

有人说,既然如此,为啥我们不基于更多的上下文来计算下一个词的概率,而仅仅基于前一个词呢?OK,这个其实就是所谓的n元语言模型。总体来说,n越大,模型参数越多,表达能力越强。当然训练模型所需要的数据量越大(显然嘛,因为需要统计的概率的数量变多了)。

模型结构

然而,模型表达能力还有另一个制约因素,那就是模型本身的结构。对于基于统计的n元语言模型来说,它只是简单的统计一个词出现在一些词后面的概率,并不理解其中的各类文法、词法关系,那它还是无法建模一些复杂的语句。比如,“我白天一直在打游戏”和“我在天黑之前一直在玩游戏“两者语义很相似,但是基于统计的模型却无法理解两者的相似性。因此,就算你把海量的数据喂给基于统计的模型,它也不可能学到ChatGPT这种程度。

基于神经网络的模型

上文提到,统计语言模型的主要缺点是无法理解语言的深层次结构。曾有一段时间,科学家们尝试将基于文法的模型和基于统计的模型相结合。不过很快,风头就深度神经网络抢了过去。

RNN & LSTM

刚开始,流行的神经网络语言模型主要是循环神经网络(RNN)以及它的改良版本LSTM。

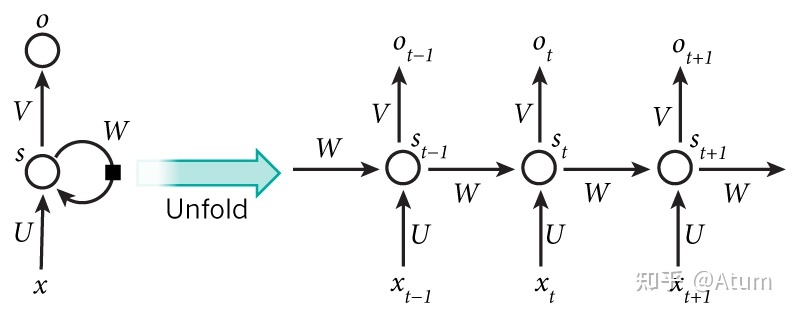

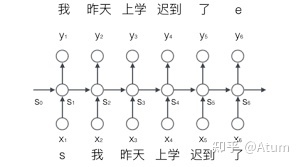

RNN的主要结构如下, x是输入,o是输出,s是状态。

如果RNN作为语言模型的话,那x可以作为顺序输入进去的词汇,而o就可以作为输出的词汇,而s就是通过x计算o的过程中生成的状态变量,这个状态变量可以理解为上下文,是对计算当前词汇时前文所有出现过的所有单词的浓缩并在一次次的计算中不断迭代更新。这也是为啥RNN可以建模词与词关系的根本原理。

与简单的基于统计的模型相比,循环神经网络的主要亮点就是能够对一段文字中不同词之间的关系进行建模,这种能力在一定程度上解决了基于统计的模型无法理解深层次的问题。

Attention Mechanisms

在更进一步之前,我们不得不提一下注意力(Attention)机制。

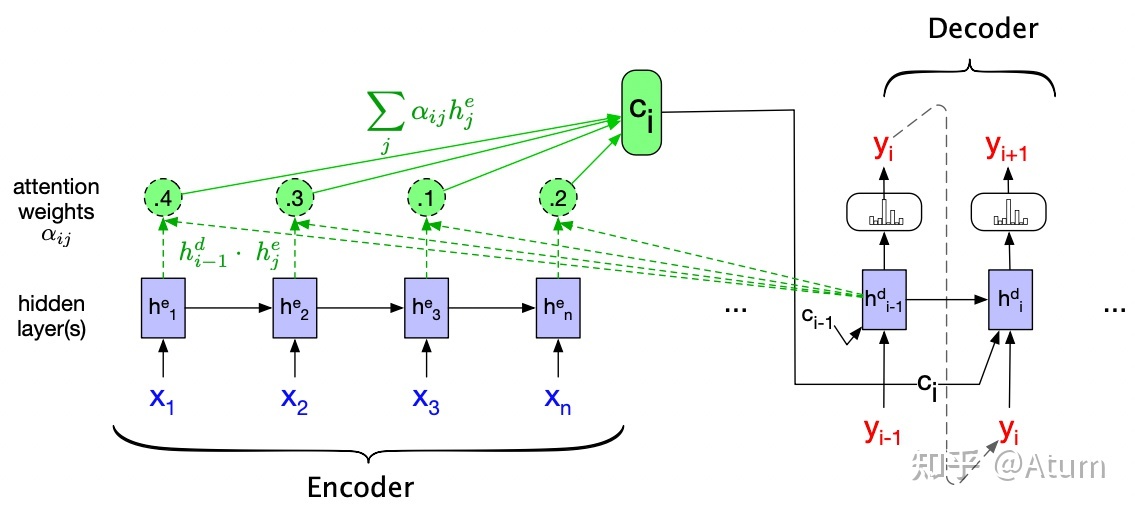

这个机制主要是对RNN在语言模型中状态S作为上下文这一机制进行了改进。在RNN中计算当前词后的状态Si主要是通过计算上一个词时的状态Si-1迭代出来的。它的主要缺点就是它假设距离较近的词汇之间的关系更密切。但是我们都知道,在自然语言中,这一假设并不是一直成立。引入Attention之后,计算第i个词后的状态从单纯的Si变成了S0,S1...Si的组合,而具体“如何组合”,即哪个状态比较重要,也是通过数据拟合出来的。在这样的情况下,模型的表达能力又得到了进一步的加强,它可以理解一些距离较远但是有非常密切的词汇之间的关系,比如说代词和被指代的名词之间的关系。

Transfomer

接下来,我们终于可以祭出之前提过的NLP跨越式发展的标志之一,Transformer的提出!

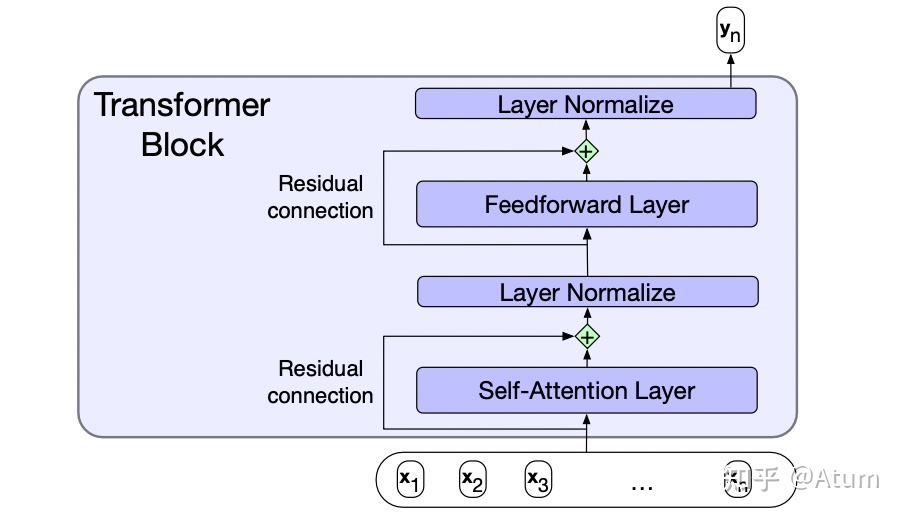

其实在有了Attention之后,Transfomer的提出已经是顺理成章了。Transfomer的主要贡献在于

1. 将Mutl-Head Attention直接内建到网络中。所谓Mutl-Head Attention其实就是多套并行的Attention,可以用于建模的词与词之间的多种关系。

2. 利用专用位置编码来替代之前RNN用输入顺序作为次序,使得并行计算成为了可能。

举一个形象但不准确的例子,对于句子I offen play skating board which is my faviorate sport. 如果使用Mutl-Head Attention,那就可以有一套Attention专门用来建模play和skating board的谓宾关系,有一套Attention用来建模skating board与favrorte的修饰关系。从而使得模型的表达能力又得到了加强。

ChatGPT所依赖GPT3.5语言模型的的底层正是Transfomer。

训练数据

OK,我们现在有一个名为Transformer模型了,这个模型通过Multi-head Attention,使得建立词语词之间的复杂关系成为了可能。因此可以说是一个表达力很强的语言模型了。然而,单有语言模型没有数据就是巧妇难为无米之炊。

GPT-3.5的相关数据并未被公开。我们就只说说它的上一代GPT-3。GPT-3整个神经网络就已经有1750亿个参数了。这不难理解,想一想Attention凭什么确定在当前上下文下哪些词比较重要?而网络又怎样通过Attention和输入生成输出?这些都是由模型里面的参数决定的。这也是为啥模型结构一样的情况下参数越多表达能力越强。那这些模型的参数怎么拿到?从数据中学习!其实大多数所谓的神经网络的学习就是在学参数。

好家伙,要训练1750亿个参数的神经网络要喂多少数据呢?这么多!(from wikipedia)

Dataset | # Tokens | Weight in Training Mix |

|---|---|---|

Common Crawl | 410 billion | 60% |

WebText2 | 19 billion | 22% |

Books1 | 12 billion | 8% |

Books2 | 55 billion | 8% |

Wikipedia | 3 billion | 3% |

可以预想,表达能力如此之强的模型,在喂入万亿级的数据之后,其对语言本身的理解已经开始接近人类了。比如它在处理句子的时候,会通过训练Attention参数理解到句子中哪些词之间是有关系的?哪些词和哪些词之间是同义的?等一系列比较深度的语言问题。

这还只是2020年的GPT-3。如今已经2022年,相信GPT-3.5的模型表达能力比GPT-3又有相当大的提升。

训练方法

监督学习 vs 无监督学习

简单来说,监督学习就是在“有答案”的数据集上学习。如果我们要用监督学习训练一个中文到英文机器翻译模型,我们就需要有中文以及其对应的英文。整个训练过程就是不断的将中文送入到模型中,模型会给出一个英文的输出,这个时候我们对比一下英文的输出与标准答案的差距远不远(Measured by Loss Function),如果差距比较大,那我们就调整模型参数。这也是早期的针对机器翻译模型的训练方法。

迁移学习

然而,“有答案”的数据终究是有限的。这也是限制之前很多自然语言学习的模型设计复杂度的原因。不是不想把模型的表达能力提上去,而是提上去之后,参数太多,我们没有足量的“带标签”的数据来训练这个模型。

2018年,另一个我认为NLP跨越式发展的标志来了,那就是GPT的提出。

GPT的主要贡献在于,它提出了自然语言的一种新的训练范式。即现通过海量的数据的无监督学习来训练一个语言模型。正如我们之前提到过的,所谓语言模型即是在一个上下文中预测下一个词,这个显然是不需要带有标注的数据的,现有的任何语料都可以作为训练数据的。由于GPT的底层借用了表达能力很强的Transformer,互联网经过长时间的发展,海量的无标记的自然语言数据也并不再是稀缺的事物。导致了训练出来的模型其实对语言有了相当深入地理解。因此模型的最后一层通常也被称为contextual emebedding。

这个时候,如果你想让这个语言模型能够做文本摘要,你只需要在模型的最后一层接一个全连接层,并用少量的数据做监督学习,即可以让他学会文本摘要。这个过程也被称为微调(fine-tune)。它是一种迁移学习(Transfer Learning)。

上下文学习

2020年,Open AI发表论文[6]正式推出了GPT3。GPT3的主要贡献在于提出了大模型的上下文学习(In-Context Learning)的能力。所谓上下文学习,简单来说就是通过向模型喂入一个提示(prompt),并选择性的加入少量的任务的样例,模型之后就可以利用Language Model的预测下一词的形式自动生成相关任务的答案。

相比上一节提到的基于Fine-tune的迁移学习,上下文学习主要了提升了零样本(Zero-shot)和少样本(Few-shot)任务的能力。Fine-tune还是需要一定数量的带标签的数据做监督学习的,但上下文学习就只需要及少量甚至完全不需要。这也为ChatGPT能够应对各种各样不同的问题提供了可能性。

值得一提的是,上下文学习是只有大模型(模型参数数量>40B)中才会出现的,因此学术界把这一类大模型才有的能力定义为突现能力(emergent ability)[7]

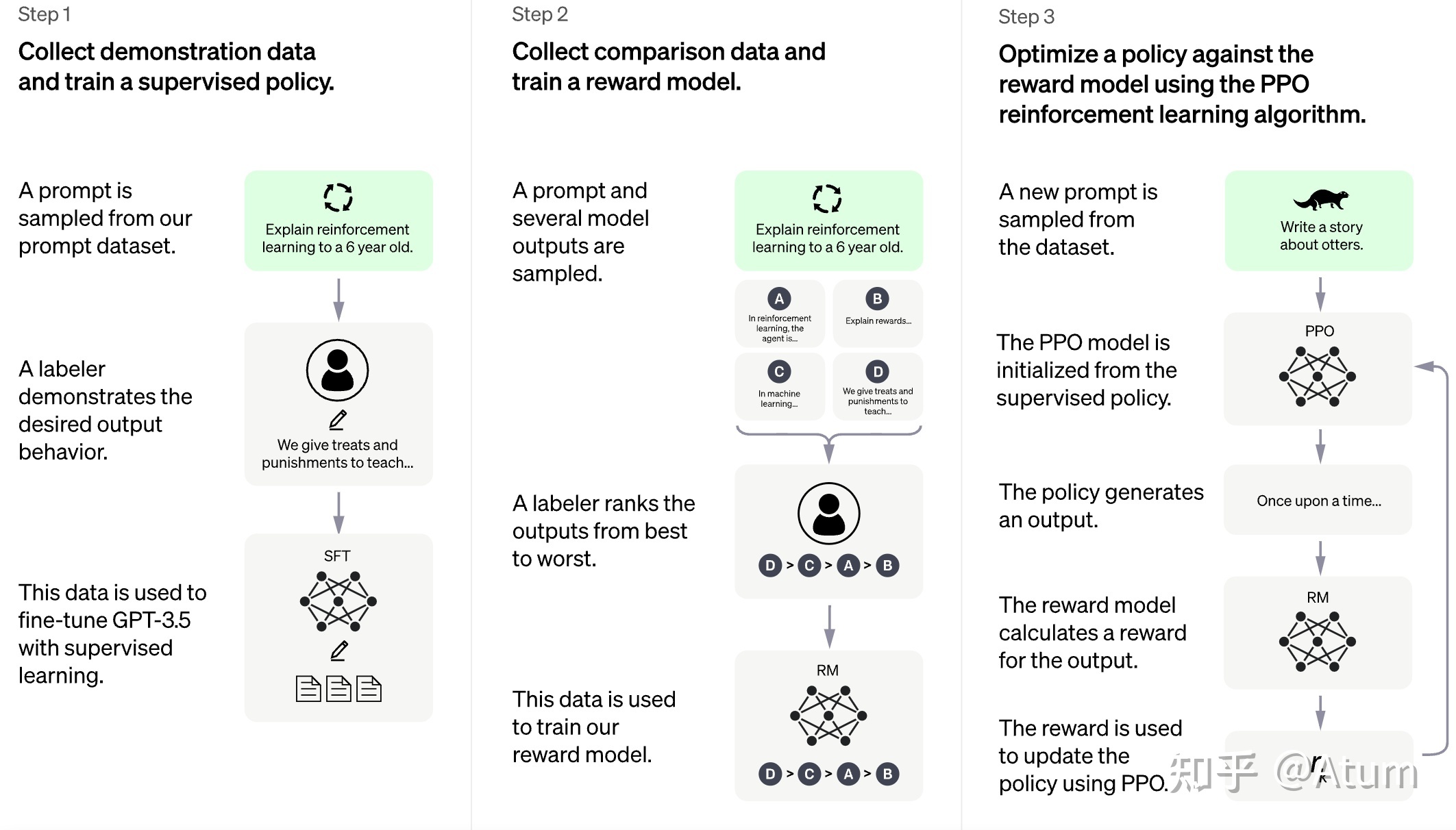

指令微调与强化学习

ChatGPT的目标是根据用户输入生成回复。在上下文学习的情况下,从输入输出的形式上来看,生成回答本身与语言模型是完全兼容的,都是根据一定的上下文生成一段文字。但是,生成回复和语言模型的内在目标却是不一致的,语言模型致力于在一定上下文下预测可能性最大的下一个词汇,而生成回复则是致力于生成一个人类认为比较满意的回答。为了解决这个不一致性。ChatGPT在还使用了一种叫reinforcement learning from human feedback (RLHF)的技术。

其总体原理如下图所示,首先利用一系列问答对模型进行监督训练(这个操作也叫监督指令微调)。在完成监督指令微调后,就开始利用强化学习对模型进行进一步的指令微调,具体地,首先在人类的帮助下训练一个奖罚网络,这个奖罚网络具有对多个聊天回复好坏进行排序的能力。接着,利用这个奖罚网络进一步优化了聊天模型。该训练方法的细节可以参考论文[3]

在这一通操作之后,ChatGPT就变成了我们现在看到的这样子。

其他

至此,我们基本上就已经能明白为什么ChatGPT这么强了,但是我相信很多同学肯定会表示“就这?我不信,它都会改bug了,给他一段代码他都知道代码是干什么的了。”

Okay,我们可以首先解释一下为什么它能改代码,根据OpenAI提供的信息 :"GPT-3.5 series is a series of models that was trained on a blend of text and code from before Q4 2021.",我们可以知道GPT-3.5中的训练数据其实是包含了海量的代码数据。所以说GPT-3.5对代码的理解也是相当强的。在论文[4]可以看到,将代码放到语言模型中训练后,训练出来的语言模型已经可以做到代码语义级的搜索了。

那ChatGPT又是怎么知道代码的功能呢?目前我还没看到相关论文,不过可以参考一下OpenAI在GPT-3上做的代码训练的工作[5],大概就是将代码和其功能docstring注释放在一起做对比训练,这样可以让语言模型理解代码和其功能的关系。

总结

总之,ChatGPT并没有那么神秘,它本质上就是将海量的数据结合表达能力很强的Transfomer模型结合,从而对自然语言进行了一个非常深度的建模。对于一个输入的句子,ChatGPT是在这个模型参数的作用下生成一个回复。

有人会发现ChatGPT也经常会一本正经胡说八道,这也是这一类方法难以避免的弊端。因为它本质上只是通过概率最大化不断生成数据而已,而不是通过逻辑推理来生成回复。

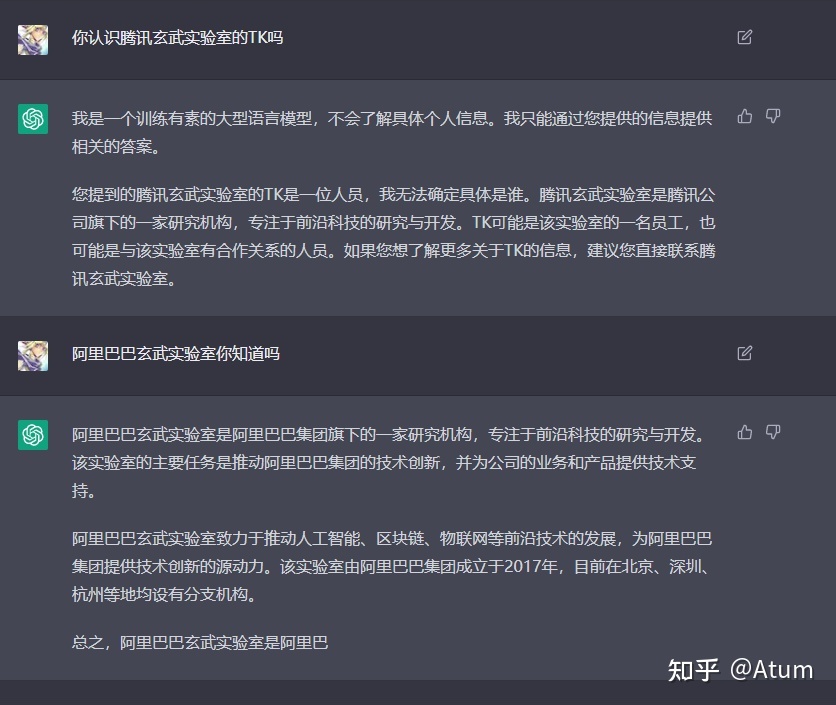

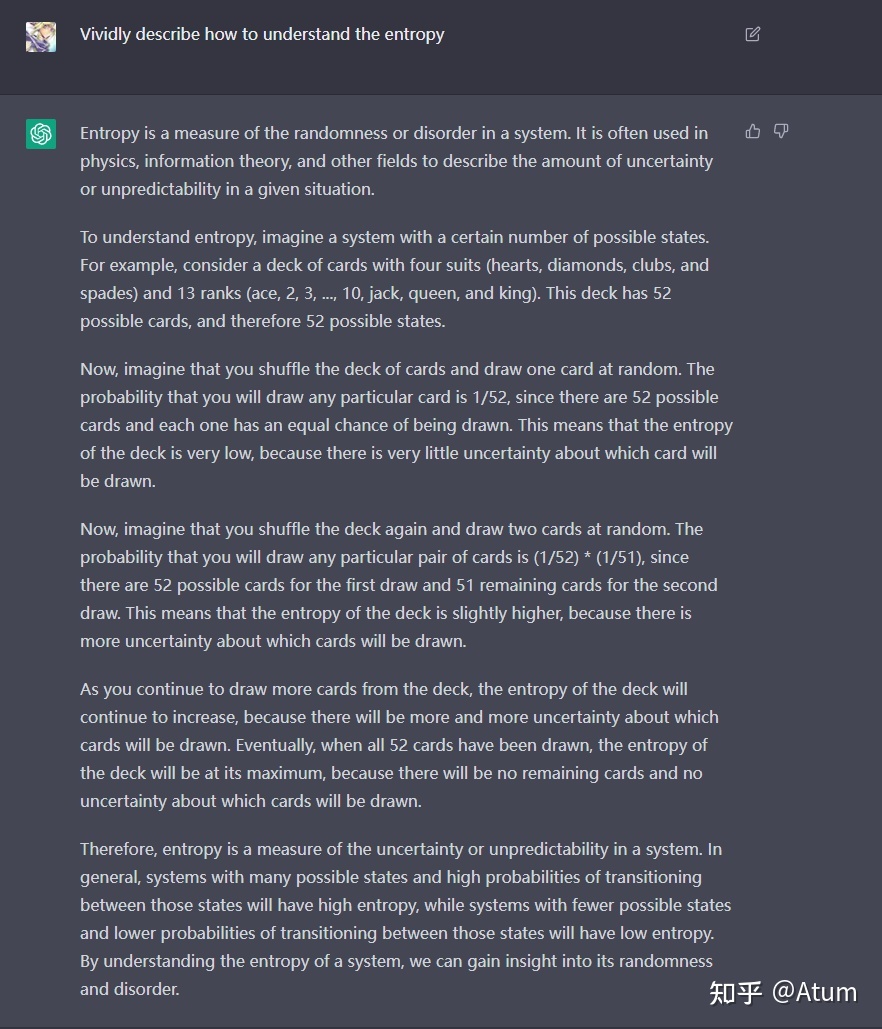

如图,向ChatGPT询问技术问题都不一定能得到靠谱的回答。

Reference

- Vaswani, Ashish, et al. "Attention is all you need." Advances in neural information processing systems 30 (2017).

- Radford, Alec, et al. "Improving language understanding by generative pre-training." (2018).

- Ouyang, Long, et al. "Training language models to follow instructions with human feedback." arXiv preprint arXiv:2203.02155 (2022).

- Chen, Mark, et al. "Evaluating large language models trained on code." arXiv preprint arXiv:2107.03374 (2021).

- Neelakantan, Arvind, et al. "Text and code embeddings by contrastive pre-training." arXiv preprint arXiv:2201.10005 (2022).

- Brown, Tom, et al. "Language models are few-shot learners." Advances in neural information processing systems 33 (2020): 1877-1901.

- Wei, Jason, et al. "Emergent abilities of large language models." arXiv preprint arXiv:2206.07682 (2022).

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2022-12-08,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录