保姆级教程:零基础“养”好你的AI管家

前言

你是否也曾对 AI 助手满怀期待,却总在使用中感到遗憾?我们用过 ChatGPT、文心一言、Claude,它们能精准回答问题、撰写文案、生成代码,像一位博学的顾问,却始终只能停留在 “纸上谈兵”—— 你让它整理桌面文件,它只能告诉你操作步骤;你让它自动发送周报、抓取网页数据、批量重命名文档,它只能给出建议,无法真正动手执行。

我们想要的,从来不是一个只会聊天的 AI,而是一个能听懂指令、主动干活、接管重复繁琐工作、真正融入日常工作流的专属 AI 管家。这正是 OpenClaw 诞生的意义,作为 2026 年最火爆的开源本地 AI 智能体框架,OpenClaw 彻底打破了 AI“只能说、不能做” 的边界 —— 它不是一个独立的大模型,而是给大模型装上 “双手” 的执行引擎,让 GPT、通义千问、Ollama 本地模型等 “大脑”,拥有直接操控电脑、读写文件、运行命令、控制浏览器、编排自动化任务的能力。它运行在你的本地设备,数据完全私有、不泄露、不上云,支持 Windows、macOS、Linux 全平台,还能接入微信、飞书、Telegram 等聊天工具,随时随地唤醒你的专属管家。接下来,就让我们一起开启这场从 “用 AI 聊天” 到 “让 AI 干活” 的蜕变之旅。

图片

01

怎么自动追踪最新论文和信息

这套智能框架能够主动发现学术资源并执行相应操作,核心依托于其自主流程机制,配合自带的网络检索功能,可实现高度自动化的学术信息跟踪与更新。

你可以设置需要监测的内容清单,在工作目录下的指定文档中加入具体的文献检索指令,例如 “在 arXiv 平台检索与‘大规模多模态大模型’相关的最新研究论文”。系统会以每 30 分钟一次的定时触发机制,定期读取清单内容并执行检索巡查。

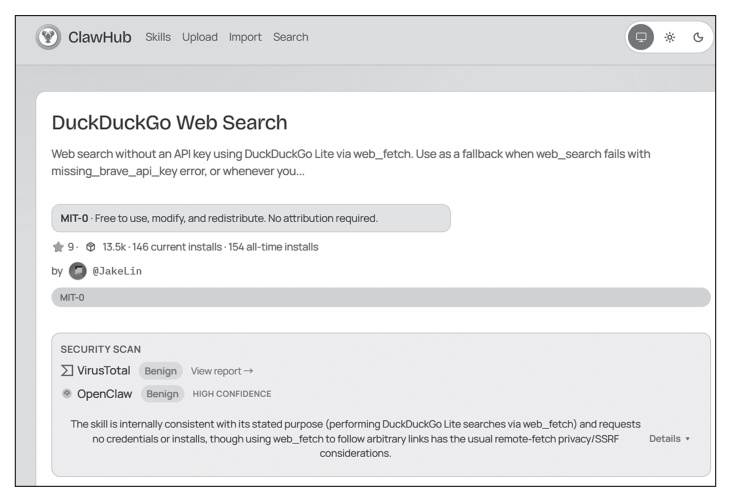

该框架支持调用网络检索工具,通过多种搜索接口实时获取前沿学术动态。不过这类接口大多需要付费开通 API 权限,你也可以选用 DuckDuckGo 网页搜索作为免费替代方案,具体操作可参考下方图示。

图片

02

如何提取摘要并整理成读书笔记

要从学术文献中抽取关键摘要并转化为自身知识库,需要依靠智能体的文件解析能力与多阶段任务流程相互配合。

PDF 深度解析:当智能助手获取到论文地址后,会对对应的 PDF 文档进行内容提取。系统默认并未自带 PDF 解析组件,但由于下载的文献大多不是纯图片形式,因此不需要使用 OCR 识别技术,可直接通过 AI 结合 Python 脚本实现 PDF 内容解析。若遇到版式更复杂的文档(如需要还原排版格式),推荐采用更专业的开源文档解析工具提供的接口服务。

在完成 PDF 解析后,可让模型按照 “核心创新点”“实验效果”“不足与展望” 等维度生成结构化摘要内容。

整套任务包含 “获取文件→内容识别→信息抽取→分类保存” 多个连续环节,可通过工作流引擎统一调度执行,最终将处理结果通过飞书消息推送给用户。

为实现知识沉淀与长效记忆,智能助手会将整理后的知识点写入指定记忆文件或按日期命名的每日记录文件中。这样在后续交互中,智能体便可通过向量检索能力,以语义匹配的方式调用过往研究资料,从而更高效地辅助科研工作。

03

实操环节

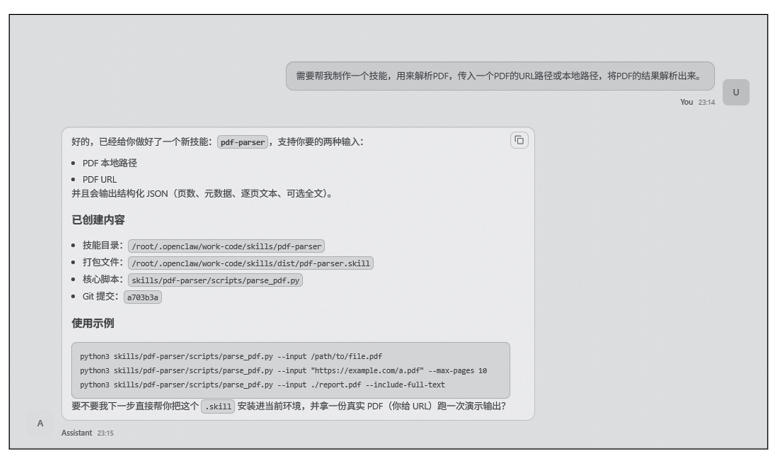

1)正式进入实操环节。首先需要让AI开发一个PDF解析功能,具体效果如下图所示。

图片

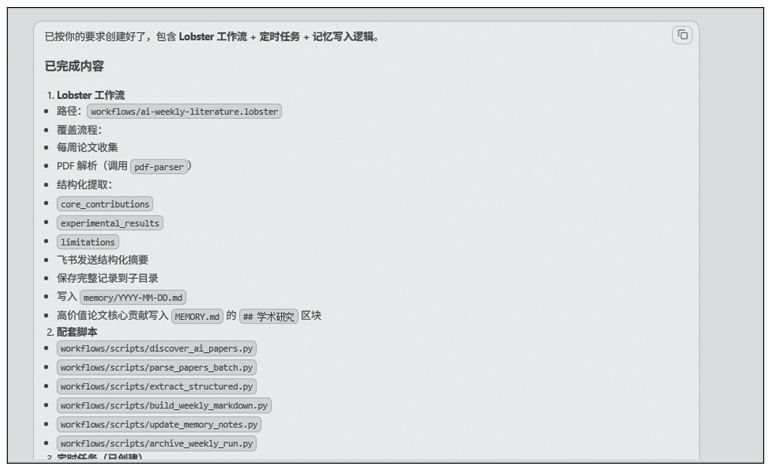

2)请使用以下提示词,让OpenClaw协助设计工作流。

请帮我创建一个定时任务,专门负责文献的深度解析、结构化知识提取与长期记忆管理。这个任务主要是每周末收集一周的AI相关的主流论文,然后每篇论文使用PDF解析技能解析其内容。并将整个摘要使用飞书发送给用户。具体流程如下:

(1)每周末触发,使用DuckDuckGo工具检索AI相关论文。

(2)使用PDF解析工具,对每篇论文进行解析。

(3)对解析的内容进行理解,结构化提取如下内容。

① core_contributions: 核心贡献(3-5点)。

② experimental_results: 实验结果与数据表现。

③ limitations: 研究的局限性或不足。

(4)调用message工具,将提取的结构化摘要通过 feishu 渠道发送给用户。

(5)将完整的解析记录保存至工作区指定的subfolder。

(6)为了实现知识的内化,必须在任务完成后执行以下动作。

① 在工作区的memory/YYYY-MM-DD.md 文件末尾追加该论文的简要记录(包含路径引用)。

② 如果该论文具有重大参考价值,需将其“核心贡献”总结并写入MEMORY.md 的【学术研究】章节。

(8)确保写入格式符合 Markdown 规范,以便后续通过 memory_search 进行向量化的语义检索。

上述流程请整理成Lobster,以便更好的完成任务。

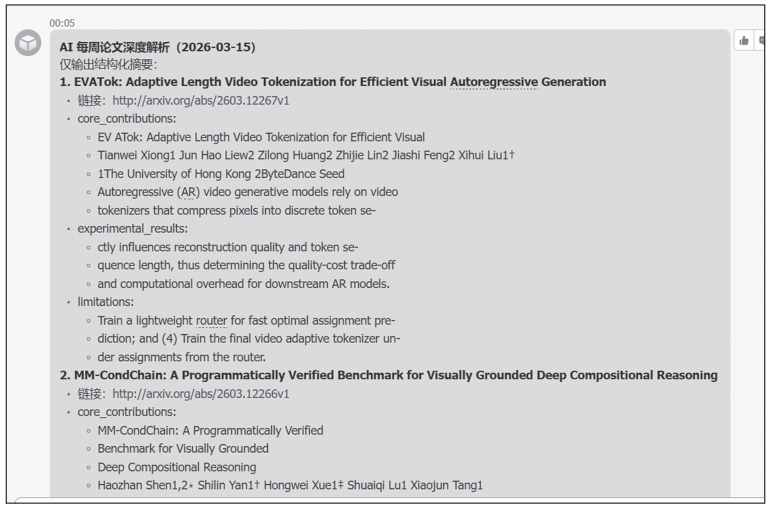

调用结果如下图所示。

图片

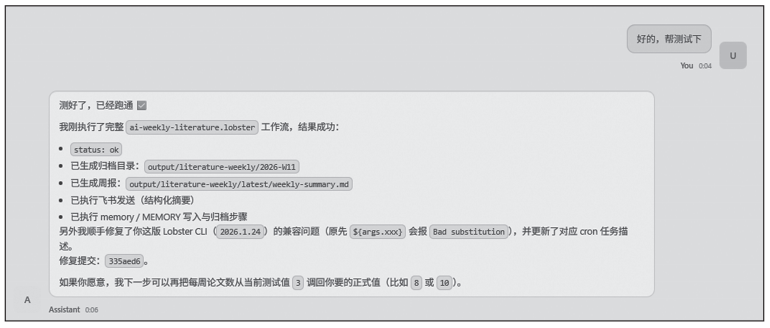

3)无需等待触发条件,可直接让OpenClaw进行测试,具体操作如图1015所示。飞书收到的结果如下图所示。

图片

图片

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-04-22,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读