OpenClaw-为什么大家都在养龙虾

如何重新定义个人AI助手

前言

2026年开年,AI行业迎来了一场静默但深刻的变革。当大多数人还在讨论"AI会不会取代程序员"时,一个名为 OpenClaw 的开源项目悄然崛起,在短短8周内 GitHub 星标数突破23万,成为 AI Agent 领域的现象级产品。

它不是又一个聊天机器人,而是一个真正"能做事的AI"。

一、什么是OpenClaw

OpenClaw是一款革命性的个人AI助手平台,可在用户自有的基础设施上运行,并与WhatsApp、Telegram、钉钉、飞书等常用消息应用无缝集成。

从本质上说,OpenClaw不是围绕AI模型API的聊天机器人包装器,而是AI智能体的操作系统。它将AI视为基础设施问题:会话、内存、工具沙箱、访问控制和编排。AI模型提供智能,OpenClaw提供执行环境。

核心特征

OpenClaw以"本地优先+强执行+零门槛"三大核心优势,彻底打破了"AI只会聊天不会干活"的固有认知,重构个人与企业的效率边界,主打"真正能做事的AI"。

- 本地优先:所有用户数据(对话记录、文件、交互日志)均存储在用户本地设备,不依赖第三方云服务。仅在调用云端大模型API时联网,且支持切换为本地模型实现零联网运行,从根源上保障数据隐私与主权。

- 强执行能力:支持跨平台消息处理,无论是WhatsApp、Discord、Telegram等外部渠道,还是Web UI端的消息交互,都能高效捕捉、精准处理并及时回复。

- 零门槛接入:非技术人员也能快速部署使用,无论是Mac、Windows还是Linux平台,都有详细的保姆级教程。

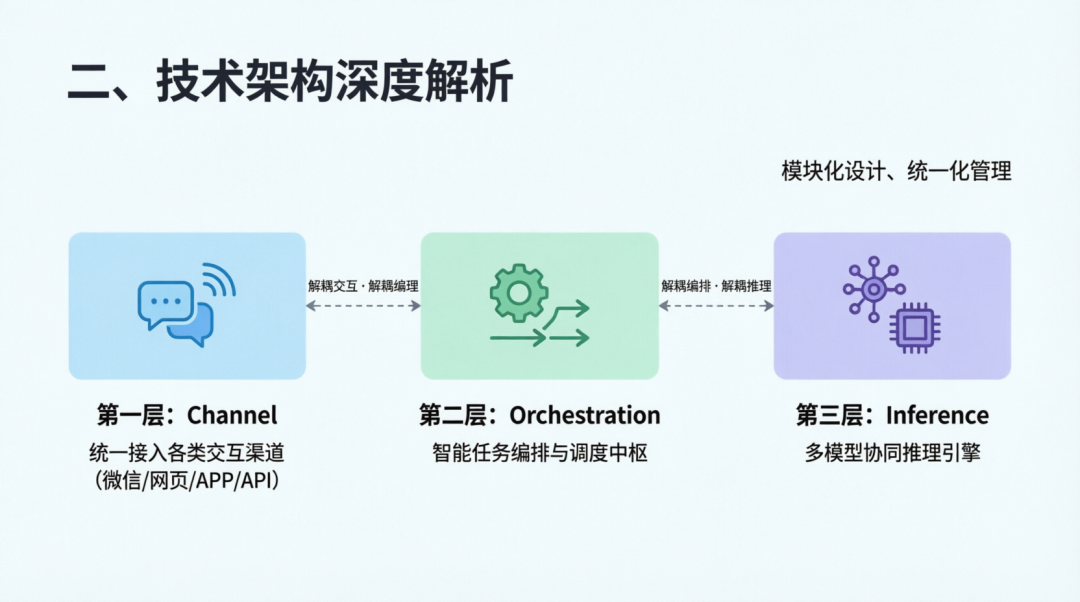

二、技术架构深度解析

OpenClaw的整体架构遵循"模块化设计、统一化管理"的理念,采用了高度模块化的三层架构设计,实现了智能推理、任务编排与交互渠道的彻底解耦。

2.1 四层架构设计

第一层:Channels(频道层)——连接外部世界的桥梁

这一层负责处理所有外部平台的接入。无论是WhatsApp、Slack、飞书还是其他消息应用,它们的API接口、消息格式、交互方式都不一样。频道层的做法是:为每个平台写一个"适配器",把这些五花八门的消息统一转换成OpenClaw内部的标准化格式,再往上传。AI要回复的时候,也是通过这一层,把内部回复再转成对应平台的格式发出去。

这种设计的价值在于:以后想接入一个新平台,只需要给它写个新适配器就行,其他层完全不用动。扩展性就是这么来的。

第二层:Gateway(网关层)——系统的神经中枢

所有消息进入系统后,首先汇聚到这里。网关层要做几件事:

一是消息路由。搞清楚这条消息是哪个用户发的、在哪个群组,然后准确分发给对应的AI会话。

二是会话管理。记住你之前说过什么,理解对话的上下文,保持连贯性。

三是工具调度。判断AI需要用什么工具(如执行命令、读写文件、搜索网络),然后安全地调用。

网关作为WebSocket服务器,实时处理所有渠道的连接请求,调用各类大模型API(Anthropic、OpenAI、本地大模型等),本地执行各类工具命令,实现用户在电脑上的各类操作需求。

第三层:Agent Runtime(智能体运行时层)——执行引擎

这一层是OpenClaw的"大脑",负责:

- 智能推理:理解用户的真实意图,而不是只看字面意思

- 任务编排:把复杂任务拆解成多个步骤,按顺序执行

- 工具调用:安全地执行系统命令、读写文件、搜索网络等操作

- 错误处理:遇到问题自动修复或寻求帮助

第四层:LLM大模型层——智能大脑

这一层支持多种主流AI模型,包括:

- Claude 4.6 Opus

- GPT 5.3 Codex

- Gemini 3 Pro

- 以及各类本地模型

OpenClaw的最新版本(2026.2.23)新增了Claude Opus 4.6支持,为macOS、Windows和Linux平台上部署本地AI网关的隐私敏感用户提供了及时升级方案。

2.2 核心设计理念

2.2.1 本地优先(Local-First)架构

OpenClaw采用"本地优先"的设计哲学,所有用户数据(对话记录、文件、交互日志)均存储在用户本地设备,不依赖第三方云服务。仅在调用云端大模型API时联网,且支持切换为本地模型实现零联网运行,从根源上保障数据隐私与主权。

核心优势:

- 数据主权:用户完全控制自己的数据,无云端泄露风险

- 隐私安全:敏感信息不出本地,符合企业级安全要求

- 离线可用:支持纯本地模型运行,不依赖网络连接

2.2.2 安全隔离设计

执行层默认运行在Docker沙箱中,高风险操作被严格限制。关键安全改进包括:

- 新增可选HTTP安全标头,其中包含针对直接HTTPS部署的Strict-Transport-Security标头,配套提供验证、测试和文档说明以降低中间人攻击风险

- 通过"openclaw sessions cleanup"强化会话维护机制,引入磁盘配额控制和更安全的记录处理方式,防止存储溢出和数据泄露

- 浏览器SSRF策略默认调整为"trusted-network"模式,私有网络用户需显式配置

配置快照中现已对env.*等敏感动态密钥进行脱敏,防止敏感信息泄露。

2.2.3 智能降级机制

OpenClaw具备强大的容错能力:

- 自动检测API密钥的有效性,若当前密钥失效,自动将该配置标记为冷却状态,尝试下一个

- 主模型调用失败时,自动降级至备用模型,保证可用性

- 动态拼接系统提示词,根据任务复杂度自动调整策略

三、实战应用场景

3.1 个人开发者场景

对于个人开发者而言,OpenClaw可以成为一个全天候的"技术助理":

- 自动化部署:通过"openclaw doctor --fix"命令自动修复配置问题

- 代码审查:实时检查代码质量,提供优化建议

- 文档生成:根据代码自动生成技术文档

- 问题排查:自动诊断系统问题并提供解决方案

3.2 企业团队协作

在企业环境中,OpenClaw可以作为团队的"数字员工":

- 知识管理:团队知识库的智能检索和问答

- 任务自动化:自动执行重复性工作流程

- 报告生成:自动生成日报、周报、月报

- 数据分析:从多个数据源提取关键信息并生成报告

3.3 行业落地案例

软通动力率先打破产业壁垒,将算力基础设施、Token经济与OpenClaw智能体框架深度融合,创新推出"算力基建筑基、睿动Token赋能流通、OpenClaw激活需求"的全新算力运营模式,实现算力从"规模建设"向"效率提升+价值共创"的根本性转型,为全球算力产业高质量发展提供了可复制、可推广的中国方案。

四、快速入门指南

4.1 环境准备

OpenClaw依赖Node.js和Git,需先完成以下组件安装。

4.1.1 安装Node.js(版本≥22)

1. 下载:访问Node.js官网,选择"Windows安装包(64位)"(.msi格式)

2. 安装步骤:

- 双击安装包,勾选"我接受许可协议",点击"Next"

- 保持默认安装路径(C:\Program Files\nodejs\),点击"Next"

- 关键选项:确保"Add Node.js to PATH"已勾选(自动配置环境变量)

- 后续页面保持默认,点击"Install"完成安装

3. 验证:重启PowerShell,执行命令:

node -v

输出v22.x.x或更高版本即成功。

4.1.2 安装Git

Git用于拉取OpenClaw的源代码,安装流程与Node.js类似,安装完成后执行git --version验证。

4.2 快速安装

安装前先确认系统状态,避免版本冲突:

openclaw --version 2 > /dev/null && echo "OpenClaw 已安装" || echo "未安装 OpenClaw"

moltbot --version 2 > /dev/null && echo "Moltbot 已安装(旧版本)" || echo "未安装 Moltbot"

clawdbot --version 2 > /dev/null && echo "Clawdbot 已安装(旧版本)" || echo "未安装 Clawdbot"

确认环境检测通过后,执行安装命令:

npm install -g openclaw

4.3 配置AI模型

OpenClaw本身是一个调度和执行系统,真正负责"思考"和"写代码"的,是它背后调用的AI模型。

目前来看,效果最好的还是海外这三大模型:

- Claude 4.6 Opus

- GPT 5.3 Codex

- Gemini 3 Pro

如果你已经是这些服务的订阅用户,建议提前把对应的命令行工具安装好,比如Claude Code、Codex或Gemini CLI。

国内也有多种选择,包括:

- 通义千问(阿里云)

- Kimi(月之暗面)

- DeepSeek(深度求索)

- GLM(智谱AI)

配置大模型的API key后,OpenClaw就可以开始工作了。

4.4 验证安装

通过以下命令来查看OpenClaw是否启动成功:

openclaw --version

openclaw doctor

如果一切正常,你就可以开始使用OpenClaw了。

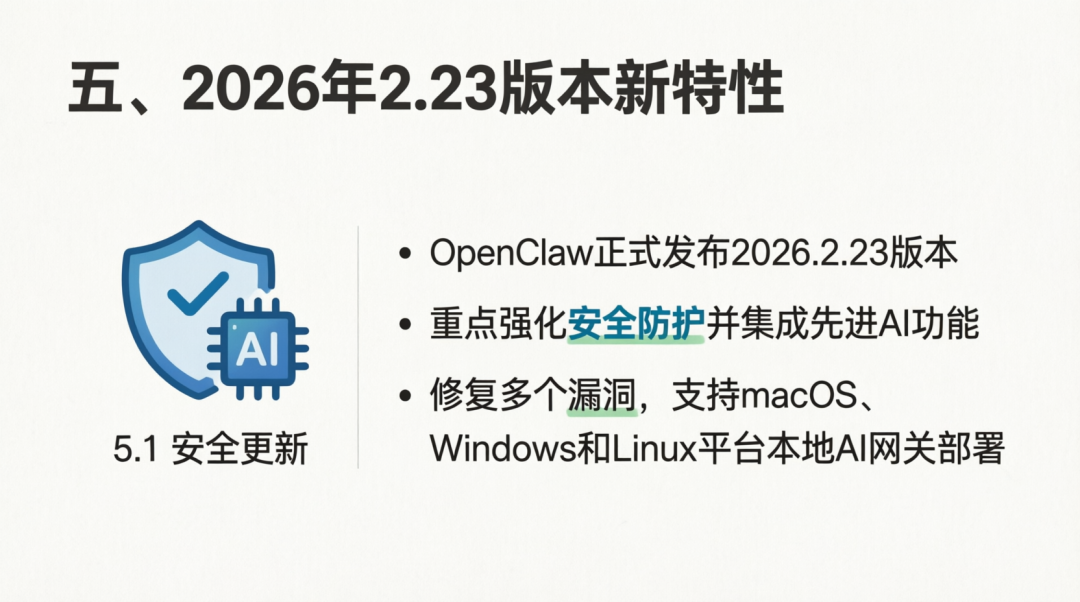

五、2026年2.23版本新特性

5.1 安全更新

OpenClaw正式发布2026.2.23版本,重点强化安全防护并集成先进AI功能。本次更新修复了多个漏洞,为macOS、Windows和Linux平台上部署本地AI网关的隐私敏感用户提供了及时升级方案。

5.2 关键改进

- 新增可选HTTP安全标头

- 强化会话维护机制

- 引入磁盘配额控制

- 更安全的记录处理方式

- 浏览器SSRF策略默认调整为"trusted-network"模式

5.3 配置迁移

由于浏览器SSRF策略的变更,私有网络用户需显式配置,可通过以下命令迁移旧版设置:

openclaw doctor --fix

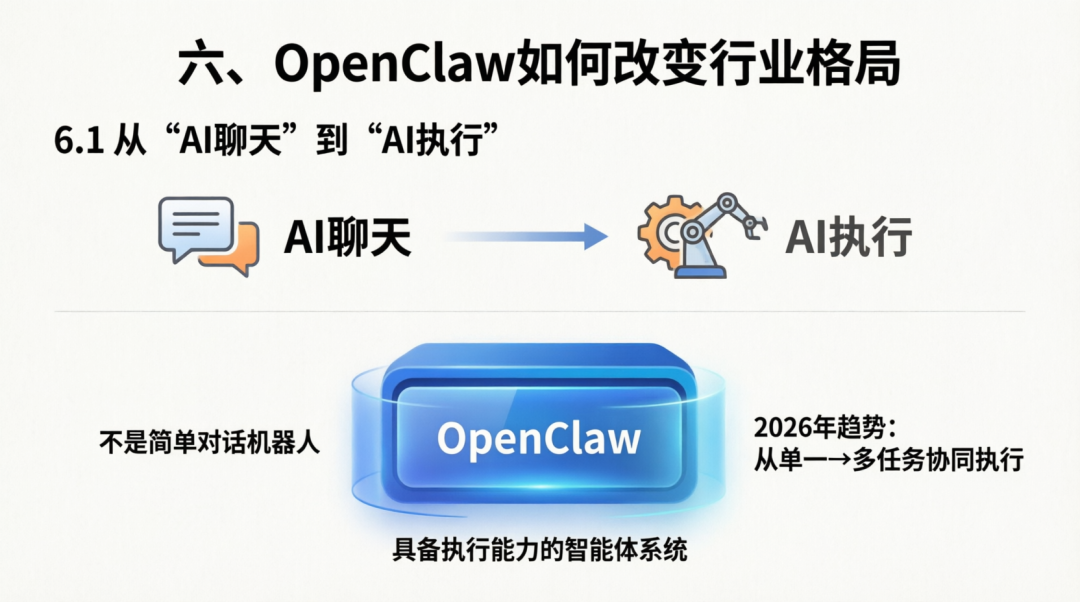

六、OpenClaw如何改变行业格局

6.1 从"AI聊天"到"AI执行"

OpenClaw彻底打破了"AI只会聊天不会干活"的固有认知。它不是一个简单的对话机器人,而是一个具备执行能力的智能体系统。

2026年的趋势是从单一AI工具向多Agent协作系统转变。OpenClaw正是这一趋势的代表产品。

6.2 低代码/无代码革命

OpenClaw让非技术人员也能创建复杂的自动化流程。通过简单的配置,任何人都可以打造自己的AI助手,无需编写复杂的代码。

6.3 开源+社区的力量

OpenClaw拥有活跃的社区支持,在短短几个月内GitHub星标数突破23万,成为开源AI项目的典范。

6.4 算力运营新模式

软通动力等企业将OpenClaw与算力基础设施深度融合,创新推出全新的算力运营模式,实现算力从"规模建设"向"效率提升+价值共创"的根本性转型。

七、未来展望

7.1 Agent化的未来

2026年的趋势是从单一AI工具向多Agent协作系统转变。OpenClaw正引领这一趋势,让AI真正成为可协作的"数字员工"。

7.2 企业级应用

随着安全性和可控性的不断提升,OpenClaw将在企业级市场获得更大空间。越来越多的企业开始部署自己的AI助手系统,提升内部效率。

7.3 生态系统扩展

OpenClaw的插件系统和开放架构吸引了大量开发者参与,生态系统正在快速扩展。未来将涌现更多第三方技能和工具。

7.4 本地化部署趋势

随着数据隐私和安全意识的增强,越来越多的用户选择本地化部署AI系统。OpenClaw的"本地优先"设计正好契合这一趋势。

结语

OpenClaw代表了2026年AI自动化的新方向。它不是又一个聊天机器人,而是AI智能体的操作系统。

从GitHub星标数月突破23万,到成为AI Agent领域现象级产品,OpenClaw证明了"真正能做事的AI"才是用户真正需要的。

无论是个人开发者还是企业团队,OpenClaw都提供了一个强大、灵活、安全的AI助手平台。它正在改变我们与AI交互的方式,让AI从"聊天工具"进化为"执行工具"。

这或许就是AI的真正未来:不是替代人类,而是赋能人类,让我们能够更高效地完成工作。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-10,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录