通俗讲解大模型短期记忆 vs 长期记忆

我们在《终于有人把“智能体”的概念给我讲明白了!》一文中深入浅出地讲解了智能体的概念。

有些同学问:智能体的 Memory 中 短期记忆(Short-term memory)与长期记忆(Long-term memory)是什么意思?有什么区别?

本文用相对通俗易懂的语言帮助大家来理解这两个概念,以及如何实现的?

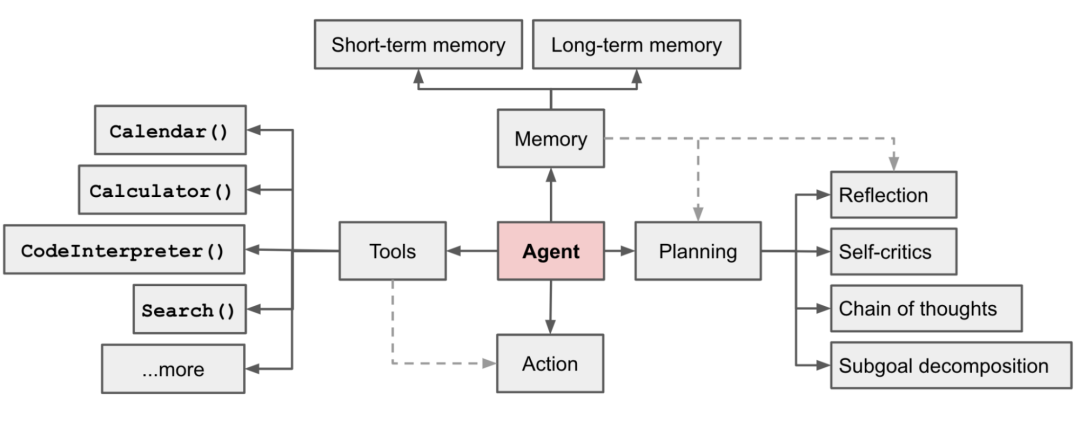

在 《LLM Powered Autonomous Agents》这篇文章中提到,大语言模型驱动的自主智能体中,大语言模型充当大脑,然后还有几个关键组件,如规划、工具、记忆。

其中记忆包括短期记忆和长期记忆。

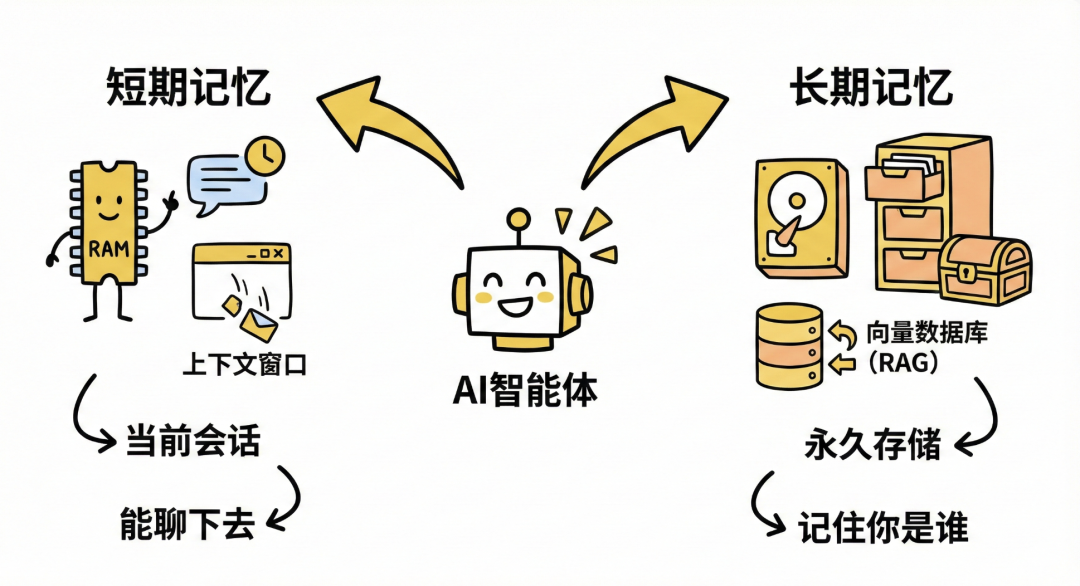

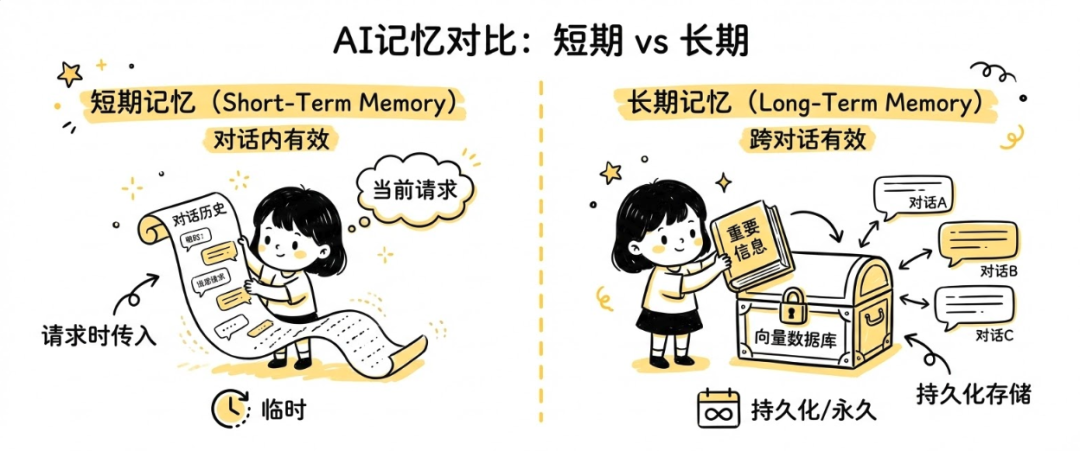

短期记忆是智能体在单一会话中维护即时上下文的能力。

- 工作机制: 它完全依赖于大模型(LLM)的上下文窗口。智能体会将之前的对话历史、中间推理步骤(如 Chain of Thought)放在 Prompt 中传给模型。

- 局限性: 随着对话变长,旧的信息会因为超出窗口限制而被丢弃或“遗忘”。

- 常见处理:

- 滑动窗口: 只保留最近的 条对话。

- 摘要法: 将之前的长对话总结成一段简短的摘要,释放窗口空间。

大模型的短期记忆其实是通过参数来维持的。我们是通过把对话的历史放在请求参数里,每次把前面的内容带上去,它才知道之前聊过什么。

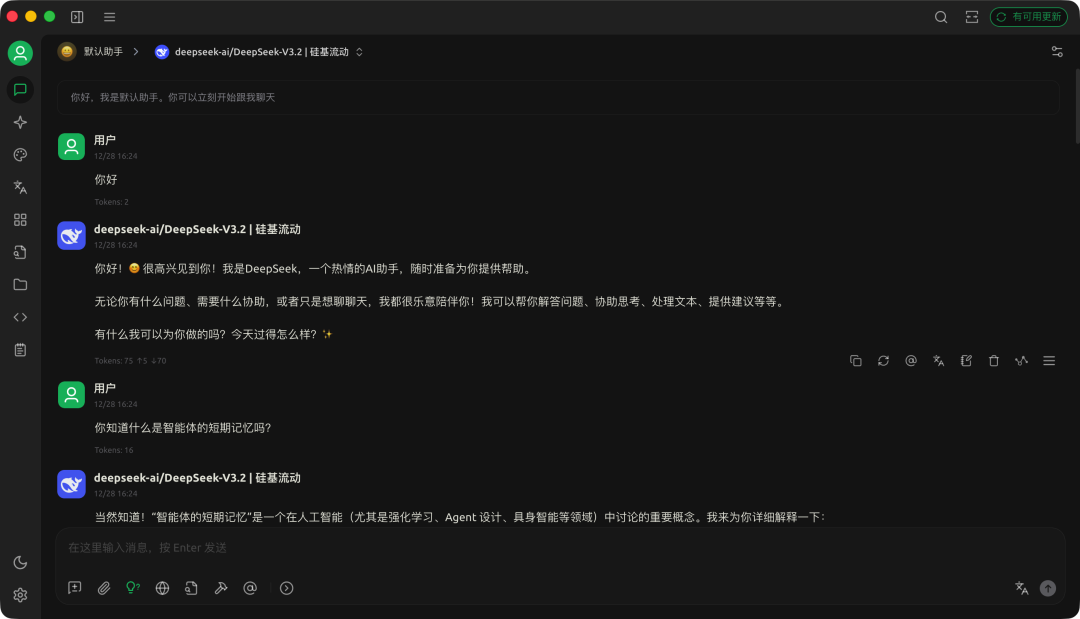

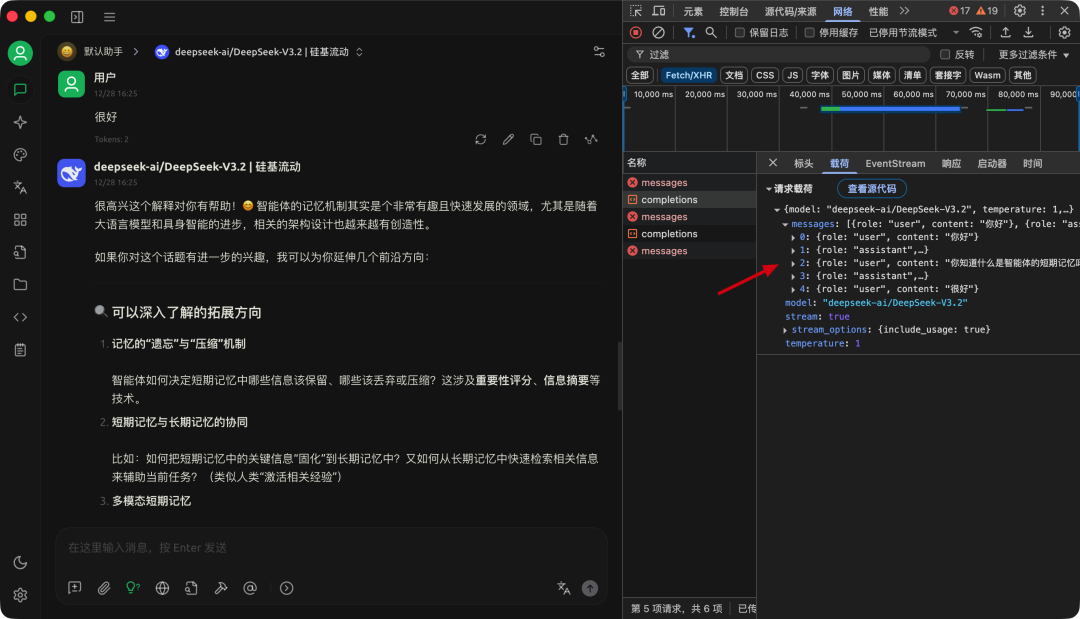

拿 Cherry Studio 为例,不管是默认助手还是我们自定义的助手,在模型设置这里都可以看到「上下文数」。

我们第一个问题是:“你好”

注:点击 Cherry Studio 客户端窗口后按下快捷键 Ctrl + Shift + I(Mac端:Command + Option + I)可以打开控制台,查看请求过程。

我们第三个问题是“很好”

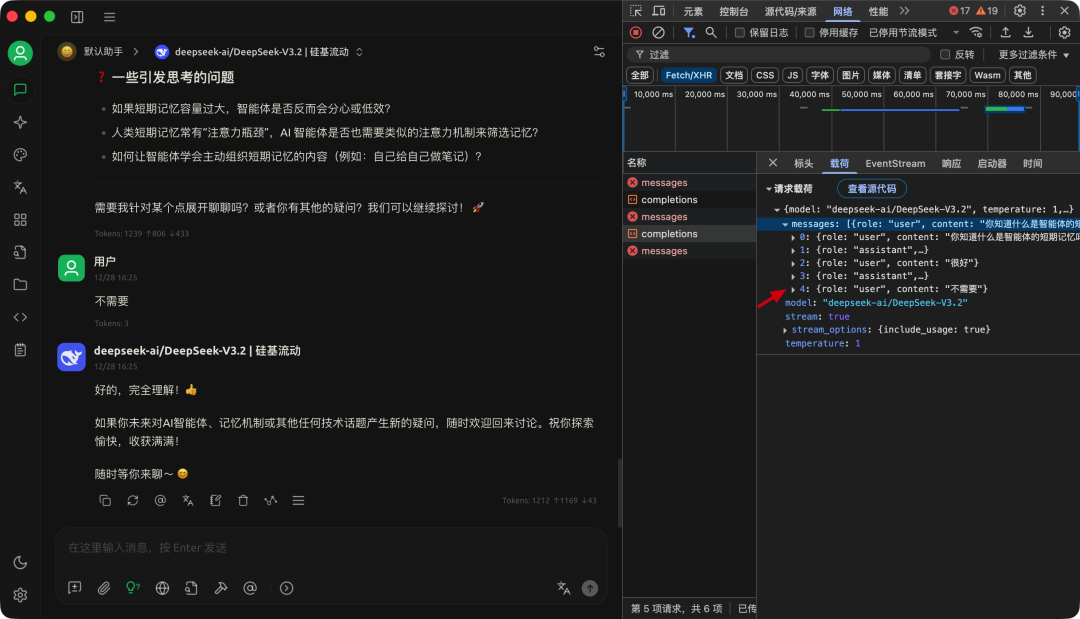

当我们问第四个问题:“不需要”时,我们可以看到我们第一个问题就被丢了!!!

这里的上下文轮数其实就是短期记忆的轮数。超过这个轮数的话,那么它就不会再发给大模型了。

有些朋友可能会问,那我们把上下文数设置长一点不就行了吗?

事情远没有想象的那么简单。

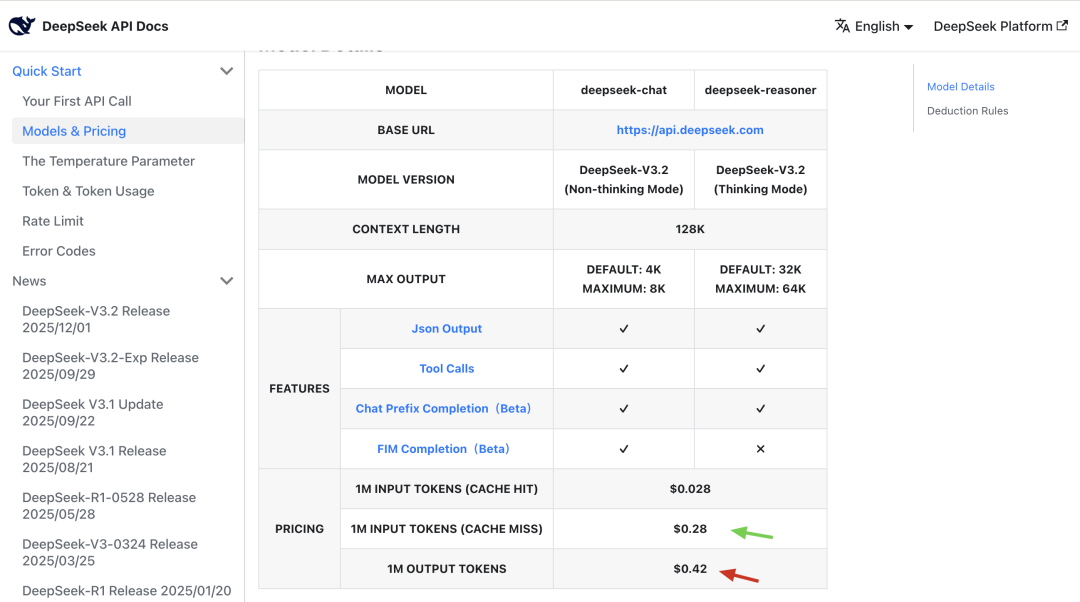

对于很多大模型来说,是按照输入和输出的 tokens 来计费的,上文越长越贵。截图来自;https://api-docs.deepseek.com/quick_start/pricing

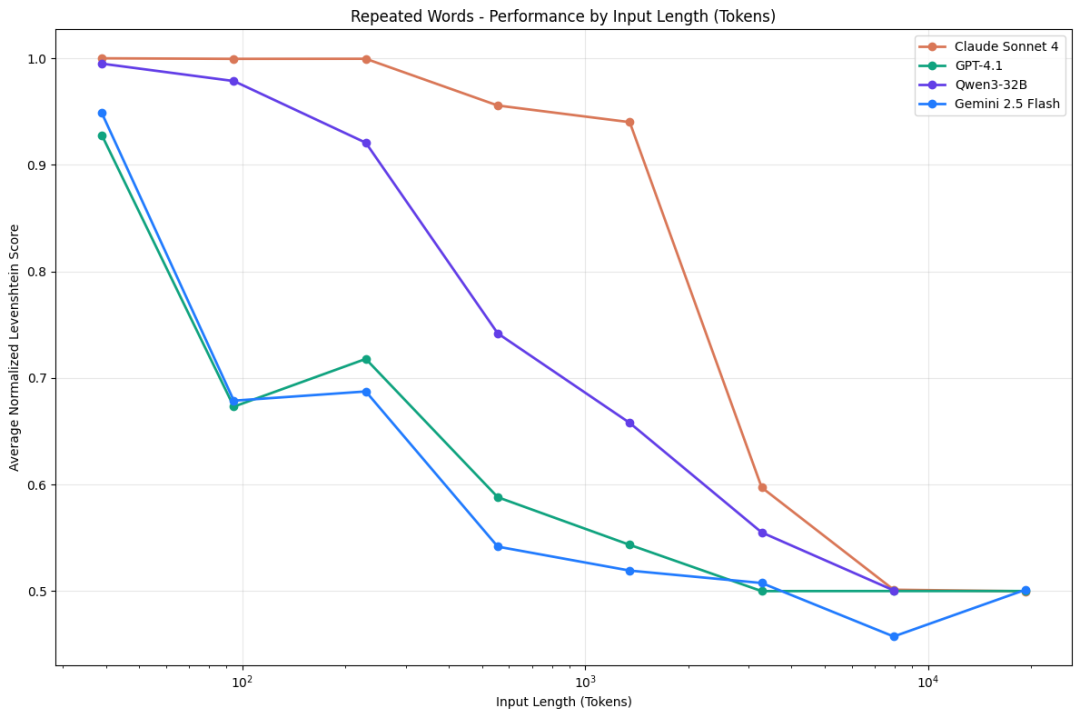

对大多数模型来说,上下文越长,能力相对来说是会普遍下降的。

详情参见:https://research.trychroma.com/context-rot

由于短期是把聊天记录当做参数传过去,所以在不同的对话中无法自动共享一些关键信息。

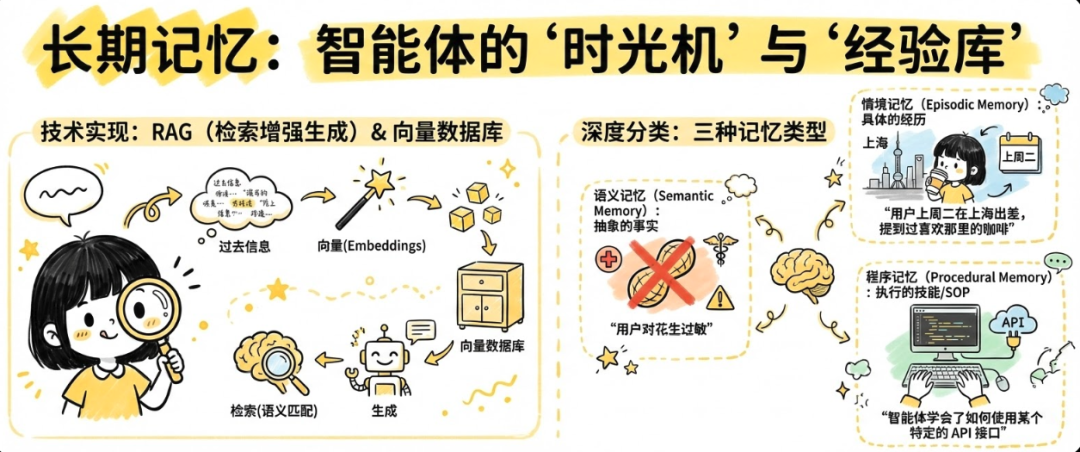

长期记忆允许智能体存储、检索和利用过去跨越数天、数月甚至数年的信息。

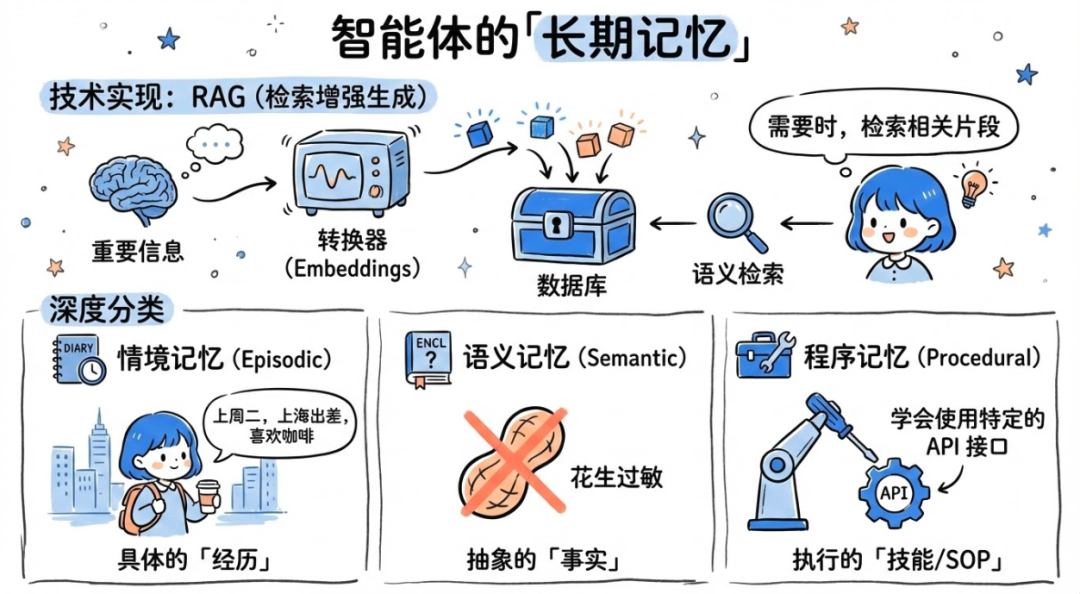

- 技术实现: 通常采用 检索增强生成(RAG) 技术。智能体将重要信息转化为向量(Embeddings)存入数据库。当需要时,通过语义匹配检索相关片段。

- 深度分类:

- 情境记忆 (Episodic Memory): 记录具体的“经历”。例如:“用户上周二在上海出差,提到过喜欢那里的咖啡”。

- 语义记忆 (Semantic Memory): 存储抽象的“事实”。例如:“用户对花生过敏”。

- 程序记忆 (Procedural Memory): 记录执行任务的“技能”或“SOP”。例如:智能体学会了如何使用某个特定的 API 接口。

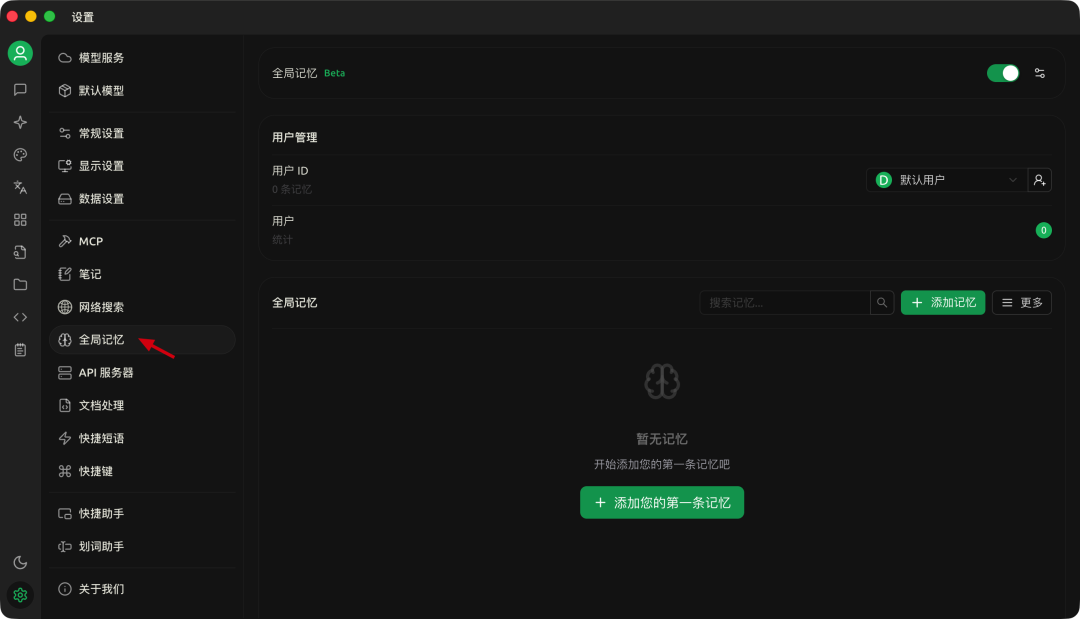

拿 Cherry Studio 为例,长期记忆是通过“全局记忆”实现的。

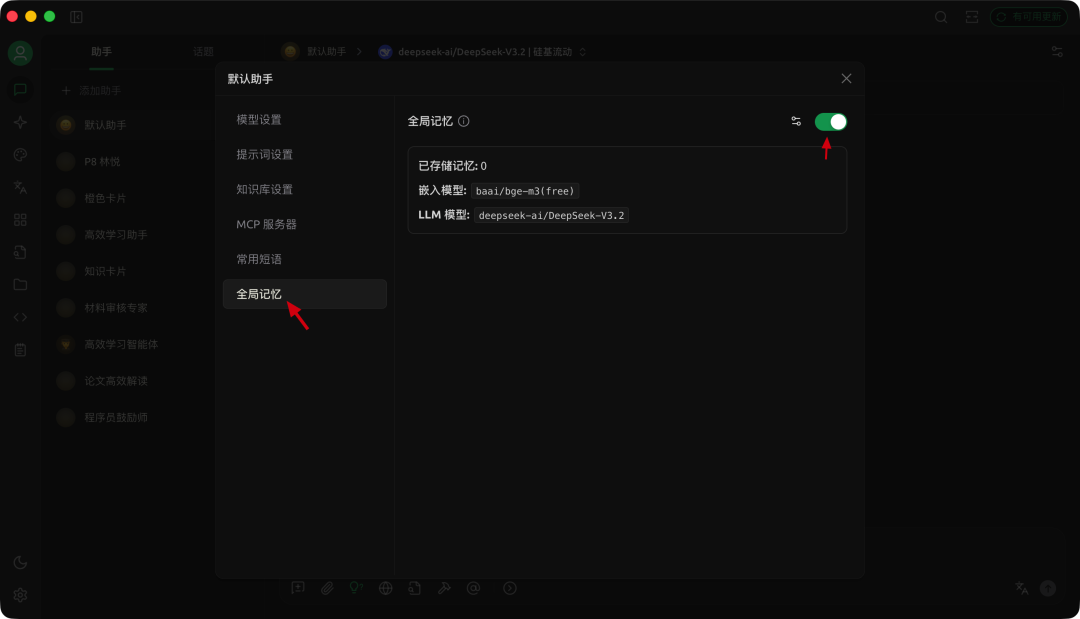

你可以手动添加记忆,也可以在智能体里开启记忆。它就会把自己需要记忆的信息做判断,然后自动存储。

我们可以在整体设置这里打开全局记忆。

我们在和他们聊天的时候,它会先检索相关的记忆,然后再回答我们的问题。

如果它认为有些信息需要记住,也会自动保存到记忆中。

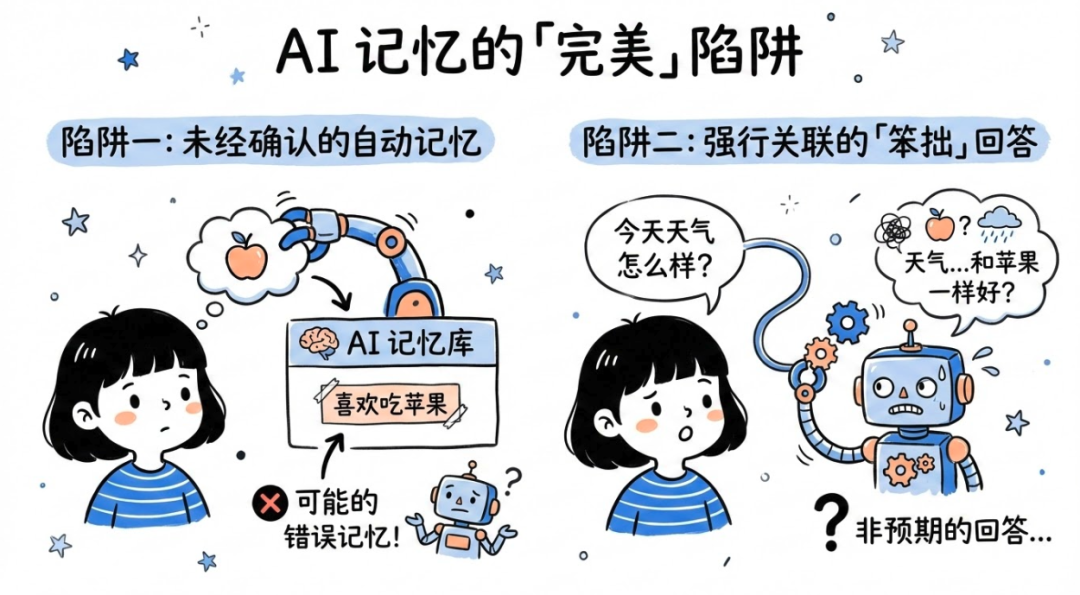

听着很完美,实际上还是会存在很多问题。

- 有时候记忆是 AI 自动决策的,没有和用户确认,那么这些记忆可能是错误的。

- 有了记忆之后,有些模型不够聪明,它有时会强行和相关记忆上靠,导致回答并不是我们想要的信息。

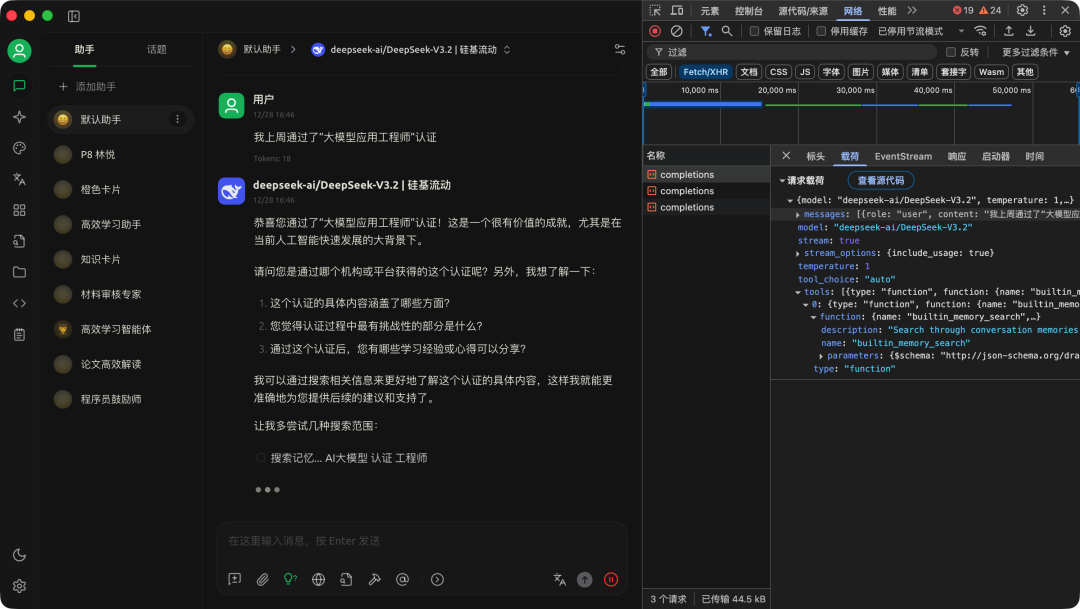

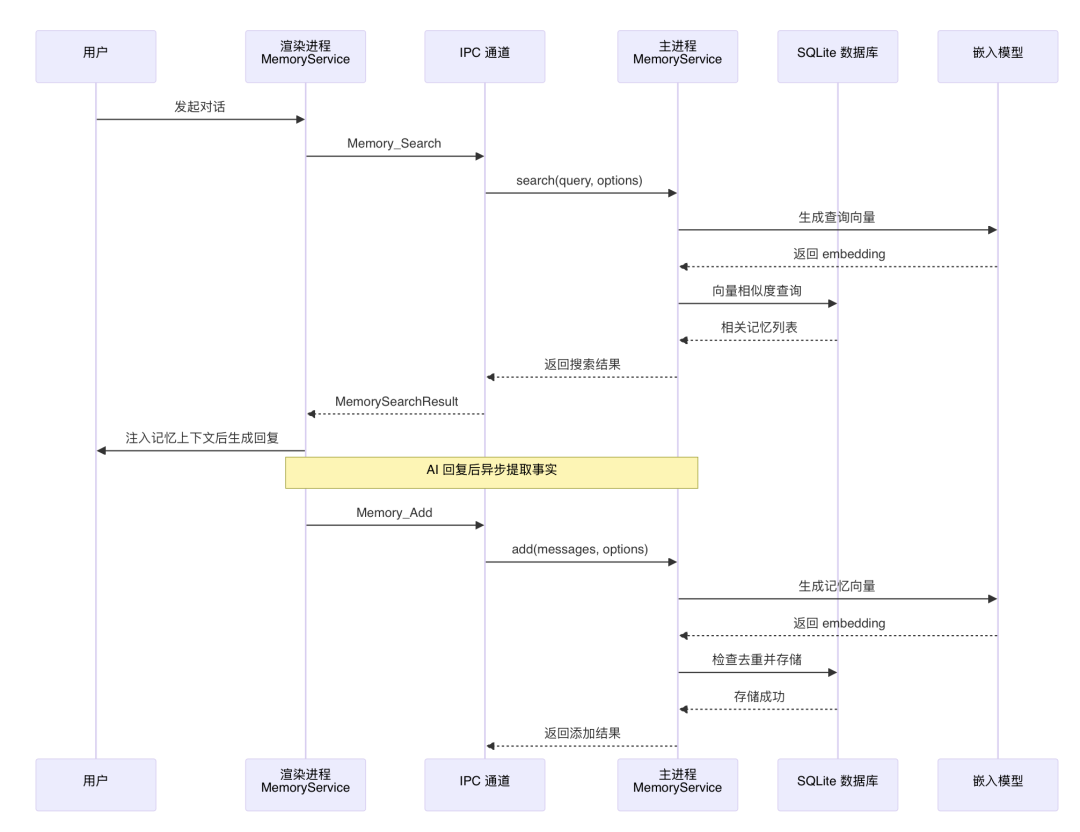

当我们开启全局记忆时,用户发起对话就会调用 Memory_Search 工具检索可能相关的记忆,并把它们放进上下文,帮助大语言模型更好地回答问题。

回答完成后,系统还会异步提取本次聊天的信息,如有需要增加、修改或删除的记忆,也会通过相应工具处理。

更多细节可 Cherry Studio 源码:https://github.com/CherryHQ/cherry-studio

简要来说,短期记忆是通过请求时传入对话历史来实现的,通常在对话内有效。长期记忆则是通过持久化存储,如向量数据库实现的,可以跨对话。

如果文章对你有帮助,可以给我三连击:点赞、喜欢,并转发给身边需要的朋友。

希望本文分享的技巧对你有帮助,我们下次再见。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-03-03,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读