Open Code的免费API集成的使用教学

原创Open Code的免费API集成的使用教学

原创

Tyenn_Siiwee

发布于 2026-03-03 12:20:21

发布于 2026-03-03 12:20:21

步骤 1.安装开放代码

步骤 2.配置API接口

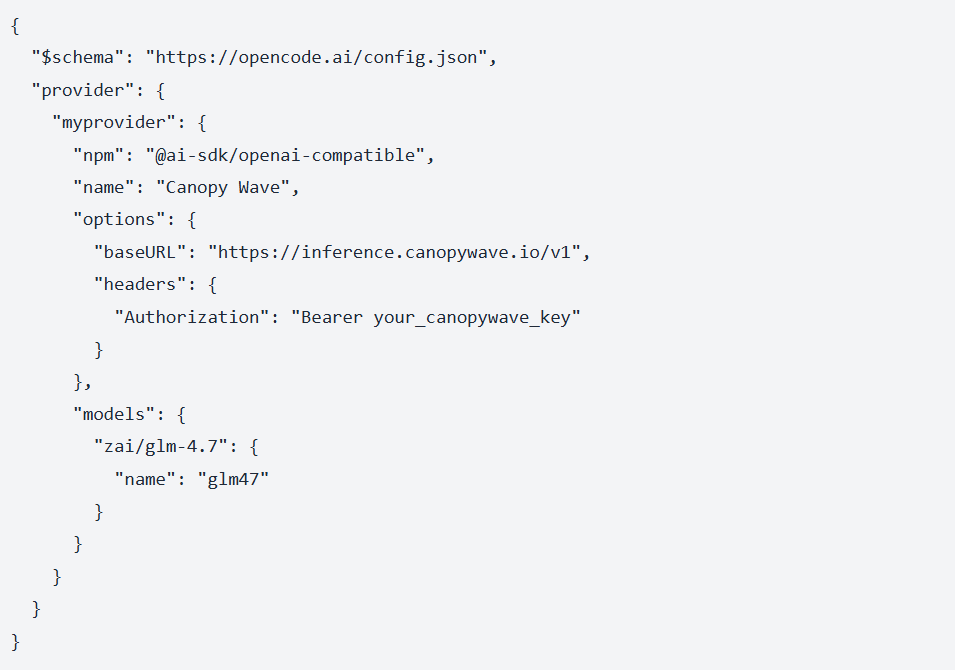

1. 配置文件位置:可以根据项目的所在位置将 opencode.json 文件放置在项目根目录中,或者将其设置为全局的~/.config/opencode/opencode.json 文件。

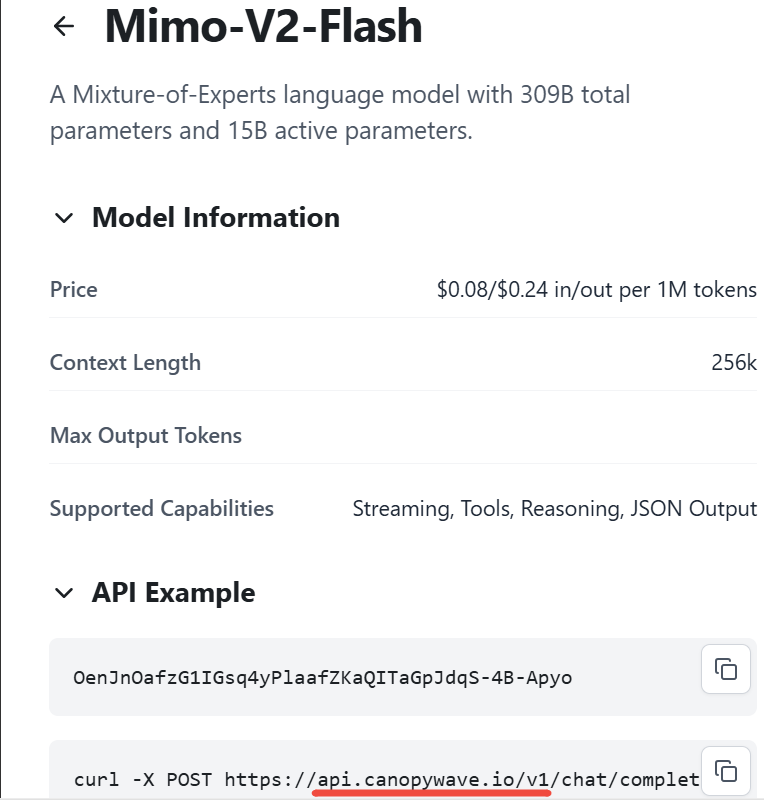

2.获取模型API,这里我接入的是Canopy Wave的免费API,该平台有许多最新的开源模型(例如Kimi-K2.5、GLM-5、MiniMax-M2.5、Qwen3.5) ,同时兼顾效率与质量,强烈推荐。

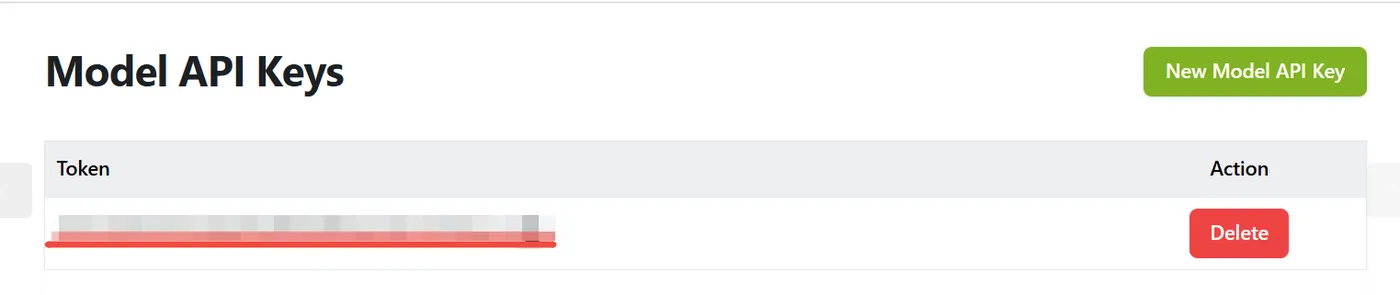

首先去Canopy Wave的官网Canopy Wave - The World’s Best Inference Platform For Open Models获取专属的API Key和模型URL,等会添加到API配置里去

3. 随后复制下面的 json 文件,将“Bearer”令牌键替换为在上一步中从“模型 API 密钥”中获取的模型 API 密钥,opencode.json 是这样的

步骤3.使用

1. “opencode”类型的操作将打开控制台,以便与模型进行交流。

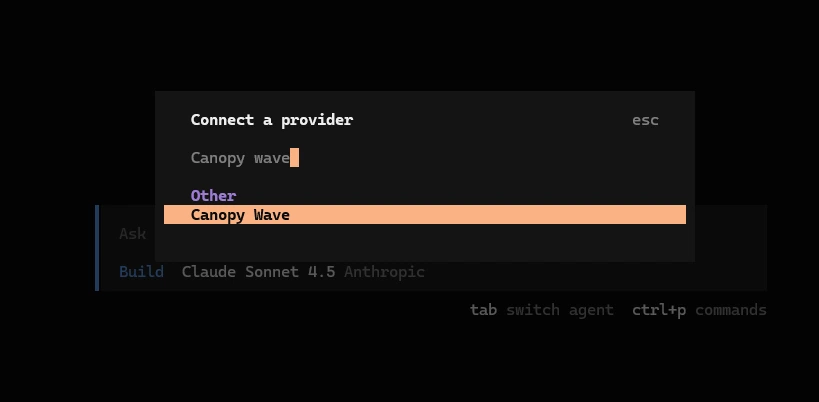

2. 使用“/connect”命令来添加提供商:

3. 在 JSON 中输入刚刚设置的提供商名称。

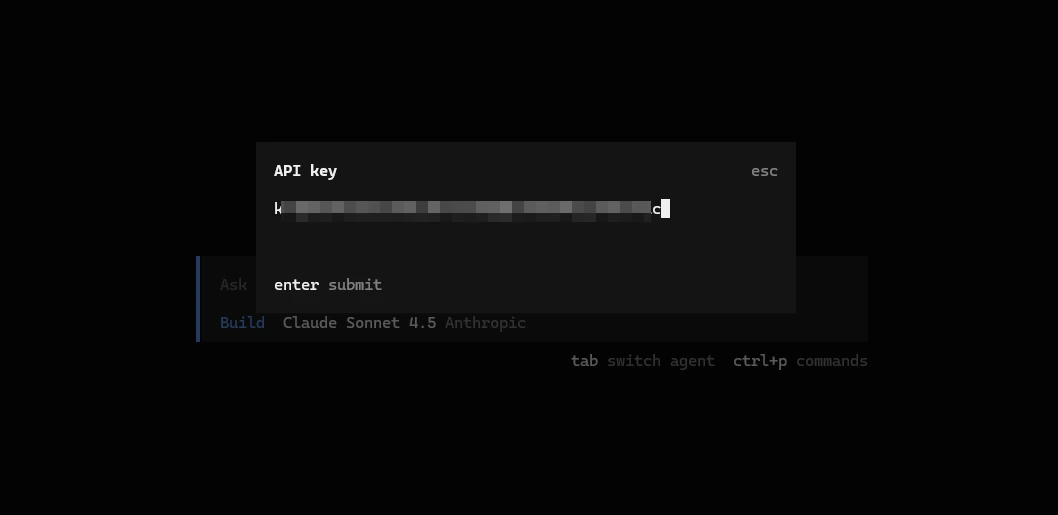

4. 在 2(3)处输入刚刚配置的模型 API 密钥,按回车键。

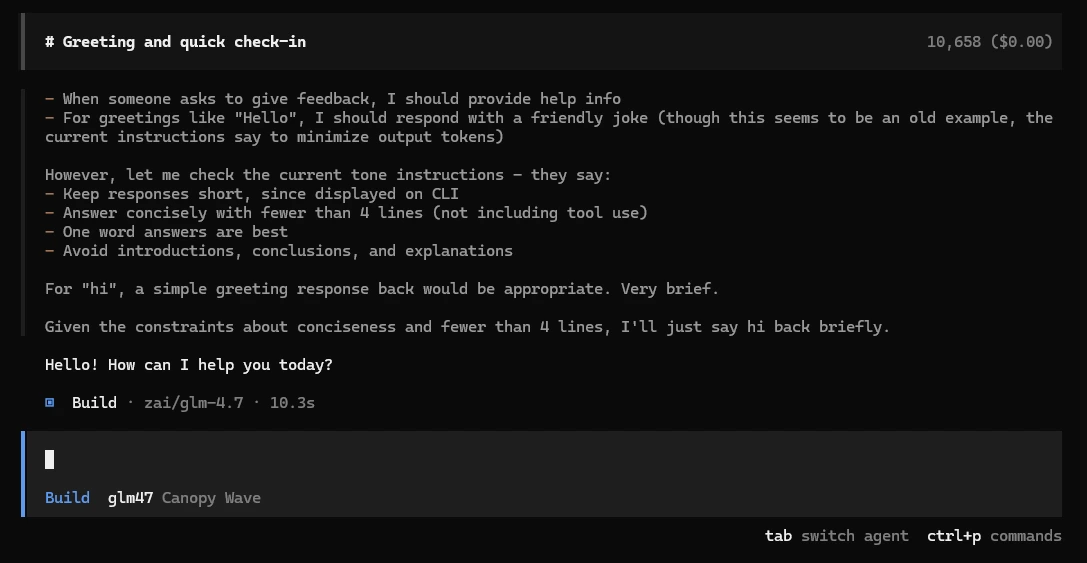

5. 最后我们就部署成功啦,可以在Open Code里调用Cnopy Wave所有的模型了

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录