迈向V4/R2之路:揭秘DeepSeek Engram如何解放大模型算力,激发高级智能

迈向V4/R2之路:揭秘DeepSeek Engram如何解放大模型算力,激发高级智能

Henry Zhang

发布于 2026-01-19 13:39:12

发布于 2026-01-19 13:39:12

DeepSeek 最新 Engram 论文解读:条件记忆将重塑下一代语言模型

本技术文章 6600 多字,可用参考播客语音形式的精华版。

在人工智能领域,大型语言模型的发展已进入深水区。自 2020 年 GPT-3 开创千亿参数时代以来,行业普遍陷入"参数规模决定一切"的迷思,通过简单堆砌参数量来提升模型能力。然而,这种模式面临两大困境:一是算力成本呈指数级增长,限制了技术的普惠化;二是模型的"记忆-推理"能力难以平衡,导致在处理固定知识时效率低下。

上周末,DeepSeek 团队联合北京大学在 GitHub 平台发布了名为《基于可扩展查找的条件记忆:大语言模型稀疏性的新维度》的最新论文,首次提出名为 Engram 的“条件记忆”技术,为解决上述问题提供了革命性思路。

目前大模型普遍采用的 “MoE” 架构,本质上是“条件计算”技术在稀疏大模型上的应用,可以节约算力。而 DeepSeek 这次 Engram 的“条件记忆”技术将模型的"记忆"与"计算"能力解耦,实现了"查算分离"的全新架构范式。

值得一提的是,DeepSeek 这次的 Engram 论文首发于开源网站 GitHub,而非学术预印版 arXiv 网站,是“开源先行”理念与“工程导向”研发模式的直接体现,意味着发布即交付,研究即产品。可以看出 DeepSeek 更看重技术的即时影响力与生态构建,从更底层塑造大模型未来的发展路径。

本文将深入解析 Engram 的技术原理和性能优势等方面的影响,以及其对DeepSeek 下一代模型 V4/R2 的变革性作用。

一、大模型的“无效内耗”,源于任务不分家

要理解 Engram 的价值,首先要搞懂当前大模型的核心缺陷。语言建模本质上要做两件完全不同的事,就像办公室里的“创意工作”和“行政事务”:

一是组合式推理:比如分析一篇文章的逻辑结构、根据需求撰写商业计划书、解数学题,这些任务需要动态思考、灵活组合知识的“创意活”;

二是知识检索:比如,识别 “亚历山大大帝”、 “四大发明”这类命名实体,或是“顺便说一下”“总而言之”这类固定短语等高频重复的“行政活”,理论上只要查现成资料就能搞定。

但现在的大模型,没有专门的“档案库”来处理这些“行政活”。不管是写方案这样的复杂推理,还是认实体这样的简单检索,都要动用最核心的计算资源(多层前馈网络+注意力机制)重新推演一遍。

这就像让一个资深策划师,每次写方案前都要先核对公司名称的正确写法和整理基础行业术语,本该用来构思创意的精力,全耗在了重复性的基础工作上。这种“用动态计算模拟静态查找”的模式,是大模型无效的内耗,也是算力浪费和效率低下的核心原因。

为了破解这个矛盾,Deeseek 和北大的团队在论文中提出了一种全新的思路:条件记忆。这一思路的核心,就是给大模型做“分工”:把静态知识的存储和检索,交给专门的“记忆模块”;让核心的 Transformer 架构,专注于动态推理。这就像给策划师配一个行政助理,专门处理资料核对和术语整理,让策划师专注创意本身。而 Engram 模块,就是“条件记忆”思路的落地实现——高效、可扩展的“AI专属档案库”。

二、Engram的“档案库”如何高效工作

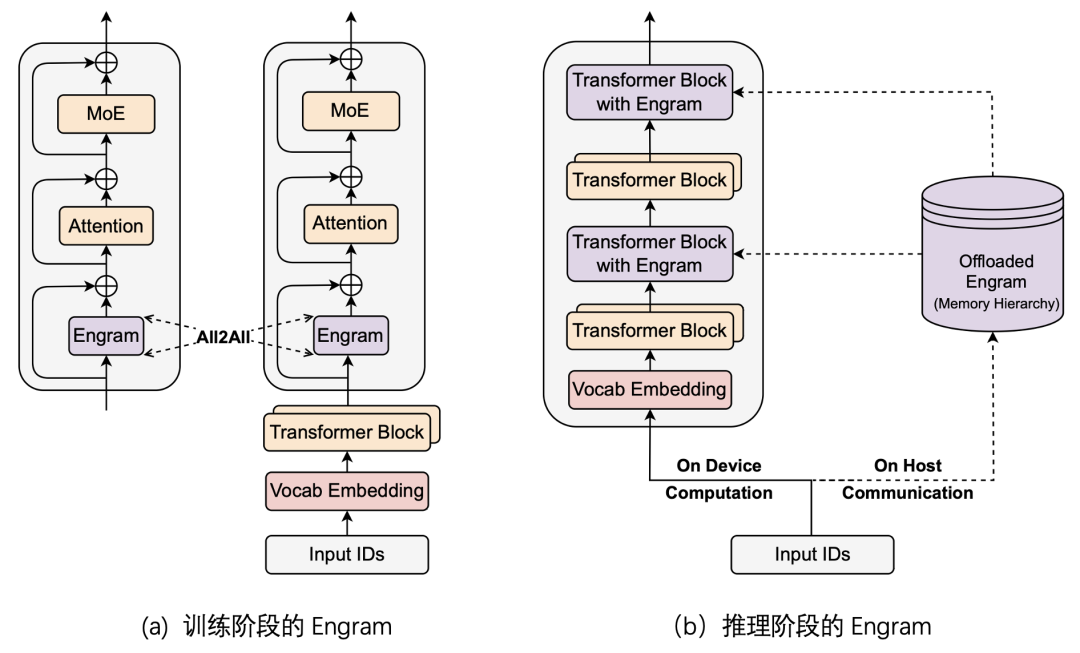

Engram不是替换现有大模型的核心架构,而是作为一个新增模块融入其中,核心工作流程只有两步:检索(从档案库找资料)和融合(把资料精准用到当前任务)。就像行政助理先从档案库找出相关资料,再筛选出和当前方案相关的部分交给策划师。

(图片来自论文)

我们一步步拆解这个过程的核心细节:

1. 给档案库做“智能整理”

要快速找到需要的资料,首先得把档案库整理好。Engram的检索阶段,就是做两件事:压缩冗余资料、精准定位所需内容。

先看分词器压缩:普通的大模型分词器,为了保证文本能完整还原,会给语义相同的词分配不同ID。比如,“Apple”(首字母大写)和 “apple”(小写)、“北京”和“北京市”(不同分词)。这就像档案库把“苹果公司”的资料分成了多份,查找时要翻遍多个文件夹,效率很低。

Engram通过一个预定义的映射函数,把这些语义等价的词统一成标准化 ID:比如把所有“苹果”相关的不同写法,都归到同一个档案编号下。实验显示,这种方法能让 128k 词汇量的分词器瘦身 23%,大大提升了后续查找效率。

再看多头哈希:如果要给所有可能的词语组合(比如“亚历山大大帝”、“四大发明之一”)都单独建档案,档案库的规模会呈指数级爆炸——就像要给每一个短语都单独建一个文件夹,最终会堆满整个办公室。

Engram 用“哈希映射”解决这个问题:给每个短语组合(专业术语叫 N-gram )分配多个独立的“哈希头”(相当于多个不同的档案分类规则),通过确定性的哈希函数,把短语快速映射到对应的档案索引。比如“亚历山大大帝”这个短语,通过3个不同的哈希头,都会指向同一个档案位置,既避免了“找不到”的情况,又不会重复存储。

最终,多个哈希头找到的资料会被整合起来,形成一个完整的记忆向量:相当于行政助理把从不同分类规则下找到的相关资料,整理成一份完整的摘要。

2. 只把有用的资料交给“策划师”

检索到的资料是通用的,不一定适合当前任务。比如找到的“苹果”资料,可能是关于水果的,也可能是关于苹果公司的,需要筛选后再用。Engram 的融合阶段,就是做精准筛选的工作。

这里的核心是上下文感知门控机制,原理很像我们找资料时的相关性判断:把当前模型正在处理的内容当作查询需求,把检索到的记忆向量当作“资料”,计算两者的相似度,生成一个 0 到 1 之间的“门控值”——相似度越高,门控值越接近1,资料被采纳的程度越高;相似度越低,门控值越接近 0,资料被直接过滤。

比如模型正在写“苹果公司“的产品策略,检索到的“苹果”资料中,关于公司的部分门控值接近 1,会被保留;关于水果的部分门控值接近 0,会被过滤。这样就避免了“无用资料”干扰核心推理,保证了信息的精准性。

之后,Engram 还通过轻量级的卷积操作,增强资料的适用性,再通过残差连接把筛选后的资料融入模型的计算流:相当于行政助理把整理好的资料,再根据当前方案的需求调整格式、补充细节,然后交给策划师。

3. mHC架构集成:既分工又协作

一些的主流大模型采用了“流形约束超连接”(mHC),就像多个策划师协作完成一个复杂项目。Engram 能和这种架构高效配合,核心是“共享+独立”的参数策略:

(1)所有分支共享同一个稀疏嵌入表(相当于所有策划师共用一个核心档案库,避免资料重复存储)和值投影矩阵(相当于资料的统一整理标准);

(2)每个分支有独立的键投影矩阵(相当于每个策划师有自己的资料筛选标准,能根据自己的任务需求精准筛选资料)。

这种设计既保证了资料的共享效率,又兼顾了不同任务的个性化需求,还能通过 FP8 矩阵乘法充分利用 GPU 算力,实现高效协作。

三、突破GPU内存墙,让大模型轻装上阵

Engram 的价值,不仅在于分工提升推理效率,更在于解决了大模型部署时的GPU 内存限制,对企业和开发者来说,堪称颠覆性优势。

我们先搞懂一个行业痛点:GPU 的高带宽内存(HBM)容量有限,就像办公室的“临时文件柜”,空间小但取放快。传统的记忆增强模型(比如 MoE ),因为路由决策依赖运行时的隐藏状态,在计算前无法预知需要哪些参数,只能把大量参数都放在 HBM 里。就像把所有档案都堆在临时文件柜里,很快就会塞满,导致无法部署更大规模的模型。

而 Engram 的检索索引只依赖的词元序列,在模型开始计算前,就能精准预知需要访问哪些内存地址,提前从大档案库(主机内存/SSD)中把资料调到临时文件柜。这种确定性寻址,带来了两个关键的系统级优化:

1. 预取-重叠策略隐藏数据传输延迟

Engram 能实现“预取-重叠”:在模型处理前一层内容的同时,从容量大但速度较慢的主机内存中异步预取下一层需要的嵌入向量。就像策划师在处理当前部分方案时,行政助理已经提前把下一部分需要的资料准备好,不会出现“策划师等资料”的停顿。

实验数据证明了这种策略的有效性:在 NVIDIA H800 GPU 上,给 4B 和 8B 参数的基础模型附加 100B 参数的 Engram 嵌入表(完全存放在主机内存),吞吐量惩罚分别只有 1.9% 和 2.8% ——相当于给模型增加了 100B 的记忆容量,但几乎不影响计算速度。

2. 多级缓存层次结构平衡容量与速度

自然语言中的 N-gram 模式遵循 “Zipf分布”,即少数高频模式占据了绝大多数访问请求(就像办公室里少数核心资料被反复查阅,大部分资料很少用到)。基于这一特性,Engram 构建了三级缓存:

(1)高速缓存(GPU HBM):存放最常用的少量嵌入向量(相当于临时文件柜,放高频资料);

(2)中速缓存(Host DRAM):存放次常用的嵌入向量(相当于办公室的核心档案柜,放常用资料);

(3)大容量存储(NVMe SSD):存放稀有的长尾模式(相当于公司的档案室,放不常用资料)。

这种分层存储,既保证了高频资料的访问速度,又通过低成本的主机内存/SSD实现了海量记忆的存储,为构建万亿甚至更大规模的记忆表提供了可能。这种 “临时文件柜+核心档案柜+档案室”的组合,既保证了日常工作效率,又能存储所有历史资料。

四、MoE与Engram的最优配比

在稀疏大模型设计中,有一个核心问题:固定总参数量和计算预算时,该如何分配条件计算(MoE)和条件记忆(Engram)的稀疏容量?就像给团队分配预算,该给“创意工作”(MoE)多少,给“行政支持”(Engram)多少?

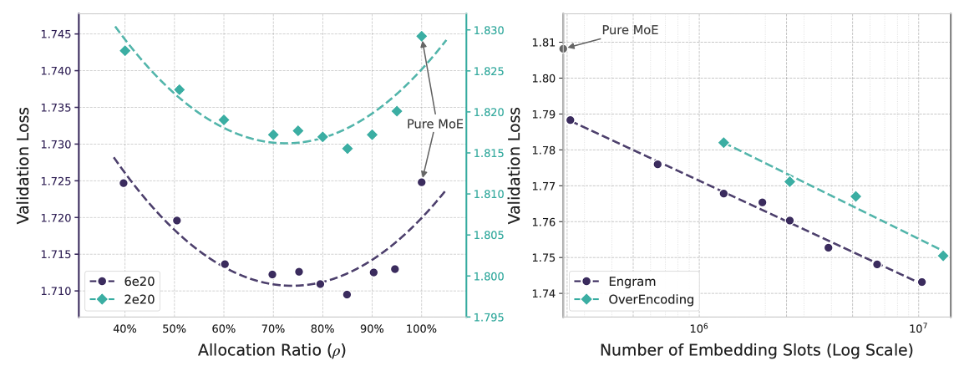

论文图片:稀疏性分配与Engram扩展 (U型缩放定律)

研究者通过实验找到了答案:U型缩放定律。他们定义分配比率 ρ 为分配给 MoE 专家容量的参数比例(ρ=1 代表纯 MoE 模型),通过调整ρ发现:

纯MoE并非最优:当所有稀疏预算都给 MoE 时,模型性能不是最好(就像团队只重视创意,没有行政支持,创意效率会受影响);

存在最优混合点:把 20%-25%的稀疏参数预算分配给 Engram(即 ρ 在75%-80%之间),模型在不同计算规模下都能达到最低的验证集损失(就像给团队分配 20% 的预算做行政支持,能让 80% 的创意预算发挥最大价值);

结构互补性被证实:ρ 过高(偏向 MoE ),模型缺乏处理静态模式的专用记忆;ρ 过低(偏向 Engram ),模型缺乏动态推理能力。只有两者平衡,才能实现最优性能。

大规模预训练验证:全方位超越纯MoE模型

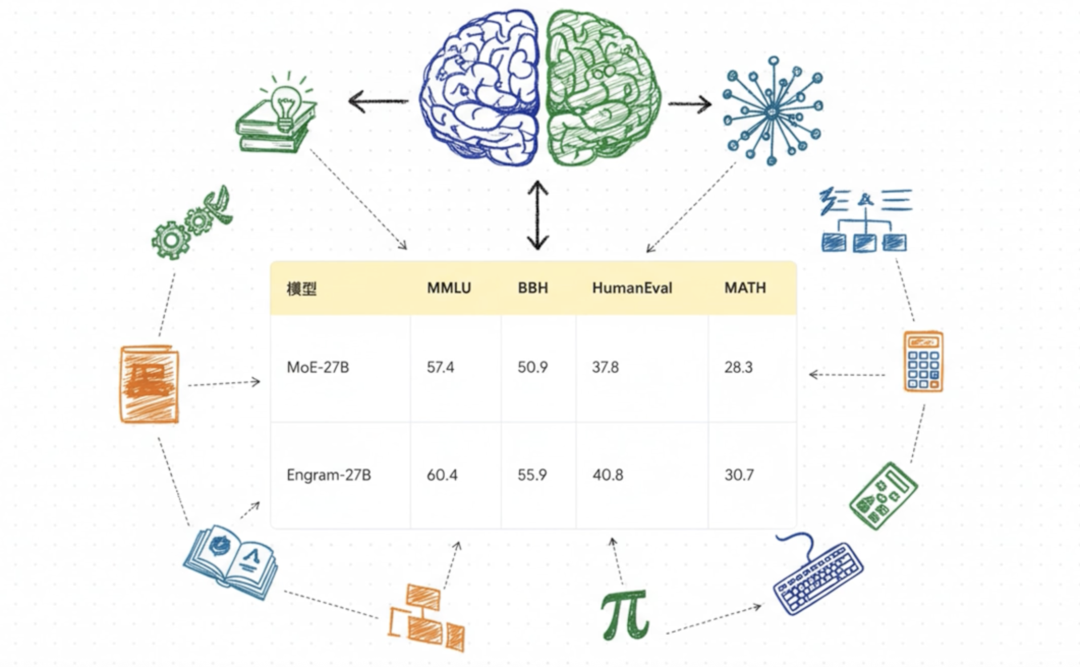

基于U型缩放定律,研究者训练了 27B 参数的混合模型( Engram-27B ),并与参数和计算量完全匹配的纯 MoE 模型( MoE-27B )进行对比。结果显示,Engram-27B 在所有任务上都实现了超越:

值得注意的是,Engram 的优势不仅体现在知识密集型任务(如MMLU、CMMLU),在需要复杂推理的任务,如BBH通用推理、HumanEval 代码生成、MATH 数学等,提升更显著,证明了 Engram 不仅是补充知识,更是提升计算效率,让模型能把更多算力用在推理上。

五、Engram本质是“增加模型有效深度”

为什么 Engram 能带来这么显著的性能提升?通过 LogitLens 和 CKA 等可解释性工具,论文中描述了核心答案:Engram 在功能上等价于“增加了模型的有效深度”。

我们可以这样理解:传统模型的前几层,大多在处理识别实体和组合简单短语这类低级任务,就像策划师要先花大量时间整理基础资料,才能开始构思创意。而 Engram 把这些低级任务“外包”出去,让模型的前几层直接开始处理更高层次的抽象推理——相当于策划师跳过了整理资料的环节,直接进入创意构思,虽然模型的物理层数没变,但有效处理深度大大增加了。

这一结论得到了两个实验的验证:

1. LogitLens分析:Engram 模型在网络早期层级,就表现出比 MoE 基线更低的 KL 散度(KL Divergence,KL散度越低,说明模型越接近最终的正确预测)。这意味着 Engram 让模型“更快地收敛到正确结果”,减少了无效的迭代过程。

2. CKA分析:通过比较 Engram 模型和 MoE 模型的层间表征相似性,发现Engram 的浅层表征与 MoE 的深层表征高度相似。比如 Engram-27B 的第5层表征,和 MoE 基线的第12层最为接近,相当于 Engram 用更少的物理层数,实现了更深的语义理解。

释放注意力,提升长上下文性能

“增加有效深度”还带来了一个延伸优势:释放注意力机制,让模型更好地处理长上下文。

传统模型的注意力机制,既要处理局部依赖(比如短语组合),又要捕捉全局依赖(比如文章的整体逻辑),这有点像策划师既要核对资料细节,又要把握方案框架,很容易顾此失彼。Engram把局部依赖的处理外包后,注意力机制能专注于捕捉全局上下文的长距离依赖,提升长文本处理能力。

实验验证:在同等损失设定下(Engram-27B 和 MoE-27B 的预训练损失完全相同),Engram-27B 在 RULER 等复杂检索任务上表现出压倒性优势,尤其是在多查询 Needle-in-a-Haystack(在大量文本中找关键信息)任务上,准确率从 84.2% 飙升到 97.0%。这对需要处理长文档的场景(如法律文书分析、学术文献解读)来说,价值巨大。

门控机制精准识别静态语言模式

(图片来自论文)

论文还通过可视化门控激活值,直观展示了 Engram的 工作过程:门控值越高(颜色越深),说明模型识别出了需要检索的静态语言模式。

实验发现,在处理英文的“Alexander the Great”(亚历山大大帝)、“Princess of Wales”(威尔士王妃),以及中文的“四大发明”、“张仲景”等命名实体和固定短语时,门控值会显著升高。这直接证实了 Engram 能精准识别并处理这些固化的语言模式,有效减轻了 Transformer 主干的负担。

Engram与RAG的区别

Engram 与目前非常流行的 RAG(检索增强生成)技术虽然都在解决模型存储与调取海量知识的效率问题,但其技术路径存在本质区别。

具体而言,Engram 将知识以嵌入表的形式直接集成在模型层级中,通过 N-gram 实现 O(1) 复杂度的快速查表。这种设计更偏向于“原生记忆”,能让模型腾出计算资源进行更高阶的逻辑推理。

相比之下,RAG 将知识库存储在模型外部,允许模型在无需重新训练的情况下,通过调取外部实时文档来适应不断演进的信息。

从运行机制看,Engram 利用确定性寻址与异步预取技术,使其在推理时几乎不产生额外延迟,且能跨越显存限制利用主机内存;而 RAG 通常依赖外部向量数据库检索,流程更侧重于外部信息的引入。

两者相辅相成:Engram 优化了模型对静态、模式化事实的内在存储效率,而 RAG 则解决了动态、长尾知识的实时调取

六、范式级创新引发业内反响热议

Engram 论文及代码开源后,24 小时内 GitHub 斩获1.2k星,在 Reddit、X 等平台引发全球技术圈热议。业内对这一创新的评价集中在“稀疏化新方向”“工程落地价值”“对下一代模型的影响”三大维度,既有肯定也有理性探讨。

1. 正面评价:开启“计算+记忆”协同范式

PyTorch 核心维护者 Dmytro Dzhulgakov 高度认可 Engram,认为其与Meta的早期理念一致,但工程实现更佳。业界普遍视其为突破“纯神经网络”范式的关键创新,将模型升级为“计算+记忆”协同系统。与 RAG 的“外挂”不同,Engram 实现了深度融合,让知识真正参与思考。国内视其为重要的架构创新方向,产业界则看到了其在金融等领域实现“经营级智能”的落地潜力,推动AI从对话走向决策。

2. 理性探讨:真实场景的挑战与优化空间

部分网友也对 Engram 提出了三点理性关切:一是面对真实噪声输入的鲁棒性,在错乱文本中哈希检索与门控机制是否可靠;二是静态记忆的动态更新难题,当前固化知识库如何适应快速变化的信息世界;三是模块化程度有待提升,建议设计为可插拔组件以降低更新和维护成本。这些问题恰好指明了未来Engram 迭代的方向:增强动态更新能力、提升抗噪性和实现模块化设计,以推动其从实验室走向更复杂的产业应用。

七、对DeepSeek下一代模型(R2/V4)的战略价值

业内普遍猜测,Engram 将是 DeepSeek 下一代模型(V4或R2)的核心基础技术。结合 DeepSeek 年初发布的 mHC(流形约束超连接)框架,下一代模型的架构轮廓已呼之欲出了:融合 mHC 优化专家间通信效率,引入 Engram 作为独立记忆模块,形成“动态计算+静态检索”的协同模式。Engram 对下一代模型的价值体现在性能提升、成本优化、场景拓展三大层面。

mHC 与 Engram 的结合是“动态计算”与“静态记忆”的双重优化,旨在实现“1+1>2”的效果:mHC 提升 MoE 通信效率,Engram 解决计算资源竞争。按照U型定律,将 20%-25% 参数分配给 Engram,能在同等算力下获得显著性能提升。

Engram 为降低大模型算力成本开辟了两大路径:在训练中,它避免对静态知识的冗余计算,提升样本训练效率;在推理中,其时间复杂度 O(1) 检索比神经网络更省资源,且能将千亿级参数记忆表存于 CPU,节省昂贵 GPU 显存。这有望显著降低推理部署成本。业内预测,基于此架构的下代模型API调用成本或下降 30%-50%,为AI技术更广泛地赋能中小企业铺平道路。

八、结语:条件记忆将是下一代大模型的核心构件

Engram 架构的出现,本质上是对大模型“任务分工”的重新定义,通过条件记忆与条件计算的互补,让模型的不同部分各司其职,实现了“性能、效率和可扩展性”的三重突破。

Engram 有三大核心贡献:

1. 性能提升:在同等参数和计算预算下,全面超越纯 MoE 模型,尤其在复杂推理任务上提升显著;

2. 效率优化:功能上等价于增加模型有效深度,释放注意力机制,提升表示效率;

3. 系统突破:确定性寻址实现计算与内存解耦,突破 GPU 内存墙,让万亿级参数的记忆表可低成本部署。

Engram 技术标志着大模型架构设计进入了一个新的里程碑。它通过显式记忆存储与检索机制,解决了传统 Transformer 模型在静态知识处理上的效率问题,实现了"查算分离"的范式革新。未来的大模型,不再是追求参数规模的盲目扩张,而是通过精准分工实现效率最大化,这也对整个 AI 行业产生了深远影响。

与年初发布的 mHC 技术一样,Engram 技术也继续在铺垫着 DeepSeek 的下一代模型。业内对 DeepSeek 模型 V4/R2 发布的呼声已经愈来愈高了。参照去年农历新年前发布的“惯例”,或许 1 月底 2 月初就是 V4/R2 的发布期,我们拭目以待吧。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-01-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读