可解释性:不是为了合规,而是调试

作者:HOS(安全风信子) 日期:2026-01-09 来源平台:GitHub 摘要: 机器学习可解释性已成为安全领域的关键技术,不仅是合规要求,更是调试和增强模型安全性的核心手段。本文从安全调试视角出发,深入探讨机器学习可解释性的本质、核心技术和工程实践。通过分析最新研究进展和工业实践,结合实际代码案例,展示如何利用可解释性技术调试安全模型,发现潜在漏洞,增强模型的鲁棒性和可信度。文章重点讨论了安全场景下可解释性的独特需求、高级解释方法、自适应解释框架、可解释性与安全性的融合以及可解释性在安全攻防中的应用,为读者提供了一套完整的安全机器学习可解释性解决方案。

1. 背景动机与当前热点

1.1 为什么可解释性是安全ML的调试利器

在安全领域,机器学习模型的可解释性至关重要。安全系统需要对每一个决策负责,尤其是在高风险场景中:

- 调试模型漏洞:通过解释模型决策,发现模型的脆弱点和错误模式。

- 检测对抗攻击:分析模型对对抗样本的决策过程,识别异常的特征依赖。

- 验证模型公平性:确保模型决策不依赖于敏感特征,避免偏见和歧视。

- 增强用户信任:向安全分析师解释模型决策,提高对模型的信任度。

- 满足合规要求:某些行业(如金融、医疗)要求模型决策可解释。

可解释性不仅是合规要求,更是调试安全模型的强大工具。通过理解模型的决策过程,安全工程师可以:

- 快速定位问题:当模型产生错误预测时,可解释性技术可以帮助定位问题根源。

- 优化模型设计:根据解释结果,调整模型架构、特征选择和训练方法。

- 增强模型鲁棒性:识别模型的脆弱特征,增强对对抗攻击的抵御能力。

- 改进安全策略:将模型决策与领域知识结合,优化安全策略。

1.2 当前行业动态与技术趋势

当前,机器学习可解释性领域正呈现出以下几个重要趋势:

- 从黑盒到灰盒解释:传统的黑盒解释方法(如LIME、SHAP)正在向灰盒解释方法发展,结合模型内部结构提供更准确的解释。

- 安全特定解释:针对安全场景的特殊需求,开发专门的可解释性技术,如对抗样本解释、异常检测解释等。

- 动态解释:不仅解释模型的静态决策,还解释模型在动态环境中的行为变化。

- 交互式解释:提供交互式解释界面,允许安全分析师探索模型决策过程。

- 因果解释:从相关性解释向因果解释发展,提供更可靠的决策依据。

- 联邦学习可解释性:在联邦学习场景下,实现分布式模型的可解释性。

1.3 安全场景下可解释性的独特需求

安全场景下,可解释性具有独特的需求:

- 实时性:安全事件需要实时响应,解释过程必须高效。

- 准确性:解释结果必须准确反映模型的真实决策过程,避免误导。

- 完整性:解释必须覆盖模型决策的所有关键因素,不能遗漏重要信息。

- 鲁棒性:解释方法本身必须鲁棒,不能被攻击者操纵。

- 可审计性:解释结果必须可审计,便于追踪和验证。

- 多维度:从不同角度解释模型决策,提供全面的理解。

2. 核心更新亮点与新要素

2.1 亮点1:自适应解释框架

传统的解释方法通常使用固定的解释策略,忽略了数据的多样性和模型的动态性。本文介绍自适应解释框架,包括:

- 数据感知解释:根据输入数据的特点,动态调整解释方法。

- 任务感知解释:根据任务的重要性和风险等级,调整解释的深度和粒度。

- 模型感知解释:根据模型的结构和行为,选择最适合的解释方法。

- 用户感知解释:根据用户的背景和需求,调整解释的形式和复杂度。

2.2 亮点2:安全特定解释技术

传统的解释方法主要关注模型的准确性解释,而安全场景需要专门的安全解释技术。本文介绍:

- 对抗解释:解释模型对对抗样本的决策过程,识别异常的特征依赖。

- 异常解释:解释模型对异常样本的检测过程,提供异常原因分析。

- 攻击路径解释:使用SHAP等方法分析攻击路径,识别关键攻击步骤。

- 鲁棒性解释:解释模型的鲁棒性表现,识别脆弱的特征和决策边界。

2.3 亮点3:因果可解释性

传统的解释方法主要基于相关性,而因果解释提供更可靠的决策依据。本文介绍:

- 因果特征选择:识别对模型决策有因果影响的特征。

- 反事实解释:生成反事实样本,解释"如果…会怎样"的问题。

- 因果图解释:使用因果图可视化模型的决策过程和特征依赖关系。

- 因果干预:通过干预特征,验证模型决策的因果关系。

3. 技术深度拆解与实现分析

3.1 可解释性技术分类

机器学习可解释性技术可以分为以下几类:

3.1.1 模型内在可解释性

模型内在可解释性是指模型本身具有可解释性,不需要额外的解释方法:

- 线性模型:权重可以直接解释特征的重要性。

- 决策树:可以通过树结构直观解释决策过程。

- 规则模型:使用规则集表示模型,易于理解。

- 广义可加模型(GAM):将模型分解为多个单特征函数的总和,便于解释。

3.1.2 模型事后可解释性

模型事后可解释性是指在模型训练完成后,使用额外的方法解释模型决策:

- 特征重要性:如SHAP值、特征置换重要性、LIME等。

- 决策可视化:如部分依赖图、个体条件期望图、累积局部效应图等。

- 注意力可视化:如Transformer模型的注意力权重可视化。

- 原型解释:找到与待解释样本相似的原型样本,通过原型解释模型决策。

3.2 SHAP分析攻击路径

SHAP(SHapley Additive exPlanations)是一种基于博弈论的可解释性方法,可以为每个特征分配一个重要性值,解释该特征对模型决策的贡献。在安全领域,SHAP可以用于分析攻击路径,识别关键攻击步骤。

下面是使用SHAP分析攻击路径的实现示例:

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

import torch

import torch.nn as nn

import shap

from sklearn.datasets import load_breast_cancer

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

# 定义简单的神经网络模型

class SimpleNN(nn.Module):

def __init__(self, input_size, hidden_size, output_size):

super(SimpleNN, self).__init__()

self.fc1 = nn.Linear(input_size, hidden_size)

self.relu = nn.ReLU()

self.fc2 = nn.Linear(hidden_size, output_size)

self.sigmoid = nn.Sigmoid()

def forward(self, x):

x = self.fc1(x)

x = self.relu(x)

x = self.fc2(x)

x = self.sigmoid(x)

return x

# 加载数据集

data = load_breast_cancer()

X = data.data

y = data.target

feature_names = data.feature_names

# 数据预处理

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X_scaled, y, test_size=0.2, random_state=42)

# 转换为PyTorch张量

X_train_tensor = torch.FloatTensor(X_train)

y_train_tensor = torch.FloatTensor(y_train).unsqueeze(1)

X_test_tensor = torch.FloatTensor(X_test)

y_test_tensor = torch.FloatTensor(y_test).unsqueeze(1)

# 初始化模型

input_size = X_train.shape[1]

hidden_size = 32

output_size = 1

model = SimpleNN(input_size, hidden_size, output_size)

# 定义损失函数和优化器

criterion = nn.BCELoss()

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

# 训练模型

epochs = 100

train_losses = []

test_losses = []

for epoch in range(epochs):

# 训练模式

model.train()

optimizer.zero_grad()

outputs = model(X_train_tensor)

loss = criterion(outputs, y_train_tensor)

loss.backward()

optimizer.step()

train_losses.append(loss.item())

# 评估模式

model.eval()

with torch.no_grad():

test_outputs = model(X_test_tensor)

test_loss = criterion(test_outputs, y_test_tensor)

test_losses.append(test_loss.item())

if (epoch+1) % 10 == 0:

print(f'Epoch [{epoch+1}/{epochs}], Train Loss: {loss.item():.4f}, Test Loss: {test_loss.item():.4f}')

# 计算模型准确率

model.eval()

with torch.no_grad():

train_outputs = model(X_train_tensor)

train_pred = (train_outputs >= 0.5).float()

train_acc = (train_pred == y_train_tensor).sum().item() / y_train_tensor.shape[0]

test_outputs = model(X_test_tensor)

test_pred = (test_outputs >= 0.5).float()

test_acc = (test_pred == y_test_tensor).sum().item() / y_test_tensor.shape[0]

print(f'Train Accuracy: {train_acc:.4f}, Test Accuracy: {test_acc:.4f}')

# 使用SHAP解释模型

# 创建SHAP解释器

explainer = shap.DeepExplainer(model, X_train_tensor)

# 计算SHAP值

shap_values = explainer.shap_values(X_test_tensor)

# 将SHAP值转换为numpy数组

shap_values = np.array(shap_values)[0] # 取第一个输出的SHAP值

# 绘制汇总图

plt.figure(figsize=(12, 8))

shap.summary_plot(shap_values, X_test, feature_names=feature_names, plot_type="bar")

plt.title("特征重要性SHAP汇总图")

plt.tight_layout()

plt.savefig('shap_summary.png')

print("SHAP汇总图已保存为 shap_summary.png")

# 绘制单个样本的SHAP值图

plt.figure(figsize=(12, 8))

shap.initjs()

shap.force_plot(

explainer.expected_value[0],

shap_values[0],

X_test[0],

feature_names=feature_names,

matplotlib=True,

show=False

)

plt.title("单个样本的SHAP值图")

plt.tight_layout()

plt.savefig('shap_force.png')

print("单个样本的SHAP力导向图已保存为 shap_force.png")

# 绘制部分依赖图

plt.figure(figsize=(12, 8))

shap.dependence_plot(0, shap_values, X_test, feature_names=feature_names, show=False)

plt.title("第一个特征的部分依赖图")

plt.tight_layout()

plt.savefig('shap_dependence.png')

print("部分依赖图已保存为 shap_dependence.png")

# 分析攻击路径(模拟)

# 假设我们有一个恶意样本,分析模型如何被欺骗

malicious_sample = X_test[0].copy()

# 修改样本,使其成为恶意样本

malicious_sample[0] += 5 # 增加第一个特征的值

malicious_sample[1] += 5 # 增加第二个特征的值

# 转换为张量

malicious_sample_tensor = torch.FloatTensor(malicious_sample.reshape(1, -1))

# 模型预测

with torch.no_grad():

original_pred = model(torch.FloatTensor(X_test[0].reshape(1, -1))).item()

malicious_pred = model(malicious_sample_tensor).item()

print(f"原始样本预测概率: {original_pred:.4f}")

print(f"恶意样本预测概率: {malicious_pred:.4f}")

# 计算恶意样本的SHAP值

malicious_shap_values = explainer.shap_values(malicious_sample_tensor)[0]

# 绘制恶意样本的SHAP值图

plt.figure(figsize=(12, 8))

shap.force_plot(

explainer.expected_value[0],

malicious_shap_values,

malicious_sample,

feature_names=feature_names,

matplotlib=True,

show=False

)

plt.title("恶意样本的SHAP力导向图")

plt.tight_layout()

plt.savefig('malicious_shap_force.png')

print("恶意样本的SHAP力导向图已保存为 malicious_shap_force.png")

# 比较原始样本和恶意样本的SHAP值差异

diff_shap = malicious_shap_values - shap_values[0]

# 创建差异数据框

diff_df = pd.DataFrame({

'Feature': feature_names,

'Original_SHAP': shap_values[0],

'Malicious_SHAP': malicious_shap_values,

'SHAP_Diff': diff_shap

})

# 按SHAP差异排序

diff_df = diff_df.sort_values(by='SHAP_Diff', ascending=False)

print("\n原始样本与恶意样本的SHAP值差异(按影响从大到小排序):")

print(diff_df.head(10))

# 绘制差异图

plt.figure(figsize=(12, 8))

plt.barh(diff_df['Feature'][:10], diff_df['SHAP_Diff'][:10])

plt.xlabel('SHAP值差异')

plt.ylabel('特征')

plt.title('原始样本与恶意样本的SHAP值差异(Top 10)')

plt.tight_layout()

plt.savefig('shap_diff.png')

print("SHAP值差异图已保存为 shap_diff.png")这段代码实现了使用SHAP分析模型决策的功能,包括:

- 模型训练:训练一个简单的神经网络模型用于乳腺癌检测。

- SHAP解释:使用DeepExplainer计算SHAP值,解释模型决策。

- 可视化:绘制SHAP汇总图、单个样本的力导向图和部分依赖图。

- 攻击路径分析:通过比较原始样本和恶意样本的SHAP值,分析攻击路径。

3.3 自适应解释框架实现

自适应解释框架根据数据、模型、任务和用户的特点,动态调整解释策略。下面是一个简单的自适应解释框架实现:

import numpy as np

import pandas as pd

import shap

from sklearn.ensemble import RandomForestClassifier

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

# 自适应解释框架类

class AdaptiveExplainer:

def __init__(self, model, X_train, feature_names=None):

self.model = model

self.X_train = X_train

self.feature_names = feature_names

self.explainers = {}

# 初始化不同类型的解释器

self._init_explainers()

def _init_explainers(self):

"""初始化不同类型的解释器"""

# SHAP解释器

self.explainers['shap'] = shap.TreeExplainer(self.model, self.X_train)

def _select_explanation_strategy(self, X, task_type='classification', user_level='expert'):

"""根据数据、任务和用户水平选择解释策略"""

# 简单策略选择,实际应用中可以更复杂

if task_type == 'classification':

if user_level == 'expert':

return 'shap_force' # 专家用户需要详细的力导向图

else:

return 'shap_summary' # 普通用户需要直观的汇总图

elif task_type == 'regression':

return 'shap_dependence' # 回归任务需要依赖图

else:

return 'shap_summary' # 默认使用汇总图

def explain(self, X, task_type='classification', user_level='expert'):

"""生成自适应解释"""

# 选择解释策略

strategy = self._select_explanation_strategy(X, task_type, user_level)

# 生成SHAP值

shap_values = self.explainers['shap'].shap_values(X)

# 根据策略生成解释

if strategy == 'shap_summary':

return self._generate_summary_explanation(shap_values, X)

elif strategy == 'shap_force':

return self._generate_force_explanation(shap_values, X)

elif strategy == 'shap_dependence':

return self._generate_dependence_explanation(shap_values, X)

else:

return self._generate_summary_explanation(shap_values, X)

def _generate_summary_explanation(self, shap_values, X):

"""生成汇总解释"""

print("生成SHAP汇总解释...")

# 绘制汇总图

import matplotlib.pyplot as plt

plt.figure(figsize=(12, 8))

shap.summary_plot(shap_values, X, feature_names=self.feature_names, plot_type="bar")

plt.title("特征重要性SHAP汇总图")

plt.tight_layout()

plt.savefig('adaptive_shap_summary.png')

print("自适应SHAP汇总图已保存为 adaptive_shap_summary.png")

return {

'type': 'summary',

'plot_path': 'adaptive_shap_summary.png',

'explanation': '此图显示了每个特征对模型决策的平均影响,帮助理解模型的整体行为。'

}

def _generate_force_explanation(self, shap_values, X):

"""生成力导向解释"""

print("生成SHAP力导向解释...")

# 绘制第一个样本的力导向图

import matplotlib.pyplot as plt

plt.figure(figsize=(12, 8))

shap.initjs()

shap.force_plot(

self.explainers['shap'].expected_value[0],

shap_values[0],

X[0],

feature_names=self.feature_names,

matplotlib=True,

show=False

)

plt.title("单个样本的SHAP力导向图")

plt.tight_layout()

plt.savefig('adaptive_shap_force.png')

print("自适应SHAP力导向图已保存为 adaptive_shap_force.png")

return {

'type': 'force',

'plot_path': 'adaptive_shap_force.png',

'explanation': '此图显示了每个特征对单个样本决策的具体影响,帮助理解模型的局部行为。'

}

def _generate_dependence_explanation(self, shap_values, X):

"""生成依赖图解释"""

print("生成SHAP依赖图解释...")

# 绘制第一个特征的依赖图

import matplotlib.pyplot as plt

plt.figure(figsize=(12, 8))

shap.dependence_plot(0, shap_values, X, feature_names=self.feature_names, show=False)

plt.title("第一个特征的部分依赖图")

plt.tight_layout()

plt.savefig('adaptive_shap_dependence.png')

print("自适应SHAP依赖图已保存为 adaptive_shap_dependence.png")

return {

'type': 'dependence',

'plot_path': 'adaptive_shap_dependence.png',

'explanation': '此图显示了单个特征与模型输出之间的关系,帮助理解特征的非线性影响。'

}

# 示例用法

if __name__ == "__main__":

# 加载数据集

data = load_iris()

X = data.data

y = data.target

feature_names = data.feature_names

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 训练模型

model = RandomForestClassifier(n_estimators=100, random_state=42)

model.fit(X_train, y_train)

# 创建自适应解释器

adaptive_explainer = AdaptiveExplainer(model, X_train, feature_names=feature_names)

# 生成不同用户水平的解释

print("\n=== 为专家用户生成解释 ===")

expert_explanation = adaptive_explainer.explain(X_test[:1], task_type='classification', user_level='expert')

print("\n=== 为普通用户生成解释 ===")

novice_explanation = adaptive_explainer.explain(X_test[:1], task_type='classification', user_level='novice')

# 生成回归任务的解释(模拟)

print("\n=== 为回归任务生成解释 ===")

regression_explanation = adaptive_explainer.explain(X_test[:1], task_type='regression', user_level='expert')

# 评估模型准确率

accuracy = model.score(X_test, y_test)

print(f"\n模型准确率: {accuracy:.4f}")这段代码实现了一个自适应解释框架,包括:

- 解释器初始化:初始化不同类型的解释器,如SHAP解释器。

- 策略选择:根据数据、任务类型和用户水平选择合适的解释策略。

- 自适应解释生成:根据选择的策略生成不同类型的解释,如汇总图、力导向图和依赖图。

- 多场景支持:支持分类、回归等不同任务类型,以及专家、普通用户等不同用户水平。

3.4 因果可解释性实现

因果可解释性提供更可靠的决策依据,下面是一个简单的因果解释实现:

import numpy as np

import pandas as pd

import dowhy

from dowhy import CausalModel

import matplotlib.pyplot as plt

from sklearn.ensemble import RandomForestRegressor

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

# 生成模拟数据

def generate_causal_data(n_samples=1000, seed=42):

np.random.seed(seed)

# 生成特征

X1 = np.random.normal(0, 1, n_samples) # 外生变量1

X2 = np.random.normal(0, 1, n_samples) # 外生变量2

U = np.random.normal(0, 1, n_samples) # 未观察到的混杂因子

# 生成处理变量T(受X1和U影响)

T = 0.5 * X1 + 0.3 * U + np.random.normal(0, 0.1, n_samples)

# 生成结果变量Y(受T、X2和U影响)

Y = 2.0 * T + 0.5 * X2 + 0.2 * U + np.random.normal(0, 0.1, n_samples)

# 创建数据框

data = pd.DataFrame({

'X1': X1,

'X2': X2,

'T': T,

'Y': Y

})

return data

# 生成数据

data = generate_causal_data()

print("生成的数据示例:")

print(data.head())

# 步骤1:构建因果模型

model = CausalModel(

data=data,

treatment='T',

outcome='Y',

common_causes=['X1', 'X2'], # 观察到的混杂因子

instruments=None # 工具变量

)

# 步骤2:识别因果效应

identified_estimand = model.identify_effect()

print("\n识别的因果效应:")

print(identified_estimand)

# 步骤3:估计因果效应

# 使用倾向评分匹配方法

estimate = model.estimate_effect(

identified_estimand,

method_name="backdoor.propensity_score_matching"

)

print("\n估计的平均因果效应(ATE):")

print(estimate)

# 使用多种方法估计,验证结果

methods = [

"backdoor.propensity_score_matching",

"backdoor.propensity_score_weighting",

"backdoor.linear_regression"

]

print("\n使用多种方法估计因果效应:")

for method in methods:

estimate = model.estimate_effect(

identified_estimand,

method_name=method

)

print(f"{method}: {estimate.value:.4f}")

# 步骤4:反驳估计结果

print("\n=== 反驳测试 ===")

# 1. 随机化处理变量

refute1_results = model.refute_estimate(

identified_estimand, estimate, method_name="random_common_cause"

)

print(f"随机化混杂因子: {refute1_results}")

# 2. 安慰剂处理

refute2_results = model.refute_estimate(

identified_estimand, estimate, method_name="placebo_treatment_refuter"

)

print(f"安慰剂处理: {refute2_results}")

# 3. 数据子集验证

refute3_results = model.refute_estimate(

identified_estimand, estimate, method_name="data_subset_refuter", subset_fraction=0.8

)

print(f"数据子集验证: {refute3_results}")

# 使用因果特征选择

print("\n=== 因果特征选择 ===")

# 生成包含无关特征的数据

np.random.seed(42)

data_with_noise = data.copy()

for i in range(5):

data_with_noise[f'Noise_{i}'] = np.random.normal(0, 1, len(data))

# 定义因果图

causal_graph = """

digraph {

X1 -> T;

X2 -> Y;

T -> Y;

U -> T;

U -> Y;

Noise_0 -> Y [arrowhead="none"]; # 无关特征,没有因果关系

Noise_1 -> Y [arrowhead="none"];

Noise_2 -> Y [arrowhead="none"];

Noise_3 -> Y [arrowhead="none"];

Noise_4 -> Y [arrowhead="none"];

}

"""

# 使用包含无关特征的数据构建模型

model_with_noise = CausalModel(

data=data_with_noise,

treatment='T',

outcome='Y',

graph=causal_graph

)

# 识别因果效应

identified_estimand_with_noise = model_with_noise.identify_effect()

# 估计因果效应(使用线性回归,包含所有特征)

estimate_with_noise = model_with_noise.estimate_effect(

identified_estimand_with_noise,

method_name="backdoor.linear_regression",

control_value=0,

treatment_value=1

)

print(f"包含无关特征的线性回归ATE估计: {estimate_with_noise.value:.4f}")

# 比较基于相关性的特征重要性和基于因果性的特征重要性

print("\n=== 相关性 vs 因果性特征重要性 ===")

# 基于相关性的特征重要性

corr_importance = data_with_noise.corr()['Y'].abs().sort_values(ascending=False)

print("基于相关性的特征重要性:")

print(corr_importance)

# 基于因果性的特征重要性(使用因果图分析)

causal_features = ['T', 'X2'] # 根据因果图,只有T和X2直接影响Y

print("\n基于因果图的特征重要性:")

print(f"直接因果特征: {causal_features}")

print(f"无关特征: {[col for col in data_with_noise.columns if col not in causal_features + ['Y', 'X1']]}")

# 反事实解释示例

print("\n=== 反事实解释示例 ===")

# 选择一个样本

sample = data.iloc[0]

print(f"原始样本: {sample.to_dict()}")

# 训练预测模型

from sklearn.linear_model import LinearRegression

X = data[['T', 'X1', 'X2']]

y = data['Y']

predict_model = LinearRegression()

predict_model.fit(X, y)

# 原始预测

original_pred = predict_model.predict(sample[['T', 'X1', 'X2']].values.reshape(1, -1))[0]

print(f"原始预测: {original_pred:.4f}")

# 反事实:如果T增加1,预测结果会怎样

counterfactual_sample = sample.copy()

counterfactual_sample['T'] += 1

counterfactual_pred = predict_model.predict(counterfactual_sample[['T', 'X1', 'X2']].values.reshape(1, -1))[0]

print(f"反事实预测(T增加1): {counterfactual_pred:.4f}")

print(f"预测变化: {counterfactual_pred - original_pred:.4f}")

# 基于因果估计的反事实预测

causal_effect = estimate.value # 使用之前估计的因果效应

causal_counterfactual_pred = original_pred + causal_effect

print(f"基于因果效应的反事实预测: {causal_counterfactual_pred:.4f}")

print(f"因果效应: {causal_effect:.4f}")

# 可视化因果关系

import networkx as nx

import matplotlib.pyplot as plt

# 构建因果图

G = nx.DiGraph()

G.add_edges_from([

('X1', 'T'),

('U', 'T'),

('U', 'Y'),

('T', 'Y'),

('X2', 'Y')

])

# 绘制因果图

plt.figure(figsize=(10, 6))

pos = nx.spring_layout(G, seed=42)

nx.draw(G, pos, with_labels=True, node_size=2000, node_color='lightblue', font_size=12, font_weight='bold', arrows=True, arrowsize=20)

nx.draw_networkx_edge_labels(G, pos, edge_labels={('X1', 'T'): '0.5', ('U', 'T'): '0.3', ('U', 'Y'): '0.2', ('T', 'Y'): '2.0', ('X2', 'Y'): '0.5'})

plt.title('因果图可视化')

plt.tight_layout()

plt.savefig('causal_graph.png')

print("\n因果图已保存为 causal_graph.png")这段代码实现了因果可解释性,包括:

- 因果模型构建:使用DoWhy库构建因果模型,定义处理变量、结果变量和混杂因子。

- 因果效应估计:使用多种方法估计因果效应,验证结果的可靠性。

- 反驳测试:通过随机化处理变量、安慰剂处理等方法验证因果效应估计的可靠性。

- 因果特征选择:基于因果图分析,识别真正的因果特征,排除无关特征。

- 反事实解释:生成反事实样本,解释"如果…会怎样"的问题。

- 因果图可视化:使用NetworkX绘制因果图,直观展示变量之间的因果关系。

3.5 Mermaid图表:可解释性技术架构

这个Mermaid图表展示了可解释性技术的整体架构,包括:

- 模型内在可解释性:如线性模型、决策树、规则模型等,本身具有可解释性。

- 模型事后可解释性:如特征重要性、决策可视化、注意力可视化等,在模型训练后解释模型决策。

- 安全特定解释:针对安全场景的特殊解释技术,如对抗解释、异常解释、攻击路径解释等。

- 自适应解释框架:根据数据、任务、模型和用户特点,动态调整解释策略。

- 因果可解释性:从因果关系角度解释模型决策,提供更可靠的决策依据。

- 工程应用:可解释性技术在模型调试、攻击检测、公平性验证和合规报告等方面的应用。

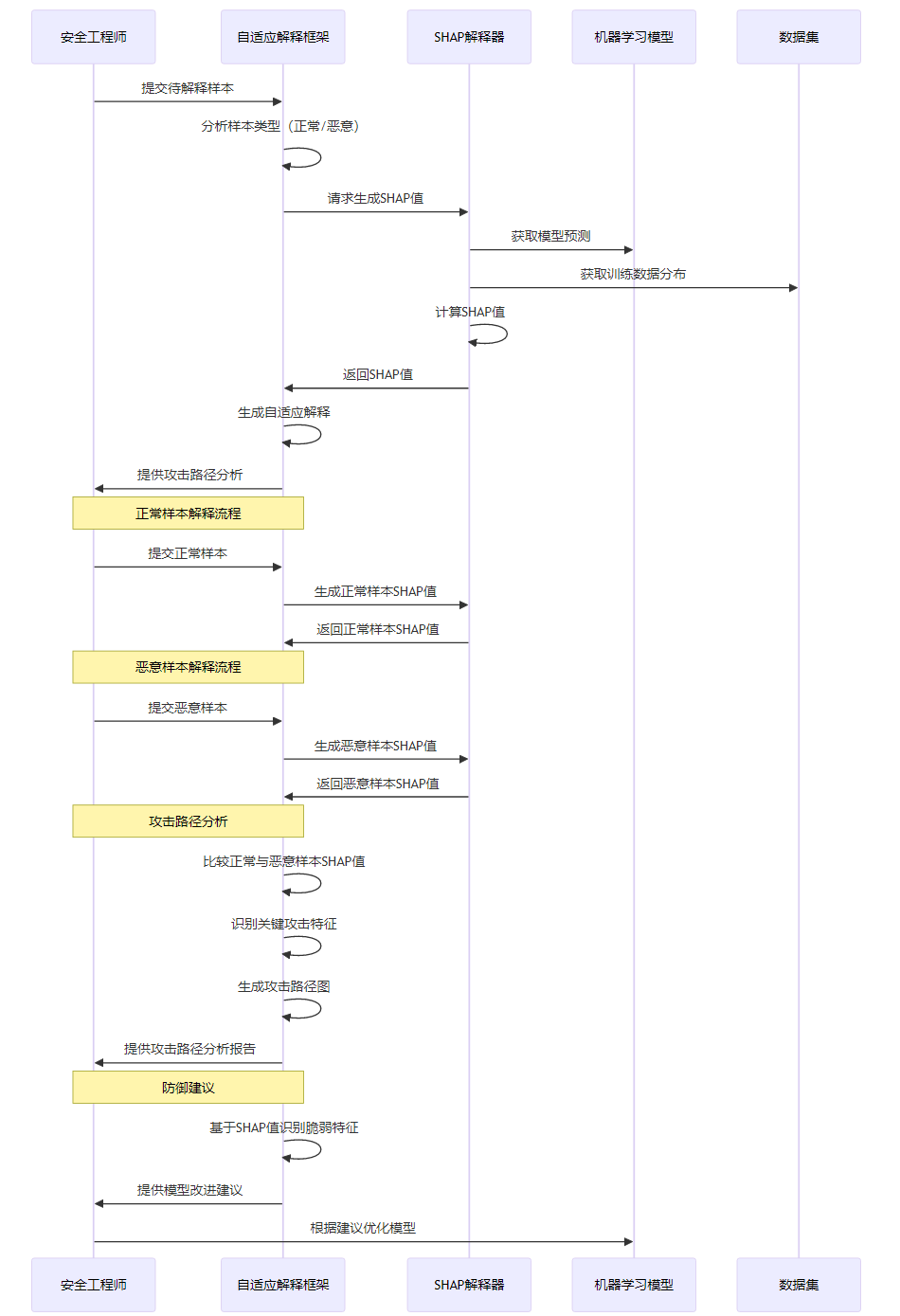

3.6 Mermaid图表:SHAP分析攻击路径流程

这个Mermaid序列图展示了使用SHAP分析攻击路径的完整流程,包括:

- 样本提交:安全工程师向自适应解释框架提交待解释样本。

- SHAP值生成:自适应解释框架调用SHAP解释器,生成样本的SHAP值。

- 自适应解释:自适应解释框架根据样本类型和用户需求,生成自适应解释。

- 攻击路径分析:比较正常样本和恶意样本的SHAP值,识别关键攻击特征,生成攻击路径图。

- 防御建议:基于SHAP值识别模型的脆弱特征,提供模型改进建议。

4. 与主流方案深度对比

4.1 可解释性技术对比

技术类型 | 代表方法 | 解释粒度 | 模型兼容性 | 计算成本 | 安全适用性 | 优势 | 局限性 |

|---|---|---|---|---|---|---|---|

内在可解释性 | 线性模型、决策树 | 全局/局部 | 有限 | 低 | 中 | 解释直观,易于理解 | 模型表达能力有限 |

基于特征重要性 | SHAP、LIME | 全局/局部 | 广泛 | 中高 | 高 | 可以解释黑盒模型,结果准确 | 计算成本高,对于高维数据效率低 |

基于可视化 | 注意力图、热力图 | 局部 | 特定模型 | 中 | 中 | 直观展示模型关注点 | 缺乏定量分析,解释主观性强 |

基于规则 | 提取规则集 | 全局/局部 | 广泛 | 高 | 中 | 解释精确,易于验证 | 规则数量多,难以管理 |

基于原型 | 原型网络、反事实解释 | 局部 | 广泛 | 高 | 高 | 易于理解,提供对比解释 | 原型选择困难,计算成本高 |

因果可解释性 | DoWhy、因果图 | 全局/局部 | 广泛 | 高 | 高 | 提供可靠的因果关系,避免相关性误导 | 需要因果知识,建模复杂 |

自适应解释 | 自适应框架 | 全局/局部 | 广泛 | 中高 | 高 | 根据需求动态调整解释策略 | 框架设计复杂,需要大量调优 |

4.2 安全场景下解释方法选择

安全场景 | 推荐解释方法 | 解释目标 | 优势 | 实施难度 |

|---|---|---|---|---|

模型调试 | SHAP、因果可解释性 | 定位模型漏洞 | 提供精确的特征重要性,识别错误模式 | 中 |

对抗样本检测 | SHAP、反事实解释 | 识别异常特征依赖 | 比较正常与恶意样本的特征贡献,发现异常模式 | 高 |

异常检测 | SHAP、LIME、原型解释 | 解释异常原因 | 提供异常样本的特征重要性,便于理解异常模式 | 中 |

公平性验证 | 因果可解释性、特征重要性 | 检测偏见和歧视 | 识别敏感特征的影响,确保公平性 | 高 |

合规报告 | 规则提取、SHAP汇总图 | 提供可审计的解释 | 生成结构化报告,满足合规要求 | 中 |

攻击路径分析 | SHAP、因果可解释性 | 识别关键攻击步骤 | 可视化攻击路径,帮助理解攻击机制 | 高 |

4.3 可解释性与安全性的权衡

权衡维度 | 高可解释性 | 高安全性 | 平衡点建议 |

|---|---|---|---|

模型复杂度 | 简单模型(线性、决策树) | 复杂模型(深度学习) | 使用可解释的复杂模型(如注意力机制) |

计算成本 | 低 | 高 | 根据场景选择合适的解释方法,如实时场景使用简化解释 |

解释准确性 | 高 | 中 | 使用多种解释方法交叉验证,确保解释准确性 |

鲁棒性 | 中 | 高 | 选择鲁棒的解释方法,避免被攻击者操纵 |

实施难度 | 低 | 高 | 从简单解释开始,逐步引入复杂解释技术 |

用户体验 | 好 | 中 | 提供交互式解释界面,平衡解释深度和易用性 |

5. 实际工程意义、潜在风险与局限性分析

5.1 实际工程意义

可解释性技术在安全领域具有重要的工程意义:

- 加速模型调试:通过解释模型决策,快速定位模型漏洞和错误模式,缩短调试时间。

- 增强模型鲁棒性:识别模型的脆弱特征,针对性地增强对对抗攻击的抵御能力。

- 改进安全策略:将模型决策与领域知识结合,优化安全策略和响应机制。

- 提高系统透明度:向安全分析师解释模型决策,提高系统的透明度和可信度。

- 满足合规要求:某些行业(如金融、医疗)要求模型决策可解释,可解释性技术可以帮助满足这些要求。

- 促进人机协作:帮助安全分析师理解模型决策,促进人机协作,提高安全系统的整体性能。

5.2 潜在风险

可解释性技术也存在一些潜在风险:

- 解释错误:错误的解释可能导致安全工程师做出错误的决策,影响系统安全性。

- 解释操纵:攻击者可能操纵解释过程,生成误导性的解释,干扰安全分析。

- 计算开销:复杂的解释方法可能带来巨大的计算开销,影响系统的实时性能。

- 隐私泄露:解释过程可能泄露敏感信息,如训练数据、模型参数等。

- 过度依赖解释:安全工程师可能过度依赖解释结果,忽略其他重要的安全因素。

- 解释复杂度:过于复杂的解释可能难以理解,降低解释的实际价值。

5.3 局限性

当前可解释性技术还存在一些局限性:

- 解释准确性:大多数解释方法都是近似的,不能完全准确地反映模型的真实决策过程。

- 模型兼容性:某些解释方法只适用于特定类型的模型,如SHAP的TreeExplainer只适用于树模型。

- 高维数据挑战:对于高维数据(如文本、图像),解释结果难以可视化和理解。

- 因果关系难以确定:大多数解释方法基于相关性,难以确定真正的因果关系。

- 缺乏统一标准:目前缺乏统一的可解释性评估标准,难以比较不同方法的效果。

- 动态环境适应性:模型在动态环境中的行为变化,解释方法难以实时适应。

6. 未来趋势展望与个人前瞻性预测

6.1 趋势1:安全特定可解释性技术的发展

未来,针对安全场景的特定可解释性技术将成为研究热点:

- 对抗解释增强:开发专门用于对抗样本检测和防御的解释技术,提高模型对对抗攻击的抵御能力。

- 异常解释自动化:实现异常检测结果的自动解释,减少安全分析师的工作量。

- 攻击路径可视化:开发更直观的攻击路径可视化工具,帮助安全工程师理解攻击机制。

- 鲁棒性解释:解释模型的鲁棒性表现,识别脆弱的特征和决策边界。

6.2 趋势2:自适应可解释性框架的普及

自适应可解释性框架将在实际工程中得到广泛应用:

- 多模态自适应解释:支持文本、图像、音频等多模态数据的自适应解释。

- 实时自适应解释:实现实时的自适应解释,满足安全系统的实时性要求。

- 交互式解释界面:提供交互式解释界面,允许安全分析师探索模型决策过程。

- 个性化解释:根据安全分析师的背景和经验,提供个性化的解释内容。

6.3 趋势3:因果可解释性的深入研究

因果可解释性将成为可解释性领域的重要发展方向:

- 因果发现与解释结合:将因果发现技术与可解释性技术结合,自动发现和解释因果关系。

- 反事实解释增强:开发更有效的反事实解释方法,提供更直观的"如果…会怎样"解释。

- 因果图自动化构建:实现因果图的自动构建和更新,适应动态环境。

- 因果干预验证:通过因果干预验证解释结果的可靠性,确保解释的准确性。

6.4 趋势4:可解释性与安全性的深度融合

可解释性技术将与安全技术深度融合,形成一体化的安全机器学习系统:

- 可解释的安全模型设计:在模型设计阶段考虑可解释性,开发内在可解释的安全模型。

- 解释驱动的安全防御:基于解释结果,自动调整安全防御策略,提高系统的自适应能力。

- 解释增强的攻击检测:结合解释技术,提高攻击检测的准确性和可解释性。

- 可解释的联邦学习:在联邦学习场景下,实现分布式模型的可解释性,保护数据隐私。

6.5 趋势5:可解释性评估标准的建立

统一的可解释性评估标准将逐渐建立:

- 定量评估指标:开发定量的可解释性评估指标,如解释准确性、解释完整性、解释鲁棒性等。

- 定性评估框架:建立定性的可解释性评估框架,如用户满意度调查、专家评估等。

- 基准数据集:创建专门用于可解释性评估的基准数据集,便于比较不同方法的效果。

- 标准化工具:开发标准化的可解释性工具和库,促进可解释性技术的普及和应用。

6.6 趋势6:硬件加速的可解释性

硬件加速将提高可解释性技术的计算效率:

- GPU/TPU加速:利用GPU/TPU加速SHAP值计算等 computationally intensive 的可解释性任务。

- 专用硬件设计:设计专门用于可解释性计算的硬件加速器,提高计算效率。

- 边缘设备可解释性:在边缘设备上实现高效的可解释性计算,满足边缘计算的实时性要求。

7. 参考链接

- SHAP官方文档

- LIME官方文档

- DoWhy官方文档

- Interpretable Machine Learning - Christoph Molnar

- SHAP: A Unified Approach to Interpreting Model Predictions

- Why Should I Trust You? Explaining the Predictions of Any Classifier

- Causal Inference in Statistics: A Primer - Judea Pearl

- Explaining and Harnessing Adversarial Examples

- Adversarial Robustness Toolbox

- The Algorithmic Foundations of Differential Privacy

8. 附录

8.1 可解释性工具库比较

工具库 | 支持模型类型 | 主要功能 | 优势 | 局限性 |

|---|---|---|---|---|

SHAP | 广泛(树模型、深度学习、线性模型等) | 特征重要性、力导向图、依赖图等 | 理论基础扎实,结果准确 | 计算成本高,对于大规模数据效率低 |

LIME | 广泛 | 局部解释、特征重要性 | 实现简单,易于理解 | 解释结果不稳定,依赖于局部近似 |

DoWhy | 广泛 | 因果效应估计、反驳测试 | 基于因果推断理论,结果可靠 | 需要因果知识,建模复杂 |

InterpretML | 广泛 | 多种解释方法集成 | 易于使用,可视化效果好 | 功能相对简单,缺乏高级特性 |

Captum | 深度学习模型 | 特征重要性、注意力可视化 | 专为PyTorch设计,支持复杂模型 | 只支持PyTorch,兼容性有限 |

Alibi | 广泛 | 反事实解释、原型解释 | 支持多种高级解释方法 | 文档不够完善,学习曲线陡峭 |

8.2 可解释性评估指标

指标 | 计算公式 | 含义 | 适用场景 |

|---|---|---|---|

解释准确性 | 解释与真实决策过程的一致性 | 衡量解释的准确性 | 所有解释方法 |

解释完整性 | 解释覆盖的特征比例 | 衡量解释的完整性 | 特征重要性解释 |

解释稳定性 | 相似样本的解释一致性 | 衡量解释的稳定性 | 局部解释方法 |

解释鲁棒性 | 对抗扰动下解释的稳定性 | 衡量解释的鲁棒性 | 安全场景下的解释 |

解释简洁性 | 解释中包含的特征数量 | 衡量解释的简洁性 | 所有解释方法 |

用户满意度 | 用户对解释的评价分数 | 衡量解释的实用性 | 交互式解释系统 |

解释效率 | 生成解释所需的时间 | 衡量解释的效率 | 实时场景下的解释 |

8.3 环境配置

# 安装基本依赖

pip install numpy pandas scikit-learn matplotlib seaborn

# 安装深度学习框架

pip install torch torchvision tensorflow

# 安装可解释性库

pip install shap lime dowhy interpret captum alibi

# 安装因果推断库

pip install causality==0.0.1 causalnex==0.11.0

# 安装可视化库

pip install networkx pydot graphviz

# 安装安全相关库

pip install adversarial-robustness-toolbox8.4 可解释性最佳实践

- 选择合适的解释方法:根据模型类型、数据特点和应用场景,选择合适的解释方法。

- 结合多种解释方法:使用多种解释方法交叉验证,提高解释的可靠性。

- 考虑用户需求:根据用户的背景和需求,调整解释的形式和复杂度。

- 关注安全特定需求:在安全场景下,重点关注对抗解释、异常解释和攻击路径分析。

- 确保解释的鲁棒性:选择鲁棒的解释方法,避免被攻击者操纵。

- 平衡解释准确性和效率:根据场景需求,平衡解释的准确性和计算效率。

- 可视化解释结果:使用直观的可视化方式展示解释结果,提高解释的可读性。

- 持续评估和改进:定期评估解释方法的效果,持续改进解释质量。

9. 关键词

可解释性, SHAP, LIME, 因果可解释性, 自适应解释, 攻击路径分析, 对抗解释, 异常解释, 安全机器学习, 模型调试, 特征重要性, 反事实解释

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-17,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录