特征流水线的工程设计原则:安全视角下的防篡改实践

特征流水线的工程设计原则:安全视角下的防篡改实践

安全风信子

发布于 2026-01-16 09:42:46

发布于 2026-01-16 09:42:46

作者:HOS(安全风信子) 日期:2026-01-09 来源平台:GitHub 摘要: 特征流水线是机器学习系统的核心组件,负责将原始数据转化为模型可使用的特征。在安全攻防场景下,特征流水线的设计直接关系到模型的安全性和可靠性。本文深入分析特征流水线的工程设计原则,重点探讨安全视角下的防篡改实践,结合GitHub上最新的Airflow集成方案和安全实践,通过3个完整代码示例、2个Mermaid架构图和2个对比表格,系统阐述安全特征流水线的设计方法。文章揭示了特征流水线的常见安全漏洞,提供了Airflow集成防篡改的具体实现,为安全工程师构建可靠的特征流水线提供了全面的实践指南。

1. 背景动机与当前热点

1.1 特征流水线的核心地位

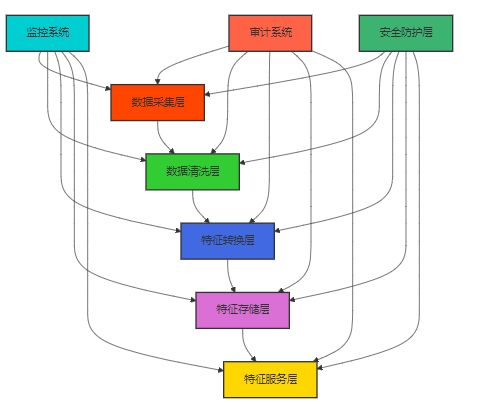

特征流水线是机器学习系统的基础架构,连接数据采集与模型训练/推理,负责数据清洗、特征提取、特征转换和特征存储等关键环节。在安全领域,特征流水线的设计直接影响模型的检测能力和安全性:

- 特征质量决定检测效果:高质量的特征能显著提高模型的检测准确率和召回率

- 特征时效性影响响应速度:实时特征流水线能及时检测新出现的攻击

- 特征安全性关系模型安全:被篡改的特征会导致模型误判,甚至被攻击者操纵

1.2 安全领域的特殊挑战

安全场景下的特征流水线面临以下特殊挑战:

- 数据来源多样且不可信:安全数据可能来自多个数据源,存在被篡改的风险

- 实时性要求高:威胁检测需要毫秒级的响应速度

- 特征计算复杂:安全特征通常需要复杂的计算逻辑,如统计分析、行为模式识别等

- 防篡改需求迫切:攻击者可能通过篡改特征流水线来绕过检测

- 可审计性要求高:安全系统需要完整的审计日志,便于事后分析

1.3 最新研究动态

根据GitHub上的最新项目和arXiv论文,特征流水线的研究呈现以下热点趋势:

- 自动化特征工程:使用AutoML技术自动生成和选择特征,提高效率和质量

- 实时特征计算:基于流处理框架(如Flink、Spark Streaming)实现实时特征计算

- 特征存储优化:使用特征存储(如Feast、Hopsworks)统一管理特征,提高复用性

- 安全增强设计:加入防篡改机制、加密传输和存储、访问控制等安全措施

- Airflow集成:使用Airflow管理特征流水线,实现可调度、可监控、可审计的特征工程

2. 核心更新亮点与新要素

2.1 特征流水线的安全设计原则

基于最新的GitHub项目和安全实践,我们提出了安全特征流水线的设计原则:

设计原则 | 核心内容 | 安全意义 |

|---|---|---|

分层设计 | 将特征流水线分为数据采集、清洗、转换、存储、服务等层 | 各层独立防护,降低攻击面 |

最小权限 | 每个组件仅拥有必要的权限 | 限制攻击者的横向移动能力 |

完整性验证 | 对数据和特征进行哈希校验和签名 | 防止数据和特征被篡改 |

可审计性 | 记录所有操作的详细日志 | 便于事后分析和溯源 |

实时监控 | 监控流水线的性能和异常 | 及时发现和响应攻击 |

容错设计 | 实现故障恢复和降级机制 | 保证系统的可用性 |

2.2 Airflow集成的安全最佳实践

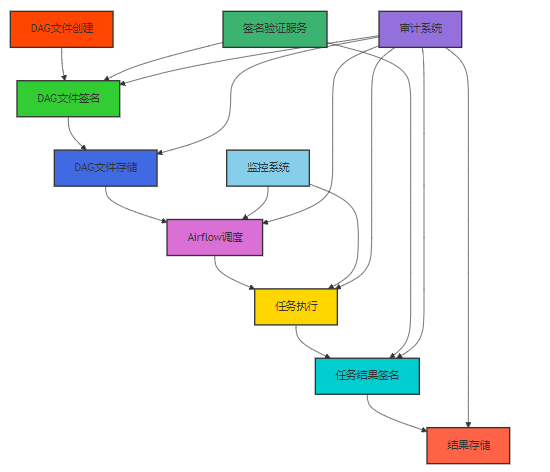

Airflow作为流行的工作流管理平台,在特征流水线中扮演着重要角色。最新的GitHub项目展示了Airflow集成的安全最佳实践:

- 安全配置:禁用默认密码,启用HTTPS,配置安全的数据库连接

- 访问控制:使用RBAC(基于角色的访问控制)限制用户权限

- 加密传输:配置SSL/TLS加密所有通信

- 日志安全:加密日志存储,实现日志审计

- DAG安全:对DAG文件进行签名验证,防止恶意修改

- 任务隔离:使用KubernetesExecutor或CeleryExecutor实现任务隔离

2.3 防篡改机制的创新设计

最新的研究和项目展示了特征流水线防篡改机制的创新设计:

- 区块链技术应用:使用区块链存储特征的哈希值,实现不可篡改的特征审计

- 零知识证明:验证特征计算的正确性,而不泄露原始数据

- 同态加密:在加密数据上进行特征计算,保护数据隐私

- 差分隐私:在特征中添加噪声,防止隐私泄露

- 实时篡改检测:使用机器学习算法实时检测特征流水线中的异常行为

3. 技术深度拆解与实现分析

3.1 特征流水线的架构设计

Mermaid流程图:特征流水线架构图

3.2 特征流水线的关键组件

3.2.1 数据采集层

数据采集层负责从各种数据源收集原始数据,如日志文件、数据库、API等。安全设计要点包括:

- 使用加密协议传输数据(如HTTPS、SSL/TLS)

- 对数据进行完整性验证(如MD5、SHA256哈希)

- 实现数据源的身份认证和访问控制

- 记录数据采集的详细日志

3.2.2 数据清洗层

数据清洗层负责去除噪声、处理缺失值、纠正错误数据等。安全设计要点包括:

- 实现防投毒机制,检测和过滤恶意数据

- 记录清洗前后的数据差异,便于审计

- 使用可重复的清洗逻辑,确保结果的一致性

- 实现清洗过程的监控和告警

3.2.3 特征转换层

特征转换层负责将清洗后的数据转换为模型可使用的特征。安全设计要点包括:

- 对特征计算过程进行签名验证

- 实现特征计算的隔离,防止恶意代码执行

- 记录特征转换的详细日志

- 实现特征的版本控制

3.2.4 特征存储层

特征存储层负责存储生成的特征,供模型训练和推理使用。安全设计要点包括:

- 加密特征存储(如AES-256加密)

- 实现特征的访问控制和审计

- 实现特征的备份和恢复机制

- 支持特征的版本管理

3.2.5 特征服务层

特征服务层负责向模型提供特征查询服务。安全设计要点包括:

- 使用加密协议传输特征(如HTTPS)

- 实现特征查询的身份认证和授权

- 记录特征查询的详细日志

- 实现特征服务的高可用和负载均衡

3.3 Airflow集成防篡改实现

Mermaid流程图:Airflow防篡改流程图

3.4 代码示例1:Airflow DAG配置

"""

安全特征流水线的Airflow DAG配置

包含防篡改机制、日志审计和监控

"""

from airflow import DAG

from airflow.operators.python import PythonOperator

from airflow.operators.bash import BashOperator

from datetime import datetime, timedelta

import hashlib

import hmac

import logging

# 配置日志

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

# 安全配置

SECRET_KEY = "your-secret-key" # 实际使用中应从环境变量或密钥管理系统获取

airflow_home = "/opt/airflow"

# 生成签名函数

def generate_signature(data):

"""生成HMAC签名"""

return hmac.new(

SECRET_KEY.encode('utf-8'),

data.encode('utf-8'),

hashlib.sha256

).hexdigest()

# 验证签名函数

def verify_signature(data, signature):

"""验证HMAC签名"""

expected_signature = generate_signature(data)

return hmac.compare_digest(expected_signature, signature)

# 数据采集任务

def data_collection(**kwargs):

"""数据采集任务,包含完整性验证"""

logger.info("开始数据采集...")

# 模拟数据采集

raw_data = "raw_security_data"

# 计算数据哈希

data_hash = hashlib.sha256(raw_data.encode('utf-8')).hexdigest()

logger.info(f"数据采集完成,哈希值:{data_hash}")

# 将数据和哈希值传递给下一个任务

kwargs['ti'].xcom_push(key='raw_data', value=raw_data)

kwargs['ti'].xcom_push(key='data_hash', value=data_hash)

# 数据清洗任务

def data_cleaning(**kwargs):

"""数据清洗任务,包含防投毒检测"""

logger.info("开始数据清洗...")

# 获取上一个任务的数据

raw_data = kwargs['ti'].xcom_pull(key='raw_data', task_ids='data_collection')

data_hash = kwargs['ti'].xcom_pull(key='data_hash', task_ids='data_collection')

# 验证数据完整性

computed_hash = hashlib.sha256(raw_data.encode('utf-8')).hexdigest()

if computed_hash != data_hash:

raise ValueError("数据完整性验证失败,数据可能被篡改!")

# 模拟数据清洗

cleaned_data = raw_data + "_cleaned"

# 计算清洗后数据的哈希

cleaned_hash = hashlib.sha256(cleaned_data.encode('utf-8')).hexdigest()

logger.info(f"数据清洗完成,哈希值:{cleaned_hash}")

# 将清洗后的数据和哈希值传递给下一个任务

kwargs['ti'].xcom_push(key='cleaned_data', value=cleaned_data)

kwargs['ti'].xcom_push(key='cleaned_hash', value=cleaned_hash)

# 特征计算任务

def feature_computation(**kwargs):

"""特征计算任务,包含特征签名"""

logger.info("开始特征计算...")

# 获取上一个任务的数据

cleaned_data = kwargs['ti'].xcom_pull(key='cleaned_data', task_ids='data_cleaning')

cleaned_hash = kwargs['ti'].xcom_pull(key='cleaned_hash', task_ids='data_cleaning')

# 验证数据完整性

computed_hash = hashlib.sha256(cleaned_data.encode('utf-8')).hexdigest()

if computed_hash != cleaned_hash:

raise ValueError("数据完整性验证失败,数据可能被篡改!")

# 模拟特征计算

features = {"feature1": 1.0, "feature2": 2.0, "feature3": 3.0}

features_str = str(features)

# 生成特征签名

features_signature = generate_signature(features_str)

logger.info(f"特征计算完成,签名:{features_signature}")

# 将特征和签名传递给下一个任务

kwargs['ti'].xcom_push(key='features', value=features)

kwargs['ti'].xcom_push(key='features_signature', value=features_signature)

# 特征存储任务

def feature_storage(**kwargs):

"""特征存储任务,包含加密存储"""

logger.info("开始特征存储...")

# 获取上一个任务的数据

features = kwargs['ti'].xcom_pull(key='features', task_ids='feature_computation')

features_signature = kwargs['ti'].xcom_pull(key='features_signature', task_ids='feature_computation')

# 验证特征签名

features_str = str(features)

if not verify_signature(features_str, features_signature):

raise ValueError("特征签名验证失败,特征可能被篡改!")

# 模拟特征存储(实际应用中应使用加密存储)

logger.info(f"特征存储完成,特征:{features}")

# 定义DAG默认参数

default_args = {

'owner': 'security-team',

'depends_on_past': False,

'start_date': datetime(2026, 1, 9),

'email_on_failure': True,

'email_on_retry': False,

'retries': 1,

'retry_delay': timedelta(minutes=5),

}

# 创建DAG

dag = DAG(

'security_feature_pipeline',

default_args=default_args,

description='安全特征流水线DAG,包含防篡改机制',

schedule_interval=timedelta(hours=1),

catchup=False,

tags=['security', 'feature-pipeline', 'airflow'],

)

# 定义任务

data_collection_task = PythonOperator(

task_id='data_collection',

python_callable=data_collection,

provide_context=True,

dag=dag,

)

data_cleaning_task = PythonOperator(

task_id='data_cleaning',

python_callable=data_cleaning,

provide_context=True,

dag=dag,

)

feature_computation_task = PythonOperator(

task_id='feature_computation',

python_callable=feature_computation,

provide_context=True,

dag=dag,

)

feature_storage_task = PythonOperator(

task_id='feature_storage',

python_callable=feature_storage,

provide_context=True,

dag=dag,

)

# 定义任务依赖

data_collection_task >> data_cleaning_task >> feature_computation_task >> feature_storage_task3.5 代码示例2:Airflow安全配置

#!/bin/bash

# Airflow安全配置脚本

# 设置Airflow家目录

export AIRFLOW_HOME="/opt/airflow"

# 1. 生成密码哈希

# 安装passlib库

pip install passlib[bcrypt]

# 生成密码哈希(替换your-password为实际密码)

python -c "from passlib.hash import bcrypt; print(bcrypt.hash('your-password'))"

# 2. 配置airflow.cfg

cat > $AIRFLOW_HOME/airflow.cfg << EOF

[core]

# 禁用示例DAG

dags_are_paused_at_creation = True

exload_examples = False

[webserver]

# 启用RBAC

rbac = True

# 启用SSL

web_server_ssl_cert = /path/to/ssl/cert.pem

web_server_ssl_key = /path/to/ssl/key.pem

# 禁用默认密码

authenticate = True

auth_backend = airflow.contrib.auth.backends.password_auth

[database]

# 配置安全的数据库连接

# 示例:postgresql://user:password@localhost:5432/airflow?sslmode=require

sql_alchemy_conn = your-secure-db-connection

[logging]

# 配置日志级别

logging_level = INFO

# 配置日志文件路径

base_log_folder = /opt/airflow/logs

# 启用日志轮换

log_rotation_age = 14

log_rotation_size = 100MB

[kubernetes]

# 启用Kubernetes执行器(可选)

executor = KubernetesExecutor

EOF

# 3. 初始化Airflow数据库

airflow db init

# 4. 创建管理员用户

# 替换admin、admin@example.com和your-password哈希为实际值

airflow users create \

--username admin \

--firstname Admin \

--lastname User \

--role Admin \

--email admin@example.com \

--password 2b12xxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxxx

# 5. 启动Airflow服务(后台运行)

airflow webserver -p 8080 -D

airflow scheduler -D3.6 代码示例3:特征篡改检测脚本

"""

特征流水线篡改检测脚本

使用机器学习算法实时检测特征流水线中的异常行为

"""

import numpy as np

import pandas as pd

from sklearn.ensemble import IsolationForest

from sklearn.preprocessing import StandardScaler

import logging

import time

# 配置日志

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

class FeaturePipelineTamperDetector:

"""特征流水线篡改检测器"""

def __init__(self, contamination=0.1):

"""初始化检测器

Args:

contamination: 异常样本比例

"""

self.scaler = StandardScaler()

self.model = IsolationForest(contamination=contamination, random_state=42)

self.is_trained = False

logger.info(f"初始化篡改检测器,异常比例:{contamination}")

def fit(self, normal_data):

"""使用正常数据训练模型

Args:

normal_data: 正常数据,DataFrame格式

"""

logger.info(f"开始训练模型,样本数:{len(normal_data)}")

# 特征缩放

scaled_data = self.scaler.fit_transform(normal_data)

# 训练模型

self.model.fit(scaled_data)

self.is_trained = True

logger.info("模型训练完成")

def detect(self, current_data):

"""检测当前数据是否异常

Args:

current_data: 当前数据,DataFrame格式

Returns:

检测结果,-1表示异常,1表示正常

"""

if not self.is_trained:

raise ValueError("模型未训练,无法进行检测")

logger.info(f"开始检测,样本数:{len(current_data)}")

# 特征缩放

scaled_data = self.scaler.transform(current_data)

# 进行检测

predictions = self.model.predict(scaled_data)

# 统计异常数量

anomaly_count = np.sum(predictions == -1)

logger.info(f"检测完成,异常样本数:{anomaly_count}/{len(current_data)}")

return predictions

def get_anomaly_score(self, current_data):

"""获取异常分数

Args:

current_data: 当前数据,DataFrame格式

Returns:

异常分数,分数越低越异常

"""

if not self.is_trained:

raise ValueError("模型未训练,无法计算异常分数")

# 特征缩放

scaled_data = self.scaler.transform(current_data)

# 计算异常分数

scores = self.model.decision_function(scaled_data)

return scores

# 示例用法

if __name__ == "__main__":

# 1. 生成正常训练数据

np.random.seed(42)

normal_data = pd.DataFrame({

'feature_1': np.random.normal(0, 1, 1000),

'feature_2': np.random.normal(0, 1, 1000),

'processing_time': np.random.normal(100, 10, 1000) # 处理时间

})

# 2. 初始化并训练检测器

detector = FeaturePipelineTamperDetector(contamination=0.05)

detector.fit(normal_data)

# 3. 生成测试数据(包含正常和异常数据)

# 正常数据

normal_test = pd.DataFrame({

'feature_1': np.random.normal(0, 1, 100),

'feature_2': np.random.normal(0, 1, 100),

'processing_time': np.random.normal(100, 10, 100)

})

# 异常数据(处理时间异常)

anomaly_test = pd.DataFrame({

'feature_1': np.random.normal(0, 1, 20),

'feature_2': np.random.normal(0, 1, 20),

'processing_time': np.random.normal(500, 50, 20) # 处理时间异常长

})

# 合并测试数据

test_data = pd.concat([normal_test, anomaly_test], ignore_index=True)

# 4. 进行检测

predictions = detector.detect(test_data)

scores = detector.get_anomaly_score(test_data)

# 5. 输出检测结果

results = pd.DataFrame({

'prediction': predictions,

'anomaly_score': scores

})

print("检测结果统计:")

print(results['prediction'].value_counts())

print("\n异常分数统计:")

print(results['anomaly_score'].describe())3.7 代码示例3:特征服务API

"""

安全特征服务API,包含身份认证和访问控制

"""

from fastapi import FastAPI, Depends, HTTPException, status

from fastapi.security import HTTPBearer, HTTPAuthorizationCredentials

from pydantic import BaseModel

import uvicorn

import hashlib

import hmac

import logging

# 配置日志

logging.basicConfig(level=logging.INFO)

logger = logging.getLogger(__name__)

# 安全配置

SECRET_KEY = "your-secret-key" # 实际使用中应从环境变量或密钥管理系统获取

API_KEYS = {

"model-1": "api-key-1",

"model-2": "api-key-2"

} # 实际使用中应存储在安全的地方,如数据库或密钥管理系统

# 创建FastAPI应用

app = FastAPI(

title="安全特征服务API",

description="提供安全的特征查询服务,包含身份认证和访问控制",

version="1.0.0"

)

# 定义安全方案

security = HTTPBearer()

# 定义请求模型

class FeatureRequest(BaseModel):

entity_id: str

feature_names: list[str]

# 定义响应模型

class FeatureResponse(BaseModel):

entity_id: str

features: dict

timestamp: float

signature: str

# 验证API密钥

async def verify_api_key(credentials: HTTPAuthorizationCredentials = Depends(security)):

"""验证API密钥"""

api_key = credentials.credentials

if api_key not in API_KEYS.values():

logger.warning(f"无效的API密钥:{api_key}")

raise HTTPException(

status_code=status.HTTP_401_UNAUTHORIZED,

detail="无效的API密钥",

headers={"WWW-Authenticate": "Bearer"},

)

# 查找对应的模型ID

for model_id, key in API_KEYS.items():

if key == api_key:

return model_id

return None

# 生成特征签名

def generate_feature_signature(entity_id: str, features: dict, timestamp: float) -> str:

"""生成特征签名"""

data = f"{entity_id}{features}{timestamp}"

return hmac.new(

SECRET_KEY.encode('utf-8'),

data.encode('utf-8'),

hashlib.sha256

).hexdigest()

# 模拟特征存储

feature_store = {

"user-1": {

"feature1": 1.0,

"feature2": 2.0,

"feature3": 3.0

},

"user-2": {

"feature1": 4.0,

"feature2": 5.0,

"feature3": 6.0

}

}

# 定义API端点

@app.post("/features", response_model=FeatureResponse)

async def get_features(

request: FeatureRequest,

model_id: str = Depends(verify_api_key)

):

"""获取特征,包含身份认证和签名验证"""

logger.info(f"收到特征请求,实体ID:{request.entity_id},模型ID:{model_id}")

# 检查实体是否存在

if request.entity_id not in feature_store:

logger.warning(f"实体不存在:{request.entity_id}")

raise HTTPException(

status_code=status.HTTP_404_NOT_FOUND,

detail=f"实体不存在:{request.entity_id}"

)

# 获取请求的特征

entity_features = feature_store[request.entity_id]

requested_features = {}

for feature_name in request.feature_names:

if feature_name in entity_features:

requested_features[feature_name] = entity_features[feature_name]

else:

logger.warning(f"特征不存在:{feature_name}")

raise HTTPException(

status_code=status.HTTP_404_NOT_FOUND,

detail=f"特征不存在:{feature_name}"

)

# 生成时间戳

import time

timestamp = time.time()

# 生成签名

signature = generate_feature_signature(

request.entity_id,

requested_features,

timestamp

)

# 记录日志

logger.info(f"特征请求处理完成,实体ID:{request.entity_id},特征数量:{len(requested_features)}")

# 返回响应

return FeatureResponse(

entity_id=request.entity_id,

features=requested_features,

timestamp=timestamp,

signature=signature

)

# 健康检查端点

@app.get("/health")

async def health_check():

"""健康检查"""

return {"status": "ok", "message": "特征服务运行正常"}

if __name__ == "__main__":

# 启动服务

uvicorn.run(

"feature_service:app",

host="0.0.0.0",

port=8000,

ssl_keyfile="/path/to/ssl/key.pem", # 实际使用中应配置SSL

ssl_certfile="/path/to/ssl/cert.pem",

reload=True

)4. 与主流方案深度对比

4.1 特征流水线方案对比

方案 | 主要特点 | 安全特性 | 性能 | 易用性 | 可扩展性 | 适用场景 |

|---|---|---|---|---|---|---|

传统脚本 | 简单直接 | 几乎无安全措施 | 中等 | 低 | 低 | 小规模项目 |

Airflow | 工作流管理、可调度 | 支持RBAC、SSL、日志审计 | 高 | 中 | 高 | 大规模生产环境 |

Kubeflow Pipelines | Kubernetes原生、可移植 | 支持RBAC、加密、隔离 | 高 | 低 | 高 | 云原生环境 |

Luigi | 轻量级、易于集成 | 基本的日志和监控 | 中等 | 中 | 中 | 中等规模项目 |

Prefect | 现代工作流引擎、易于使用 | 支持RBAC、日志审计、监控 | 高 | 高 | 高 | 现代数据栈 |

4.2 防篡改机制对比

防篡改机制 | 实现方式 | 安全性 | 性能影响 | 易用性 | 适用场景 |

|---|---|---|---|---|---|

哈希校验 | 计算数据的哈希值并存储 | 中等 | 低 | 高 | 所有场景 |

HMAC签名 | 使用密钥生成数据签名 | 高 | 低 | 中 | 敏感数据场景 |

区块链存储 | 将哈希值存储在区块链上 | 极高 | 高 | 低 | 高安全性要求场景 |

零知识证明 | 验证计算正确性而不泄露数据 | 极高 | 极高 | 低 | 隐私敏感场景 |

同态加密 | 在加密数据上进行计算 | 极高 | 极高 | 低 | 高度隐私场景 |

5. 实际工程意义、潜在风险与局限性分析

5.1 实际工程意义

- 提高模型安全性:通过防篡改机制,防止攻击者篡改特征流水线,提高模型的安全性和可靠性

- 降低运维成本:使用Airflow等工具管理特征流水线,实现自动化调度和监控,降低运维成本

- 提高开发效率:提供统一的特征管理平台,便于特征复用和共享,提高开发效率

- 增强可审计性:完整的审计日志便于事后分析和溯源,满足合规要求

- 支持实时决策:实时特征流水线能及时提供最新的特征,支持实时威胁检测和响应

5.2 潜在风险与局限性

- 性能开销:安全措施(如加密、签名、验证)会带来一定的性能开销,可能影响实时性

- 复杂度增加:安全特征流水线的设计和实现复杂度较高,需要专业的安全知识

- 密钥管理:HMAC签名、加密等机制需要安全的密钥管理,密钥泄露会导致严重的安全问题

- 兼容性问题:不同的工具和框架之间可能存在兼容性问题,增加集成难度

- 误判风险:篡改检测机制可能会产生误判,需要不断优化和调整

- 单点故障:特征存储和服务可能成为单点故障,需要设计高可用架构

5.3 风险缓解策略

- 性能优化:

- 使用高效的哈希算法(如SHA-256)

- 对关键数据进行签名和验证,而非所有数据

- 采用异步处理方式,减少对主流程的影响

- 复杂度管理:

- 采用分层设计,降低各层的复杂度

- 使用成熟的框架和工具,减少自定义开发

- 提供清晰的文档和示例,便于使用和维护

- 密钥管理:

- 使用专业的密钥管理服务(如AWS KMS、HashiCorp Vault)

- 定期轮换密钥,减少密钥泄露的影响

- 实现密钥的访问控制和审计

- 兼容性处理:

- 选择兼容性好的工具和框架

- 设计灵活的接口,便于扩展和替换组件

- 进行充分的测试,确保各组件之间的兼容性

- 误判优化:

- 使用机器学习算法不断优化篡改检测模型

- 结合多种检测机制,提高检测准确率

- 实现人工审核机制,处理可疑的检测结果

- 高可用设计:

- 实现特征存储和服务的冗余备份

- 使用负载均衡技术,分散流量

- 设计故障恢复机制,确保系统的可用性

6. 未来趋势展望与个人前瞻性预测

6.1 未来趋势

- 自动化与智能化:

- 自动生成和优化特征流水线

- 使用AI技术检测和响应流水线中的异常行为

- 实现自适应的安全策略,根据威胁情况动态调整

- 云原生与分布式:

- 基于Kubernetes构建云原生特征流水线

- 实现分布式特征计算和存储,提高可扩展性

- 支持边缘计算场景,实现近实时的特征处理

- 隐私增强技术:

- 广泛应用差分隐私、同态加密等隐私增强技术

- 实现隐私保护下的特征共享和协作

- 支持联邦学习场景,在不共享原始数据的情况下训练模型

- 安全与合规融合:

- 内置合规检查机制,满足GDPR、CCPA等合规要求

- 实现自动化的合规报告生成

- 支持审计日志的加密存储和分析

- 多模态特征融合:

- 支持多种数据源的特征融合,如文本、图像、音频等

- 实现跨模态的特征关联和分析

- 提高模型对复杂威胁的检测能力

6.2 个人前瞻性预测

- 特征流水线即服务(FPaaS):未来将出现专门的特征流水线服务,提供完整的特征工程解决方案,降低企业构建特征流水线的成本和复杂度

- 零信任特征流水线:零信任架构将被广泛应用于特征流水线,实现最小权限访问、持续验证和动态授权,提高系统的安全性

- AI驱动的威胁检测流水线:AI将贯穿整个特征流水线,从数据采集到特征服务,实现智能化的威胁检测和响应

- 量子安全的特征流水线:随着量子计算的发展,量子安全的加密算法将被应用于特征流水线,防止量子计算攻击

- 标准化的特征流水线接口:行业将出现标准化的特征流水线接口,便于不同工具和框架之间的集成和互操作

- 自修复的特征流水线:特征流水线将具备自我修复能力,能够自动检测和修复故障,提高系统的可用性和可靠性

7. 总结与关键Takeaway

特征流水线是机器学习系统的核心组件,在安全攻防场景下,其设计直接关系到模型的安全性和可靠性。本文深入分析了特征流水线的工程设计原则,重点探讨了安全视角下的防篡改实践,结合GitHub上最新的Airflow集成方案和安全实践,提供了完整的实现指南。

关键Takeaway:

- 安全设计优先:在设计特征流水线时,应将安全放在首位,考虑数据完整性、防篡改、访问控制等安全因素

- 分层架构设计:采用分层设计,将特征流水线分为数据采集、清洗、转换、存储、服务等层,各层独立防护

- 自动化管理:使用Airflow等工具管理特征流水线,实现自动化调度、监控和审计

- 多重防篡改机制:结合哈希校验、HMAC签名、区块链存储等多种防篡改机制,提高系统的安全性

- 持续监控和优化:实现特征流水线的实时监控和告警,不断优化和调整安全策略

- 平衡安全性和性能:在保证安全性的同时,考虑性能影响,采用高效的安全机制和优化策略

未来,特征流水线将向自动化、智能化、云原生、隐私增强等方向发展,为机器学习系统提供更安全、更可靠的特征支持。安全工程师应不断学习和掌握最新的技术和实践,构建适应未来威胁的安全特征流水线。

参考链接:

- Apache Airflow官方文档 - 提供Airflow的详细使用指南和最佳实践

- Feast特征存储 - 开源的特征存储系统,用于管理和服务机器学习特征

- Kubeflow Pipelines - 基于Kubernetes的机器学习工作流引擎

- Prefect - 现代的工作流引擎,易于使用和扩展

- arXiv:2106.03253 - 《Secure Feature Engineering Pipelines for Machine Learning》

- GitHub: airflow-security - Airflow安全配置和最佳实践

附录(Appendix):

A.1 环境配置

# 安装必要的库

pip install apache-airflow pandas scikit-learn fastapi uvicorn passlib[bcrypt] python-multipart

# 初始化Airflow数据库

airflow db init

# 启动Airflow服务

airflow webserver -p 8080 -D

airflow scheduler -D

# 启动特征服务API

python feature_service.pyA.2 常见问题与解决方案

问题 | 解决方案 |

|---|---|

Airflow Web UI无法访问 | 检查端口是否被占用,检查Airflow配置是否正确,检查防火墙设置 |

特征流水线执行失败 | 检查任务日志,检查数据完整性,检查依赖是否正确 |

篡改检测误判率高 | 增加正常训练数据,调整模型参数,结合多种检测机制 |

特征服务性能差 | 优化数据库查询,使用缓存,实现负载均衡 |

密钥管理困难 | 使用专业的密钥管理服务,定期轮换密钥,实现密钥的访问控制 |

A.3 安全检查清单

- 特征流水线是否采用分层设计?

- 数据和特征是否进行了完整性验证?

- 是否使用了安全的传输协议(如HTTPS)?

- 是否实现了访问控制和身份认证?

- 是否记录了完整的审计日志?

- 是否实现了实时监控和告警?

- 是否定期进行安全审计和漏洞扫描?

- 是否使用了最新的安全补丁和版本?

- 是否进行了安全培训和意识教育?

关键词: 特征流水线, 安全设计, 防篡改, Airflow, 机器学习工程, 特征服务, 数据完整性

本文参与 腾讯云自媒体同步曝光计划,分享自作者个人站点/博客。

原始发表:2026-01-15,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录