探秘NVIDIA RTX AI:llama.cpp如何让你的Windows PC变身AI超人

原创探秘NVIDIA RTX AI:llama.cpp如何让你的Windows PC变身AI超人

原创

GPUS Lady

发布于 2024-10-04 11:08:16

发布于 2024-10-04 11:08:16

想象一下,你的Windows PC突然拥有了超能力,能够迅速处理复杂的AI任务,就像电影里的超级电脑一样。这一切,都要归功于NVIDIA RTX AI平台和它的秘密武器——llama.cpp!

llama.cpp:AI界的轻量级冠军

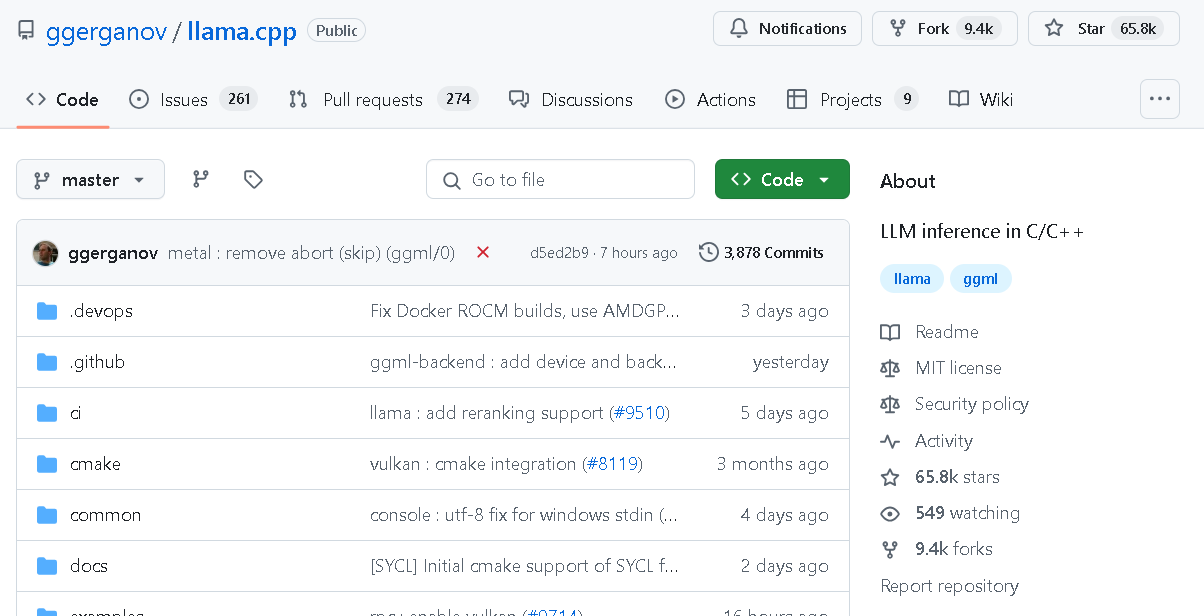

llama.cpp,这个名字听起来可能有点奇怪,但它在AI界可是个响当当的角色。自2023年问世以来,它就在GitHub上收获了超过6.5万颗星星,成为了开发者们的宠儿。这个轻量级、高效的框架,专门为大型语言模型(LLM)的推理设计,能够在各种硬件平台上大展身手,当然也包括我们的RTX PC啦!

内存和计算资源?llama.cpp说“没问题!”

在生产应用中部署LLM,最大的挑战就是它们太“吃资源”了,需要大量的内存和计算资源。但是,llama.cpp可不怕这个。它利用了一系列神奇的功能,优化模型性能,让LLM在各种硬件上都能高效运行。这背后的功臣,就是ggml张量库。这个轻量级的软件栈,让llama.cpp能够在没有外部依赖的情况下,实现跨平台使用。而且,它还特别节省内存,简直就是本地设备上推理的绝佳选择!

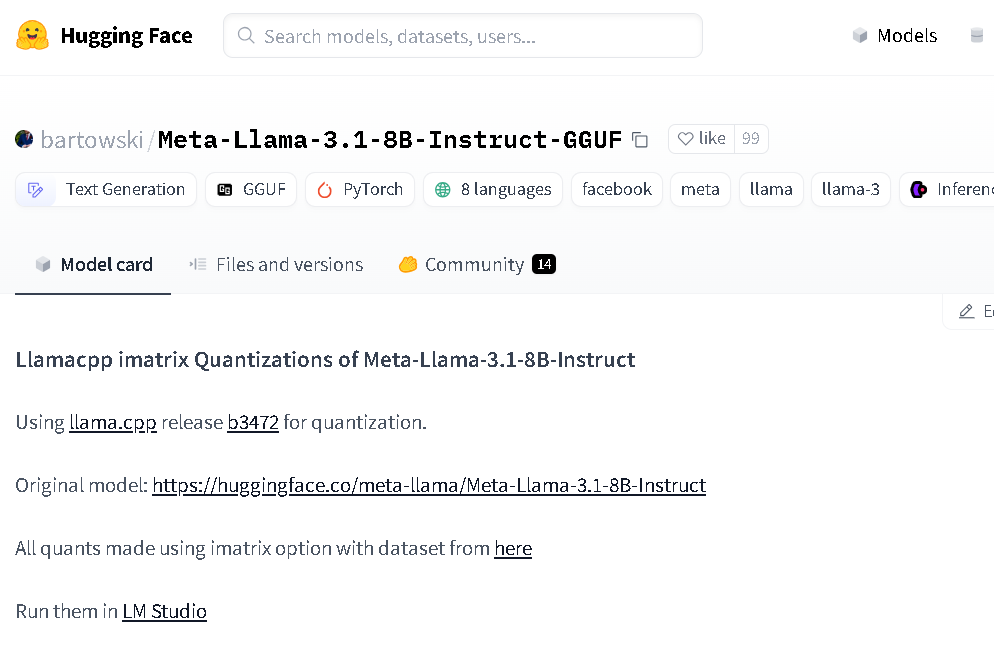

模型数据被打包并部署在一种称为GGUF的自定义文件格式中,这是由llama.cpp的贡献者专门设计和实现的。开发者可以从数千个预打包的模型中选择,这些模型涵盖了广泛的高质量量化。一个不断增长的开源社区正在积极开发llama.cpp和ggml项目,确保该平台保持最新并得到支持。开发者们最头疼的问题之一,就是找不到合适的模型。但是,在llama.cpp的生态系统中,你完全不用担心这个问题。这里有数千个预打包的模型等你来挑,涵盖了广泛的高质量量化。而且,还有一个不断壮大的开源社区,在积极开发llama.cpp和ggml项目,确保这个平台始终保持最新并得到支持。

NVIDIA RTX上的llama.cpp:速度与激情的碰撞

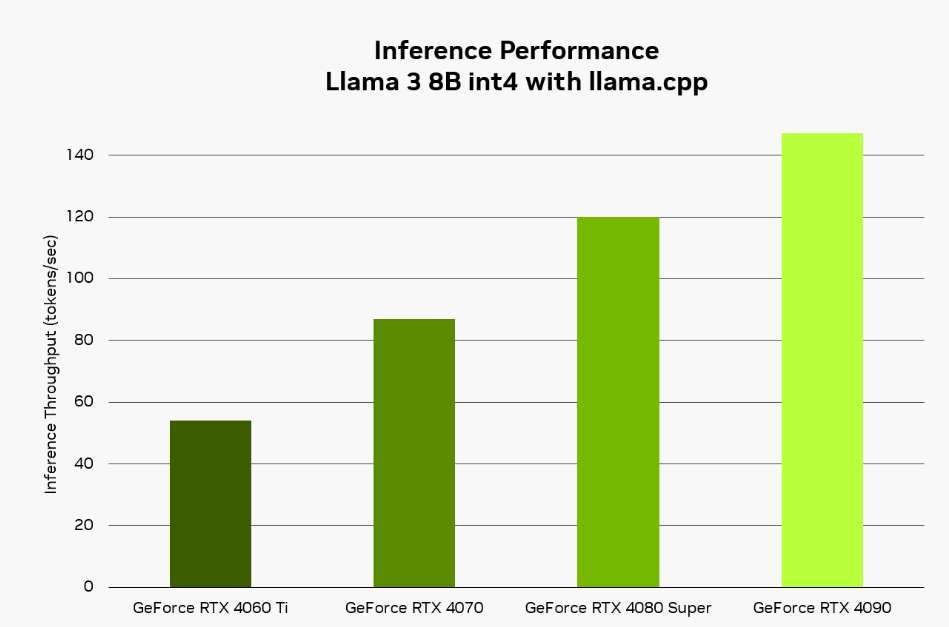

NVIDIA已与llama.cpp社区合作,改进和优化其在RTX GPU上的性能。一些关键贡献包括在llama.cpp中实现CUDA Graph,以减少内核执行时间之间的开销和间隙,从而生成标记,以及减少准备ggml图时的CPU开销。这些优化使得NVIDIA GeForce RTX GPU上的吞吐量性能得到提高。例如,在llama.cpp上使用Llama 3 8B模型时,用户可以在NVIDIA RTX 4090 GPU上期望达到每秒约150个标记的速度,输入序列长度为100个标记,输出序列长度为100个标记。要使用CUDA后端构建带有NVIDIA GPU优化的llama.cpp库,请访问GitHub上的llama.cpp/docs。

基于llama.cpp的开发者生态系统

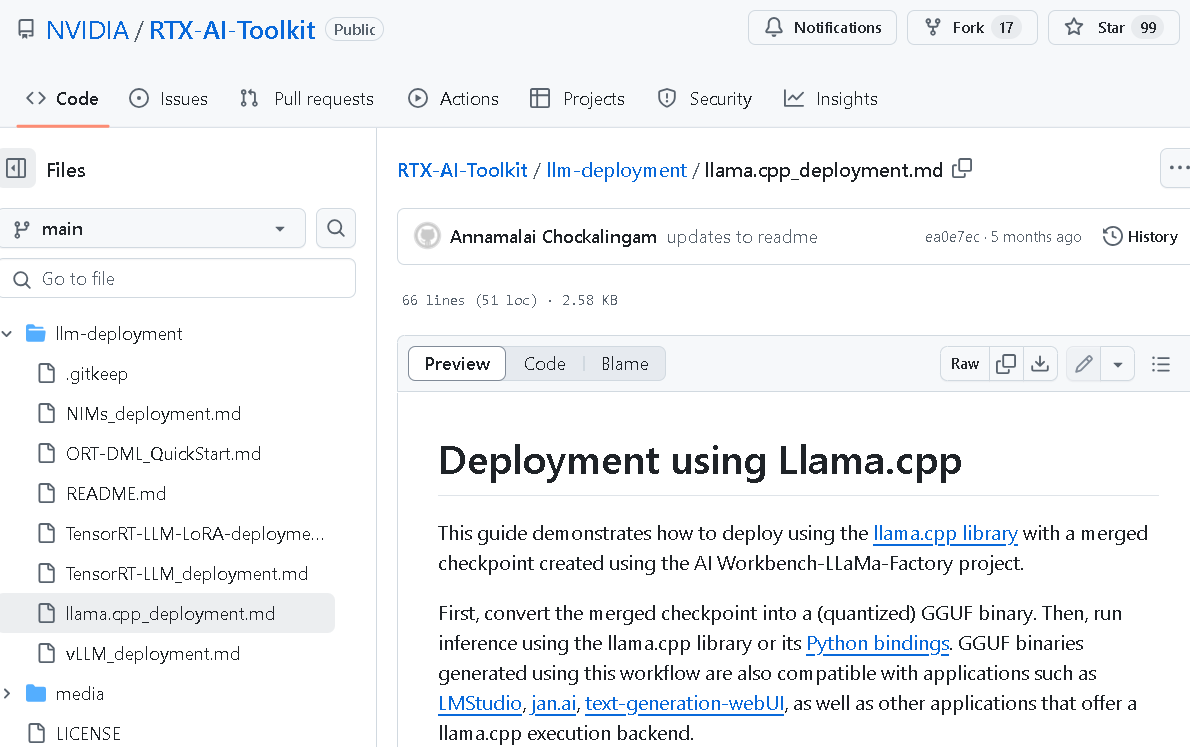

基于llama.cpp构建了一个庞大的开发者框架和抽象层生态系统,使开发者能够进一步加速他们的应用程序开发过程。流行的开发者工具,如Ollama、Homebrew和LMStudio,都在底层扩展和利用了llama.cpp的能力,以提供抽象的开发者体验。这些工具提供了配置和依赖管理、模型权重打包、抽象UI以及本地运行的LLM API端点等功能。 此外,还有一个广泛的模型生态系统,这些模型已经过预优化,可供开发者在RTX系统上使用llama.cpp进行利用。值得注意的模型包括Hugging Face上提供的Llama 3.2的最新GGUF量化版本。llama.cpp也作为推理部署机制,作为NVIDIA RTX AI Toolkit的一部分提供。

在RTX平台上使用llama.cpp加速的应用程序

目前已有超过50个工具和应用程序通过llama.cpp进行了加速,包括Backyard.ai、Brave、Opera和Sourcegraph等平台。这些应用程序利用llama.cpp在RTX系统上加速LLM模型,为用户提供增强的AI功能。例如,Brave已将其智能AI助手Leo直接集成到浏览器中,允许用户提问、总结页面和PDF、编写代码以及创建新文本。Opera已集成本地AI模型,以增强用户的浏览需求,提供摘要、翻译以及文本和图像生成等功能。

在RTX AI PC上开始使用llama.cpp

相关资源:

https://github.com/NVIDIA/RTX-AI-Toolkit/blob/main/llm-deployment/llama.cpp_deployment.md

https://huggingface.co/bartowski/Meta-Llama-3.1-8B-Instruct-GGUF

https://github.com/ggerganov/llama.cpp

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读