全面对比WinCLIP与AnomalyCLIP零样本异常检测VLM模型

全面对比WinCLIP与AnomalyCLIP零样本异常检测VLM模型

OpenCV学堂

发布于 2026-04-02 18:54:24

发布于 2026-04-02 18:54:24

本文重点比较了两种具有代表性的基于VLM的方法,它们体现了不同的设计理念。

WinCLIP采用相对直接的方法,通过精心设计的提示集成与基于窗口的密集视觉特征采样相结合。

AnomalyCLIP则运用了更复杂的流程,包括与对象无关的提示学习、文本标记的多层细化,以及名为对角显著注意力图(DPAM)的专门注意力机制,该机制能增强空间定位能力。

这两种方法在多样化的异常类型和产品类别中都展现出强大的泛化能力,但在模型复杂度、计算成本和检测精度方面做出了不同的权衡。理解这些权衡对于从业者在实际检测系统中决定采用哪种方法至关重要

效果对比

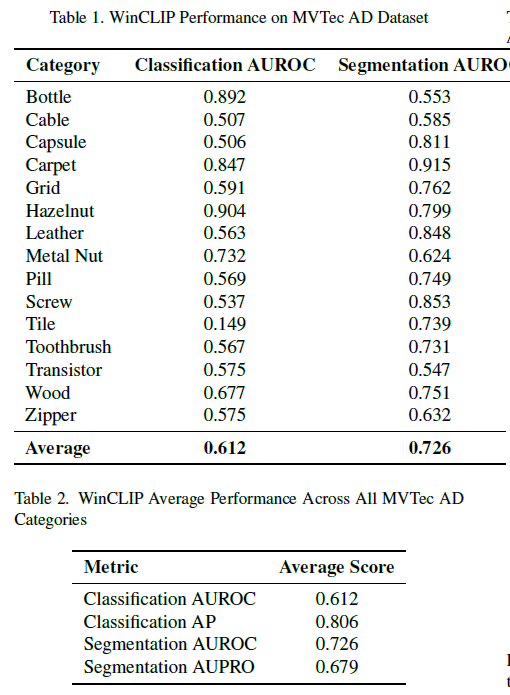

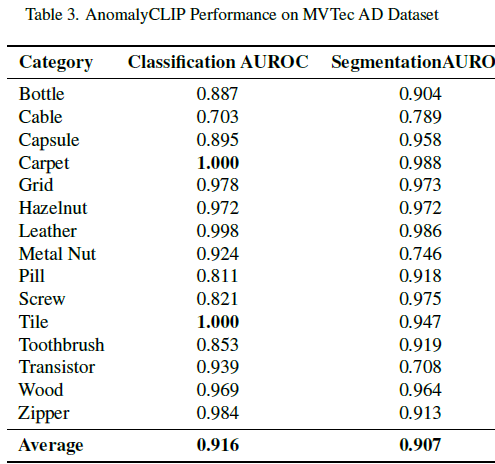

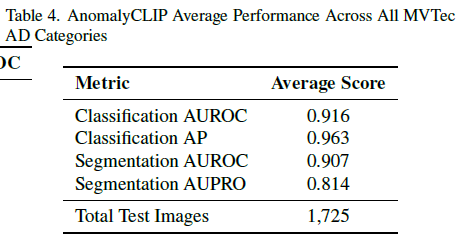

使用四个标准指标对这两种方法进行评估:

• 分类AUROC:图像级异常分类的ROC曲线下面积

• 分类AP:图像级分类的平均精度

• 分割AUROC:像素级异常定位性能

• 分割AUPRO:每区域重叠曲线下面积

总结

研究对比了WinCLIP与AnomalyCLIP两种方法,旨在帮助从业者为工业异常检测选择合适的技术方案。基于MVTec AD数据集的评估结果显示,AnomalyCLIP显著优于WinCLIP:其分类AUROC达到91.6%(对比WinCLIP的61.2%),分割AUROC达到90.7%(对比WinCLIP的72.6%)。AnomalyCLIP的可学习提示机制与对角显著注意力图(DPAM)模块,使其无需人工设计即可实现跨物体类型的卓越泛化能力。而WinCLIP的优势则体现在真正的零样本部署场景,以及面向细粒度定位的显式空间推理能力。

技术选型需考量部署条件:AnomalyCLIP适用于精度优先的场景,WinCLIP则更适合资源受限的快速原型开发。两种方法在柔性物体与复杂装配体的检测中仍存在局限性,这为未来研究指明了方向。总体而言,视觉语言模型已从根本上革新工业检测范式,通过自然语言即可实现缺陷识别,大幅降低了模型再训练成本。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-20,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读