AI大模型不会学习?腾讯姚顺宇团队来解答

AI大模型不会学习?腾讯姚顺宇团队来解答

臻成AI大模型

发布于 2026-02-28 15:55:04

发布于 2026-02-28 15:55:04

你有没有遇到过这种情况:跟AI聊了半小时,把背景信息、前置条件、参考文档全喂给它了,结果它给你的回复像是第一次聊天? 我有一个做产品经理的朋友,前几天跟我吐槽说,他花了三天写的需求文档全扔给了AI辅助开发,结果AI生成的功能方案跟文档里写的完全是两码事。 他当时就懵了:这些字它是一个都没看见吗? 后来我发现,遇到这种事的还不止他一个。

一个让业内哗然的结论

这段时间,AI圈被一个报告炸得够呛。

腾讯新上任的混元首席AI科学家姚顺宇,带着他的团队发了一份研究,核心观点就一句话:ChatGPT、Claude这些大模型,根本不会从上下文里学习。

你以为它在理解你?

其实它只是在翻旧账。

这个姚顺宇是什么人?

名字可能没多少人听过,但他搞出来的东西你肯定用过。

Agent设计必用的ReAct框架,提示词工程里大名鼎鼎的思维树技巧,都是他在普林斯顿读博士时搞出来的。

后来在OpenAI参与了Operator和Deep Research的开发,最近被腾讯重金挖来,直接出任混元首席AI科学家。

他上任后抛出的第一个炸弹,就是这份让很多人坐不住的研究报告。

实验结果让所有人意外

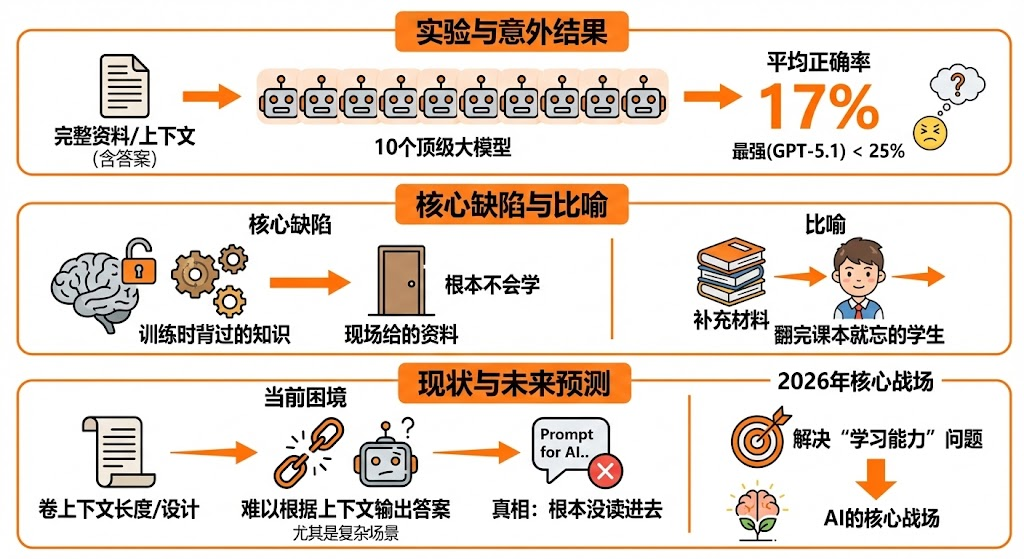

姚顺宇团队做了个看起来很简单的实验:给AI提供完整的资料,答案就明明白白写在上下文里,让它去解决问题。

结果呢?

测了10个顶级大模型,平均正确率只有17%。最强的是GPT-5.1,也只做对了不到四分之一。

这意味着什么?

你把攻略塞到AI嘴里,它还是能给你做错八成。

问题出在哪里?

报告指出,大模型有一个致命缺陷——它只会调用训练时背过的、见过的那些知识,对于你现场给的资料,它根本不会学。

人类遇到新问题会现学现用,但AI不会。它就像一个翻完课本就忘的学生,你给他再多的补充材料,他左耳进右耳出。

这个结论为什么重要?

因为现在国内外的AI产品都在卷上下文长度、上下文设计。但按照这份报告的说法,哪怕你把上下文塞得满满当当,AI也很难根据上下文里的信息输出答案。尤其是需要注意到上下文细节、跨区域检索这些复杂场景时,表现更是拉胯。

所以有时候你觉得AI不听话,不一定是你的prompt写得烂,真相可能是它根本没读进去你给的东西。

这是当前所有大模型最核心的瓶颈之一。

姚顺宇团队预测,解决这个学习能力的问题,将是2026年AI的核心战场。

结语

不过,我这两年的实际体感是,测评榜单和真实使用体验之间往往有差距。

就拿Gemini 3 Pro来说,编程能力测评一度排第一,但实际用起来完全是另一回事。姚顺宇团队的实验结果,跟你的真实体验一致吗?

至少在我这里,文案生成这个领域还是有点偏差的。

我们给客户设计的智能体,多数情况下还是能比较自然地把上下文信息融合进去的。

当然,这可能也跟我们使用场景有关,不一定具有普遍代表性。

你怎么看?有没有遇到过AI翻旧账而不是学新东西的情况?

欢迎在评论区聊聊你的真实经历。

本文参与 腾讯云自媒体同步曝光计划,分享自微信公众号。

原始发表:2026-02-11,如有侵权请联系 cloudcommunity@tencent.com 删除

评论

登录后参与评论

推荐阅读

目录