Gemini 3 Pro登顶AMO-Bench:大模型数学推理正迈向高效率新阶段

原创Gemini 3 Pro登顶AMO-Bench:大模型数学推理正迈向高效率新阶段

原创

AGI-Eval评测社区

发布于 2025-12-02 11:52:53

发布于 2025-12-02 11:52:53

- 随着大模型在推理能力上的快速迭代,现有的数学评测基准面临着区分度下降的挑战。在 AIME24/25 等基准上,前沿模型的准确率已趋于饱和。

在此背景下,美团 LongCat 团队发布了 AMO-Bench,这是一套包含 50 道原创高难度数学问题的评测集。该基准旨在通过更高的难度和严格的数据隔离,重新评估当前模型的推理能力上限。

目前该研究已经发表成论文:《AMO-Bench: Large Language Models Still Struggle in High School Math Competitions》。

图片

- 论文地址:

https://arxiv.org/pdf/2510.26768

AMO-Bench 的评测榜单未来将由 AGI-Eval 评测社区长期维护更新,欢迎持续关注。榜单和论文地址如下:

图片

- 微信小程序:AGI-Eval模型评测

AMO-Bench 的评测榜单将保持更新,欢迎持续关注:

- 项目主页: http://amo-bench.github.io/

- Github地址: https://github.com/meituan-longcat/AMO-Bench

- Hugging Face地址: https://huggingface.co/datasets/meituan-longcat/AMO-Bench

本文将结合美团 LongCat 团队的论文与最新数据,从评测结果、基准构建、模型表现及推理效率三个维度进行解读。

01. 评测结果分析

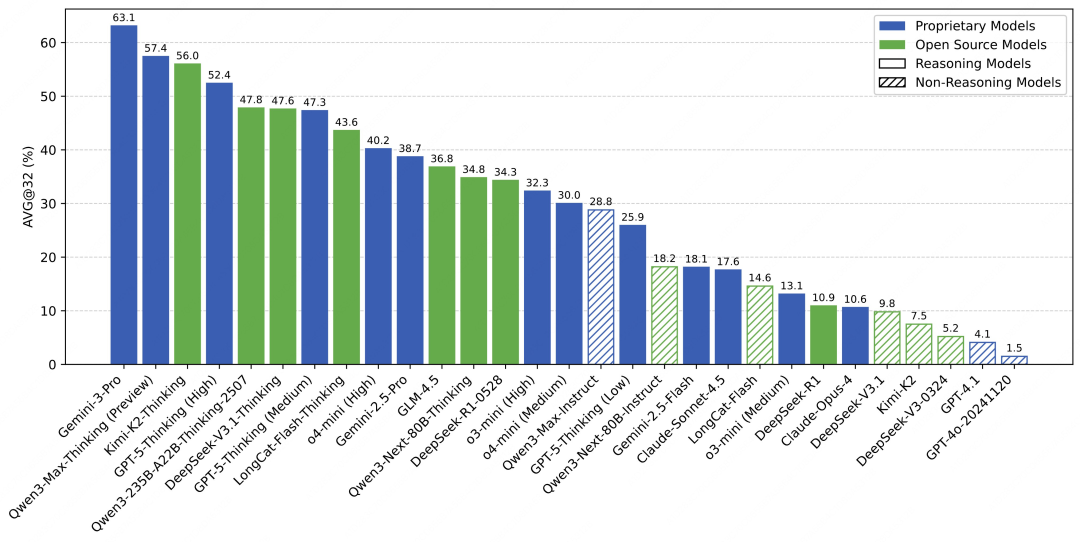

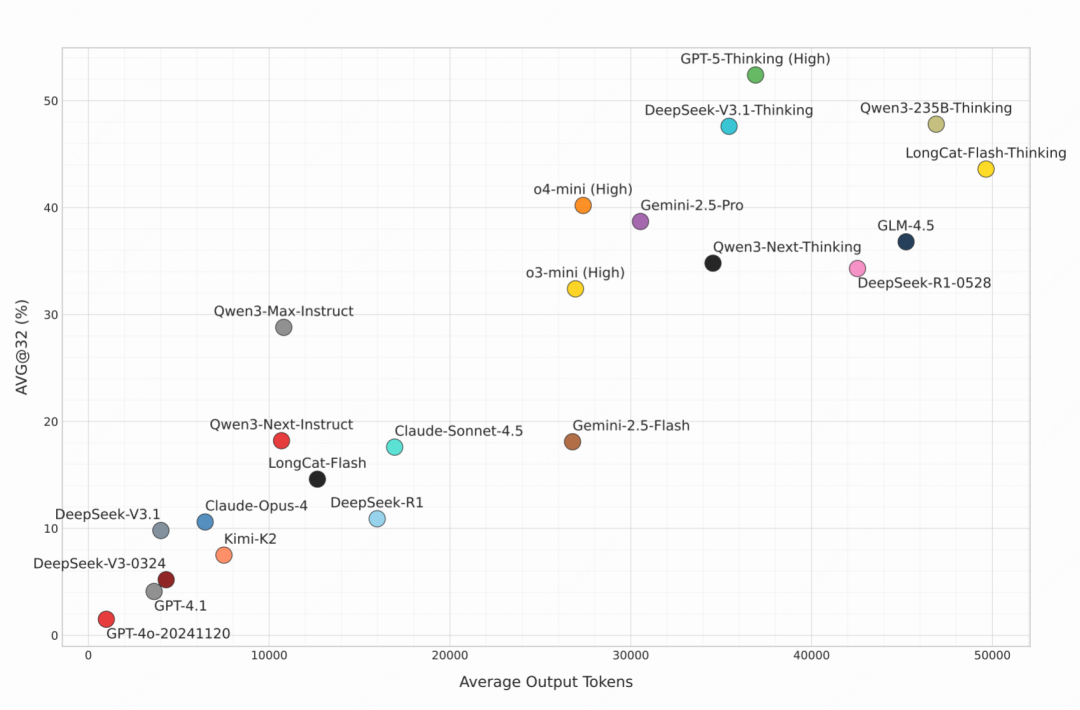

基于 AMO-Bench 的评测结果揭示了当前大模型在复杂数学推理任务上的表现差异。结合最新数据,Gemini 3 Pro 和 Qwen3-Max-Thinking 位于头部梯队。

图1:展示了各模型的 AVG@32 表现

- 最新榜单结果来自项目主页: https://amo-bench.github.io/

- SOTA 模型的突破: Gemini 3 Pro 取得了 63.1% (AVG@32) 的成绩,刷新了该基准的纪录。相比于此前 GPT-5-Thinking (High) 的 52.4%,这一大幅提升表明模型在处理高难度奥赛题目时,其逻辑稳定性有了显著增强。

- 国产模型的崛起: 阿里 Qwen 团队的 Qwen3-Max-Thinking 取得了 57.4% (AVG@32) 的成绩,位居第二。这一数据不仅超越了 GPT-5-Thinking (High),也展现了国产顶尖大模型在复杂逻辑推理能力上已具备与国际最强闭源模型同台竞技的实力。

02. 基准构建

2.1 AMO-Bench 的构建逻辑

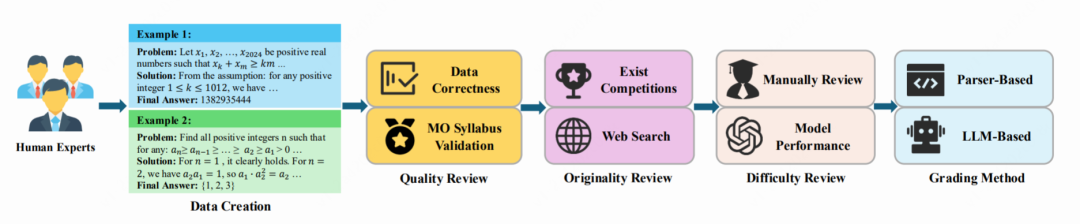

为了解决现有数据集面临的“性能饱和”和“数据污染”问题,AMO-Bench 在构建过程中确立了三个核心标准:

- 原创性: 50 道题目均由数学专家从零构建,并经过 n-gram 匹配和网络搜索查重,旨在规避模型训练数据的记忆效应。

- 难度分级: 题目难度对标 IMO(国际数学奥林匹克)标准。构建过程中引入了模型对抗筛选机制,剔除现有主流模型能够轻松解决的题目,确保评测的区分度。

- 自动化评分: 题目设计为仅需提交最终答案(如数值、集合等),避免了人工阅卷的主观偏差,提升了大规模评测的效率与客观性。

如下图所示,展示了 AMO-Bench 从专家命题、查重筛选到难度验证的完整构建流程。

图2展示了 AMO-Bench 的构建与评分流水线,包括数据创建、质量审查、原创性审查和难度审查四个阶段

2.2 数据特征:长链条推理挑战

AMO-Bench 的难度不仅体现在知识点的覆盖广度,更体现在解题路径的长度上。

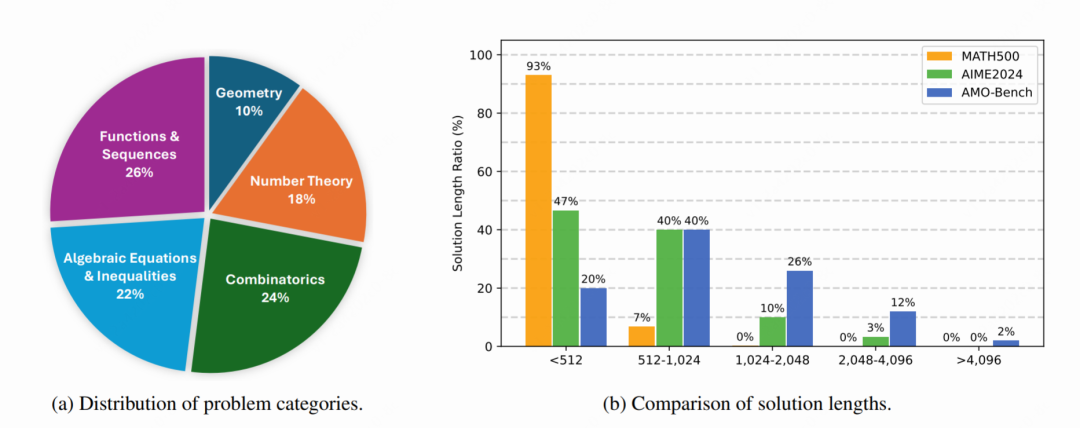

论文统计显示,AMO-Bench 标准解答的 Token 长度显著高于 MATH500 和 AIME24 等现有基准。这意味着模型需要具备更强的长文本逻辑推理能力,才能在多步推导中得出正确结论。这种设计使得 AMO-Bench 能够更有效地评估模型的深层推理能力。

图3(a)展示了题目类别的分布;图3(b)对比了 AMO-Bench 与 MATH500、AIME24 的解答长度分布)

03. 深度洞察

3.1 推理效率的新趋势

在模型性能提升的同时,推理效率成为了新的关注点。

在此前的研究中,普遍观察到“模型性能与输出长度正相关”的现象(如图4所示)。GPT-5 等模型往往通过增加推理计算量,生成更长的思维链来提升准确率。

图4:展示了模型性能与输出长度的相关性

然而,对比最新的 Gemini 3 Pro 数据发现,该模型在取得最高准确率的同时,其平均输出 Token 数量并未显著增加,甚至低于部分同梯队模型。这表明,顶尖模型的演进方向可能正在从单纯增加推理长度,转向提升思维链的质量与密度。

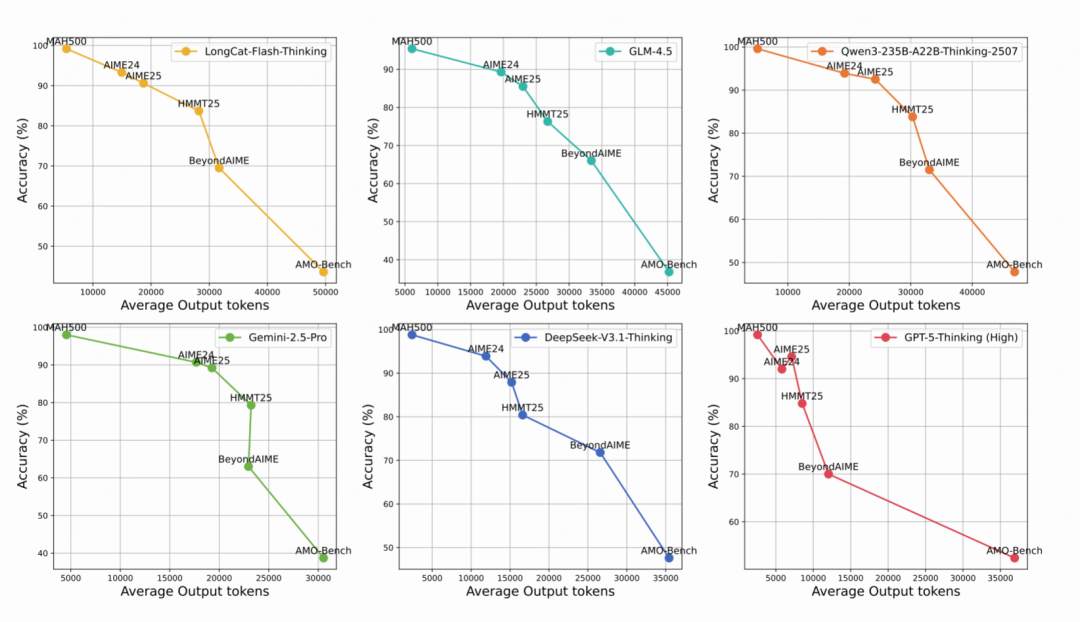

此外,论文分析了不同基准难度与输出长度的关系。数据显示,在难度更高的基准(如 AMO-Bench)上,模型确实需要更长的推理步骤。

图5:展示了不同难度基准下模型输出长度的变化,AMO-Bench 对应更长的输出

3.2 Test-time Scaling 的有效性验证

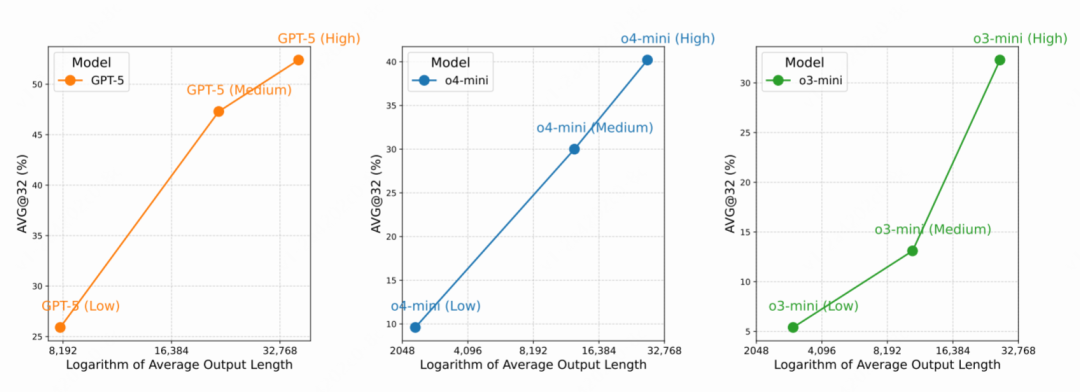

尽管高效推理是未来的趋势,但现阶段增加推理时间依然是提升模型性能的有效手段。

实验数据显示,GPT-5、o4-mini 等模型在对数坐标系下,其性能随输出长度呈现近似线性的增长趋势。这验证了 Test-time Scaling(测试时扩展)定律在复杂数学任务中的有效性,即通过分配更多的推理算力,可以挖掘模型潜在的解题能力。

图6:展示了不同推理预算下模型性能的增长趋势

3.3 Pass@32 与模型潜能

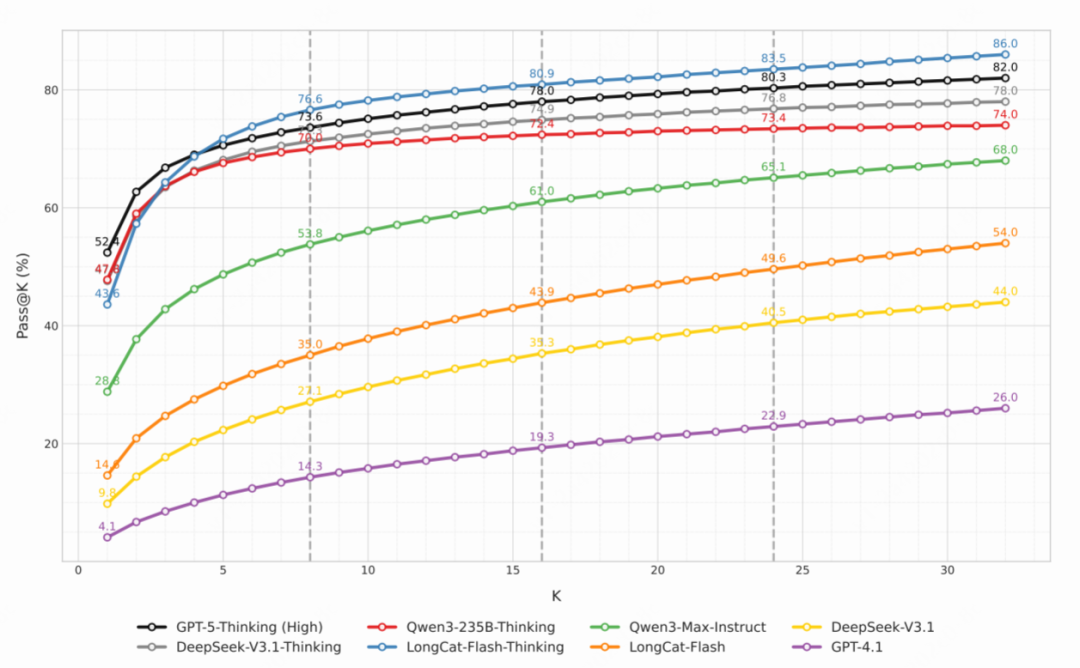

除了单次回答的准确率(Pass@1),论文还分析了多次采样下的 Pass@32 指标。

结果显示,当给予模型 32 次尝试机会时,顶尖模型的理论解决率可大幅提升,部分模型逼近 80%。这表明模型具备解决这些难题的潜在知识储备,但缺乏生成正确推理路径的稳定性。未来的优化方向可能包括强化学习或引入验证器机制。

图7:展示了随着采样次数 k 的增加,各模型 Pass@k 的提升趋势

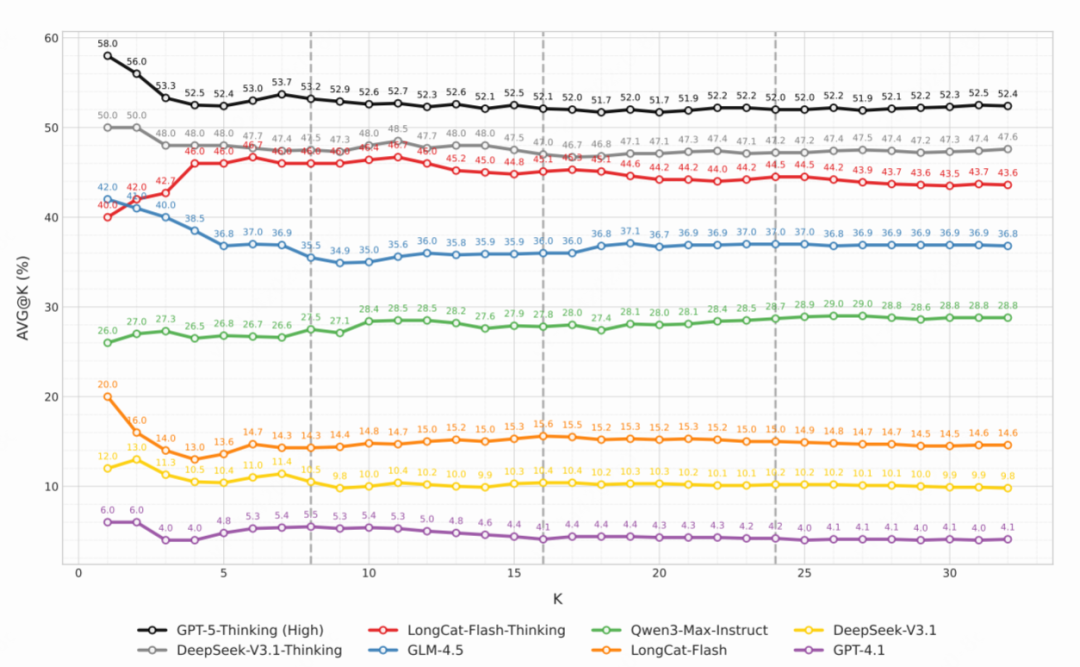

同时,AVG@k 的收敛趋势表明,AVG@32 是一个相对稳健的评价指标,能够客观反映模型的平均推理水平。

图8:展示了 AVG@k 的稳定性

04. 总结与展望

AMO-Bench 的发布及其评测结果,为行业提供了一个观察大模型数学推理能力边界的窗口。从评测数据来看,Gemini 3 Pro 的 63.1% 确立了新的性能基准,而 Kimi-K2-Thinking 则展现了国产模型的惊人追赶速度。 但值得注意的是,SOTA 模型仍有近 40% 的题目未能稳定解决,这表明复杂数学推理依然是当前 AI 技术亟待攻坚的深水区。

面向未来,AMO-Bench 的价值将不限于分数的比拼,更在于它通过严格的原创性与高难度设定,倒逼行业从单纯的“数据记忆”转向对“深度推理效率”与“逻辑验证”的探索。随着 Test-time Scaling 等技术的持续演进,AGI-Eval 评测社区期待这一基准能持续推动大模型从“做题”向真正的“思考”跨越,为通用人工智能时代的到来贡献力量。

以上就是本次解读的全部内容,更多前沿大模型评测与技术解读,请持续关注 AGI-Eval 评测社区。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录