Taming OpenClaw——论文简析

原创Taming OpenClaw——论文简析

原创

大模型实验室Lab4AI

发布于 2026-03-31 10:57:03

发布于 2026-03-31 10:57:03

Lab4AI大模型实验室是面向AI开发者、科研党与学习者打造的一站式AI实践平台,深度绑定高性能弹性算力,支持模型复现、训练、推理全流程,以按需计费、低价高效破解高端算力紧缺与成本高昂难题;同步Arxiv前沿论文并提供翻译、导读、分析服务,支持各类大模型一键复现与数据集微调,对接孵化资源助力科研成果转化;同时搭载多样化AI在线课程,实现理论学习与代码实操同步推进,全方位覆盖AI研发、科研创新与技能学习全场景需求。

原始链接:https://arxiv.org/pdf/2603.11619v1

作者信息

- Xinhao Deng(蚂蚁集团 & 清华大学)

- Yixiang Zhang(清华大学)

- Jiaqing Wu(清华大学)

- Qi Li(清华大学,通讯作者)

研究背景

大型语言模型(LLMs)在自然语言处理、代码生成和复杂推理任务方面取得了显著进展。基于这些能力,自主LLM代理(以OpenClaw为代表)作为一种新范式出现,将AI系统从被动的对话助手转变为能够独立执行复杂、长视距任务的主动实体。

OpenClaw通过丰富的即时消息(IM)接口连接人类意图与计算执行,允许代理动态编排专门的第三方插件,维护持久的上下文记忆,并执行高权限操作。然而,这些赋予自主代理的能力也引入了显著的安全风险。

与在受限、无状态设置中运行的传统LLM应用不同,自主代理依赖持久记忆、跨系统集成和特权访问来执行复杂工作流,其交互性质和高权限执行能力极大地扩展了系统攻击面。

近期研究虽揭示了LLM系统中的关键漏洞,但代理的自主性引入了独特的多阶段威胁,超出了孤立的提示注入或越狱攻击。现有防御措施(如基于护栏的输入过滤、结构化查询、防御性训练)主要针对代理管道中的孤立接口,属于零散的单点解决方案,无法有效缓解在扩展代理交互中展开的跨时间、多阶段系统性风险,留下关键安全缺口。

研究目的

本研究旨在对OpenClaw进行全面的安全威胁分析与缓解,具体目标包括:

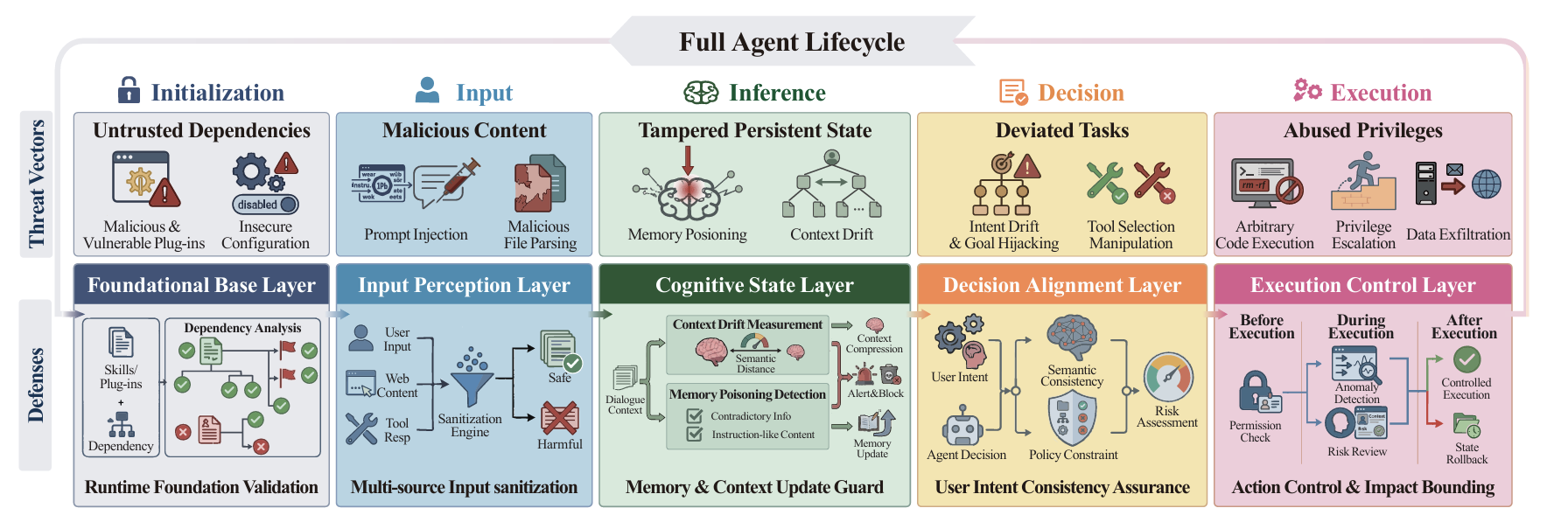

- 构建一个五层生命周期导向的安全框架,涵盖代理的初始化、输入、推理、决策和执行五个关键阶段;

- 利用该框架系统地检查代理操作生命周期中的所有复合威胁,包括间接提示注入、技能供应链污染、记忆中毒和意图漂移等;

- 通过OpenClaw上的详细案例研究,展示这些威胁的普遍性和严重性,并分析现有防御策略在缓解现实世界攻击场景方面的有效性;

- 探索更广泛的防御设计空间,检查与不同生命周期阶段相对应的代表性防御策略,为构建针对自主代理威胁的综合保护提供见解。

核心贡献

- 提出自主代理威胁景观的系统分类法:覆盖代理完整操作生命周期(初始化、输入、推理、决策、执行),识别长视距代理操作中特有的复合风险。

- 通过案例研究展示威胁严重性:在OpenClaw上演示技能中毒、间接提示注入、记忆中毒、意图漂移和高风险命令执行等攻击,揭示现有防御机制局限性。

- 提供全生命周期防御机制分析:系统评估现有防御在各阶段的不足,并提出适配各阶段的防御措施,包括插件审查框架、上下文感知指令过滤、记忆完整性验证协议、意图验证机制和能力执行架构。

- 提出纵深防御架构设计原则:探索防御设计空间,提出生命周期感知的纵深防御架构,强调跨阶段安全一致性,以应对跨时间、组合性和面向记忆的威胁。

研究方法

本文采用系统性的安全分析与案例研究方法:

- 构建五层生命周期导向安全框架,将代理操作划分为初始化、输入、推理、决策、执行五个阶段;

- 针对每个阶段进行威胁建模,识别供应链攻击、提示注入、上下文漂移、目标劫持、任意代码执行等特定威胁;

- 在OpenClaw上开展案例研究,验证技能中毒、间接提示注入、记忆中毒、意图漂移、高风险命令执行等威胁的实际影响;

- 系统评估现有防御机制(插件审查、输入过滤、沙箱隔离等)在各阶段的局限性,指出其无法处理时间和组合威胁;

- 提出与生命周期对齐的纵深防御架构,阐述各层具体防御技术:静态与动态分析、指令层次强制执行、语义防火墙、向量空间访问控制、形式化验证、内核级沙箱等。

研究结果

研究发现,当前基于单点的防御机制在处理跨时间和多阶段系统性风险时存在关键弱点:

- 初始化阶段:现有防御假设可信初始化状态,无法应对动态供应链妥协;

- 输入阶段:防御假设无状态交互,易受时间组合攻击影响;

- 推理阶段:缺乏对记忆状态的持续监控。

案例研究表明,攻击者可通过:

- 技能中毒静默替换合法功能

- 间接提示注入实现零点击攻击

- 记忆中毒将瞬时攻击转化为持久行为偏差

- 意图漂移导致系统破坏

- 高风险命令执行导致拒绝服务攻击

研究表明,需构建生命周期感知的纵深防御架构,整合动态内存保护、自适应护栏、自主提示注入防御和系统级监控。提出的五层防御架构(基础层、输入感知层、认知状态层、决策对齐层、执行控制层)可有效映射并缓解各阶段特定威胁。

总结与展望

从被动语言模型到主动自主代理的过渡是AI能力的重大进步,但也引入了复杂的多阶段安全漏洞。现有缓解策略分散,无法应对长视距代理操作中的复合、跨阶段攻击。

本文通过系统分析OpenClaw威胁景观,提出全生命周期安全分类法和纵深防御架构,为未来自主AI系统安全可靠部署提供实用见解。

研究局限性

- 主要关注源自不受信任外部交互的威胁

- 假设存在定义良好的可信计算基

- 排除模型权重中毒、硬件侧信道攻击等

未来研究方向

- 集成硬件辅助安全原语(如可信执行环境TEEs),降低计算开销并强化基础信任层;

- 探索动态自适应安全策略,利用强化学习根据任务复杂性和环境不确定性动态调整防御层敏感性,在保持高任务效用的同时增强弹性。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录