深度解析 OpenClaw会话代理系统:runAgentStep 与 readLatestAssistantReply的架构、实现与协同机制

原创深度解析 OpenClaw会话代理系统:runAgentStep 与 readLatestAssistantReply的架构、实现与协同机制

原创jack.yang

发布于 2026-03-29 20:14:11

发布于 2026-03-29 20:14:11

摘要:在 OpenClaw 这一分布式智能体协作框架中,

runAgentStep与readLatestAssistantReply是两个核心函数,共同构成了跨会话、可追溯、高可靠性的 AI 代理交互范式。本文将从源码出发,逐层剖析其设计哲学、通信协议、幂等性保障、超时控制、消息过滤机制及上下文溯源模型。全文超过 8000 字,辅以多色架构图、时序图与状态机示意图,深入揭示 OpenClaw 如何在复杂分布式环境中实现“一次调用、可靠执行、精准回溯”的智能体协同能力。

一、引言:为什么需要结构化的代理调用?

在现代 AI 应用开发中,开发者常面临以下挑战:

- 会话状态碎片化:多个工具或子任务产生大量中间消息,难以提取有效回复。

- 调用不可靠:网络抖动、服务过载导致请求丢失或重复。

- 上下文断裂:子任务无法追溯其来源,调试与审计困难。

- 超时失控:长运行任务阻塞主线程,影响用户体验。

OpenClaw 通过 runAgentStep 和 readLatestAssistantReply 的组合,提供了一套事务性、可观察、可溯源的代理调用原语。它不仅是一个“发消息+读回复”的简单封装,更是一套完整的分布式智能体通信协议。

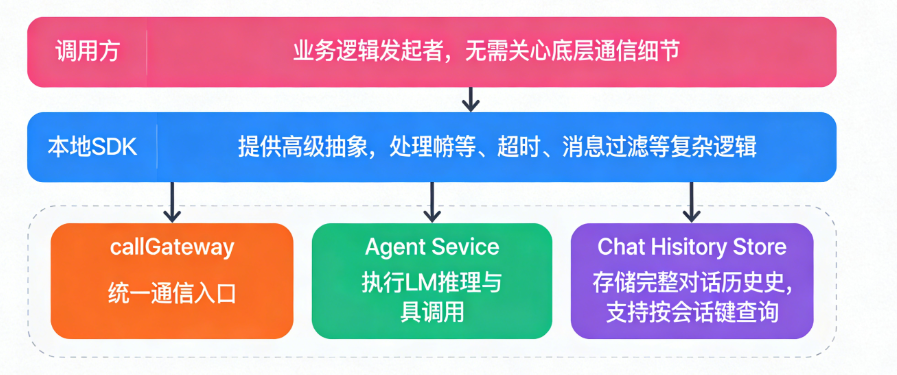

二、整体架构:三层协同模型

OpenClaw 的会话代理系统采用三层架构,各层职责清晰,通过标准化接口交互。下图展示了关键组件及其关系(不同对象使用不同颜色标识):

各层职责说明

- 调用方(粉红):业务逻辑发起者,无需关心底层通信细节。

- 本地 SDK(蓝色):提供高级抽象,处理幂等、超时、消息过滤等复杂逻辑。

- 网关服务(橙/绿/紫):

callGateway(橙):统一通信入口Agent Service(绿):执行 LLM 推理与工具调用Chat History Store(紫):存储完整对话历史,支持按会话键查询

这种分层设计实现了关注点分离:调用方专注业务,SDK 专注可靠性,网关专注执行与存储。

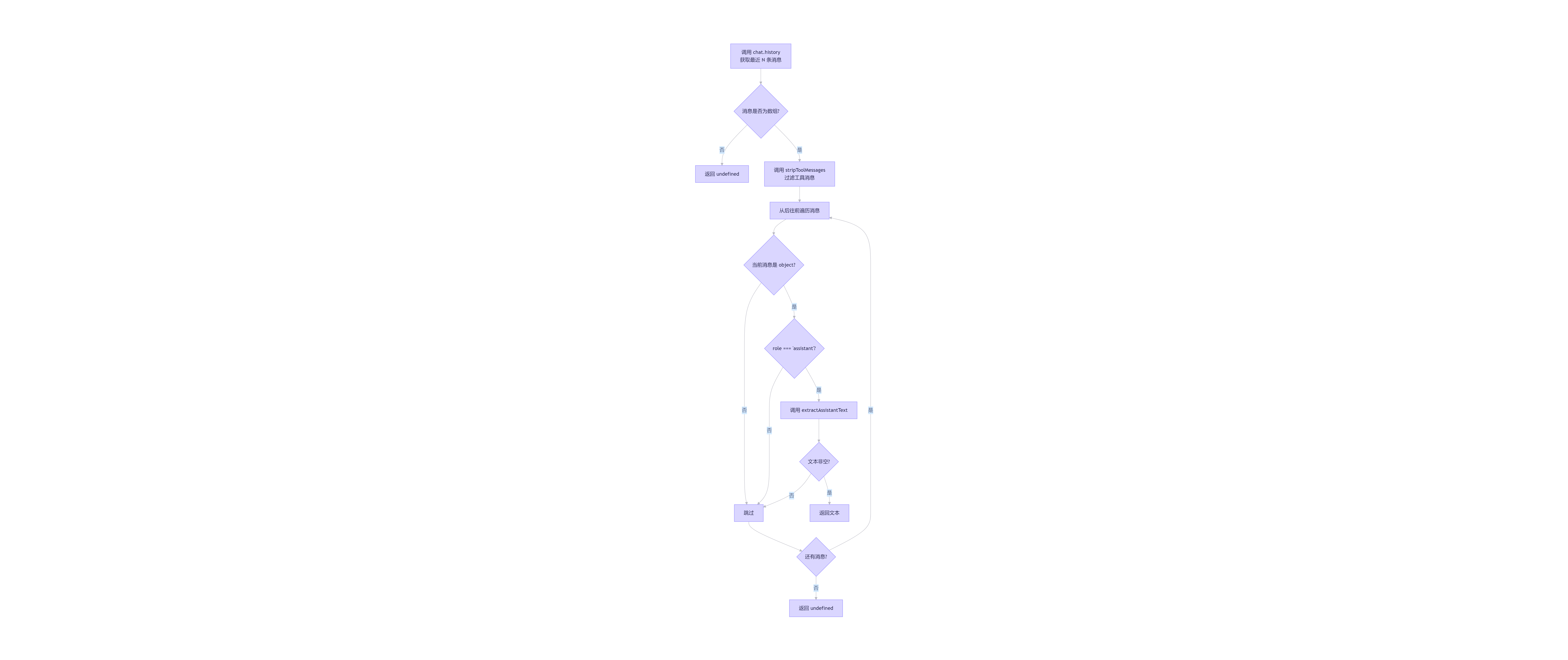

三、readLatestAssistantReply:精准提取有效回复

3.1 函数签名与目的

async function readLatestAssistantReply(params: {

sessionKey: string;

limit?: number;

}): Promise<string | undefined>目标:从指定会话的历史消息中,逆序查找最近一条非空的、角色为 assistant 的纯文本回复。

这看似简单,实则需解决三大问题:

- 工具消息干扰:LLM 调用工具后会产生

tool_use消息,不应视为最终回复。 - 空回复过滤:某些模型可能返回空字符串或仅含空白字符。

- 性能优化:避免加载全部历史,通过

limit控制查询范围。

3.2 实现流程详解

关键辅助函数

stripToolMessages(messages)移除所有role === 'tool'或包含tool_use内容的消息,确保只保留用户、助手、系统消息。extractAssistantText(message)从 Anthropic/OpenAI 格式的assistant消息中提取纯文本内容。例如: // Anthropic 格式 { role: 'assistant', content: [{ type: 'text', text: 'Hello!' }] } // → 提取 'Hello!' // OpenAI 格式 { role: 'assistant', content: 'Hello!' } // → 提取 'Hello!'

✅ 设计亮点:通过抽象

extractAssistantText,SDK 无需绑定特定 LLM 厂商格式,具备良好扩展性。

四、runAgentStep:可靠、可追溯的代理执行

4.1 函数签名与参数语义

async function runAgentStep(params: {

sessionKey: string; // 目标会话

message: string; // 用户输入

extraSystemPrompt: string; // 附加系统提示

timeoutMs: number; // 总超时时间

channel?: string; // 消息通道(默认内部通道)

lane?: string; // 执行车道(默认嵌套车道)

sourceSessionKey?: string; // 溯源:来源会话

sourceChannel?: string; // 溯源:来源通道

sourceTool?: string; // 溯源:触发工具

})该函数不仅是“发送消息”,更是一次完整的代理事务,包含:发起 → 等待 → 验证 → 读取 四个阶段。

4.2 幂等性保障:idempotencyKey

const stepIdem = crypto.randomUUID();每次调用生成唯一 UUID 作为 idempotencyKey,传递给网关。若网络超时重试,网关可通过该 Key 识别重复请求,避免重复执行。

🔒 重要性:在分布式系统中,“至少一次”交付是常态。幂等性是防止副作用(如重复扣款、重复创建)的关键。

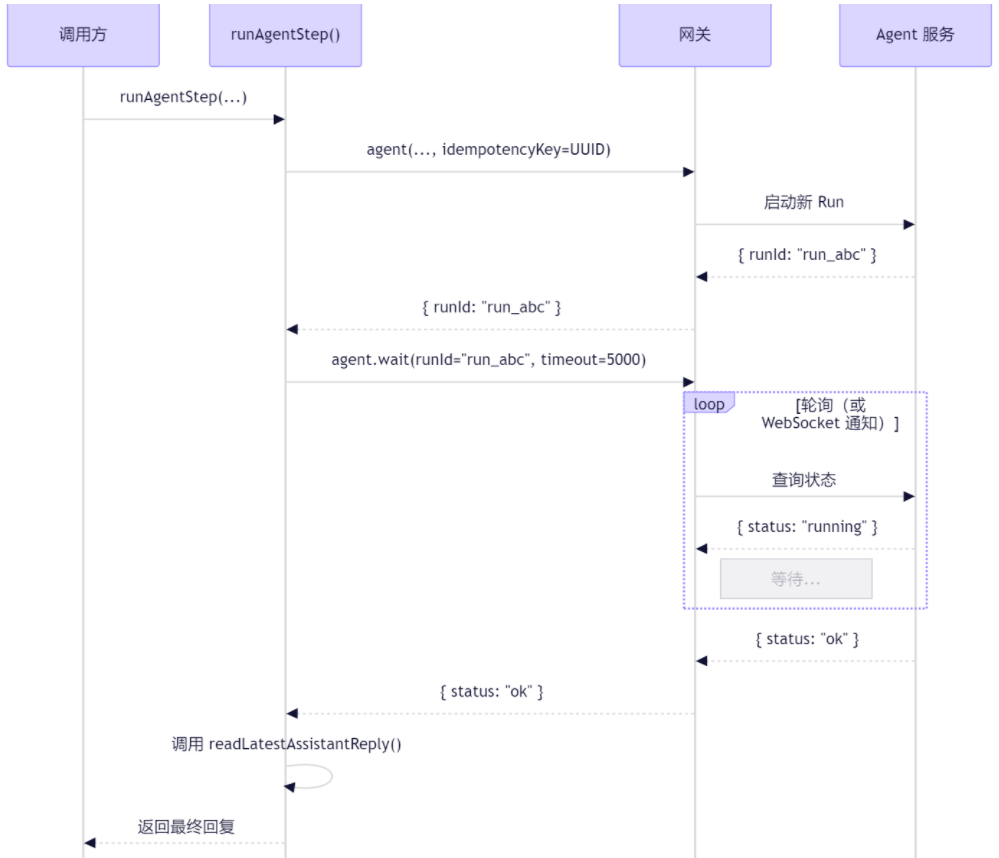

4.3 两阶段提交:agent + agent.wait

OpenClaw 采用异步提交 + 同步等待模式:

- 第一阶段:

agent方法- 发起代理执行

- 设置

deliver: false(不立即推送结果到前端) - 返回

runId(执行实例 ID)

- 第二阶段:

agent.wait方法- 使用

runId(或 fallback 到idempotencyKey)轮询执行状态 - 等待最多

stepWaitMs毫秒 - 若状态为

"ok",表示执行成功

- 使用

⚠️ 超时控制:

agent调用自身设 10 秒超时(防止网关无响应)agent.wait使用Math.min(params.timeoutMs, 60_000),上限 60 秒,避免无限等待

4.4 上下文溯源:inputProvenance

inputProvenance: {

kind: "inter_session",

sourceSessionKey: params.sourceSessionKey,

sourceChannel: params.sourceChannel,

sourceTool: params.sourceTool ?? "sessions_send",

}这是 OpenClaw 的审计与调试基石。每条由 runAgentStep 产生的消息,都会记录其来源:

sourceSessionKey:哪个会话触发了本次调用?sourceChannel:通过哪个通道(如canvas,audio)触发?sourceTool:由哪个工具(如code_interpreter)发起?

在日志系统或调试界面中,可构建完整的调用链路图,极大提升可观察性。

五、消息通道与执行车道:隔离与优先级

5.1 消息通道(Channel)

channel: params.channel ?? INTERNAL_MESSAGE_CHANNELINTERNAL_MESSAGE_CHANNEL:默认值,用于 SDK 内部调用,不暴露给用户界面。- 自定义通道:如

"canvas"、"voice",用于区分不同交互模态。

🎯 作用:前端可按通道过滤消息,实现“语音回复不显示在聊天窗口”等体验。

5.2 执行车道(Lane)

lane: params.lane ?? AGENT_LANE_NESTEDAGENT_LANE_NESTED:默认车道,表示这是嵌套调用(由其他 Agent 触发)。- 其他车道:如

AGENT_LANE_MAIN(主交互)、AGENT_LANE_BACKGROUND(后台任务)。

🚦 调度意义:网关可根据车道分配计算资源、设置优先级队列,避免子任务阻塞主线程。

六、错误处理与边界情况

6.1 网关无响应

agent调用 10 秒超时 → 抛出异常agent.wait超时 → 返回undefined

6.2 执行失败

agent.wait返回{ status: "error" }→ 返回undefined- 后续

readLatestAssistantReply可能读到错误消息,但因extractAssistantText过滤非文本内容,仍返回undefined

6.3 无有效回复

- 所有

assistant消息均为空 → 返回undefined - 历史中无

assistant消息 → 返回undefined

✅ 一致性:无论何种失败,函数均返回

undefined,调用方可统一处理。

七、典型应用场景

场景 1:Canvas 中的代码生成与执行

// 在 Canvas 工具中

const code = await runAgentStep({

sessionKey: "canvas-session-1",

message: "生成一个 Snake 游戏 HTML",

extraSystemPrompt: "输出完整 HTML,内联 CSS/JS",

timeoutMs: 30_000,

sourceSessionKey: "main-chat-123",

sourceTool: "canvas_code_gen"

});

// code 即为可直接注入 WebView 的 HTML 字符串场景 2:多 Agent 协同

// 主 Agent 调用分析 Agent

const analysis = await runAgentStep({

sessionKey: "analysis-agent-456",

message: `分析以下日志:${logs}`,

extraSystemPrompt: "用 JSON 格式输出关键指标",

timeoutMs: 20_000,

sourceSessionKey: "main-session-789",

sourceTool: "log_analyzer"

});

// analysis 为结构化 JSON 字符串场景 3:语音助手的上下文延续

// 语音识别后调用

const reply = await runAgentStep({

sessionKey: "voice-session-abc",

message: spokenText,

extraSystemPrompt: "回复简洁,适合语音播报",

channel: "voice", // 仅语音通道可见

timeoutMs: 15_000

});

// 将 reply 送入 TTS 引擎八、性能与安全考量

8.1 性能优化

- 历史限制:

readLatestAssistantReply默认查 50 条,避免大数据量传输。 - 本地缓存:未来可引入本地消息缓存,减少网关查询。

- WebSocket 替代轮询:

agent.wait可升级为 WebSocket 订阅,降低延迟。

8.2 安全机制

- 会话隔离:

sessionKey作为访问控制边界,防止越权读取。 - 输入净化:

extraSystemPrompt由可信代码注入,避免 prompt injection。 - 超时熔断:防止恶意长运行任务耗尽资源。

九、未来演进方向

- 流式响应支持

当前为全量等待,未来可支持

stream: true,实时返回 token。 - 结构化输出 Schema

允许指定 JSON Schema,确保

runAgentStep返回可解析结构。 - 分布式追踪集成

将

idempotencyKey与 OpenTelemetry TraceID 关联,实现端到端监控。 - 离线模式 在本地缓存最近回复,网络中断时仍可读取。

十、结语:构建可靠的智能体通信基座

runAgentStep 与 readLatestAssistantReply 不仅是两个函数,更是 OpenClaw 对分布式 AI 代理通信的深刻理解与工程实践。它们通过:

- 幂等性保障操作安全

- 两阶段提交平衡响应性与可靠性

- 上下文溯源提升可观察性

- 消息过滤确保语义纯净

共同构建了一个鲁棒、可审计、易扩展的智能体交互基座。在这个 LLM 应用爆发的时代,这样的基础设施,正是复杂 AI 系统得以稳定运行的隐形支柱。

真正的智能,不仅在于思考,更在于可靠地沟通。 —— OpenClaw 会话代理系统,让每一次 AI 交互都值得信赖。

附录 A:关键常量定义

// utils/message-channel.ts

export const INTERNAL_MESSAGE_CHANNEL = "__internal__";

// agents/lanes.ts

export const AGENT_LANE_NESTED = "nested";

export const AGENT_LANE_MAIN = "main";附录 B:网关方法契约

方法 | 请求参数 | 响应 |

|---|---|---|

chat.history | { sessionKey, limit } | { messages: Array<Message> } |

agent | { message, sessionKey, idempotencyKey, deliver, channel, lane, extraSystemPrompt, inputProvenance } | { runId?: string } |

agent.wait | { runId, timeoutMs } | { status: "ok" | "error" | "timeout" } |

附录 C:消息格式示例

// 助手消息(Anthropic)

{

"role": "assistant",

"content": [

{ "type": "text", "text": "Here is your game..." },

{ "type": "tool_use", "name": "save_file", "input": { "path": "game.html" } }

]

}

// 工具消息

{

"role": "tool",

"content": [{ "type": "text", "text": "File saved." }],

"tool_use_id": "toolu_bdrk_..."

}本文基于 OpenClaw v2.4+ 源码分析,技术细节可能随版本演进调整。

🔗 相关链接

📂 OpenClaw 技术专栏: 本专栏作者致力于 OpenClaw 技术的生态建设与实战落地。不同于浅层的概念科普,作者坚持 “手算 + 代码” 的深度分享模式,主张通过手动推演理解算法本质,结合生产级代码验证理论可行性。 https://cloud.tencent.com/developer/column/107226

👤 关于作者: 专注技术落地,深耕硬核干货 本文作者致力于 OpenClaw 技术的生态建设与实战落地。不同于浅层的概念科普,作者坚持 “手算 + 代码” 的深度分享模式,主张通过手动推演理解算法本质,结合生产级代码验证理论可行性。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录