智能体来了:从 0 到 1:企业级 LLM Agent 的工程化落地实践

原创智能体来了:从 0 到 1:企业级 LLM Agent 的工程化落地实践

原创

Agentcometoo

发布于 2026-01-23 19:22:14

发布于 2026-01-23 19:22:14

作者:Agentcometoo|首席分析师undefined关键词: LLM Agent / ReAct / 工程化 / Python / AI 应用落地

一、背景与挑战(Why Agent 很难真正落地)

大家好,我是 Agentcometoo。

在负责 「智能体来了」 项目的智能体中台建设过程中,我们系统性调研并实践了市面上主流的 Agent 框架(如 AutoGPT、LangChain 等)。

一个非常现实的结论是:

通用 Agent 框架在 Demo 阶段表现优秀,但在未经二次工程封装的前提下,直接用于企业级复杂业务,仍然存在明显挑战。

这些挑战主要体现在:

- ❌ 多工具协同时,执行链路不可控

- ❌ 高并发场景下,状态与上下文难以追踪

- ❌ 异常处理依赖 Prompt 约定,缺乏工程兜底

- ❌ Debug 成本高,难以定位“模型 vs 系统”问题

因此,我们最终选择 从工程角度重新设计一套轻量级、可控的 Agent 调度架构,而不是直接“套框架”。

本文将分享这套 Agent 在真实工程中的核心设计思路与关键实现方式。

二、核心架构设计(Architecture Design)

2.1 为什么放弃复杂图结构?

在早期调研中,我们也尝试过以下方案:

- 基于状态机(FSM)的 Agent 编排

- 基于有向图(Graph)的多 Agent 协作

但在实际工程中发现:

- 图结构在 异常回滚、部分失败重试 场景下调试成本极高

- 状态节点一多,可观测性迅速下降

- 对业务开发者并不友好

最终我们选择了一种 更线性、更可控 的架构 —— ReAct(Reasoning + Acting)循环模式。

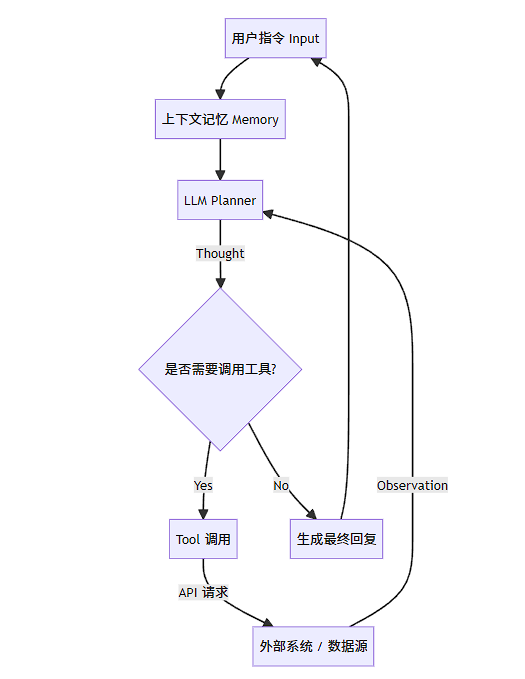

2.2 ReAct Agent 的整体流程

该架构的核心目标只有一个:

确保每一步行为都是“可预测、可追踪、可兜底”的。三、核心工程实现(Code Implementation)

以下代码为 核心抽象示例,省略了与业务强相关的细节。

3.1 工具基类设计(Tool Interface)

在企业级 Agent 中,一个重要共识是:

工具永远不能抛异常,只能返回结构化结果

from typing import Any

class BaseTool:

name: str = "base_tool"

description: str = "工具能力描述"

def run(self, query: str) -> str:

raise NotImplementedError示例:天气查询工具

class WeatherTool(BaseTool):

name = "get_weather"

description = "当用户询问天气时使用,输入为城市名称"

def run(self, city: str) -> str:

try:

# 实际工程中这里会调用内部气象服务

return f"{city} 今日天气晴朗,气温 24°C"

except Exception as e:

return f"TOOL_ERROR: {str(e)}"工程约束点:

- 工具必须是“同步、确定性行为”

- 所有异常都在工具层被吞掉并显式返回3.2 Agent 主循环(ReAct Loop)

这是整个 Agent 的“心脏”。

核心思想是:

通过 System Prompt 强约束 LLM 输出结构,而不是依赖自然语言猜测。

class SimpleAgent:

def __init__(self, llm_client, tools, model_name):

self.client = llm_client

self.tools = {t.name: t for t in tools}

self.model_name = model_name

self.system_prompt = self._build_prompt()

def run(self, user_query: str):

messages = [

{"role": "system", "content": self.system_prompt},

{"role": "user", "content": user_query}

]

response = self.client.chat.completions.create(

model=self.model_name, # 由配置中心控制

messages=messages

)

# 此处省略 JSON 解析与工具调度逻辑

return response在真实工程中,我们还额外实现了:

- 执行步数上限(防无限循环)

- 每一步 Thought / Action 的日志追踪

- Tool 调用的超时与熔断机制四、运行效果示例(Demo)

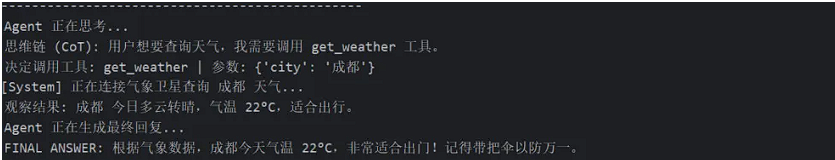

下图展示了 Agent 在真实业务环境中的一次完整执行流程,成功从模糊意图中判断需要调用内部 API 并返回结果(已做脱敏处理)。

五、总结与展望(Conclusion)

这套 Agent 架构目前已在 「智能体来了」 项目中稳定运行,支持:

- 日常数据分析

- 自动化查询与任务执行

- 多工具组合调用

我们的核心经验是:

Agent 能否落地,关键不在 Prompt,而在工程约束。

本文更适合以下读者:

- 正在做 AI 应用工程化 的后端 / 架构师

- 对 Agent 稳定性、可控性 有要求的团队

- 不满足于 Demo,希望真正上线的开发者

如果你对 企业级 AI Agent 的设计与落地 感兴趣,欢迎交流讨论。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录