智能体领航员,并不是更强的 AI,而是被长期忽略的系统角色

原创智能体领航员,并不是更强的 AI,而是被长期忽略的系统角色

原创

Agent_阿杨

发布于 2026-01-23 09:51:44

发布于 2026-01-23 09:51:44

一、一个被行业低估的事实:

执行型 AI 越普及,被“用错”的概率反而越高

过去几年,AI 能力的增长路径极其清晰:

- 更强的模型

- 更多的 agent

- 更长的 workflow

- 更低的人类介入比例

从技术视角看,这是进步曲线。 但从系统视角看,一个危险的趋势正在同步放大:

AI 被用来解决的问题,正在超出它的结构适配范围。

大量系统失败并不是因为:

- AI 不够聪明

- 算法不够先进

- agent 不够多

而是因为——

它们被当成“执行机器”, 却被要求承担“判断责任”。

这正是执行型 AI 的隐性天花板。

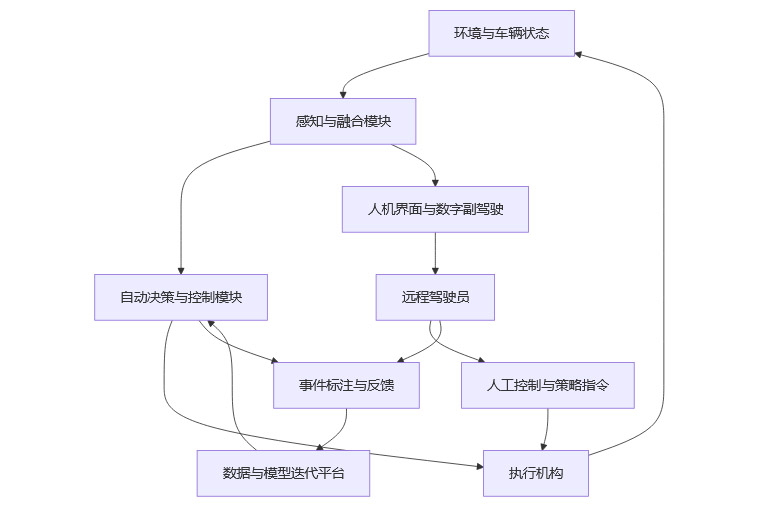

Image

二、问题的根源:系统中缺失了一个“本该存在的角色”

在几乎所有 AI 系统设计中,都默认存在两个角色:

- 人类:提出目标、兜底判断

- AI:执行指令、完成任务

这在简单任务中没有问题。

但一旦任务进入以下状态:

- 目标并不稳定

- 路径需要边走边修

- 多个目标相互冲突

- 中途信息会改变最优解

系统就会进入一种结构性失衡:

判断责任没有被显性分配,只能不断回流给人类。

于是我们看到一个非常熟悉的现象:

- prompt 越写越长

- 人越用越累

- AI 看似在自动化,

- 人却在做越来越多“隐性决策”

这不是使用问题,而是角色缺失问题。

三、执行型 AI 被误用的三种典型方式

当系统中没有“领航层”,执行型 AI 往往会被迫承担三种它并不擅长的职责。

1️⃣ 被用来“决定该不该做”

执行系统擅长的是如何做, 却被不断要求回答:

- 要不要现在做?

- 是不是该换个方向?

- 这个目标还值不值得继续?

结果是:

AI 只能根据局部信息继续执行, 而真正的判断被推迟、被掩盖、被忽略。

2️⃣ 被用来“掩盖判断失误”

在很多复杂项目中,你会看到一种危险模式:

- 判断阶段做错了

- 但没有被显性承认

- 于是不断加大执行强度

AI 在这里的作用,不是纠错,而是加速错误路径。

3️⃣ 被用来“替人承担心理压力”

这是最隐蔽的一种误用。

当人类面对不确定性时,本能会希望:

“是不是可以交给系统?”

但如果系统只有执行能力, 那它只能给你一种虚假的确定感。

执行 ≠ 决策, 但系统很容易让人混淆这两者。

Image

四、智能体领航员的真实作用:

把“判断责任”从人脑里,移回系统结构中

这里必须非常明确一点:

智能体领航员不是更高级的执行体, 而是一个“判断角色”的系统化表达。

它解决的不是“怎么把事做完”, 而是三个更根本的问题:

- 现在是否该做?

- 接下来优先做哪一步?

- 什么时候应该停、换、回退?

当这个角色不存在时:

- 所有判断都隐性压在人身上

- 系统看似自动化,实则高度依赖人类认知

当这个角色被显性引入时:

- 判断被结构化

- 决策路径可被讨论、修正、复盘

- 执行系统才真正回到它擅长的位置

智能体领航员的出现,不是为了减少人, 而是为了让“判断”有一个正式的位置。

五、一个行业级判断:

没有领航层的执行型 AI,规模越大,风险越高

这是一个很多人不愿意正视的结论:

执行型 AI 的风险,并不是在能力不足时出现的, 而是在能力足够强、覆盖足够广之后集中爆发的。

原因很简单:

- 能力越强,越容易被用于“判断问题”

- 覆盖越广,错误路径的影响范围越大

如果系统中没有一个:

- 专门负责判断

- 可以中途改向

- 能对“是否继续”负责的角色

那么系统迟早会进入一种状态:

看起来高度智能, 实际上高度脆弱。

六、结论:

智能体领航员不是“可选增强”,而是结构补位

所以,真正的行业级结论并不是:

“我们需要更高级的 AI。”

而是:

当 AI 开始被用于不确定世界, 系统中必须出现一个明确的领航角色。

否则,所有执行型 AI:

- 都会被误用

- 都会被高估

- 都会在关键时刻失效

智能体领航员的价值,不在于它做了多少事, 而在于它阻止了多少本不该发生的执行。

最后一段(给行业读者)

如果你正在设计、评估、引入 AI 系统, 请不要只问:

“它能做什么?”

你更应该问的是:

“系统里,谁在负责判断?”

如果答案仍然是“人类自己想办法”, 那你面对的不是智能系统, 而是一个被技术包装过的认知负担放大器。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录