山东14岁初中生提出CredalTransformer架构解决大模型幻觉研究成果被人工智能国际顶级会议NeurIPS 2025录用

原创山东14岁初中生提出CredalTransformer架构解决大模型幻觉研究成果被人工智能国际顶级会议NeurIPS 2025录用

原创用户11945664

发布于 2025-12-08 19:58:34

发布于 2025-12-08 19:58:34

近日,神经信息处理系统大会(Conference and Workshop on Neural Information Processing Systems, NeurIPS)公布了2025年会议论文录用结果。令人瞩目的是山东省初三学生姬世豪作为第一作者的研究成果 “Credal Transformer: A Principled Approach for Quantifying and Mitigating Hallucinations in Large Language Models”(Credal Transformer:一种量化和缓解大语言模型幻觉的原则性方法)被NeurIPS 2025 Workshop on Reliable ML录用。

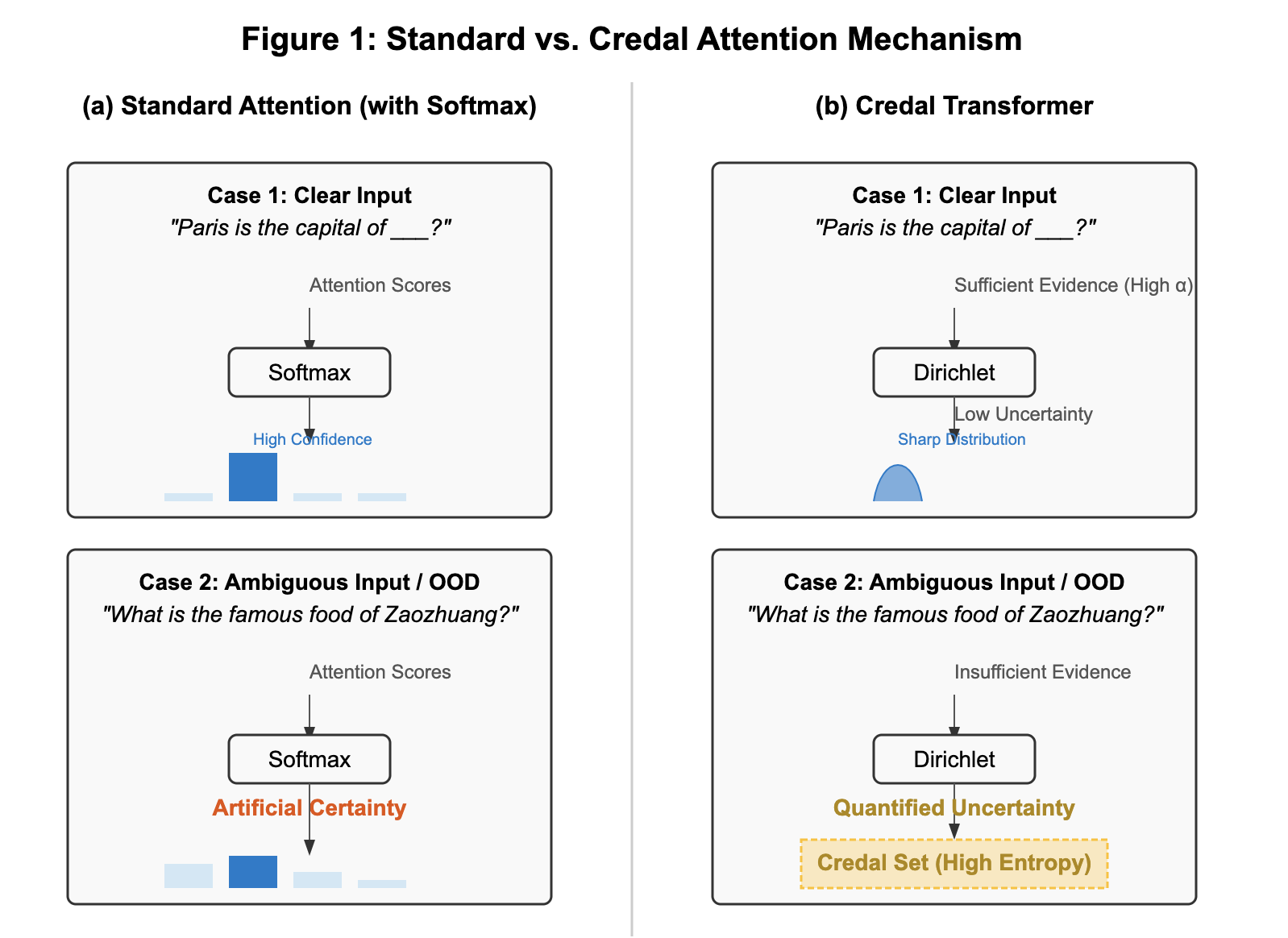

当前,大语言模型在文本生成方面展现了非凡的能力,但其广泛应用面临着一个严峻挑战——幻觉现象,即模型会生成事实错误但置信度极高的断言。这一问题严重制约了LLMs在关键领域的可靠性。姬世豪的研究指出,幻觉问题的根源可能深植于Transformer架构本身,特别是其注意力机制中的Softmax函数。该函数会将潜在的、模糊的注意力分数强制归一化为单一的概率分布,从而在每一层都丢弃了关于模型不确定性的关键信息。这种“人造确定性”在模型深层传播和累积,最终导致模型对虚构内容产生过度自信的预测。针对这一核心问题,该研究提出了 Credal Transformer,一种新颖的模型架构。该架构用凭证注意力机制(Credal Attention Mechanism, CAM)取代了标准的注意力机制。CAM基于证据理论,不再生成单一的注意力向量,而是输出一个凭证集,即一个由多种可能分布构成的凸集。该集合的大小直接、可微地度量了模型的认知不确定性。当模型有充分证据时,该集合会收缩为单一精准的分布,表现与标准注意力机制类似;而当证据不足时,该集合会扩大,明确地表达了模型对于“知识盲区”的认知。实验结果表明,Credal Transformer在多个任务上表现出色。它能够通过产生高熵输出来有效识别分布外的未知输入,并准确量化输入中的模糊性。在问答任务基准测试中,当面对无法回答的问题时,该模型能够主动选择弃权,从而显著减少了高置信度的错误回答。该成果不仅为解决大模型幻觉问题提供了一个具体的、可落地的架构方案,更倡导了一种将不确定性量化作为模型内在核心功能的设计范式。Credal Transformer为开发更可靠、更值得信赖,且能够“自知其无知”的下一代人工智能系统奠定了坚实的理论与架构基础。

NeurIPS是人工智能和机器学习领域的国际顶级学术会议,以其严格的评审标准和巨大的学术影响力而著称,每年吸引全球顶尖学者与行业领袖参与。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读