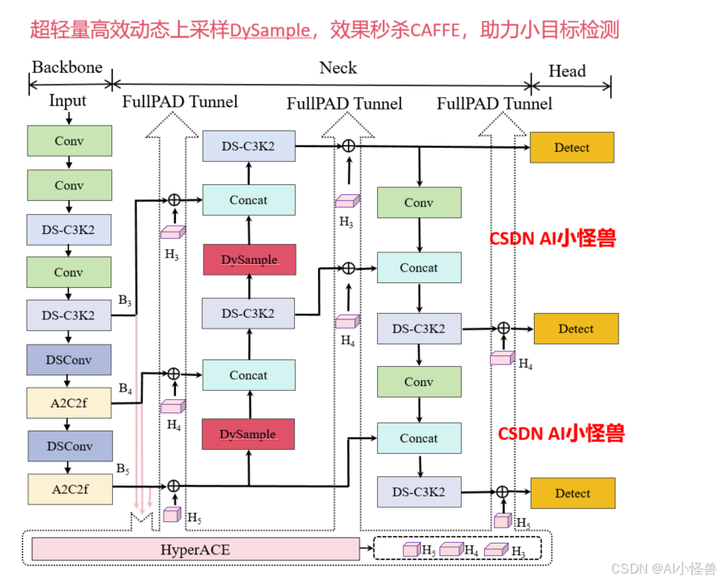

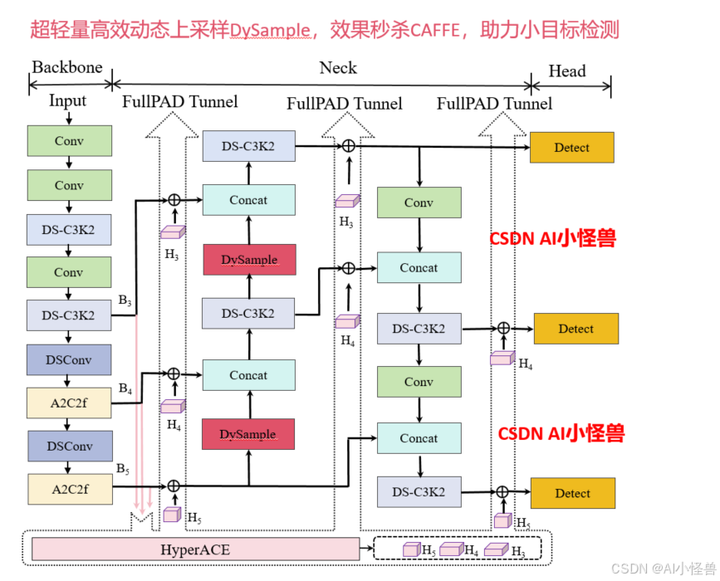

YOLOv13改进:上采样算子 | 超轻量高效动态上采样DySample,效果秒杀CAFFE,助力小目标检测

原创YOLOv13改进:上采样算子 | 超轻量高效动态上采样DySample,效果秒杀CAFFE,助力小目标检测

原创

AI小怪兽

发布于 2025-07-08 09:03:04

发布于 2025-07-08 09:03:04

💡💡💡本文独家改进:一种超轻量高效动态上采样DySample, 具有更少的参数、FLOPs,效果秒杀CAFFE和YOLOv13网络中的nn.Upsample

💡💡💡在多个数据集下验证能够涨点,尤其在小目标检测领域涨点显著。

《YOLOv13魔术师专栏》将从以下各个方向进行创新:

链接:

【原创自研模块】【多组合点优化】【注意力机制】【卷积魔改】【block&多尺度融合结合】【损失&IOU优化】【上下采样优化 】【小目标性能提升】【前沿论文分享】【训练实战篇】

定期向订阅者提供源码工程,配合博客使用。

💡💡💡为本专栏订阅者提供创新点改进代码,改进网络结构图,方便paper写作!!!

💡💡💡适用场景:红外、小目标检测、工业缺陷检测、医学影像、遥感目标检测、低对比度场景

💡💡💡适用任务:所有改进点适用【检测】、【分割】、【pose】、【分类】等

💡💡💡全网独家首发创新,【自研多个自研模块】,【多创新点组合适合paper 】!!!

☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️ ☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️

包含注意力机制魔改、卷积魔改、检测头创新、损失&IOU优化、block优化&多层特征融合、 轻量级网络设计、25年最新顶会改进思路、原创自研paper级创新等

🚀🚀🚀 本项目持续更新 | 更新完结保底≥80+ ,冲刺100+ 🚀🚀🚀

💡💡💡 2025年计算机视觉顶会创新点适用于YOLOv12、YOLO11、YOLOv10、YOLOv8等各个YOLO系列,专栏文章提供每一步步骤和源码,轻松带你上手魔改网络 !!!

💡💡💡重点:通过本专栏的阅读,后续你也可以设计魔改网络,在网络不同位置(Backbone、head、detect、loss等)进行魔改,实现创新!!!

☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️ ☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️☁️

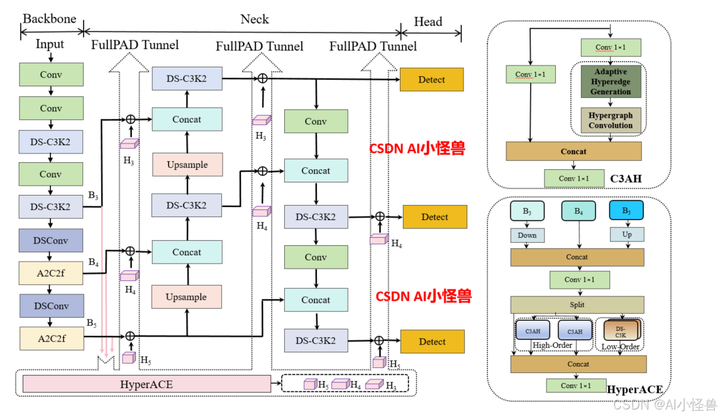

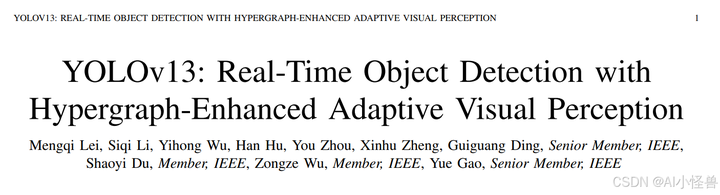

1.YOLOv13介绍

论文:[2506.17733] YOLOv13: Real-Time Object Detection with Hypergraph-Enhanced Adaptive Visual Perception

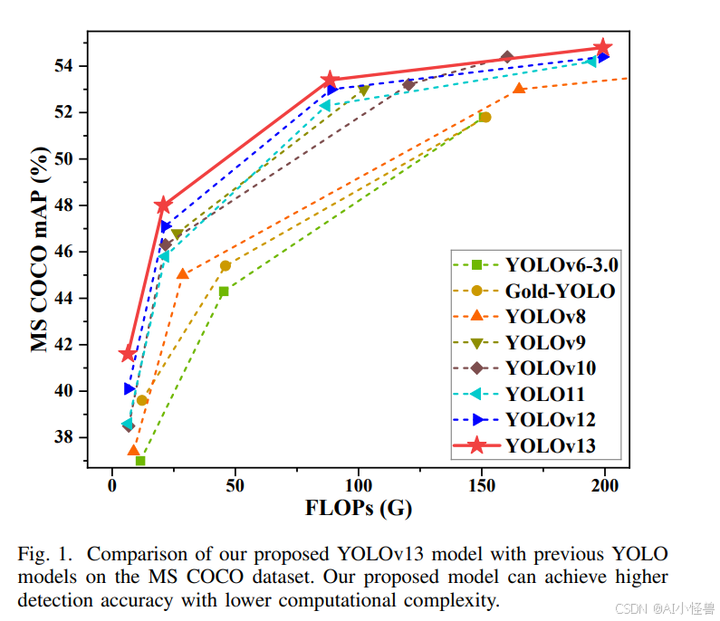

摘要—YOLO 系列模型因其卓越的准确性和计算效率在实时目标检测领域占据主导地位。然而,无论是 YOLO11 及更早版本的卷积架构,还是 YOLOv12 引入的基于区域的自注意力机制,都仅限于局部信息聚合和成对相关性建模,缺乏捕捉全局多对多高阶相关性的能力,这限制了在复杂场景下的检测性能。本文提出了一种准确且轻量化的 YOLOv13 目标检测器。为应对上述挑战,我们提出了一种基于超图的自适应相关性增强(HyperACE)机制,通过超图计算自适应地利用潜在的高阶相关性,克服了以往方法仅基于成对相关性建模的限制,实现了高效的全局跨位置和跨尺度特征融合与增强。随后,我们基于 HyperACE 提出了全链路聚合与分配(FullPAD)范式,通过将相关性增强特征分配到整个网络,有效实现了全网的细粒度信息流和表征协同。最后,我们提出用深度可分离卷积代替常规的大核卷积,并设计了一系列块结构,在不牺牲性能的前提下显著降低了参数量和计算复杂度。我们在广泛使用的 MS COCO 基准测试上进行了大量实验,结果表明,我们的方法在参数更少、浮点运算量更少的情况下达到了最先进性能。具体而言,我们的 YOLOv13-N 相比 YOLO11-N 提升了 3.0% 的 mAP,相比 YOLOv12-N 提升了 1.5% 的 mAP。

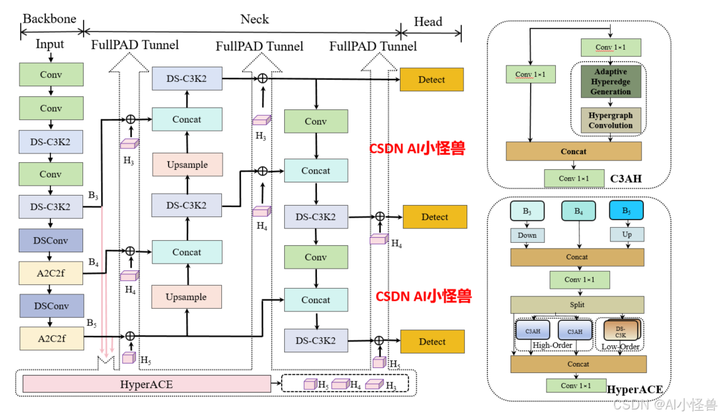

以往的 YOLO 系列遵循 “骨干网络 → 颈部网络 → 检测头” 的计算范式,这本质上限定了信息流的充分传输。相比之下,我们的模型通过超图自适应关联增强(HyperACE)机制,实现全链路特征聚合与分配(FullPAD),从而增强传统的 YOLO 架构。因此,我们提出的方法在整个网络中实现了细粒度的信息流和表征协同,能够改善梯度传播并显著提升检测性能。具体而言,如图 2 所示,我们的 YOLOv13 模型首先使用类似以往工作的骨干网络提取多尺度特征图 B1、B2、B3、B4、B5,但其中的大核卷积被我们提出的轻量化 DS-C3k2 模块取代。然后,与传统 YOLO 方法直接将 B3、B4 和 B5 输入颈部网络不同,我们的方法将这些特征收集并传递到提出的 HyperACE 模块中,实现跨尺度跨位置特征的高阶关联自适应建模和特征增强。随后,我们的 FullPAD 范式利用三个独立通道,将关联增强后的特征分别分配到骨干网络与颈部网络的连接处、颈部网络的内部层以及颈部网络与检测头的连接处,以优化信息流。最后,颈部网络的输出特征图被传递到检测头中,实现多尺度目标检测。

ultralytics/cfg/models/v13/yolov13.yaml

nc: 80 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov13n.yaml' will call yolov13.yaml with scale 'n'

# [depth, width, max_channels]

n: [0.50, 0.25, 1024] # Nano

s: [0.50, 0.50, 1024] # Small

l: [1.00, 1.00, 512] # Large

x: [1.00, 1.50, 512] # Extra Large

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2, 1, 2]] # 1-P2/4

- [-1, 2, DSC3k2, [256, False, 0.25]]

- [-1, 1, Conv, [256, 3, 2, 1, 4]] # 3-P3/8

- [-1, 2, DSC3k2, [512, False, 0.25]]

- [-1, 1, DSConv, [512, 3, 2]] # 5-P4/16

- [-1, 4, A2C2f, [512, True, 4]]

- [-1, 1, DSConv, [1024, 3, 2]] # 7-P5/32

- [-1, 4, A2C2f, [1024, True, 1]] # 8

head:

- [[4, 6, 8], 2, HyperACE, [512, 8, True, True, 0.5, 1, "both"]]

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [ 9, 1, DownsampleConv, []]

- [[6, 9], 1, FullPAD_Tunnel, []] #12

- [[4, 10], 1, FullPAD_Tunnel, []] #13

- [[8, 11], 1, FullPAD_Tunnel, []] #14

- [-1, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 12], 1, Concat, [1]] # cat backbone P4

- [-1, 2, DSC3k2, [512, True]] # 17

- [[-1, 9], 1, FullPAD_Tunnel, []] #18

- [17, 1, nn.Upsample, [None, 2, "nearest"]]

- [[-1, 13], 1, Concat, [1]] # cat backbone P3

- [-1, 2, DSC3k2, [256, True]] # 21

- [10, 1, Conv, [256, 1, 1]]

- [[21, 22], 1, FullPAD_Tunnel, []] #23

- [-1, 1, Conv, [256, 3, 2]]

- [[-1, 18], 1, Concat, [1]] # cat head P4

- [-1, 2, DSC3k2, [512, True]] # 26

- [[-1, 9], 1, FullPAD_Tunnel, []]

- [26, 1, Conv, [512, 3, 2]]

- [[-1, 14], 1, Concat, [1]] # cat head P5

- [-1, 2, DSC3k2, [1024,True]] # 30 (P5/32-large)

- [[-1, 11], 1, FullPAD_Tunnel, []]

- [[23, 27, 31], 1, Detect, [nc]] # Detect(P3, P4, P5)1.1 HyperACE

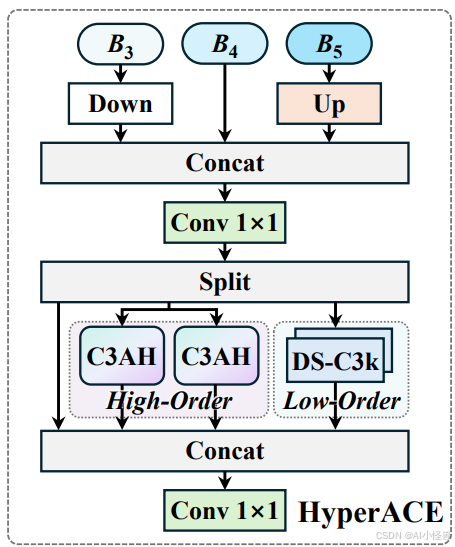

超图自适应相关性增强机制 HyperACE

- 超图理论借鉴与创新 :借鉴超图理论,将多尺度特征图的像素视为超图顶点,不同的是,传统超图方法依赖手工设定参数构建超边,而 HyperACE 设计了可学习的超边生成模块,能自适应地学习并构建超边,动态探索不同特征顶点间的潜在关联。

- 超图卷积操作 :在生成自适应超边后,通过超图卷积操作进行特征聚合与增强。每条超边先从其连接的所有顶点处聚合信息形成高阶特征,再将这些高阶特征传播回各个顶点,更新与增强顶点特征,从而实现高效地跨位置和跨尺度的特征融合与增强,强化不同尺度特征间的语义关联,对小目标和密集目标检测效果显著。

代码位置ultralytics/nn/modules/block.py

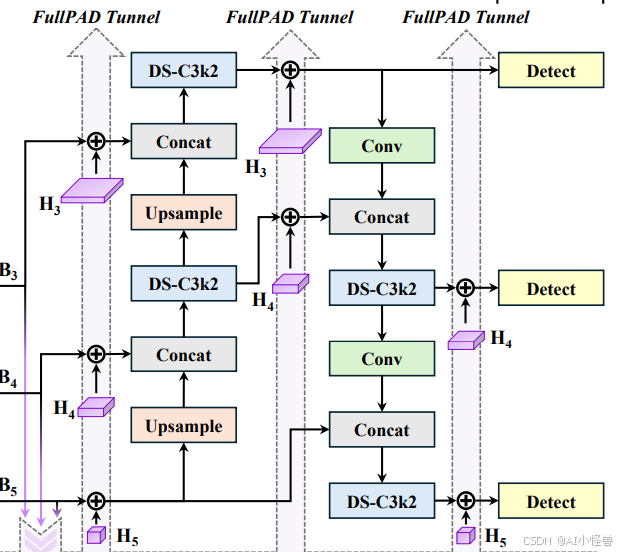

1.2 FullPAD_Tunnel

全流程聚合 - 分发范式 FullPAD

- 多通道特征传递 :打破传统的 “骨干→颈部→头部” 单向计算范式,通过三条独立通路传递特征,即主干 - 颈部连接层、颈部内部层、颈部 - 头部连接层,将 HyperACE 聚合后的多尺度特征,通过这些 “隧道” 分发回网络的不同位置,实现细粒度信息流与全流程表征协同。

- 改善梯度传播 :该范式有效解决了梯度消失或爆炸问题,显着改善了梯度传播效率,从而提升模型整体的检测性能,使模型在复杂场景下能够更好地捕捉目标特征,提高检测的准确性和稳定性。

代码位置ultralytics/nn/modules/block.py

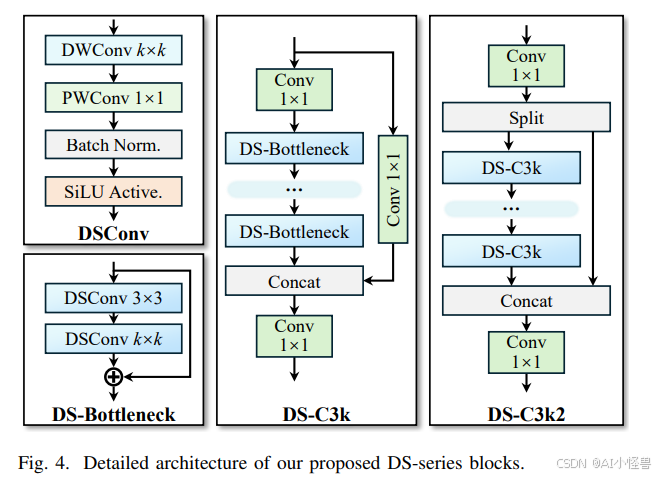

1.3 DSC3k2

基于深度可分离卷积的轻量化模块

- 模块创新与替代 :采用深度可分离卷积构建了 DSConv、DS-Bottleneck、DS-C3k 等模块,替代传统的大核卷积。例如使用 DS-C3k2 模块作为轻量化的骨干网络提取多尺度特征,在保持感受野的同时,大幅降低了参数量与计算量,提高了模型的计算效率。

- 性能与效率平衡 :在几乎不牺牲性能的前提下,显著减少了模型的参数量和计算复杂度,使得 YOLOv13 能够在保持较高检测精度的同时,具备更快的推理速度,适合实时目标检测应用场景,降低了模型的部署难度和资源消耗。

代码位置ultralytics/nn/modules/block.py

2.原理介绍

论文:https://arxiv.org/pdf/2308.15085.pdf

摘要:我们介绍DySample,一个超轻量和有效的动态上采样器。虽然最近基于内核的动态上采样器(如CARAFE、FADE和SAPA)的性能提升令人印象深刻,但它们带来了大量的工作负载,主要是由于耗时的动态卷积和用于生成动态内核的额外子网络。此外,对高特征指导的需求在某种程度上限制了它们的应用场景。为了解决这些问题,我们绕过动态卷积并从点采样的角度制定上采样,这更节省资源,并且可以很容易地使用PyTorch中的标准内置函数实现。我们首先展示了一个朴素的设计,然后演示了如何逐步加强其上采样行为,以实现我们的新上采样器DySample。与以前基于内核的动态上采样器相比,DySample不需要定制CUDA包,并且具有更少的参数、FLOPs、GPU内存和延迟。除了轻量级的特点,DySample在五个密集预测任务上优于其他上采样器,包括语义分割、目标检测、实例分割、全视分割和单目深度估计。

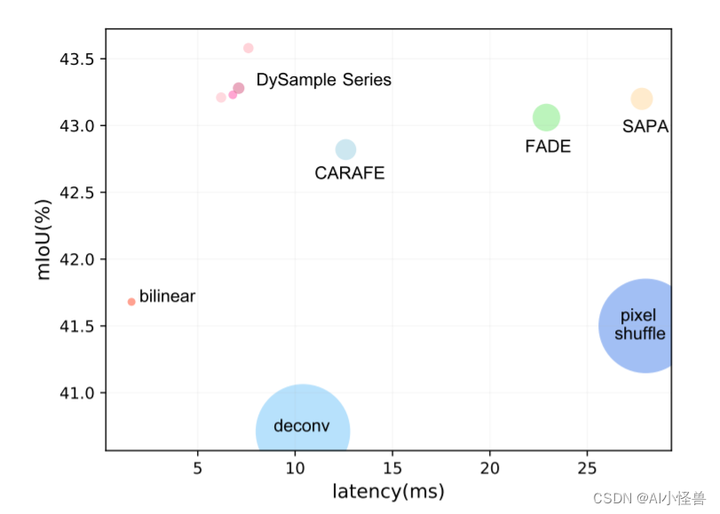

图1所示。不同上采样器的性能、推理速度和GFLOPs的比较。圆圈的大小表示GFLOPs的开销。通过×2上采样大小为256 × 120 × 120的特征图来测试推理时间。在ADE20K数据集[42]上使用SegFormer-B1[40]测试了mIoU性能和额外的gflop。

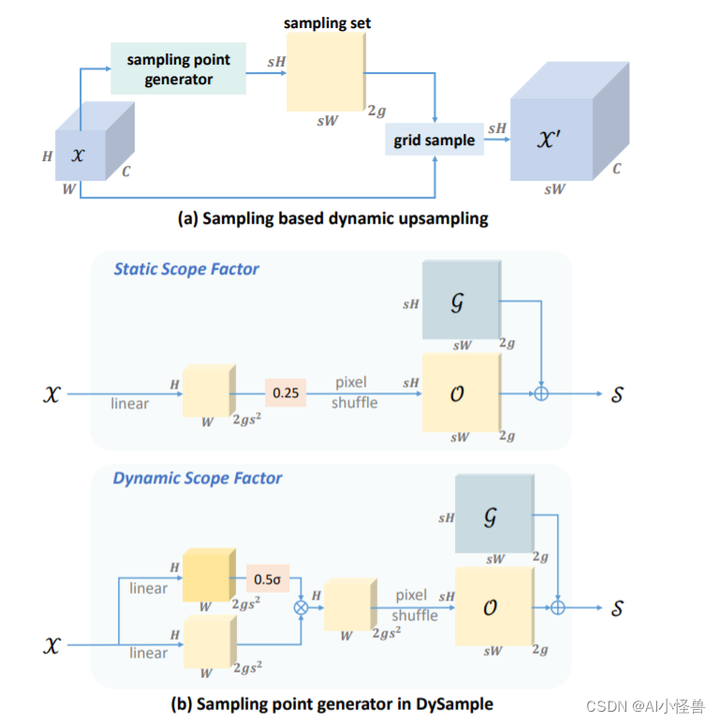

在几何信息建模的基础上,回归到上采样的本质,即点采样。对于PyTorch中的内置函数,我们首先提供了一个简单的实现来演示基于采样的动态上采样的可行性

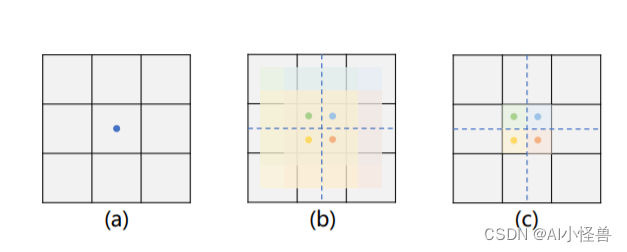

图3。初始采样位置和偏移范围。点和彩色遮罩分别表示初始采样位置和偏移范围。考虑采样4个点(s = 2), (a)在最接近初始化的情况下,4个偏移共享相同的初始位置,忽略位置关系;在双线性初始化(b)中,我们分离初始位置,使它们均匀分布。如果没有偏移调制(b),偏移范围通常会重叠,因此在(c)中,我们局部约束偏移范围以减少重叠。

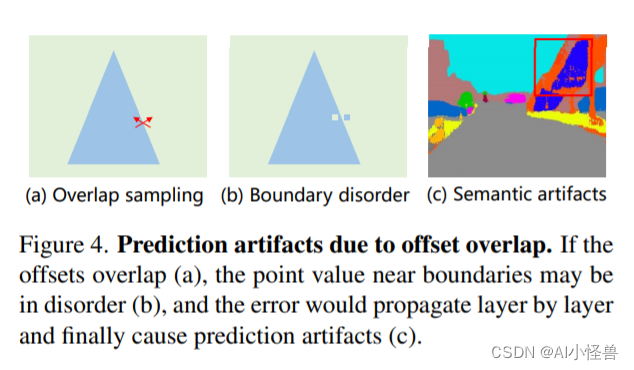

图4。由于偏移重叠造成的预测伪影。如果偏移量重叠(a),边界附近的点值可能是无序的(b),误差会逐层传播,最终导致预测伪影(c)。

添加图片注释,不超过 140 字(可选)

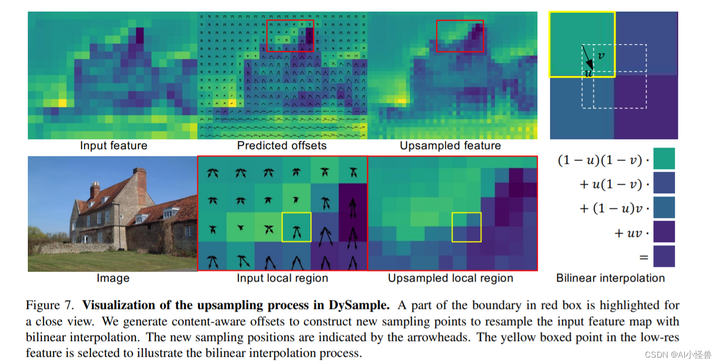

图7。DySample中上采样过程的可视化。红色框中的部分边界被高亮显示,以便近距离观察。我们生成内容感知偏移来构造新的采样点,用双线性插值对输入特征映射进行重采样。新的采样位置由箭头表示。选择低分辨率特征中的黄色框点来说明双线性插值过程。

3.DySample如何加入到YOLOv13

3.1新建ultralytics/nn/updownsample/dysample.py

import torch

import torch.nn as nn

import torch.nn.functional as F

from mmengine.model import constant_init, normal_init

#from ultralytics.nn.modules import (Conv, C3, Bottleneck, C2f)

class DySample(nn.Module):

def __init__(self, in_channels, scale=2, style='lp', groups=4, dyscope=False):

super().__init__()

self.scale = scale

self.style = style

self.groups = groups

assert style in ['lp', 'pl']

if style == 'pl':

assert in_channels >= scale ** 2 and in_channels % scale ** 2 == 0

assert in_channels >= groups and in_channels % groups == 0

if style == 'pl':

in_channels = in_channels // scale ** 2

out_channels = 2 * groups

else:

out_channels = 2 * groups * scale ** 2

self.offset = nn.Conv2d(in_channels, out_channels, 1)

normal_init(self.offset, std=0.001)

if dyscope:

self.scope = nn.Conv2d(in_channels, out_channels, 1)

constant_init(self.scope, val=0.)

self.register_buffer('init_pos', self._init_pos())

def _init_pos(self):

h = torch.arange((-self.scale + 1) / 2, (self.scale - 1) / 2 + 1) / self.scale

return torch.stack(torch.meshgrid([h, h])).transpose(1, 2).repeat(1, self.groups, 1).reshape(1, -1, 1, 1)

def sample(self, x, offset):

B, _, H, W = offset.shape

offset = offset.view(B, 2, -1, H, W)

coords_h = torch.arange(H) + 0.5

coords_w = torch.arange(W) + 0.5

coords = torch.stack(torch.meshgrid([coords_w, coords_h])

).transpose(1, 2).unsqueeze(1).unsqueeze(0).type(x.dtype).to(x.device)

normalizer = torch.tensor([W, H], dtype=x.dtype, device=x.device).view(1, 2, 1, 1, 1)

coords = 2 * (coords + offset) / normalizer - 1

coords = F.pixel_shuffle(coords.view(B, -1, H, W), self.scale).view(

B, 2, -1, self.scale * H, self.scale * W).permute(0, 2, 3, 4, 1).contiguous().flatten(0, 1)

return F.grid_sample(x.reshape(B * self.groups, -1, H, W), coords, mode='bilinear',

align_corners=False, padding_mode="border").view(B, -1, self.scale * H, self.scale * W)

def forward_lp(self, x):

if hasattr(self, 'scope'):

offset = self.offset(x) * self.scope(x).sigmoid() * 0.5 + self.init_pos

else:

offset = self.offset(x) * 0.25 + self.init_pos

return self.sample(x, offset)

def forward_pl(self, x):

x_ = F.pixel_shuffle(x, self.scale)

if hasattr(self, 'scope'):

offset = F.pixel_unshuffle(self.offset(x_) * self.scope(x_).sigmoid(), self.scale) * 0.5 + self.init_pos

else:

offset = F.pixel_unshuffle(self.offset(x_), self.scale) * 0.25 + self.init_pos

return self.sample(x, offset)

def forward(self, x):

if self.style == 'pl':

return self.forward_pl(x)

return self.forward_lp(x)3.2 修改tasks.py

详见源码

https://blog.csdn.net/m0_63774211/article/details/1491750923.3 yolo13-DySample.yaml

nc: 80 # number of classes

scales: # model compound scaling constants, i.e. 'model=yolov13n.yaml' will call yolov13.yaml with scale 'n'

# [depth, width, max_channels]

n: [0.50, 0.25, 1024] # Nano

s: [0.50, 0.50, 1024] # Small

l: [1.00, 1.00, 512] # Large

x: [1.00, 1.50, 512] # Extra Large

backbone:

# [from, repeats, module, args]

- [-1, 1, Conv, [64, 3, 2]] # 0-P1/2

- [-1, 1, Conv, [128, 3, 2, 1, 2]] # 1-P2/4

- [-1, 2, DSC3k2, [256, False, 0.25]]

- [-1, 1, Conv, [256, 3, 2, 1, 4]] # 3-P3/8

- [-1, 2, DSC3k2, [512, False, 0.25]]

- [-1, 1, DSConv, [512, 3, 2]] # 5-P4/16

- [-1, 4, A2C2f, [512, True, 4]]

- [-1, 1, DSConv, [1024, 3, 2]] # 7-P5/32

- [-1, 4, A2C2f, [1024, True, 1]] # 8

head:

- [[4, 6, 8], 2, HyperACE, [512, 8, True, True, 0.5, 1, "both"]]

- [-1, 1, DySample, [2, 'lp']]

- [ 9, 1, DownsampleConv, []]

- [[6, 9], 1, FullPAD_Tunnel, []] #12

- [[4, 10], 1, FullPAD_Tunnel, []] #13

- [[8, 11], 1, FullPAD_Tunnel, []] #14

- [-1, 1, DySample, [2, 'lp']]

- [[-1, 12], 1, Concat, [1]] # cat backbone P4

- [-1, 2, DSC3k2, [512, True]] # 17

- [[-1, 9], 1, FullPAD_Tunnel, []] #18

- [17, 1, DySample, [2, 'lp']]

- [[-1, 13], 1, Concat, [1]] # cat backbone P3

- [-1, 2, DSC3k2, [256, True]] # 21

- [10, 1, Conv, [256, 1, 1]]

- [[21, 22], 1, FullPAD_Tunnel, []] #23

- [-1, 1, Conv, [256, 3, 2]]

- [[-1, 18], 1, Concat, [1]] # cat head P4

- [-1, 2, DSC3k2, [512, True]] # 26

- [[-1, 9], 1, FullPAD_Tunnel, []]

- [26, 1, Conv, [512, 3, 2]]

- [[-1, 14], 1, Concat, [1]] # cat head P5

- [-1, 2, DSC3k2, [1024,True]] # 30 (P5/32-large)

- [[-1, 11], 1, FullPAD_Tunnel, []]

- [[23, 27, 31], 1, Detect, [nc]] # Detect(P3, P4, P5)

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录