腾讯云高性能应用服务HAI搭建开源大模型DeepSeek+AnythingLLM实现企业知识库

原创腾讯云高性能应用服务HAI搭建开源大模型DeepSeek+AnythingLLM实现企业知识库

原创

星哥玩云

修改于 2025-03-21 15:27:59

修改于 2025-03-21 15:27:59

腾讯云高性能应用服务HAI

高性能应用服务(Hyper Application Inventor,HAI)是一款面向 AI 、科学计算的 GPU 应用服务产品,提供即插即用的澎湃算力与常见环境,助力中小企业及开发者快速部署 LLM。

对于初步探索AIGC的用户,可以选择基础型算力套餐,以较低的成本进行尝试。腾讯云高性能应用服务HAI-CPU支持关机不计费,用户可以根据自身使用需求动态开关机,节省成本。此外,通过选择合适的算力套餐和购买时长,也可以进一步降低使用成本。

今天我们就来学习一下如何快速使用腾讯云高性能应用服务HAI搭建开源大模型DeepSeek+AnythingLLM实现企业知识库。

1元特惠

新老用户专享特惠,超值现金券活动火热进行中!基础型算力折后0.79元/时起。点击:https://cloud.tencent.com/act/pro/hai

image-20250321115503911

点击购买,即可一元使用HAI

image-20250321115600291

购买完了就可以抵扣8小时的GPU基础型算力。

购买HAI

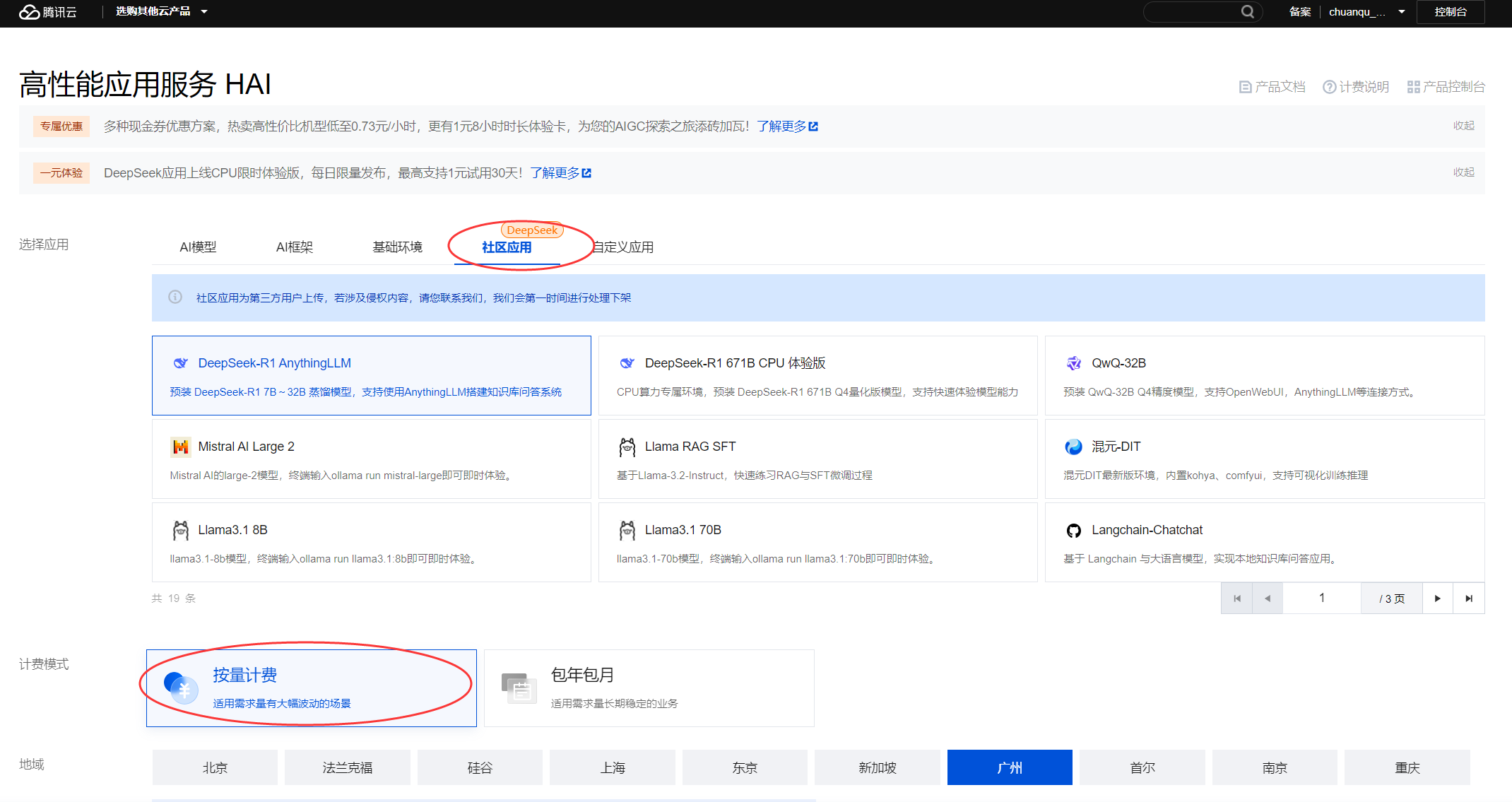

1.应用选择

这里选择社区应用,deepseek-R1 AnythingLLM

image-20250321141435398

2.计费模式

计费模式选择按量计费,适用需求量有大幅波动的场景,我这里选择按量计费

适用需求量长期稳定的业务

3.地域

地域我这里选择广州,可以根据实际情况来选择

4.算力方案

我这里选择GPU基础型

5.实例名称

随便取个名称即可,DeepSeek-r1

image-20250321141700726

其他默认即可。

6.创建应用

实例创建中,这里等待几分钟成功之后,点击算力连接,再点击AnytingLLM

image-20250321141839763

连接deepseek

点击AnytingLLM浏览器会弹出IP+端口进入AnythingLLM页面,如下图

image-20250321142612300

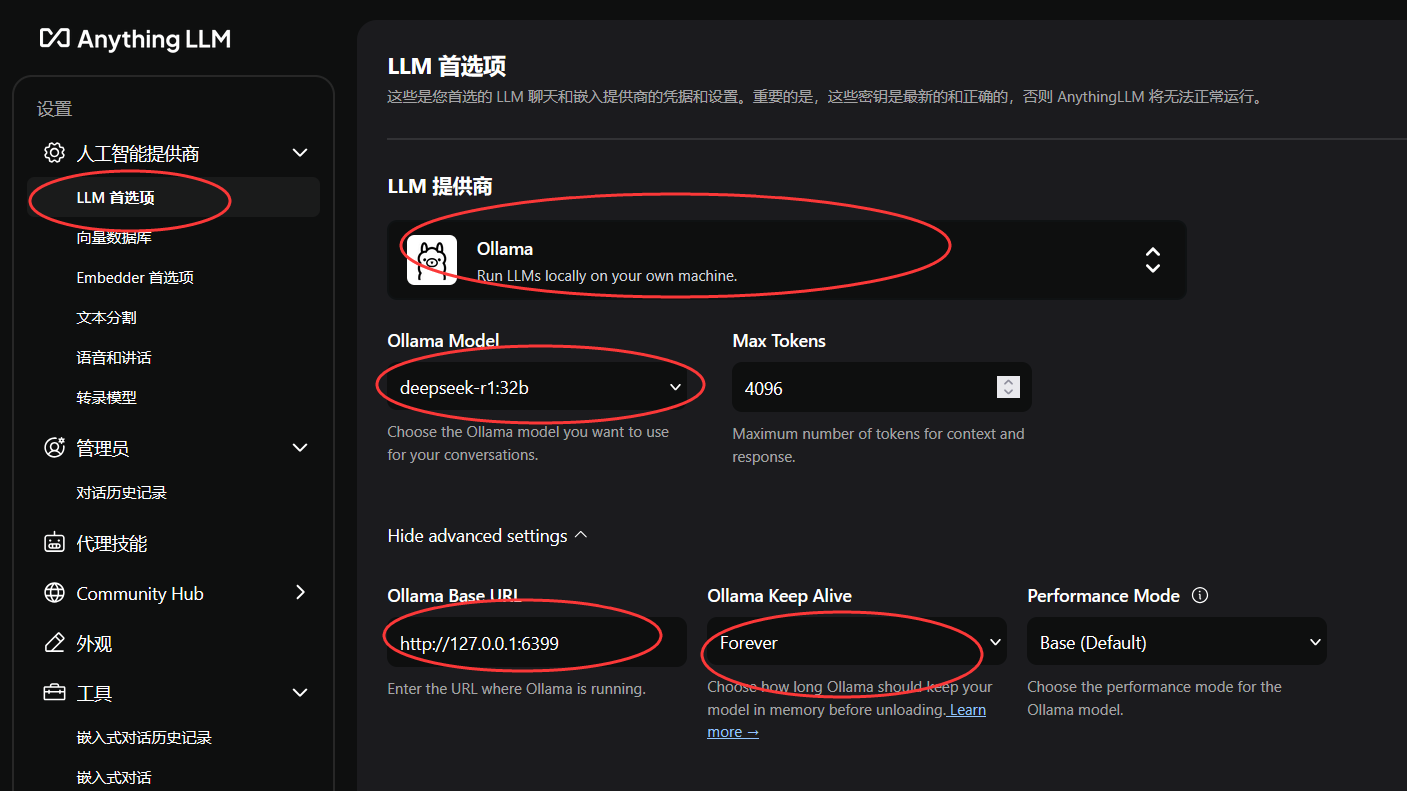

1.配置LLM首选项

在浏览器左下角点击设置,再点击LLM首选项

将“LLM提供商”选择为“Ollama” 将“Ollama Base url”修改为:该台HAI实例的公网ip:6399,如 http://127.0.0.1(此步骤为最关键的一步) 在“Ollama Model”处选择需要使用的模型,如“deepseek-r1:32b” 在“Ollama keep alive”处按需配置保活时长,本最佳实践将其配置为永久。(模型在每次超过保活时长后会被移除,再次使用时需重新载入模型,耗时较久,若不存在频繁切换模型诉求,建议将保活时长尽可能调大)

image-20250321143051678

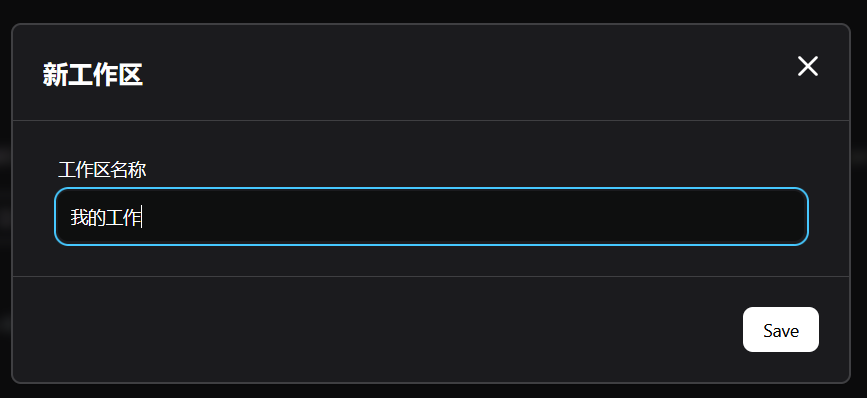

2.新建工作区

在AnythingLLM左侧点击,新工作区,随便写一个工作区的名字

image-20250321143143748

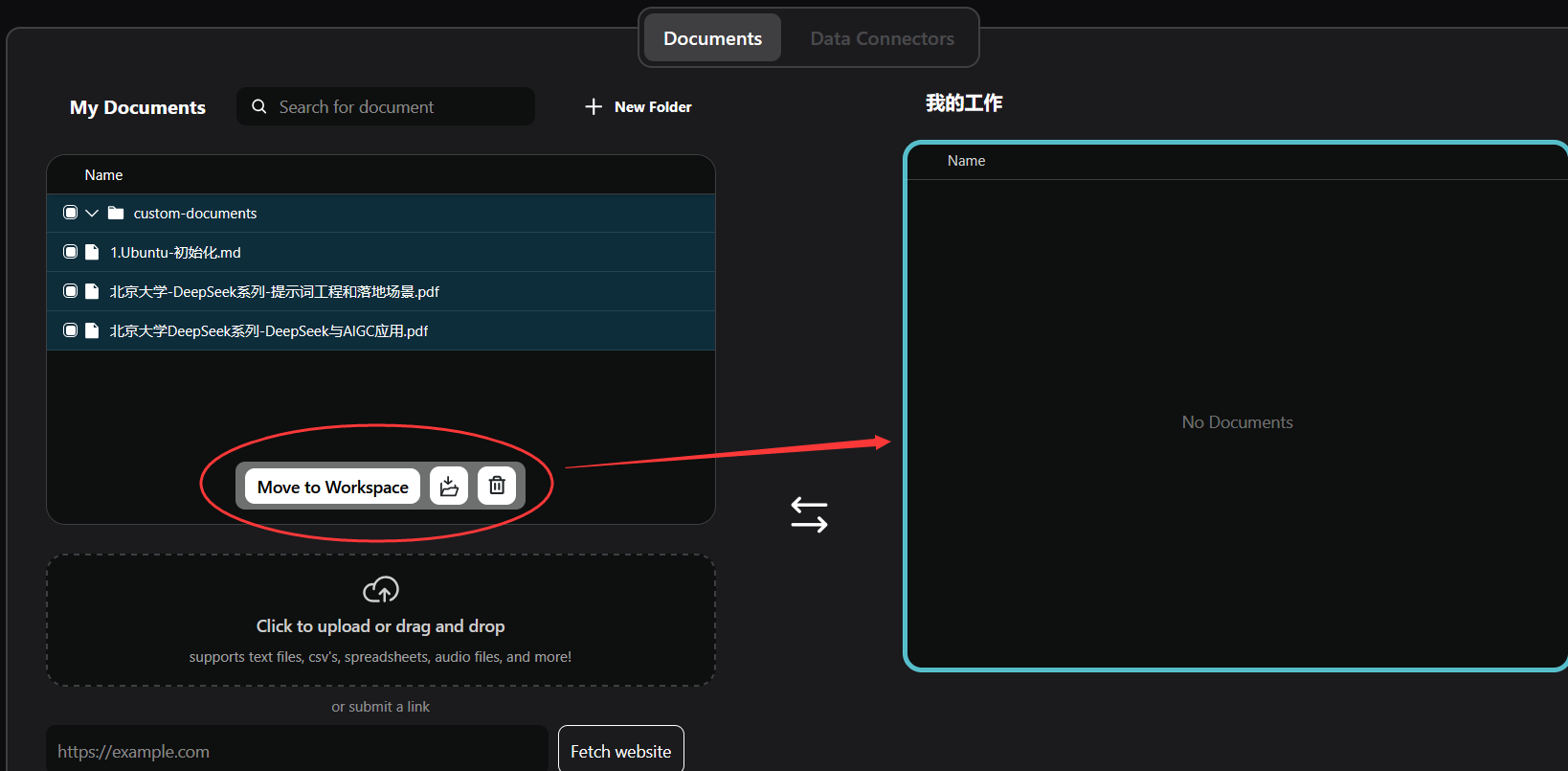

3.上传文件

配置完成后,回到项目页面,点击“upload a document”上传本地文件

把我们准备的工作文件“1.Ubuntu-初始化.md”等的文档上传上去

4.移动工作区

上传文件后,选中希望使用的文件,点击“move to workspace”将文件添加至项目。点击“save and embed”按钮,完成配置。

image-20250321143932662

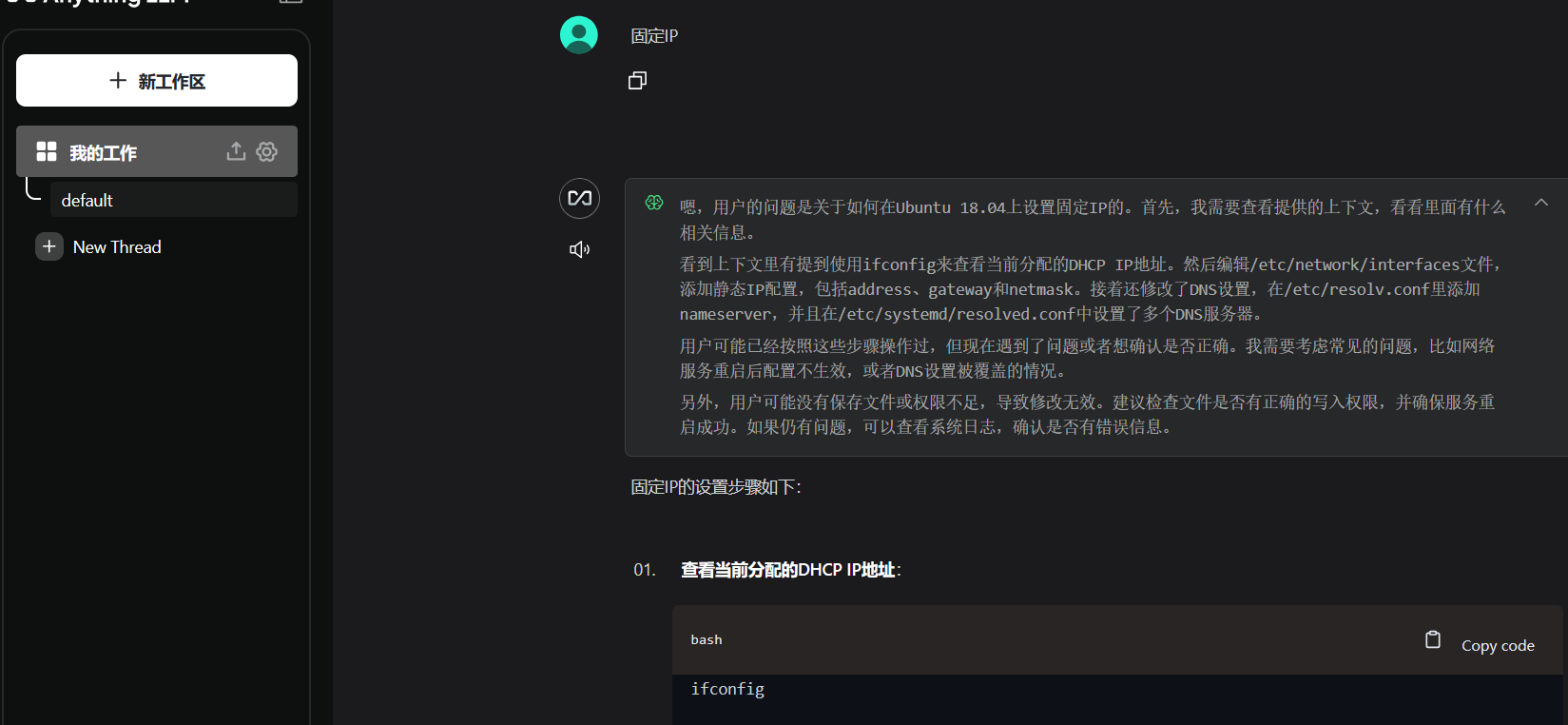

5.对话

您可直接与模型进行对话,模型会根据对话内容智能调用本地知识库内容。

本地知识库里面的“固定IP”

image-20250321144803854

最后

安全性

由于deepseek和AnythingLLM没有配置密码,所以其他人只要知道IP+端口都可以使用,如果是长期项目

image-20250321144740428

费用

因为HAI涉及到腾讯云费用的问题,我的1元套餐可以使用8小时,8小时以后不再使用一定要记得销毁,而不是关机,关机还会收费的。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录