EMNLP 2023 | 腾讯优图实验室3篇论文入选,含信息抽取、知识图谱编码等研究方向

EMNLP 2023 | 腾讯优图实验室3篇论文入选,含信息抽取、知识图谱编码等研究方向

小腾资讯君

发布于 2024-01-19 18:23:51

发布于 2024-01-19 18:23:51

近日,EMNLP 2023( Conference on Empirical Methods in Natural Language Processing)论文接收结果公布。本次会议共接收 4909 篇投稿,主会录用论文 1047 篇,录用率 21.3 %,高于2022年的20%。

EMNLP 作为人工智能/自然语言处理领域的顶级国际学术会议之一,通常由国际计算语言学会 ACL 组织每年举办一次。大会讨论的内容包含上下文学习、MBR算法、大模型攻击、信息抽取、机器翻译、文本生成、情感分析研究等众多细分领域。

今年,腾讯优图实验室共有3篇论文入选,内容涵盖视频字幕信息抽取、医学对话信息抽取、知识图谱编码等研究方向,展示了腾讯优图实验室在人工智能领域的技术能力和学术成果。

以下为腾讯优图实验室入选论文概览:

01

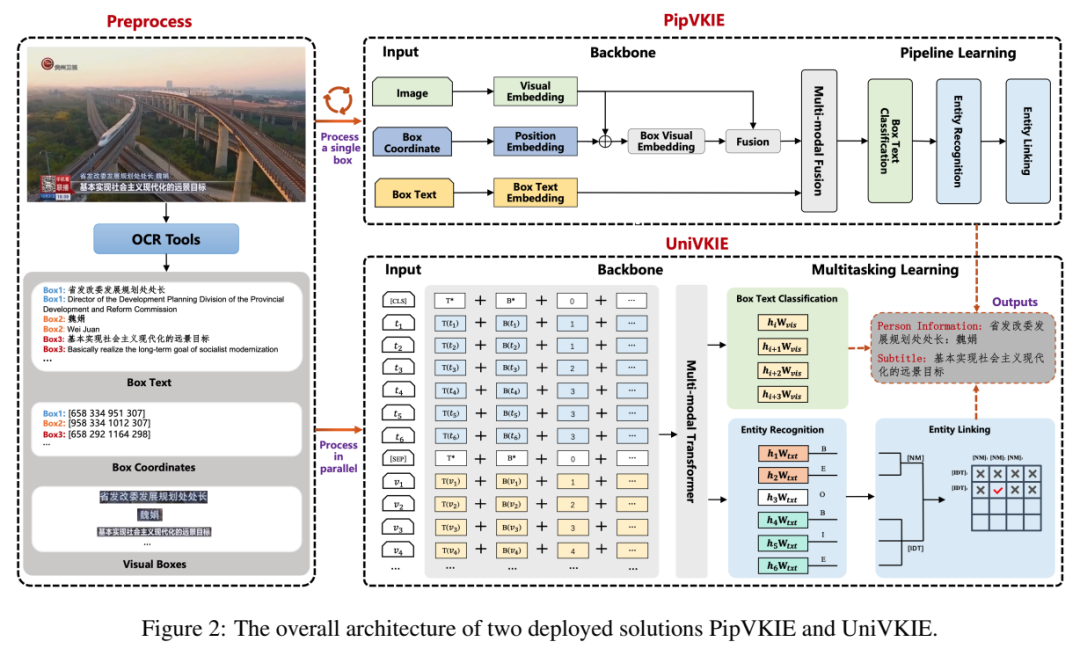

视频字幕文本的关键信息抽取

VKIE: The Application of Key Information Extraction on Video Text

SiyuAn, YeLiu(Nvidia), HaoyuanPeng(learnable AI), DiYin

在视频中提取结构化信息对于行业中的许多下游应用至关重要。在这篇论文中,我们定义了一个重要的任务,即从视频中的视觉文本提取层次化关键信息。为了完成这项任务,我们将其分解为四个子任务,并介绍了两种实现方案,分别称为PipVKIE和UniVKIE。PipVKIE按顺序在连续阶段完成这四个子任务,而UniVKIE通过将所有子任务统一到一个主干网络中进行了改进。PipVKIE和UniVKIE都利用了视觉、文本和坐标的多模态信息进行特征表示。在一个定义良好的数据集上进行的广泛实验表明,我们的解决方案可以实现显著的性能和高效的推理速度。

论文链接:

https://aclanthology.org/2023.emnlp-industry.51.pdf

02

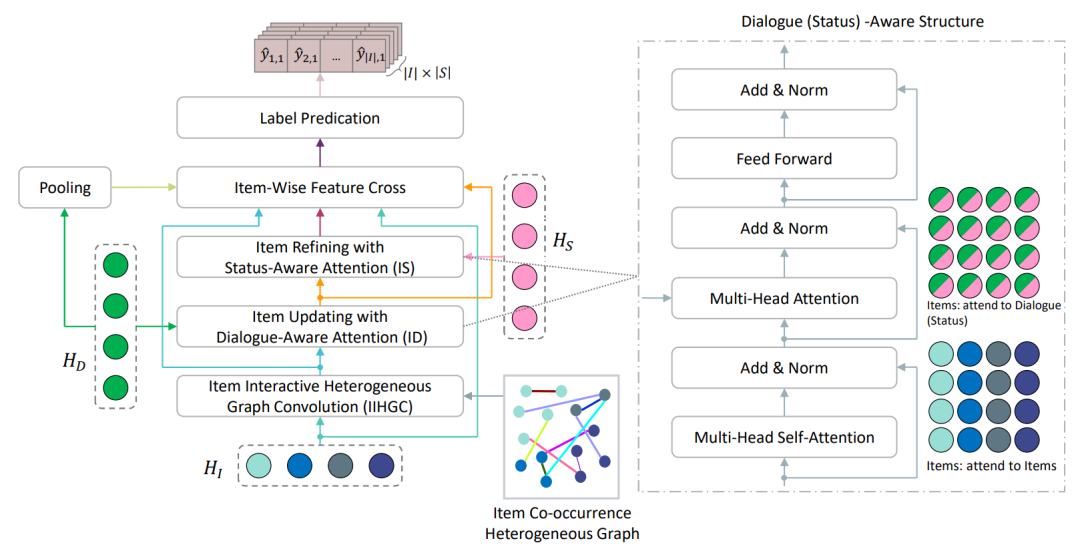

基于图和状态增强的医学对话信息抽取

Dialogue Medical Information Extraction with Medical-Item Graph and Dialogue-Status Enriched Representation

Lei Gao, Xinnan Zhang, Xian Wu, Shen Ge, Yefeng Zheng

多轮医患对话包含丰富的医学知识,如患者的症状,医生的诊断和建议的药物治疗。如果能够正确地挖掘和表示这些医学知识,那么这些知识可以为大范围的临床应用带来好处,包括诊断辅助和药物推荐。为了从自由文本对话中提取结构化知识,我们针对一个关键任务:对话医学信息提取(DMIE)。DMIE的目标是从对话中检测预定义的具有临床意义的医学项目(如症状,手术等)以及它们的状态(如阳性,阴性等)。现有的方法主要将DMIE视为一个多标签分类问题,并忽略了医学项目和状态之间的关系。与以前的方法不同,我们提出了一个异构图来模拟项目之间的关系。我们进一步提出了两个连续的基于注意力的模块,以丰富对话和状态的项目表示。通过这种方式,我们能够在DMIE任务中模拟医学项目和状态之间的关系。在公开的基准数据集上的实验结果显示,我们提出的模型超越了以前的工作,并达到了最先进的性能。

论文链接:

https://aclanthology.org/2023.findings-emnlp.888/

03

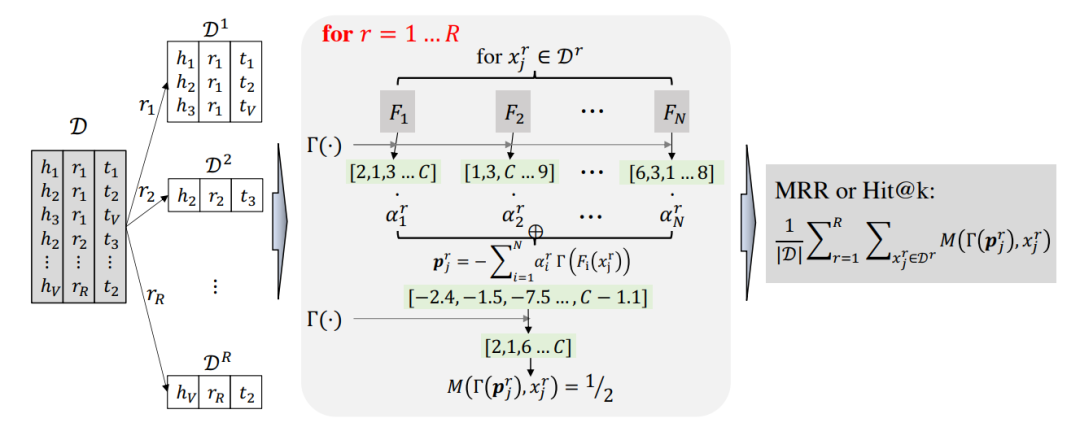

关系感知的知识图谱编码集成学习

Relation-aware Ensemble Learning for Knowledge Graph Embedding

Ling Yue (Tsinghua University), Yongqi Zhang(4 paradigm), Quanming Yao(Tsinghua University), Yong Li(Tsinghua University), Xian Wu, Ziheng Zhang, Zhenxi Lin, Yefeng Zheng

知识图谱(KG)嵌入是自然语言处理中的基本任务,已经提出了各种方法以不同的方式探索语义模式。在本文中,我们建议通过利用现有方法以关系感知的方式来学习集成。然而,使用关系感知集成来探索这些语义会导致比一般集成方法更大的搜索空间。为了解决这个问题,我们提出了一种分割-搜索-组合算法RelEns-DSC,该算法独立地搜索关系感知集成权重。这种算法具有与一般集成方法相同的计算成本,但性能要好得多。在基准数据集上的实验结果证明了所提方法在有效搜索关系感知集成权重和实现最先进嵌入性能方面的有效性。代码公开在https://github.com/LARS-research/RelEns。

论文链接:

https://aclanthology.org/2023.emnlp-main.1034/

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

本文系转载,前往查看

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读