从人形到具身智能:融合时代的机器人技术趋势与直播SDK感知方案

原创从人形到具身智能:融合时代的机器人技术趋势与直播SDK感知方案

原创

音视频牛哥

发布于 2025-08-15 11:10:11

发布于 2025-08-15 11:10:11

1. 前言

过去十年,机器人技术经历了从单一任务执行到多模态感知与自主决策的跨越式发展,其中人形机器人(Humanoid Robots)与具身智能机器人(Embodied Intelligent Robotics)成为最具代表性的两大技术方向。

- 人形机器人以类人外观、拟人化的运动与交互方式赢得公众关注,它不仅能在外形上贴近人类,还能借助现有的人类工具和基础设施直接开展工作。

- 具身智能机器人则强调“身体”在智能形成与演化中的关键作用,主张通过与环境的物理交互来驱动学习与认知,让机器人在多变的任务和场景中保持高适应性和自主性。

两者在形态、目标和技术路径上存在差异,但并非彼此割裂。实际上,人形机器人可以被视为具身智能理念的一种具象化落地,而具身智能的研究成果也为人形机器人赋予了更高层次的环境理解和任务适应能力。未来的机器人发展趋势,很可能是二者的深度融合:既拥有类人外观与自然交互能力,又具备灵活的环境适应性和持续学习的智能内核。

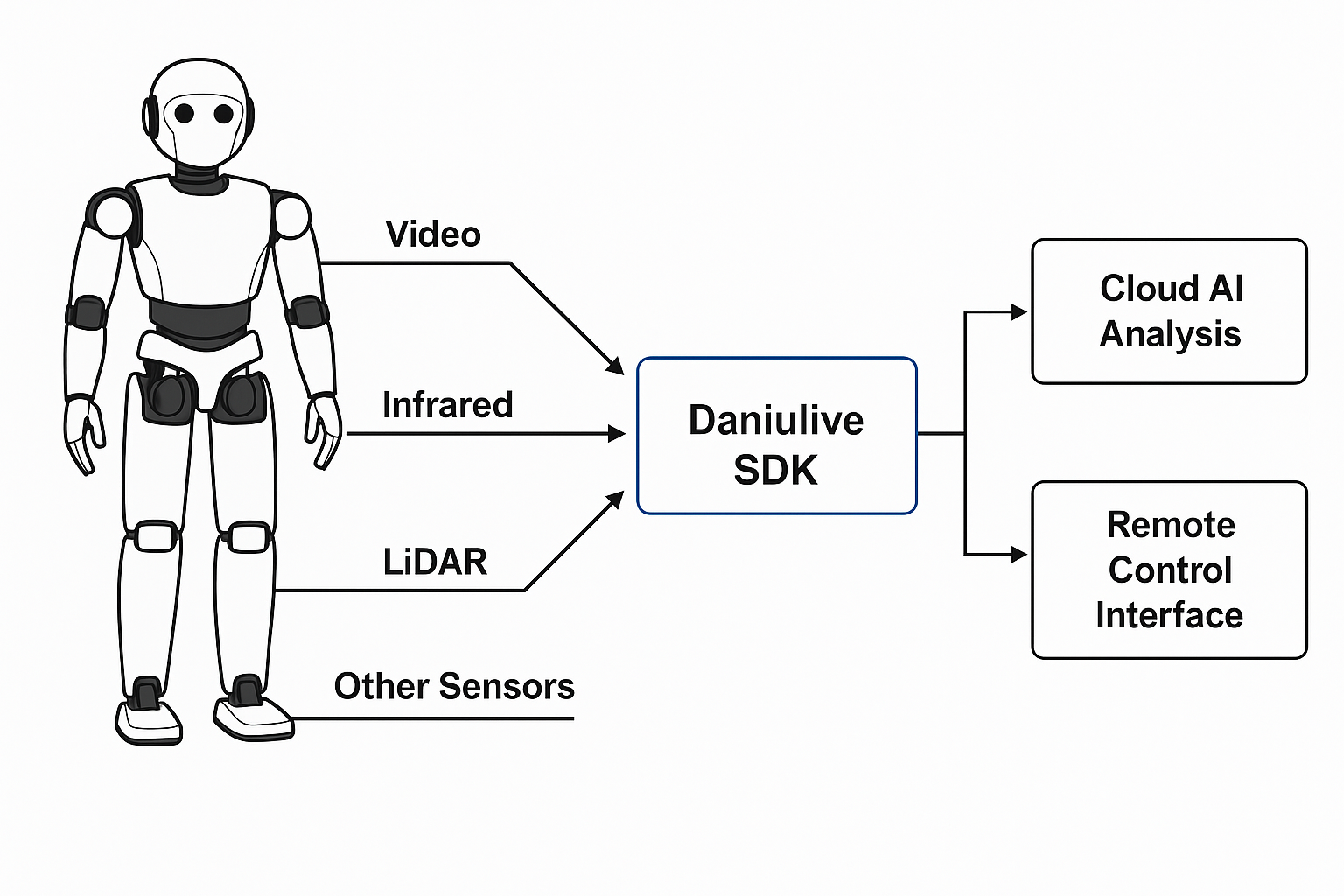

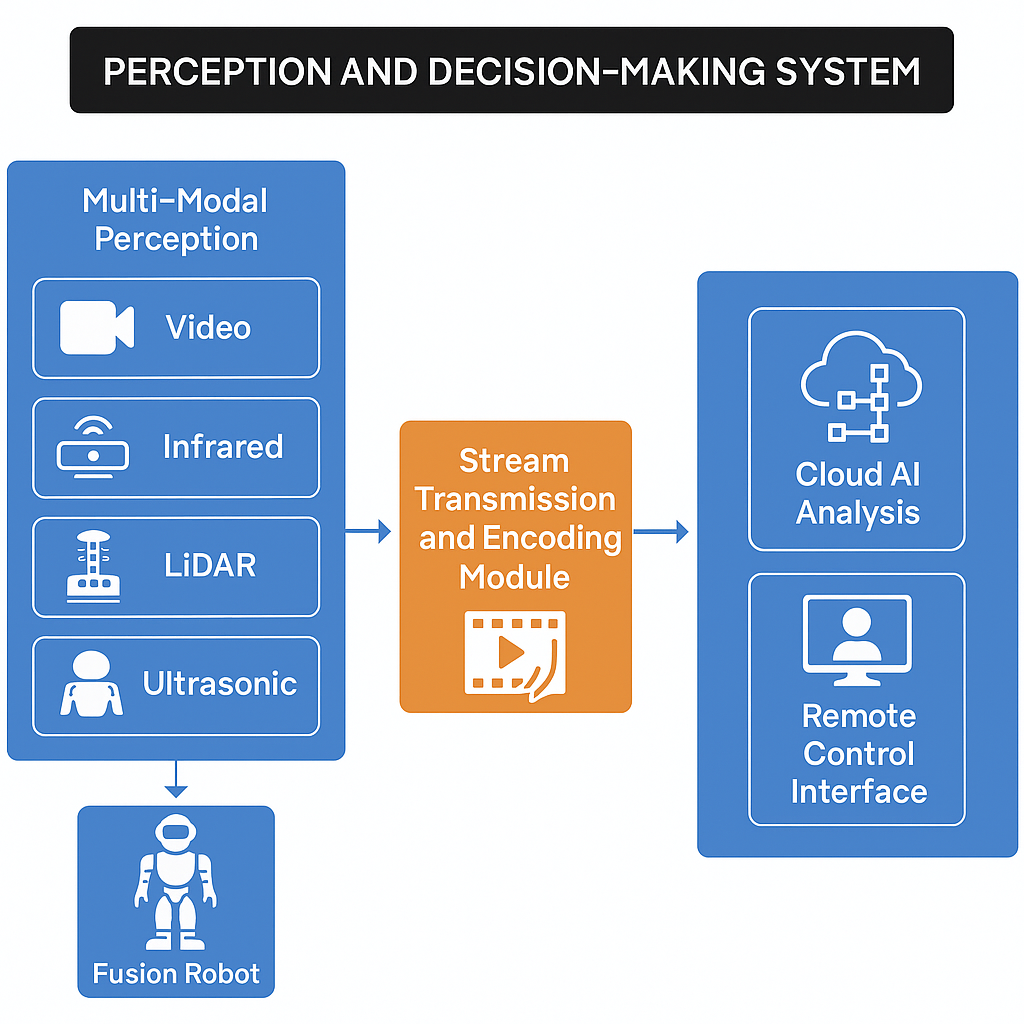

在这一演进过程中,实时视频感知与传输能力逐渐成为机器人智能的“神经系统”。无论是在人类环境中执行精细任务的人形机器人,还是在复杂地形自主探索的具身智能机器人,它们都需要以毫秒级延迟获取外部世界的多模态信息,并将这些信息实时传递给本地或远程的决策系统。 大牛直播SDK正是在这一环节中扮演关键角色——它提供跨平台、低延迟、高稳定性的视频采集与传输能力,支持多路视频流并发、弱网环境优化以及与AI感知模块的无缝对接,使机器人能够在医疗巡诊、工业巡检、远程协作、安防巡逻乃至灾害救援等多种场景下,保持稳定而高效的感知链路。

2. 人形机器人:形似人类,服务人类环境

在人类社会环境中,人形机器人(Humanoid Robots)因其类人的外观、比例和交互方式而被广泛关注。它们的设计灵感来源于人类自身的运动与感知系统,试图在硬件结构、感知能力和交互模式上尽可能接近人类,以便在无需大幅改造环境的情况下执行任务。

2.1 技术定义

人形机器人通常具备与人类相似的头部、躯干、双臂和双腿,能够进行双足行走与双手操作。这种形态不仅是为了外观上的亲和力,更是为了兼容人类设计的基础设施(如楼梯、门把手、工具等),从而降低适配成本。

2.2 核心目标

- 模仿人类运动与行为

- 通过高精度的关节驱动与控制系统,实现类似人类的步态、手部抓取与精细操作。

- 融入人类环境

- 无需对环境进行大规模改造即可执行任务,尤其适合家庭、办公室、医疗机构等场景。

- 提升人机交互的自然性

- 通过类人的面部表情、肢体语言和语音交互,降低人类的学习成本与心理障碍。

2.3 关键技术特征

- 形态相似性:外观和比例接近人类,便于直观理解其动作意图。

- 双足行走与动态平衡:利用陀螺仪、加速度计、力传感器等实现稳定行走和姿态调整。

- 多模态感知:整合视觉、听觉、触觉等传感器,形成对环境的综合感知能力。

- 高自由度机械结构:在关节数、旋转范围和力矩输出上接近人类水平。

2.4 优势与挑战

- 优势

- 易于被人类接受,具有天然的社会亲和力。

- 可直接使用人类工具和设施,减少环境改造成本。

- 在医疗、教育、商业服务等领域拥有广阔的应用前景。

- 挑战

- 机械与控制系统极其复杂,研发成本与制造成本高昂。

- 双足行走在复杂地形上的稳定性仍是难题。

- 能量效率较低,不利于长时间自主运行。

在这一阶段,虽然人形机器人在形态和交互上已经接近人类,但在智能水平、适应性和学习能力方面仍受限。如果说人形机器人解决了“看起来像人、动起来像人”的问题,那么下一步的关键,就是让它们具备“像人一样感知和思考”的能力,这也正是具身智能机器人理念的重要切入点。

3. 具身智能机器人:以身体为载体的智能进化

与人形机器人强调外观与形态不同,具身智能机器人(Embodied Intelligent Robotics)更关注的是“身体”在智能形成与演化中的核心作用。它的理论基础源于认知科学和机器人学的交叉研究,即智能不仅存在于算法和计算单元中,还深深依赖于机器人身体与环境的物理交互。

3.1 技术定义

具身智能机器人可以拥有多种形态:双足、四足、轮式、爬行、飞行甚至软体结构,并不局限于人类的形态。它们通过与环境的持续交互,在不断感知、行动和反馈中构建对世界的认知模型,从而具备更高的适应性和自主性。

3.2 核心目标

- 通过交互学习

- 在环境中进行试探、探索与反馈修正,通过强化学习、模仿学习等方式提升技能与策略。

- 多环境适应

- 无论是在平坦道路、崎岖山地还是低光环境,都能保持稳定运行。

- 任务自主化

- 能够在未知或动态变化的场景中自主规划路径、执行任务,并在出现意外情况时调整策略。

3.3 关键技术特征

- 身体驱动智能:将机械结构、传感系统与控制算法紧密耦合,让身体成为智能的“传感器”和“执行器”。

- 感知-行动循环(Perception-Action Loop):实时采集环境信息 → 做出决策 → 执行动作 → 再次感知反馈。

- 形态灵活:根据任务需求选择最优的运动方式和结构,例如救援场景用四足机器人、农业巡检用轮式机器人、空中勘察用无人机。

- 多模态融合:将视觉、激光雷达、IMU、触觉等多种传感信息进行融合处理,形成更稳定的环境理解。

3.4 优势与挑战

- 优势

- 适应性强,能够应对复杂多变的环境和任务。

- 形态可定制化,根据任务需求优化运动效率。

- 学习过程接近人类与动物,更具泛化能力。

- 挑战

- 控制与算法复杂度高,对计算资源和感知能力要求大。

- 需要高质量的环境感知链路,否则决策易受干扰。

3.5 与实时视频感知的结合

在具身智能机器人中,感知系统是智能进化的基础,而视频传输是感知链路的核心部分之一:

- 视频即认知输入:高分辨率、多视角的视频数据不仅为机器人自身的视觉识别算法提供原始信息,还可传回远程控制中心进行人机协作决策。

- 低延迟的重要性:在动态环境(如灾害救援、工业巡检)中,毫秒级延迟的视频回传决定了机器人是否能在关键时刻做出正确响应。

- 多路视频与多模态融合:具身机器人往往同时采集可见光、红外、深度信息,需要一套稳定的多流管理与传输方案。

大牛直播SDK在这一环节具有天然优势:

- 支持RTSP、RTMP等主流低延迟协议,实现整体毫秒级(100-250ms)的视频回传。

- 可同时接入多路摄像头并进行稳定传输,方便多模态感知。

- 具备跨平台能力(Windows、Linux、Android、iOS、Unity3D),方便机器人在不同硬件与操作系统间快速部署。

- 内置弱网优化机制,保障视频链路在室外、远程等复杂网络环境下依旧稳定。

正因如此,大牛直播SDK不仅是具身智能机器人“看得见”的眼睛,更是它在复杂任务中保持高效感知与决策的“神经通道”。

4. 人形机器人 vs. 具身智能机器人:对比分析

尽管人形机器人与具身智能机器人都在不断推动机器人技术的前沿,但它们在形态设计、智能理念、技术实现和应用场景上有着显著差异。下表汇总了两者的主要比较维度:

比较维度 | 人形机器人(Humanoid Robots) | 具身智能机器人(Embodied Intelligent Robotics) |

|---|---|---|

形态设计 | 高度模仿人类外观与比例 | 形态多样化:四足、轮式、爬行、飞行、软体等 |

主要目标 | 在人类环境中执行任务,提升社会接受度 | 通过身体与环境的交互驱动学习与适应 |

身体作用 | 作为任务执行的工具,形态优先 | 智能发展的基础,感知与行动的核心载体 |

复杂性 | 机械与控制系统高度复杂 | 复杂性取决于形态与任务 |

能量效率 | 较低(尤其是双足行走) | 视形态与任务而定,可更高效 |

核心技术 | 双足行走、类人操作手、面部表情与语音交互 | 感知-行动循环、多模态融合、强化学习 |

应用领域 | 医疗陪护、教育、商业服务、娱乐 | 工业巡检、灾害救援、农业自动化、探索任务 |

社会接受度 | 高(形态亲和) | 取决于形态(非人形可能较低) |

4.1 差异与互补关系

- 差异性

- 人形机器人在“融入人类环境”的适应性上有天然优势,但在智能灵活性和环境适应方面存在瓶颈。

- 具身智能机器人在应对复杂任务与未知环境时表现更优,但社会接受度和人机交互的自然性可能不及人形机器人。

- 互补性

- 如果将具身智能的感知与学习能力引入人形机器人,其不仅能像人类一样工作,还能在变化环境中自主调整策略。

- 将人形外观与具身智能算法结合,可以在医疗、教育、公共服务等场景实现更自然的交互,同时保持环境适应性与任务多样性。

- 融合趋势

- 未来的机器人形态很可能是“类人外形 + 具身智能内核”:

- 外部形态满足人类的情感和社交需求

- 内部智能具备环境感知、自主学习和跨任务迁移能力

- 未来的机器人形态很可能是“类人外形 + 具身智能内核”:

4.2 实例分析:从差异到融合

- 医疗巡诊场景:

- 人形机器人:可自然进入病房与病患对话,完成药物递送与简单检查

- 具身智能机器人:可在医院复杂走廊中自主导航,避让障碍物并根据患者位置调整路线

- 融合方案:类人外观 + 自主导航 + 多模态感知,提升巡诊效率与患者体验

- 工业巡检场景:

- 人形机器人:在厂区内检查人工设备、读取仪表盘

- 具身智能机器人:在高温、粉尘、狭窄等特殊环境下灵活移动

- 融合方案:通过具身智能的环境适应能力结合人形机器人的工具操作能力,实现全覆盖巡检

4.3 视频感知在融合中的关键作用

无论是类人外观还是多样化形态,机器人都需要实时感知外部环境,而视频传输是感知链路的核心。在融合形态下,这一需求更为迫切:

- 多视角同步:头部摄像头、胸部摄像头、全景摄像头同时工作

- 多模态输入:视频流与红外、深度数据融合

- 低延迟响应:确保决策系统或远程操作者在毫秒级别做出反应

大牛直播SDK在融合方案中,既能为人形机器人提供类人视角的实时回传,也能为具身智能机器人提供多路视频与弱网环境下的稳定传输,让“感知-决策-执行”的闭环更加高效和可靠。

5. 融合时代的机器人与大牛直播SDK的场景结合

当人形机器人的类人外观与自然交互能力,结合具身智能机器人的环境适应与自主学习能力,就诞生了新一代的“融合型机器人”。这类机器人不仅能够在人类环境中高效工作,还能在非结构化、复杂、多变的环境中保持高执行力。而要让这种能力在现实世界中真正发挥作用,稳定、高效的实时视频感知链路是必不可少的。

大牛直播SDK作为跨平台、超低延迟(100-250ms)、高稳定性的视频传输引擎,能够为融合型机器人提供从“感知”到“决策”再到“执行”的核心数据通道。下面从典型应用场景出发,分析其技术价值。

5.1 医疗巡诊与远程诊疗

场景需求:

- 机器人在医院病房、隔离区、手术辅助区巡诊

- 医生远程实时观察患者状态并进行语音/视频交互

- 多模态信息融合(可见光+红外热成像)用于病患体温监测与康复评估

SDK价值:

- 低延迟视频回传:保障医生与患者几乎实时交流

- 多路视频支持:同步传输高清摄像头与红外摄像头画面

- 跨平台部署:可在机器人端(Android/Linux)与医生端(Windows/iOS)无缝运行

- 弱网优化:即使在医院地下室或无线信号弱的区域,也能稳定传输画面

5.2 工业巡检与设备维护

场景需求:

- 机器人在工厂、变电站、矿区等环境中巡检设备状态

- 识别仪表读数、检测设备故障点

- 遇到异常时将视频回传至控制中心,由人工判断或AI自动识别

SDK价值:

- 4K高清传输:保障细节可见性,方便识别小型缺陷或设备异常

- 多协议兼容:支持RTSP、RTMP推流到工业监控平台

- 稳定性强:长时间连续运行仍能保持流畅

- 边缘计算适配:可与AI模块协同工作,实现本地视频分析与云端审核的混合模式

5.3 智能安防与巡逻

场景需求:

- 机器人在写字楼、园区、仓储区等区域进行巡逻

- 实时回传视频并进行人脸识别、异常行为检测

- 与安防中心进行实时联动

SDK价值:

- 毫秒级延迟:安防事件发生时,视频画面与报警信号同步送达

- 多路流分发:可同时推送给安防中心与移动终端

- 与AI识别结合:支持将视频流直接送入AI分析模块,进行实时预警

5.4 灾害救援与探索作业

场景需求:

- 机器人在地震、火灾、矿难、海底等高危环境中执行任务

- 多传感器融合(视频、热成像、深度信息)定位被困人员或障碍物

- 远程操控与自主探索结合

SDK价值:

- 复杂环境适应性:在高温、湿度、灰尘、弱网等环境中保持稳定视频链路

- 多模态视频传输:支持不同类型传感器的视频源统一管理与推流

- 跨平台远程控制:救援指挥中心可在多种操作系统上实时接收与操控

5.5 技术融合架构示例

融合型机器人与大牛直播SDK在视频感知链路上的典型架构如下:

[多模态传感器] → [机器人视频采集模块] → [大牛直播SDK编码与推流] →

[网络传输(RTSP/RTMP)] → [控制中心/云端AI分析] → [决策与控制反馈]

这种架构确保了机器人无论在何种环境下,都能将高质量、低延迟的视频数据传递给决策端,实现闭环控制。

6. 未来展望:融合形态 + 实时视频感知的行业价值

随着人工智能、机器人学和通信技术的持续融合,人形机器人与具身智能机器人的界限将逐渐模糊,二者将走向深度整合。外观的类人化不仅是为了社会接受度,更是为了降低环境适配成本;而具身智能的引入,将赋予机器人在未知环境中自主探索、持续学习和任务迁移的能力。

在这种趋势下,实时视频感知的重要性将进一步提升,成为机器人智能体系中不可或缺的“信息动脉”:

- 数据驱动智能演化:视频数据是视觉AI的核心训练与推理素材,高质量、低延迟的视频链路能显著提升机器人环境理解的速度与精度。

- 人机协作的桥梁:无论是远程医疗、工业巡检还是灾害救援,实时视频是人类获取现场信息、下达决策指令的直接通道。

- 多模态融合的基石:视频与激光雷达、IMU、声学传感等数据的同步传输,为多模态感知提供统一时间基准。

在这一背景下,大牛直播SDK的价值不仅仅在于提供视频传输能力,更在于赋能整个机器人智能生态:

- 让机器人“看得更清”——高分辨率与稳定帧率保障视觉信息质量

- 让机器人“反应更快”——低延迟传输缩短感知到执行的时间链路

- 让机器人“适应更多”——跨平台与弱网优化为各种部署环境提供兼容性与稳定性

可以预见,未来的融合型机器人将具备以下特征:

- 外观类人化:适配人类环境和交互需求

- 智能具身化:通过身体与环境的交互持续进化

- 感知全景化:多视角、多模态实时视频融合

- 协作云端化:与云端AI和远程操作系统无缝衔接

- 应用普及化:从工业、医疗、安防扩展到家庭、教育、公共服务

当这些能力汇聚到一个系统中,我们将看到机器人不再只是执行预设任务的机械装置,而是能够与环境和人类建立深层次协作关系的智能伙伴。而在这一进化路径上,像大牛直播SDK这样稳定、低延迟的视频感知链路技术,将成为推动机器人走向更高智能水平的核心引擎之一。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

登录后参与评论

推荐阅读

目录