paddle深度学习10 模型准备

原创paddle深度学习10 模型准备

原创用户11104668

发布于 2025-01-16 09:28:01

发布于 2025-01-16 09:28:01

在深度学习中,模型训练是一个迭代的过程,通过不断调整模型参数,使其在给定任务上的表现逐渐提升。本节将详细介绍模型训练的基本流程,包括模型定义、损失函数和优化器的选择,以及训练循环的各个步骤。

【定义模型】

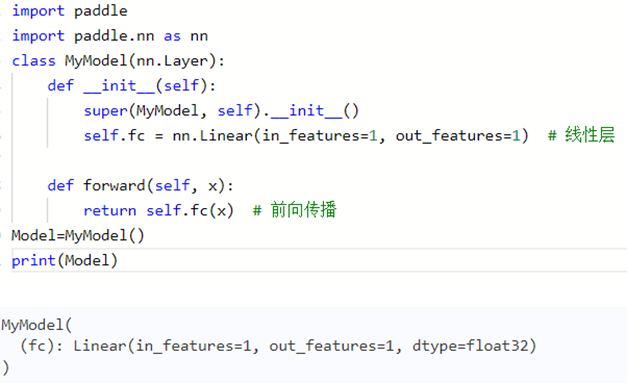

在PaddlePaddle中,模型通常通过继承 paddle.nn.Layer 类来定义。可以在这个类中定义模型的结构,比如全连接层、卷积层、循环神经网络层等。以下是一个简单的线性回归模型示例:

import paddle

import paddle.nn as nn

class MyModel(nn.Layer):

def __init__(self):

super(MyModel, self).__init__()

self.fc = nn.Linear(in_features=1, out_features=1) # 线性层

def forward(self, x):

return self.fc(x) # 前向传播

Model=MyModel()

print(Model)

【定义损失函数】

损失函数用于衡量模型预测值与真实值之间的差距。常见的损失函数包括均方误差(MSE)用于回归任务,交叉熵损失(Cross-Entropy Loss)用于分类任务。PaddlePaddle提供了多种内置的损失函数,可以直接使用。

loss_fn = nn.MSELoss() # 均方误差损失函数

【优化器】

优化器用于更新模型参数,以最小化损失函数。常见的优化器包括随机梯度下降(SGD)、Adam等。PaddlePaddle提供了多种优化器,你可以根据任务需求选择合适的优化器:

optimizer = paddle.optimizer.SGD(learning_rate=0.01, parameters=model.parameters()) # SGD优化器

【训练循环】

训练循环是模型训练的核心部分,通常包括以下几个步骤:

1)前向传播

将输入数据传入模型,得到模型的预测输出。

y_pred = model(x) # x是输入数据,y_pred是模型预测输出

2)计算损失

使用损失函数计算模型预测值与真实值之间的差距。

loss = loss_fn(y_pred, y) # y是真实标签

3)反向传播

通过反向传播算法计算损失函数对模型参数的梯度。

loss.backward() # 反向传播,计算梯度

4)参数更新

使用优化器更新模型参数,以减小损失。

optimizer.step() # 更新模型参数

optimizer.clear_grad() # 清空梯度,为下一次迭代做准备

5)重复迭代

以上步骤会重复进行多次,直到模型在训练数据上的表现达到预期。

模型评估指标

在训练过程中,除了损失函数外,我们还需要使用一些评估指标来衡量模型的性能。常见的评估指标包括准确率、精确率、召回率、F1 Score等

准确率(Accuracy)用于分类任务,表示模型预测正确的样本占总样本的比例。

correct = (y_pred.argmax(axis=1) == y).astype('float32').sum() # 计算正确预测的样本数

accuracy = correct / len(y) # 计算准确率

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

原创声明:本文系作者授权腾讯云开发者社区发表,未经许可,不得转载。

如有侵权,请联系 cloudcommunity@tencent.com 删除。

评论

作者已关闭评论

推荐阅读